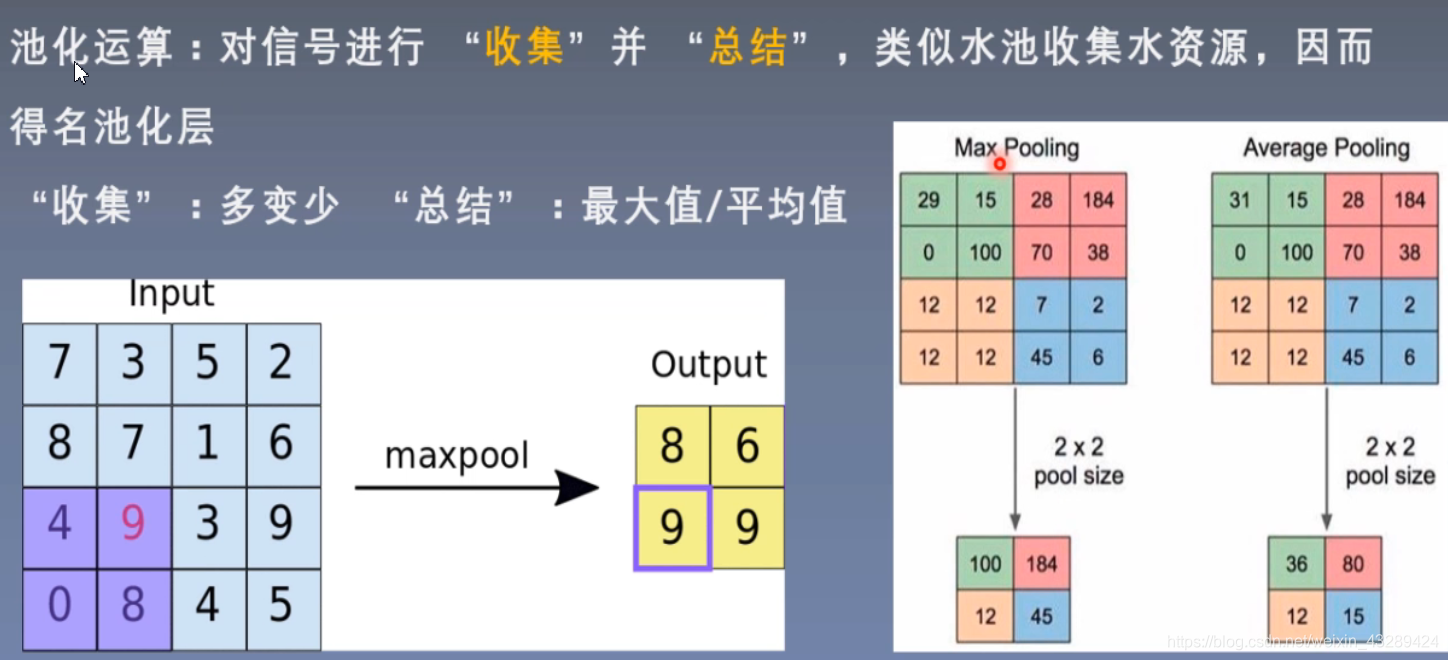

池化层

最大池化、平均池化

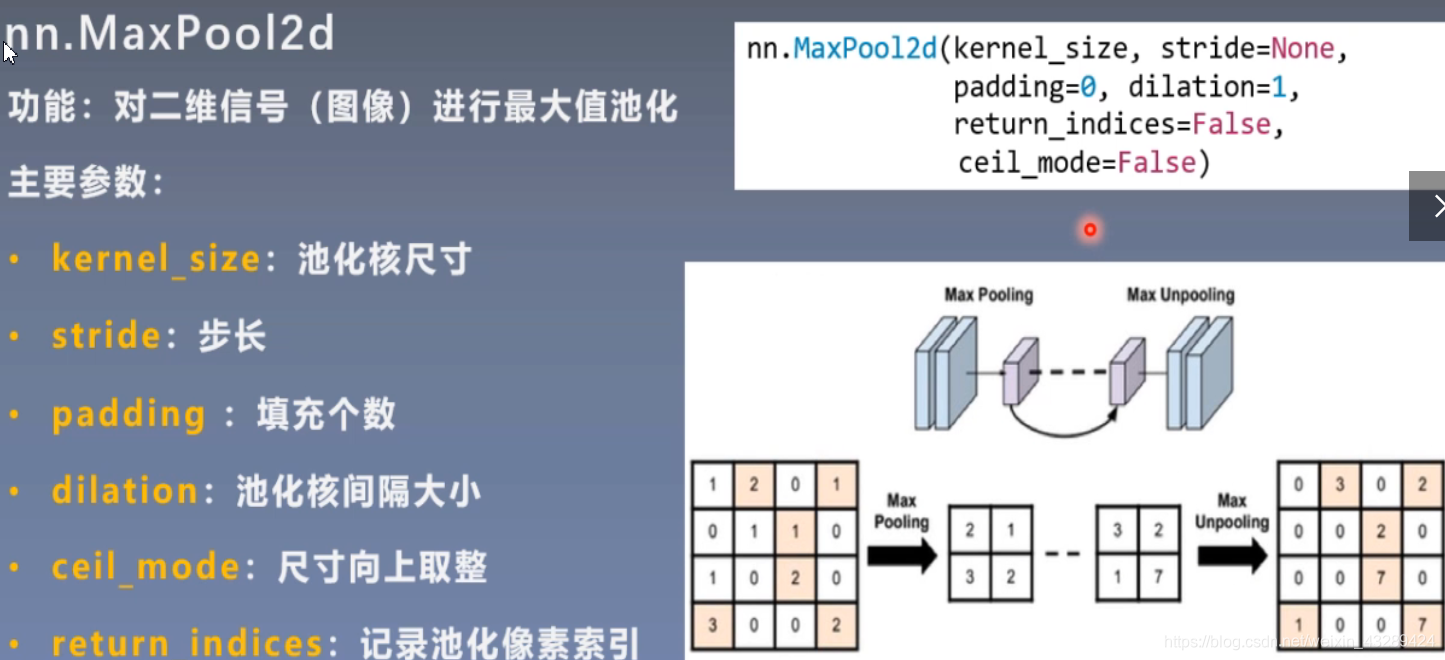

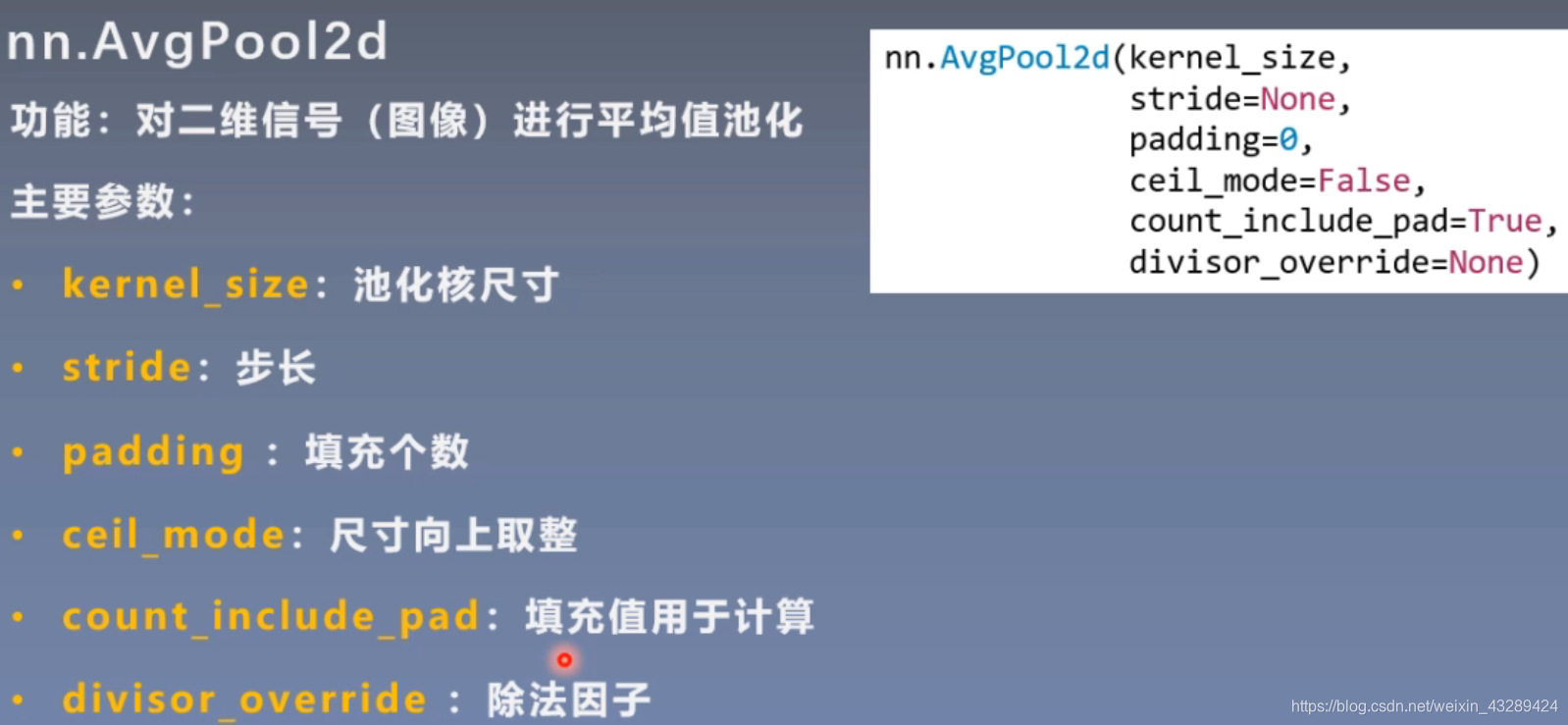

pytorch实现池化(下采样)

最大池化

冗余信息剔除、减小运算量

平均池化

相对于最大池池化的图像亮度较小

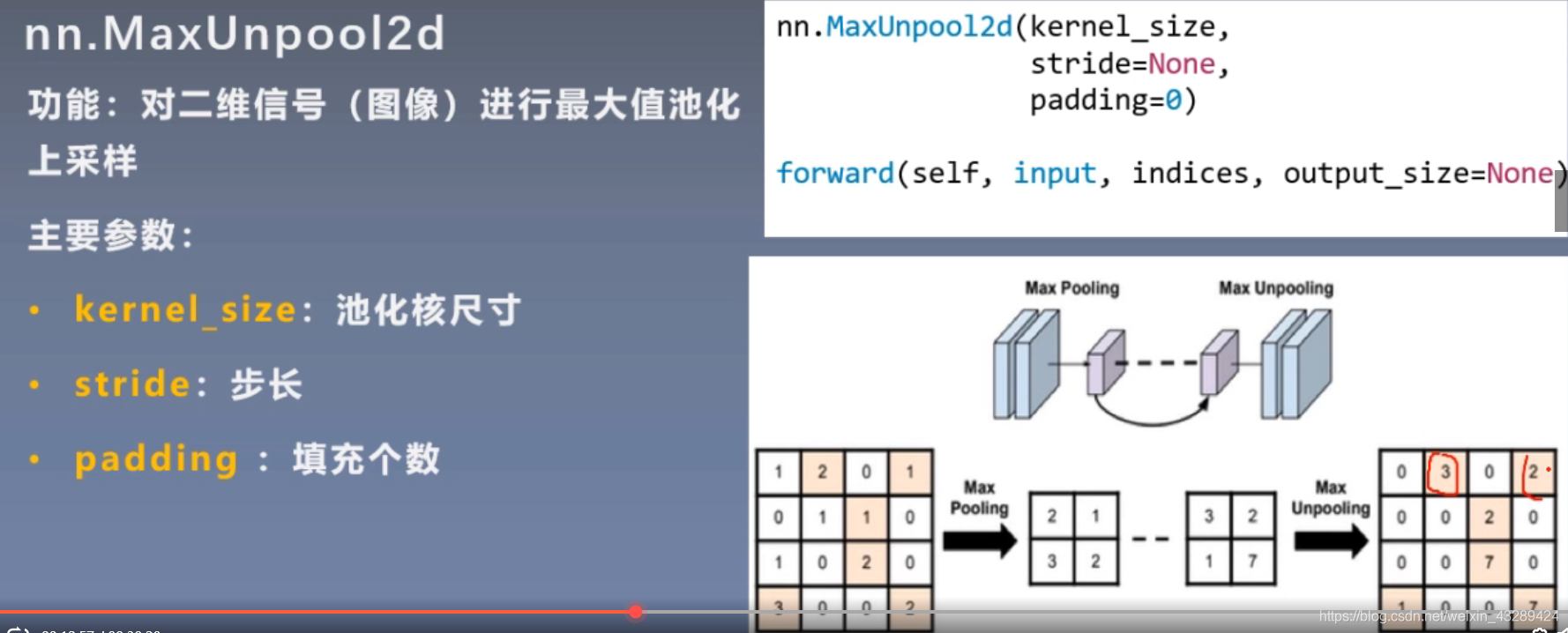

pytorch实现反池化(上采样)

最大值反池化

img_reconstruct = torch.randn_like(img_pool, dtype=torch.float)

maxunpool_layer = nn.MaxUnpool2d((2, 2), stride=(2, 2))

img_unpool = maxunpool_layer(img_reconstruct, indices)

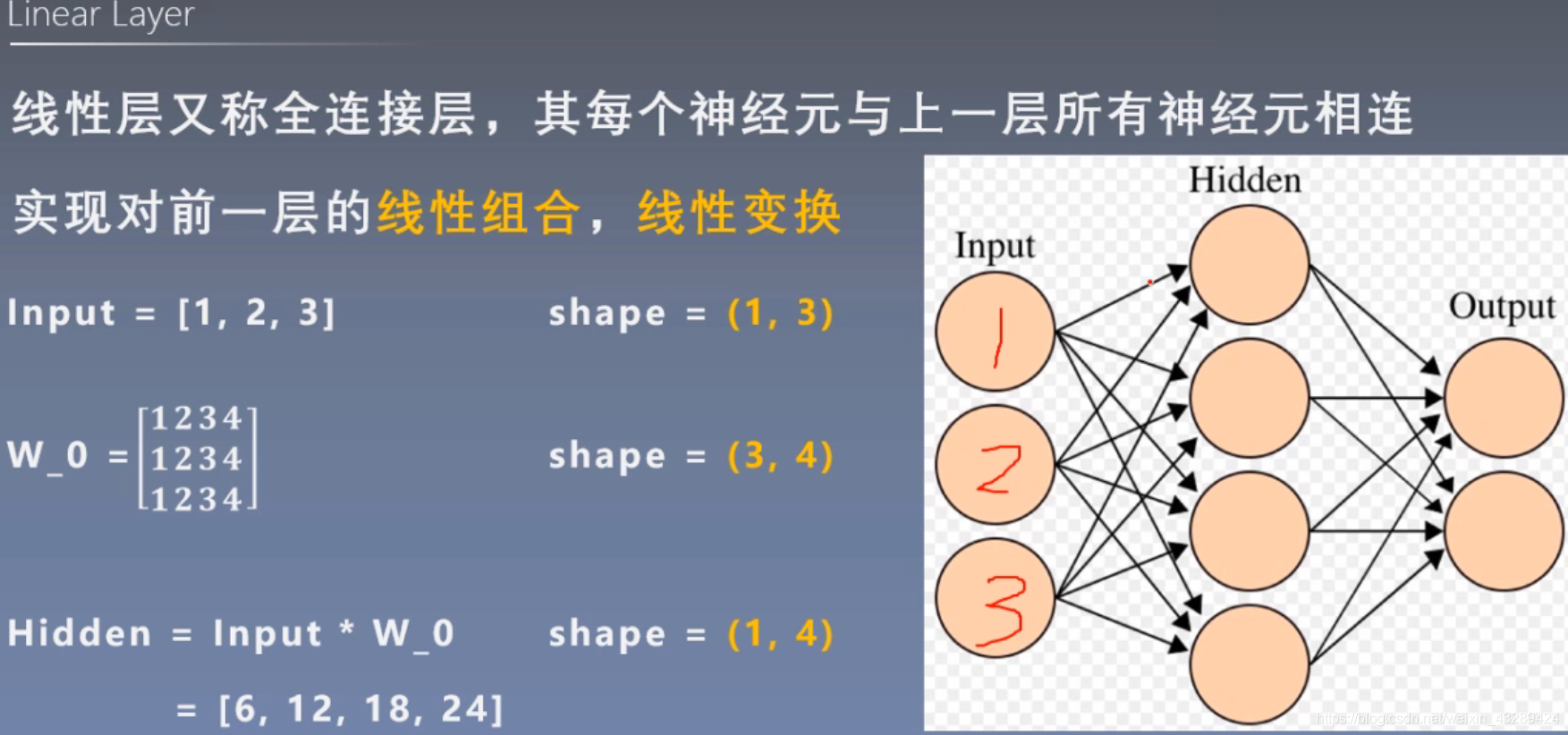

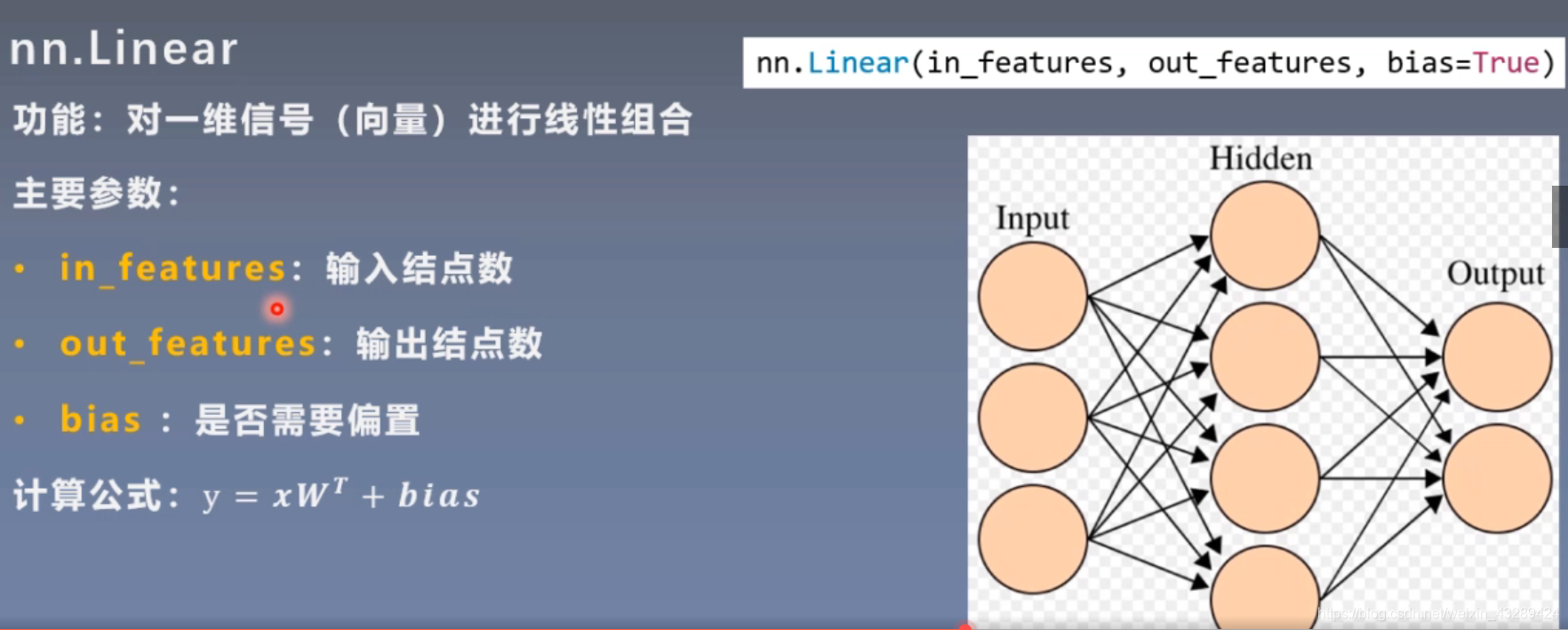

线性层

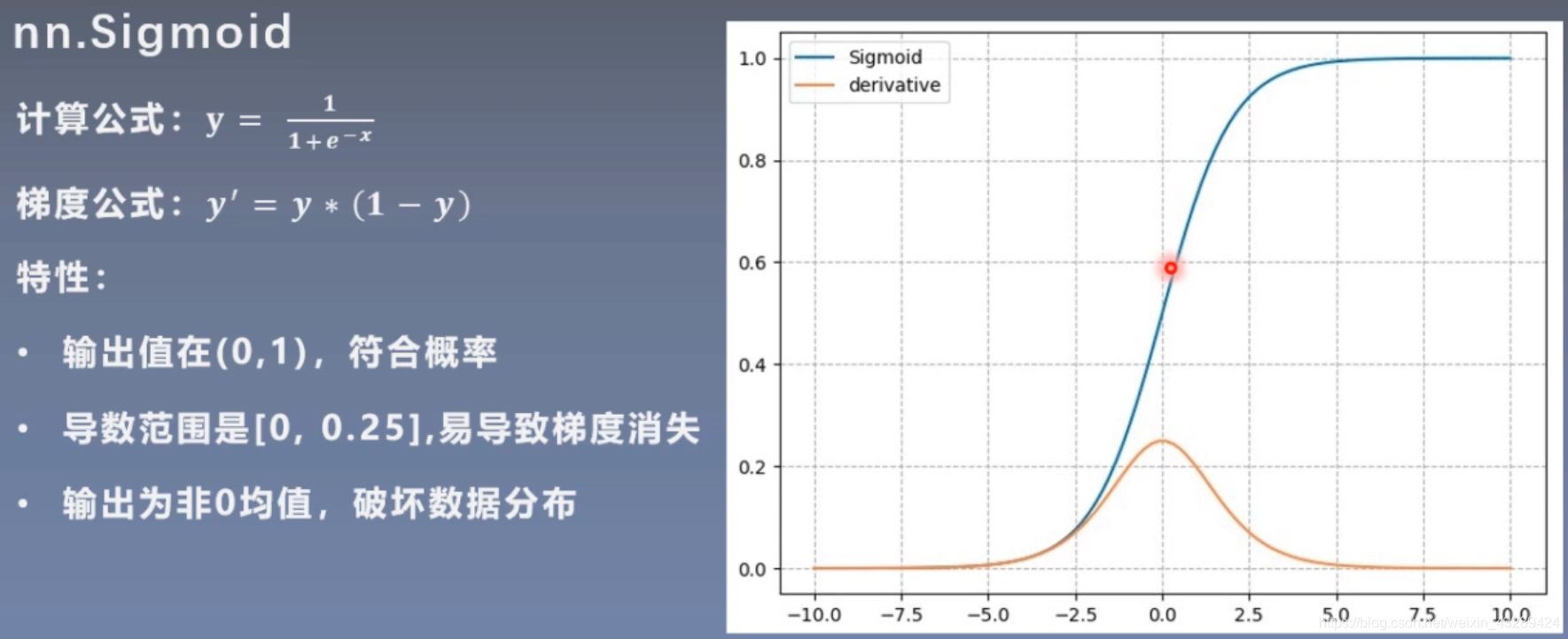

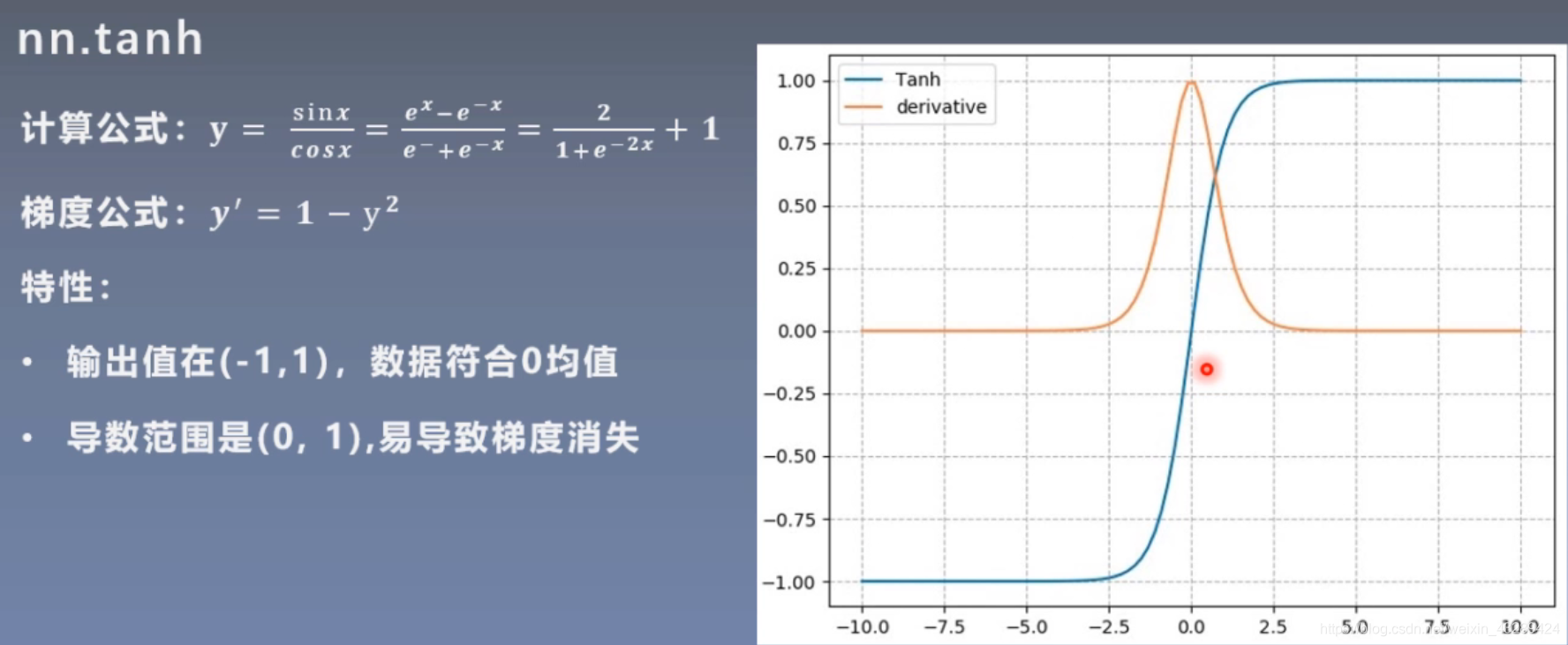

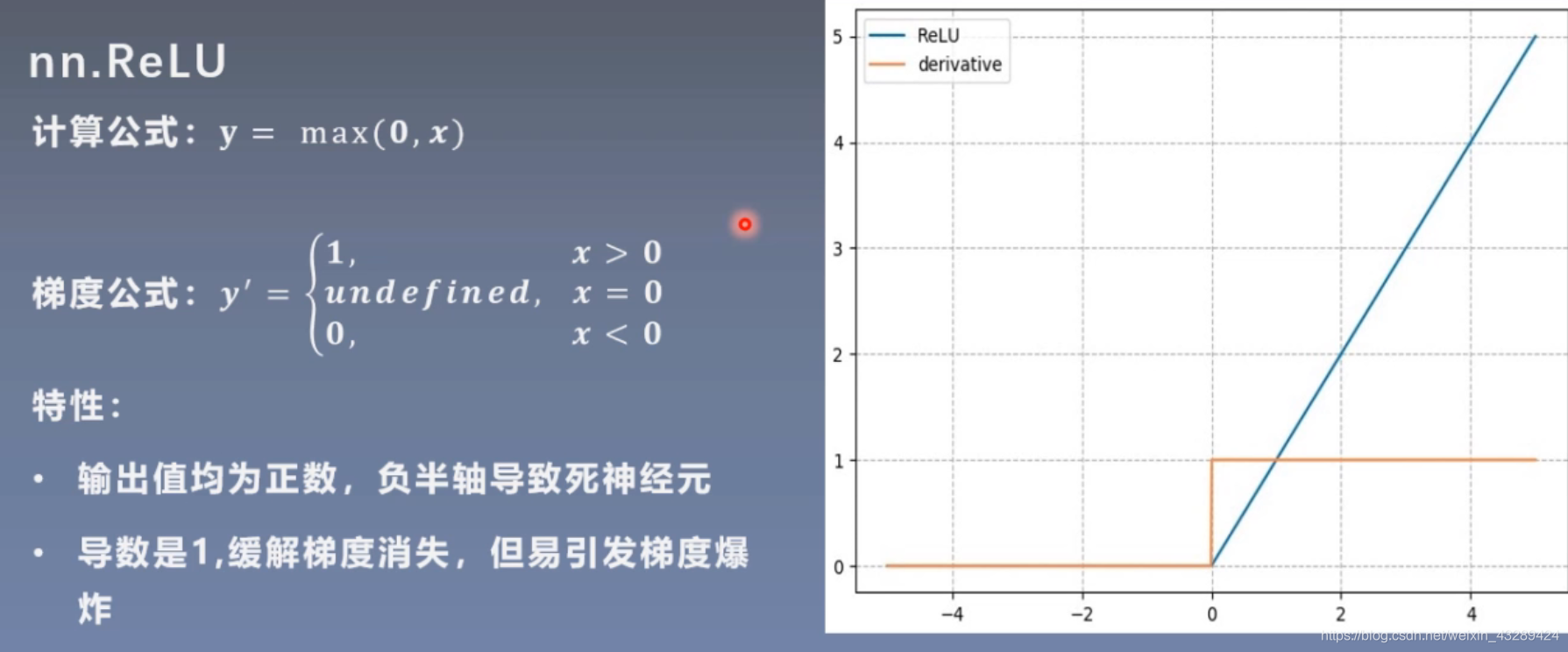

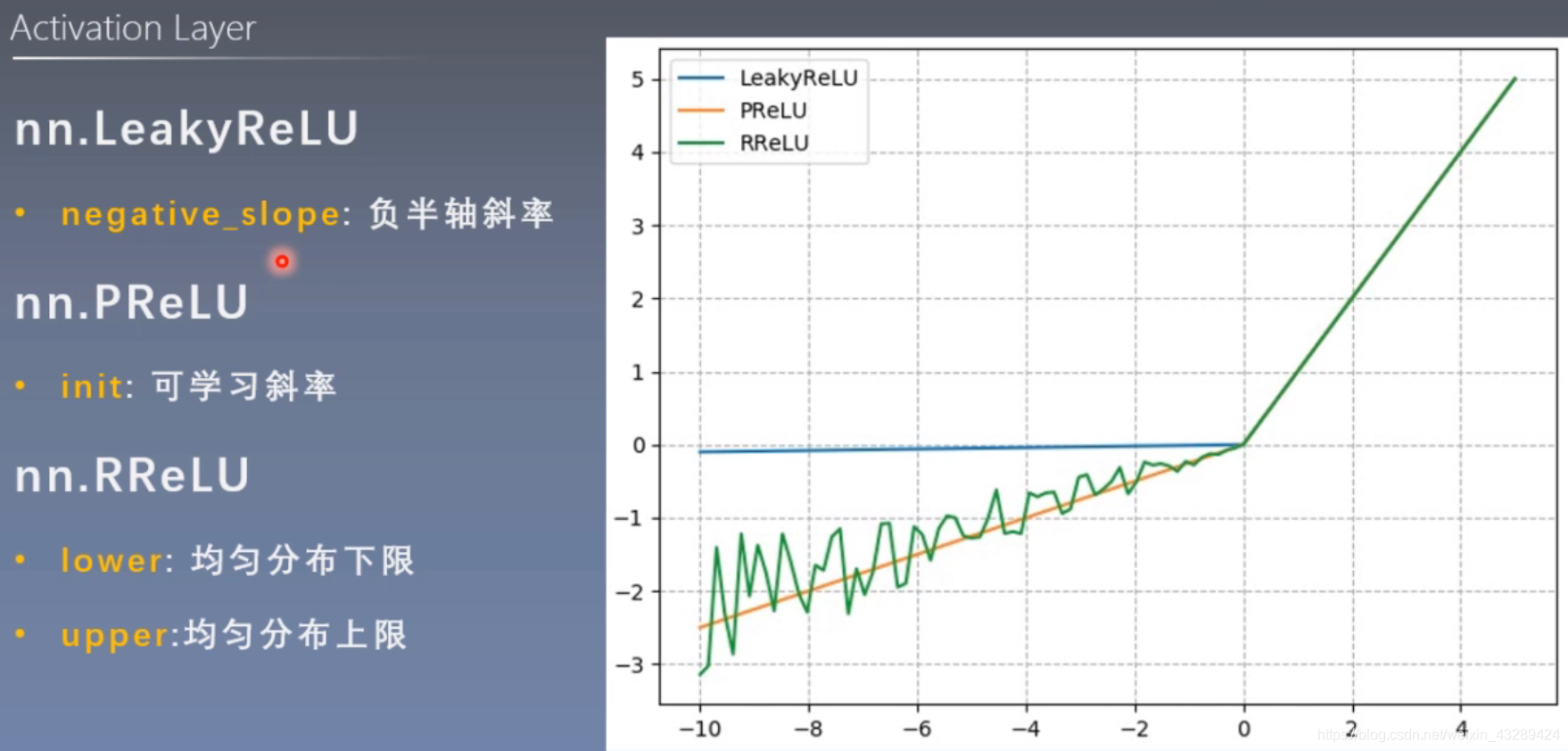

激活函数层

非线性变换

sigmoid

tanh

relu

本文详细解析了深度学习中池化层的作用,包括最大池化和平均池化,并介绍了PyTorch框架下如何实现这些操作。同时,探讨了反池化过程,即上采样技术,如最大值反池化,并解释了其在神经网络中的应用。

本文详细解析了深度学习中池化层的作用,包括最大池化和平均池化,并介绍了PyTorch框架下如何实现这些操作。同时,探讨了反池化过程,即上采样技术,如最大值反池化,并解释了其在神经网络中的应用。

2266

2266

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?