众所周知,一些领域对速度与精度的要求都很高,比如自动驾驶、机器人交互、医疗影像...为了满足这些需求,推动场景的落地应用,针对YOLO+SAM的研究逐渐火热,成为了当前CV领域的热门研究方向。

原理在于,YOLO以实时性为核心优势,但分割精度不足;SAM通用分割能力强,但推理速度慢。这两者结合,既能提供快速目标检测框,又可以基于检测结果精细化分割,完美实现实时检测+高精度分割!为动态场景下的高效精细感知提供了新思路。

当前主流方法在效率、任务对齐、领域适应上还存在问题,推荐论文er围绕模型架构设计、任务协同机制、落地场景优化展开,多注意视频理解、3D分割等延伸方向。我这边整理了10篇YOLO+SAM相关新论文,idea和代码都值得参考,需要的可无偿获取。

全部论文+开源代码需要的同学看文末

SAM-YOLO: An Improved Small Object Detection Model for Vehicle Detection

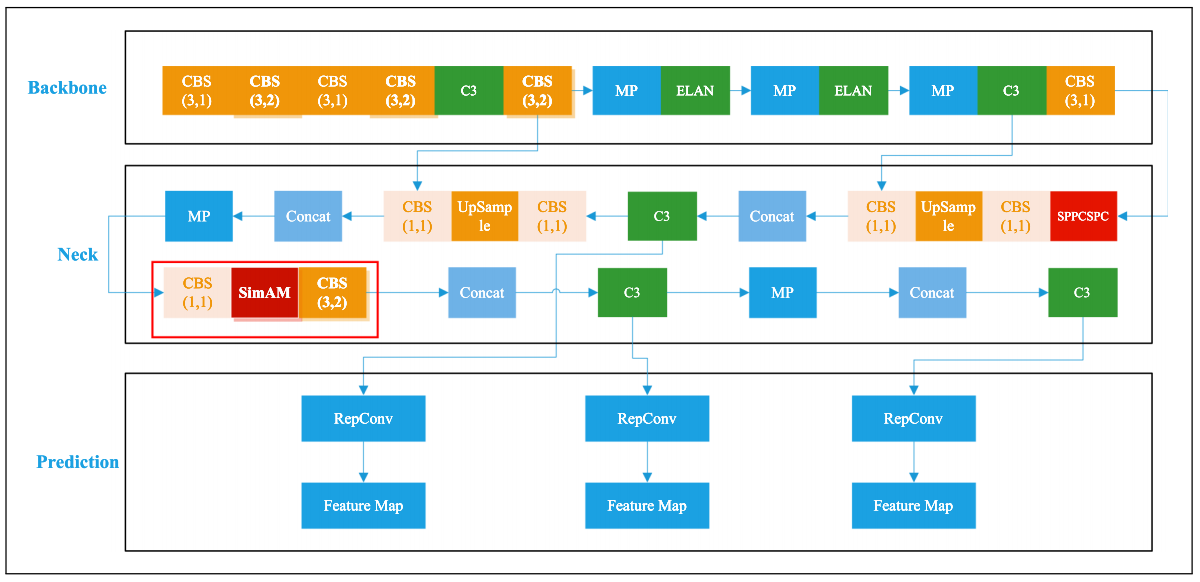

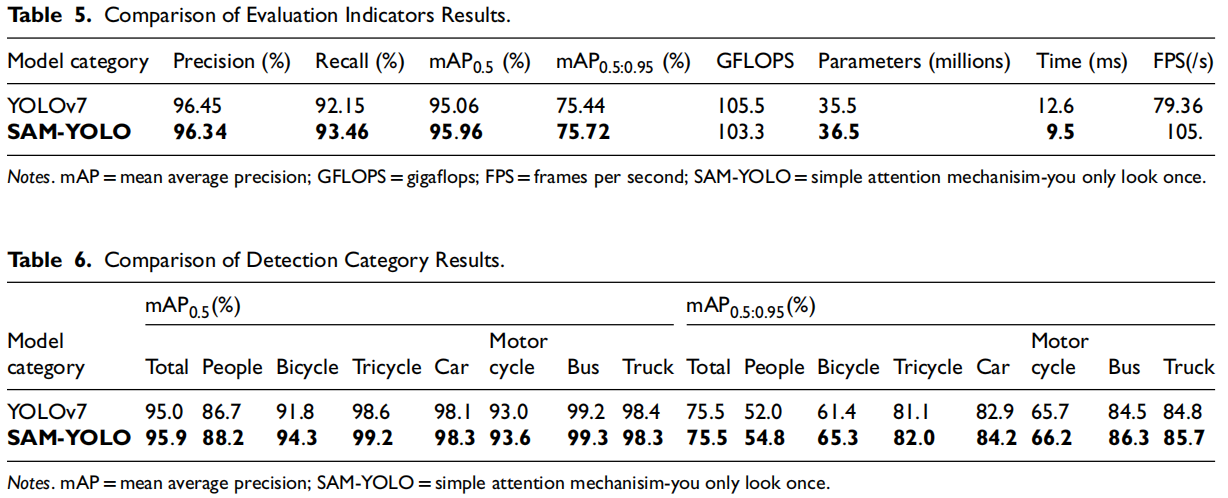

方法:论文提出了一种改进的车辆检测算法SAM-YOLO,它在YOLOv7的基础上引入了简单注意力机制(SimAM),并优化了网络结构和损失函数。通过这些改进,SAM-YOLO在小目标检测和复杂光照条件下的性能得到了显著提升,同时保持了较高的计算效率。

创新点:

-

结合通道级和空间级信息,SimAM通过建模多维依赖关系、结构信息和全局特性,提升小目标检测的精度。

-

通过将冗余部分替换为C3模块,简化YOLOv7的主干网络,同时引入SIoU损失函数以优化目标框的匹配准确性。

-

通过改进数据增强技术以及优化网络结构,SAM-YOLO在极端光照条件下表现出更高的鲁棒性。

Quantifying Bubble-Induced Diffusion Resistance Through Real-Time Sam-Assisted Yolo High Density Bubble Detection Algorithm

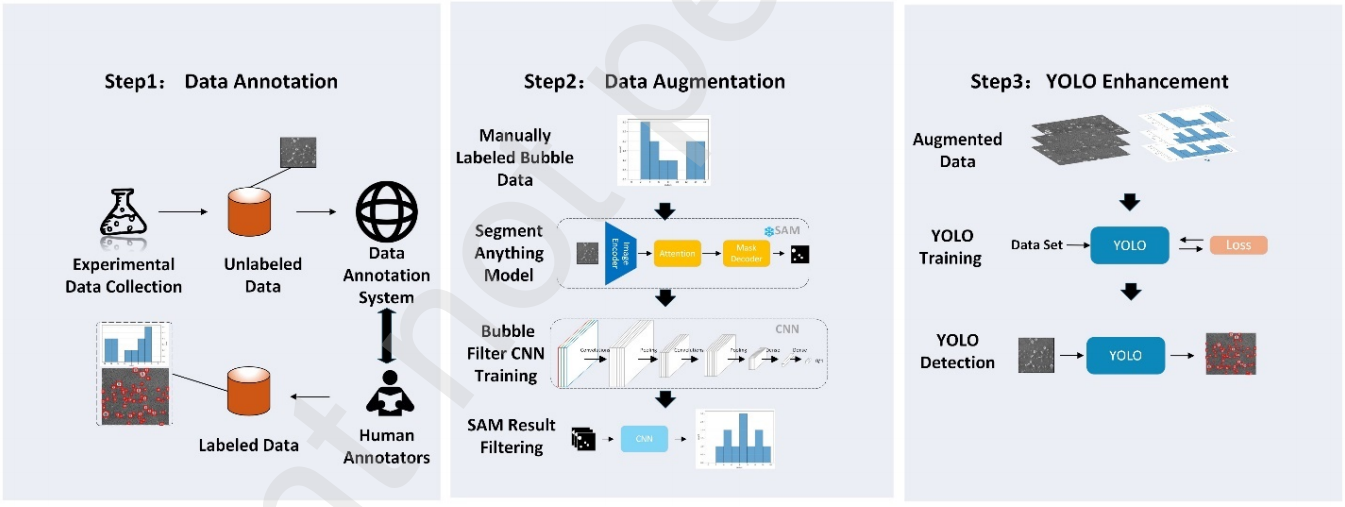

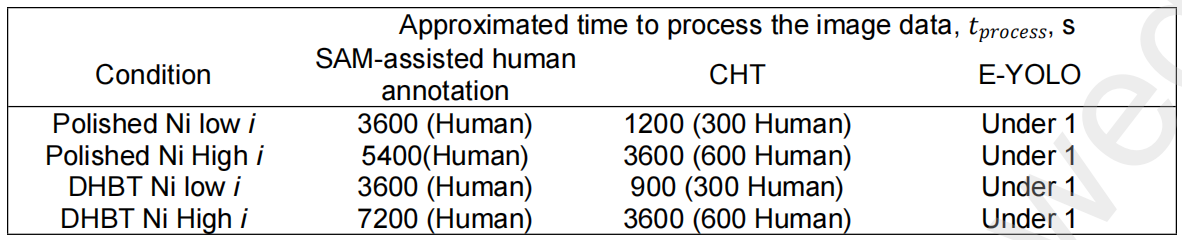

方法:论文提出了一种结合YOLO和SAM的气泡检测方法。通过SAM辅助YOLO,显著降低了训练成本,同时提高了对高密度和重叠气泡的检测精度。不仅提升了气泡计数的效率,还通过与电化学阻抗谱(EIS)结合,建立了气泡分布与扩散阻力之间的关系,为优化气泡管理和提高电解效率提供了新的视角。

创新点:

-

将Segment Anything Model (SAM) 与 YOLO 算法相结合,用于检测高密度、重叠的气泡场景。

-

首次将气泡层厚度与扩散阻力通过气泡尺寸 (D32) 建立起直接联系。

-

通过数据分割框架确保 YOLO 模型的训练数据不包含重复或相似的对象实例,从而减少了数据冗余,避免了过拟合。

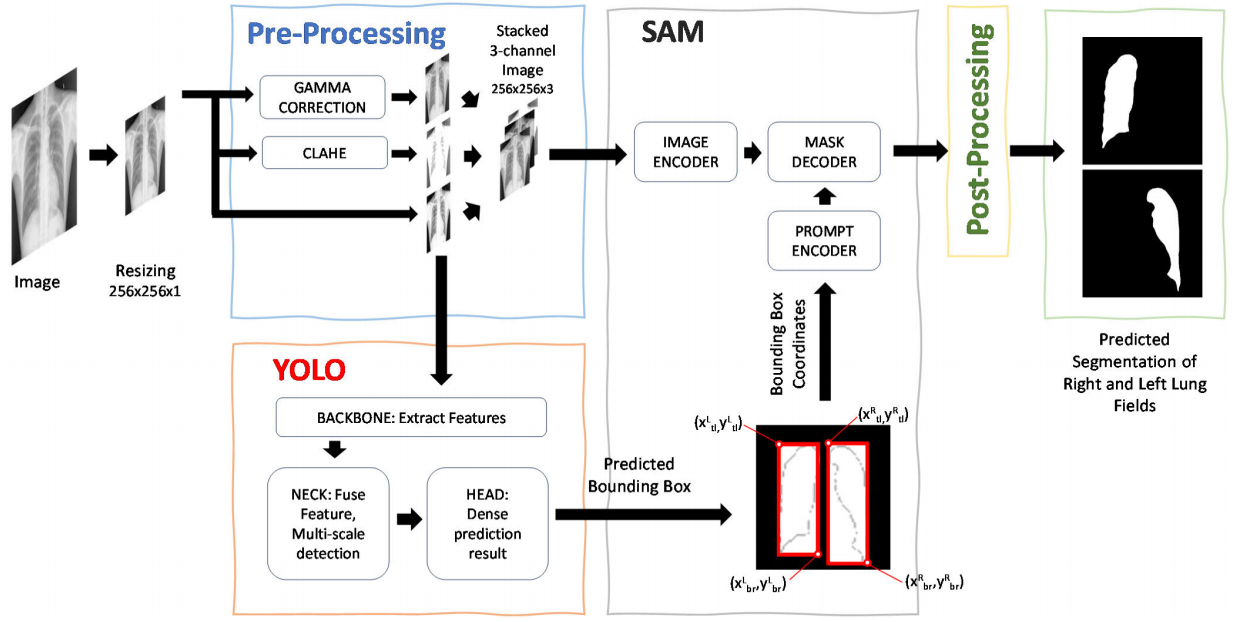

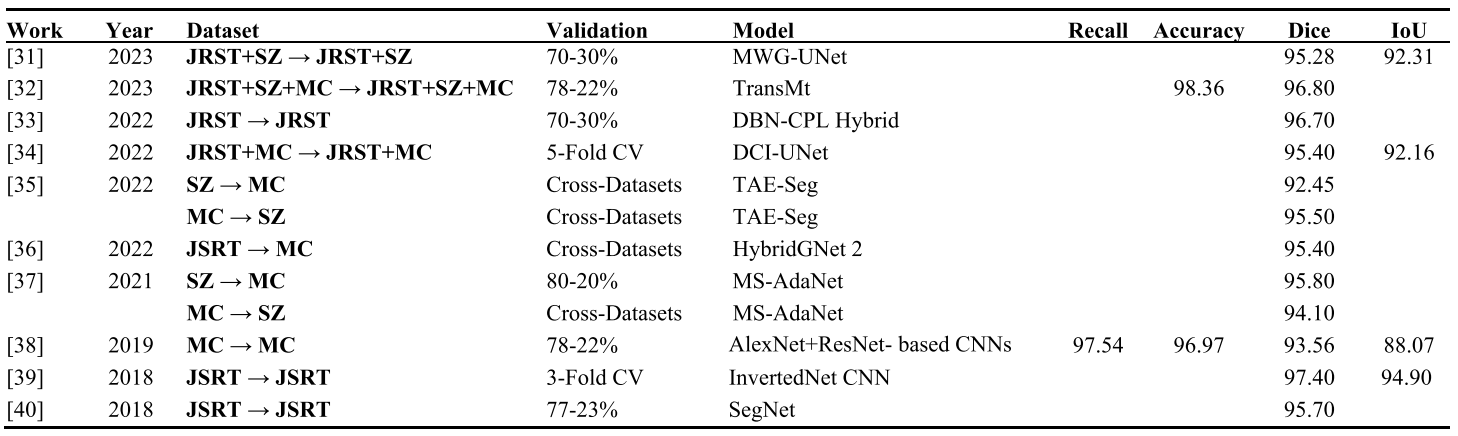

Automatic Lung Segmentation in Chest X-Ray Images Using SAM With Prompts From YOLO

方法:论文提出了一种全自动框架,用于胸部X光图像中的肺部分割。结合了YOLO模型的高效目标检测能力和SAM模型的零样本分割能力。YOLO模型首先检测肺部区域并生成边界框作为提示,然后SAM模型利用这些提示进行详细的肺部轮廓分割,从而提高了分割的准确性和泛化能力。

创新点:

-

首次将YOLO模型与SAM相结合,用于胸部X射线图像中的肺部分割任务。

-

提出使用几何提示(如边界框)指导SAM进行分割,并设计了结合Soft Jaccard Focal和Tversky损失函数的混合优化方法,平衡精确性与召回率,改善像素级分割性能。

-

采用多种公共数据集和多种验证策略对模型性能进行评估,并创建了公平比较的新基准。

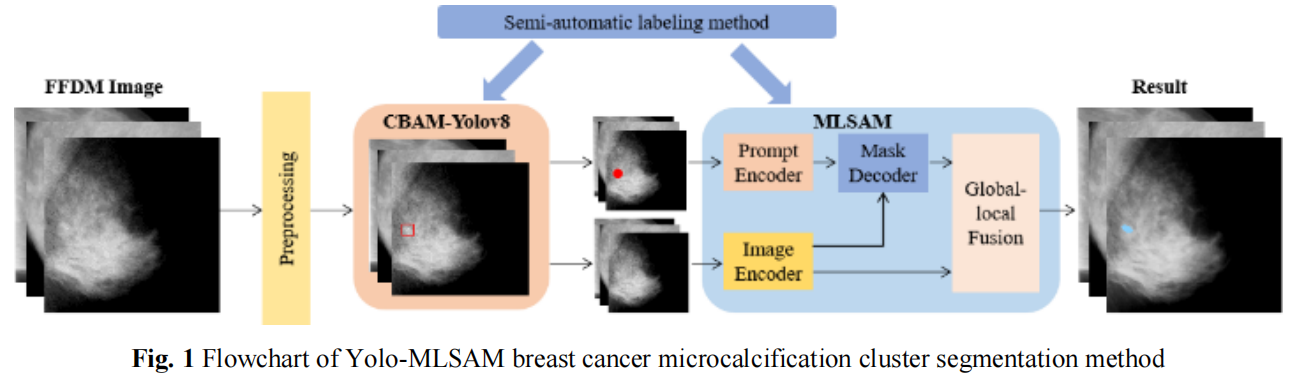

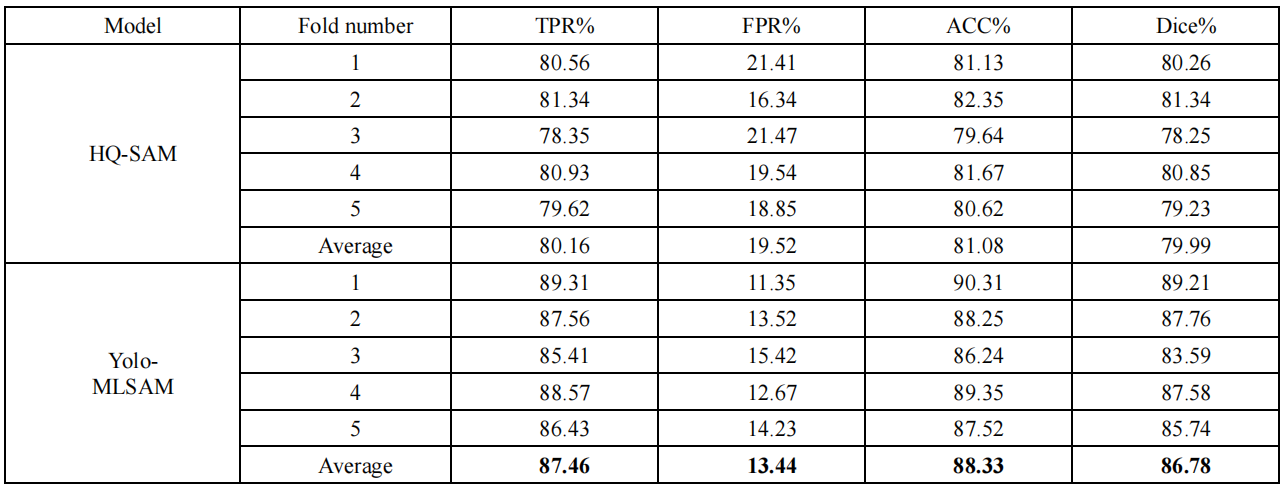

Yolo-MLSAM: SAM Based Breast Cancer Microcalcification Cluster-Segmentation Method

方法:论文提出了一种名为 Yolo-MLSAM 的乳腺癌微钙化簇分割方法,结合了 Yolov8 和 MLSAM 模型。Yolov8 用于精确定位病变区域并提取最亮点作为提示,MLSAM 则利用多级特征融合进行详细语义分割,最终实现半自动标注功能,降低人工成本。

创新点:

-

提出了一种结合Yolov8的区域候选网络和MLSAM模型的图像分割方法,能够精确定位和分割乳腺癌微钙化簇。

-

利用预训练模型完成初步标注,并通过医学专家审阅纠正错误或关注未准确分割的病变区域,增强了标注的准确性和完整性。

-

引入额外的中间特征层以加强局部细节的捕捉能力,并通过实验验证了模型尺度的扩展可显著提升细粒度任务的性能。

关注下方《学姐带你玩AI》🚀🚀🚀

回复“目标分割”获取全部方案+开源代码

码字不易,欢迎大家点赞评论收藏

1054

1054

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?