在概率论或信息论中,KL散度( Kullback–Leibler divergence),又称相对熵(relative entropy),是描述两个概率分布P和Q差异的一种方法。它是非对称的,这意味着D(P||Q) ≠ D(Q||P)。特别的,在信息论中,D(P||Q)表示当用概率分布Q来拟合真实分布P时,产生的信息损耗,其中P表示真实分布,Q表示P的拟合分布。

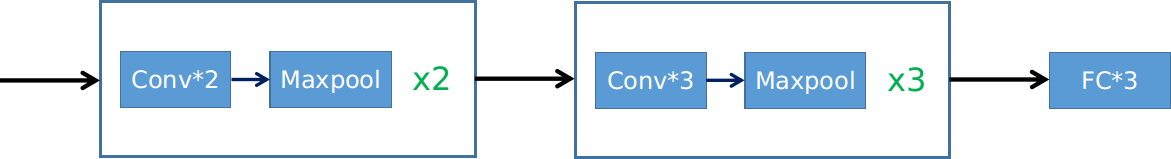

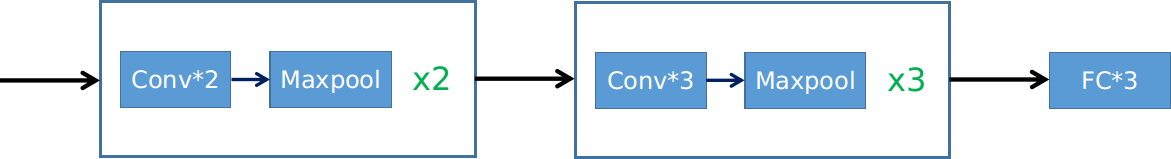

VGG16

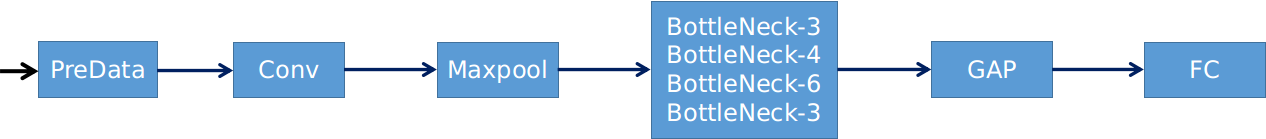

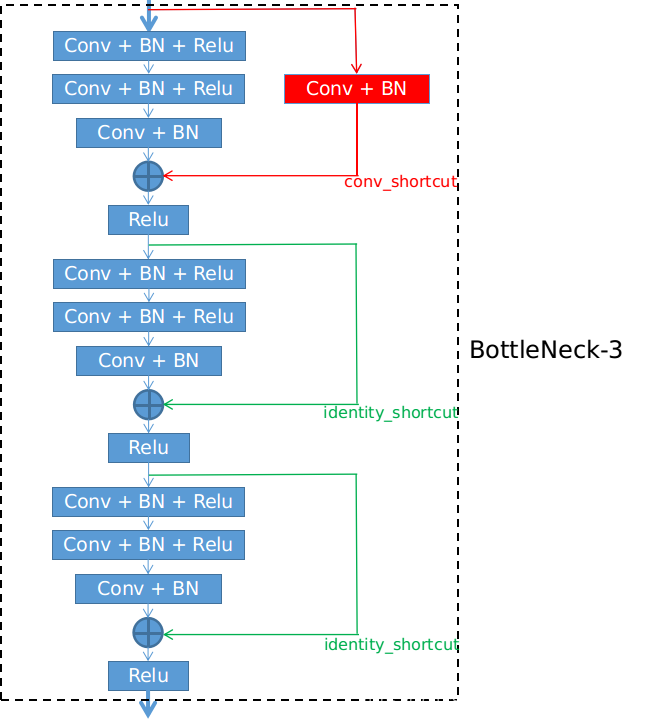

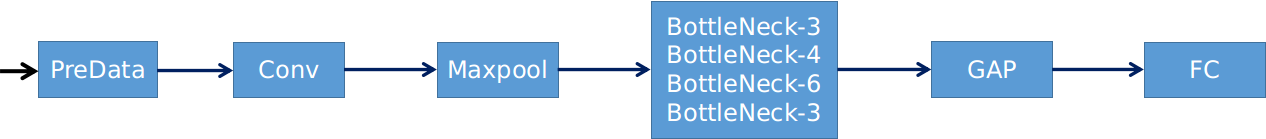

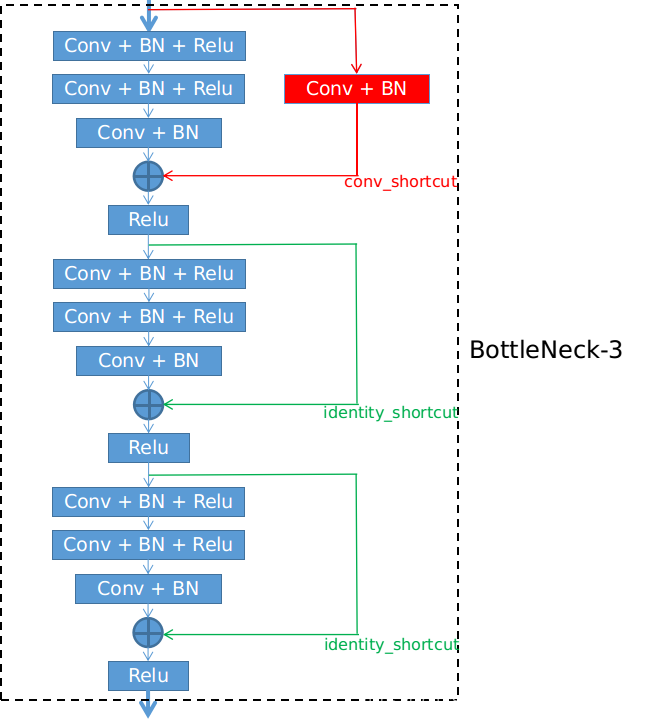

Resnet50 Bottleneck3463

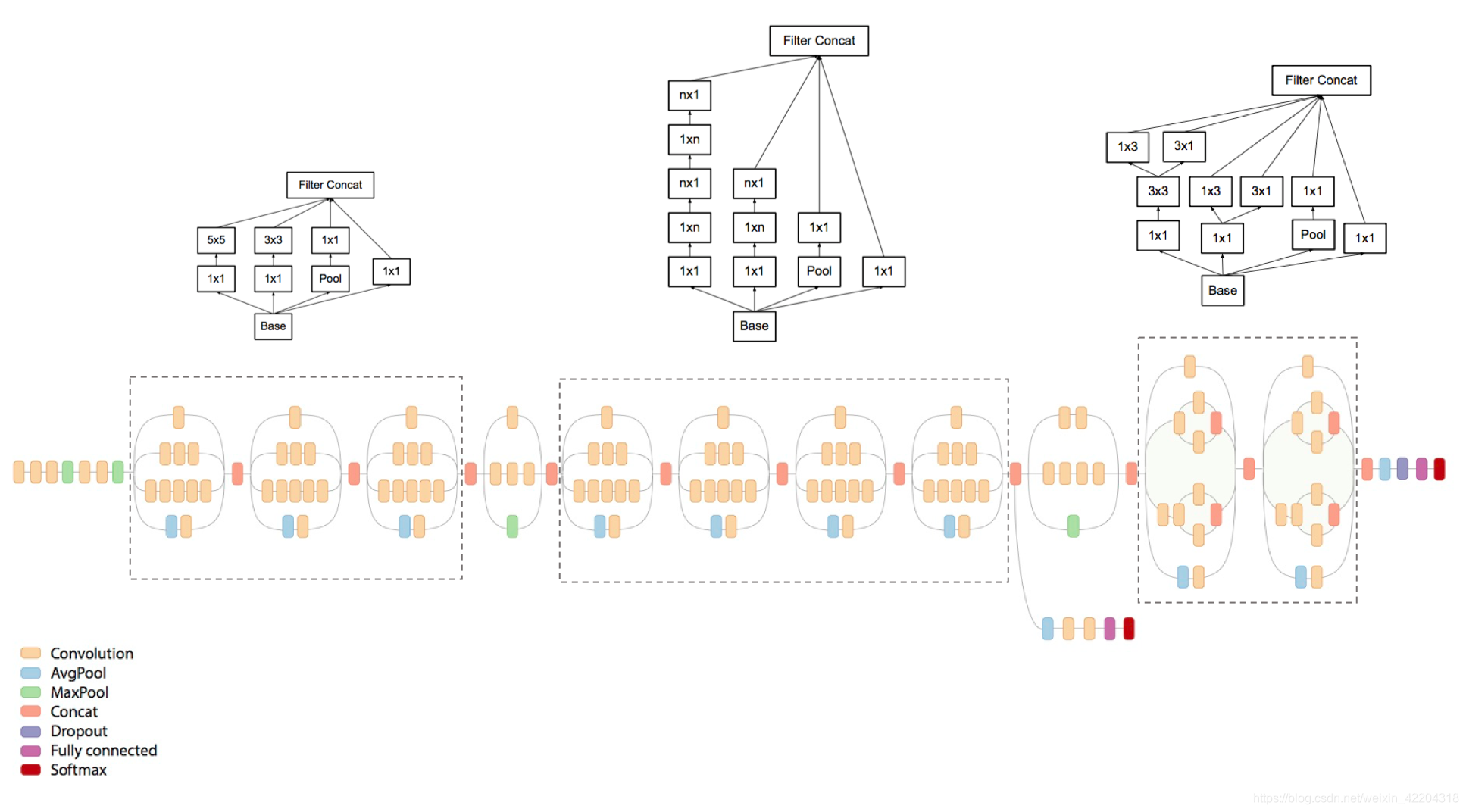

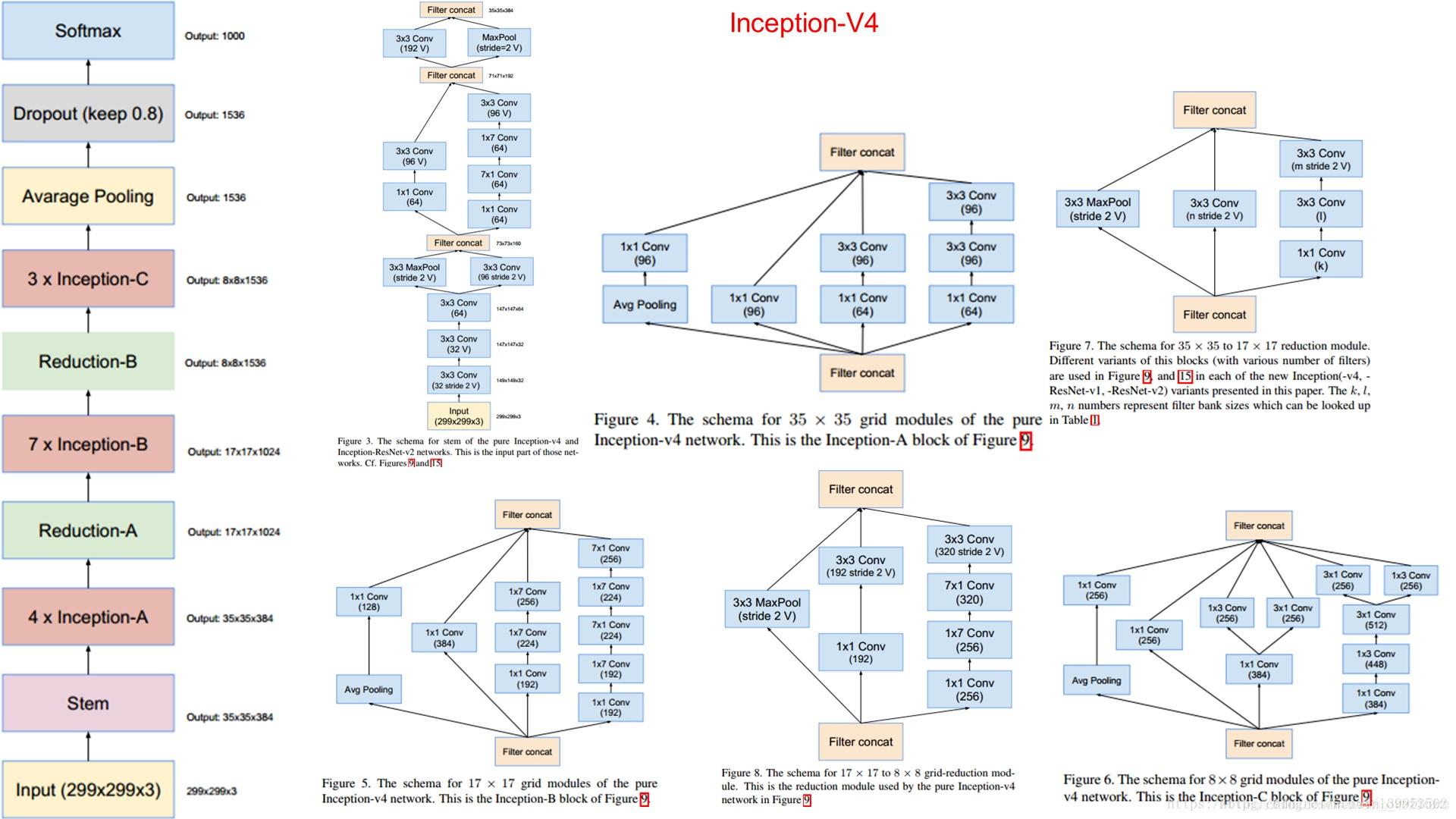

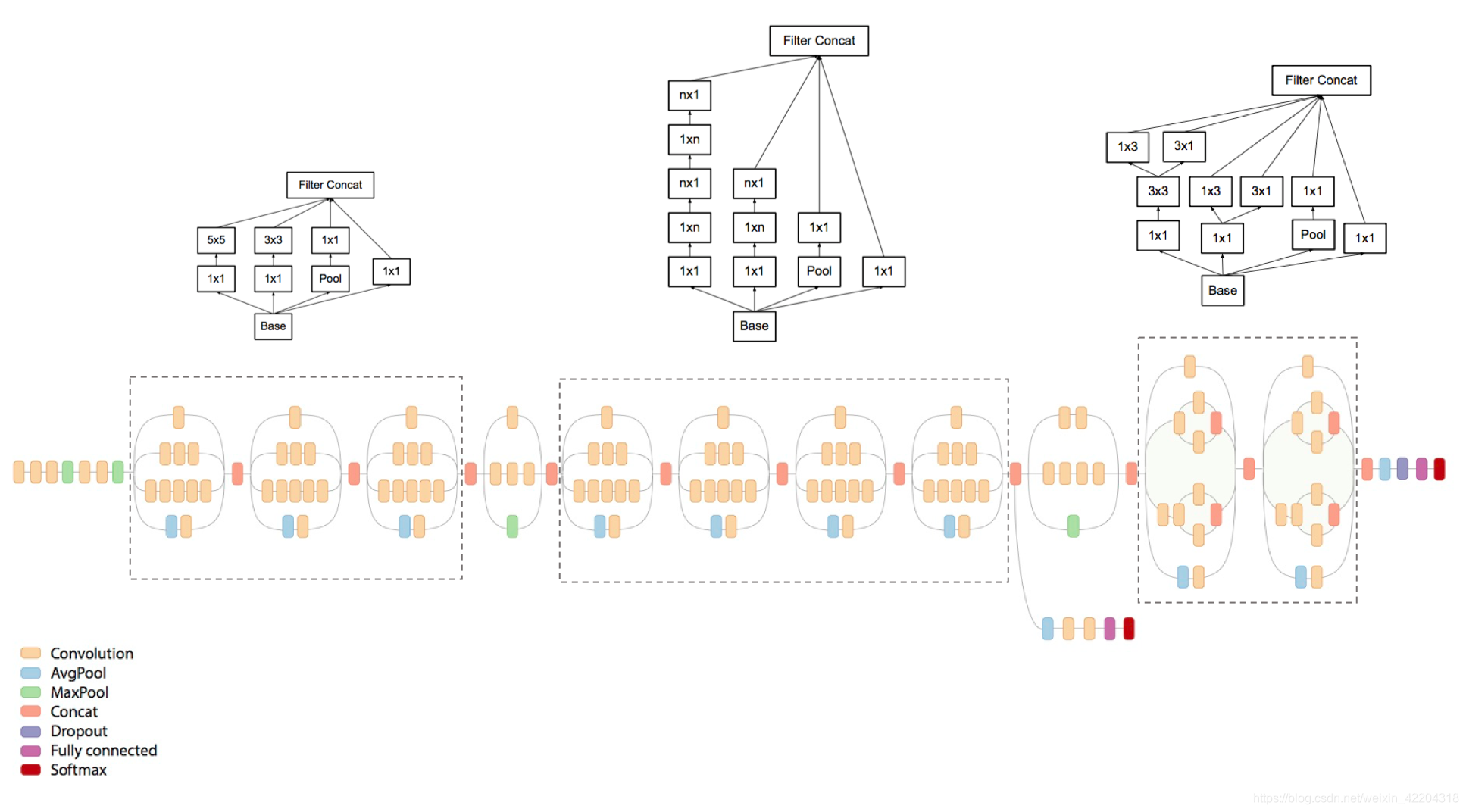

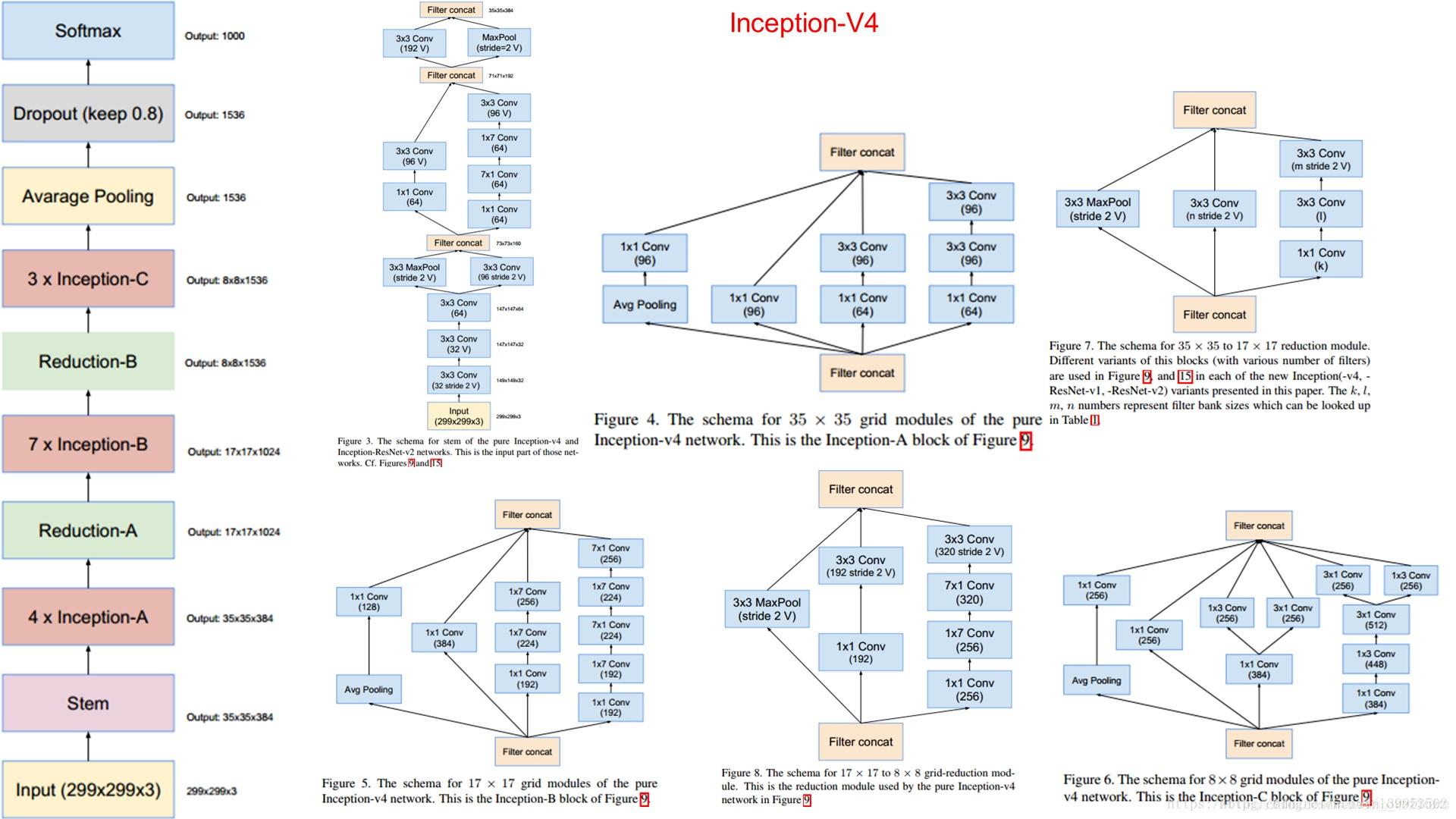

Inception-V3

<

KL散度是衡量两个概率分布差异的非对称指标,常用于信息论和机器学习。它表示使用分布Q近似真实分布P时的信息损失。文章提及VGG16, Resnet50和Inception-V3等深度学习模型。"

111951969,10297172,锐捷上网认证问题及解决方案,"['网络认证', '锐捷路由器', '网络故障排查', '网络连接问题', '802.1x认证']

KL散度是衡量两个概率分布差异的非对称指标,常用于信息论和机器学习。它表示使用分布Q近似真实分布P时的信息损失。文章提及VGG16, Resnet50和Inception-V3等深度学习模型。"

111951969,10297172,锐捷上网认证问题及解决方案,"['网络认证', '锐捷路由器', '网络故障排查', '网络连接问题', '802.1x认证']

在概率论或信息论中,KL散度( Kullback–Leibler divergence),又称相对熵(relative entropy),是描述两个概率分布P和Q差异的一种方法。它是非对称的,这意味着D(P||Q) ≠ D(Q||P)。特别的,在信息论中,D(P||Q)表示当用概率分布Q来拟合真实分布P时,产生的信息损耗,其中P表示真实分布,Q表示P的拟合分布。

VGG16

Resnet50 Bottleneck3463

Inception-V3

<

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?