lenet5 模型一共有7层(不包括输入层),结构如下图表示

第一层为卷积层:

卷积层的输入是32*32*1,步长:1,卷积核:5*5,深度:6,用一圈0来补位,根据公式

卷积后输出层矩阵宽度的计算:

Outlength=

(inlength-fileterlength+2*padding)/stridelength+1

Outlength:输出层矩阵的宽度

Inlength:输入层矩阵的宽度

Padding:补0的圈数(非必要)

Stridelength:步长,即过滤器每隔几步计算一次结果

计算得出卷积层的输出为28*28*6,卷积核有5x5个连接参数加上1个偏置共26个参数。卷积区域每次滑动一个像素,这样卷积层形成的特征图谱每个的大小是28x28。C1层共有26x6=156个训练参数,有(5x5+1)x28x28x6=122304个连接。

第二层是池化层(应用下采样的方法)

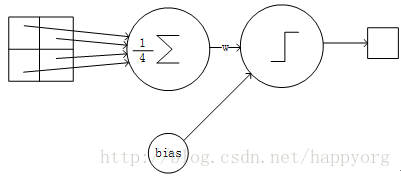

下抽样层采用的是2x2的输入域,即上一层的4个节点作为下一层1个节点的输入,且输入域不重叠,即每次滑动2个像素,深度为16。下抽样节点的结构如下:

(下抽样就是利用图像局部相关性的原理,对图像进行子抽样,可以减少数据处理量同时保留有用信息)。第一个卷积层的6个28x28的特征图谱分别进行以2x2为单位的下抽样得到6个14x14((28-2)/2+1)的图。每个特征图谱使用一个下抽样核。5x14x14x6=5880个连接。

第三层也是卷积层和第

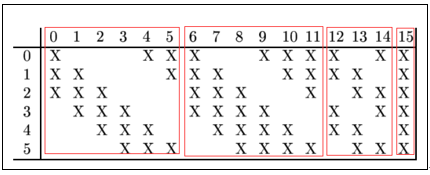

C3层是一个卷积层,卷积和和C1相同,不同的是C3的每个节点与S2中的多个图相连。C3层有16个10x10的图,每个图与S2层的连接的方式如下 所示。C3与S2中前3个图相连的卷积结构见Figure 10.这种不对称的组合连接的方式有利于提取多种组合特征。改成有(5x5x3+1)x6 + (5x5x4 + 1) x 3 + (5x5x4 +1)x6 + (5x5x6+1)x1 = 1516个训练参数,共有1516x10x10=151600个连接。

第四层是池化层,也是采用下采样的方法

S4是一个下采样层。C3层的16个10x10的图分别进行以2x2为单位的下抽样得到16个5x5的图。这一层有2x16共32个训练参数,5x5x5x16=2000个连接。连接的方式与S2层类似。步长为2,深度为16,(10-2)/2+1=5

第五层是一个全连接层(卷积层)

C5层是一个全连接层。由于S4层的16个图的大小为5x5,与卷积核的大小相同,所以卷积后形成的图的大小为1x1。这里形成120个卷积结果。每个都与上一层的16个图相连。所以共有(5x5x16+1)x120 = 48120个参数,同样有48120个连接。C5层的网络结构如下所示。

第六层是一个全连接层,

形成84个卷积结果,在论文里表示的是一个比特图,总共参数为120*84+84=10164个。

第七层是一个全连接层

形成10个卷积结果,论文里表示的是0-9是个数字,总共参数为84*10+10=850。

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?