外星人控制中心-解决方案

平时打不开时,可以断网

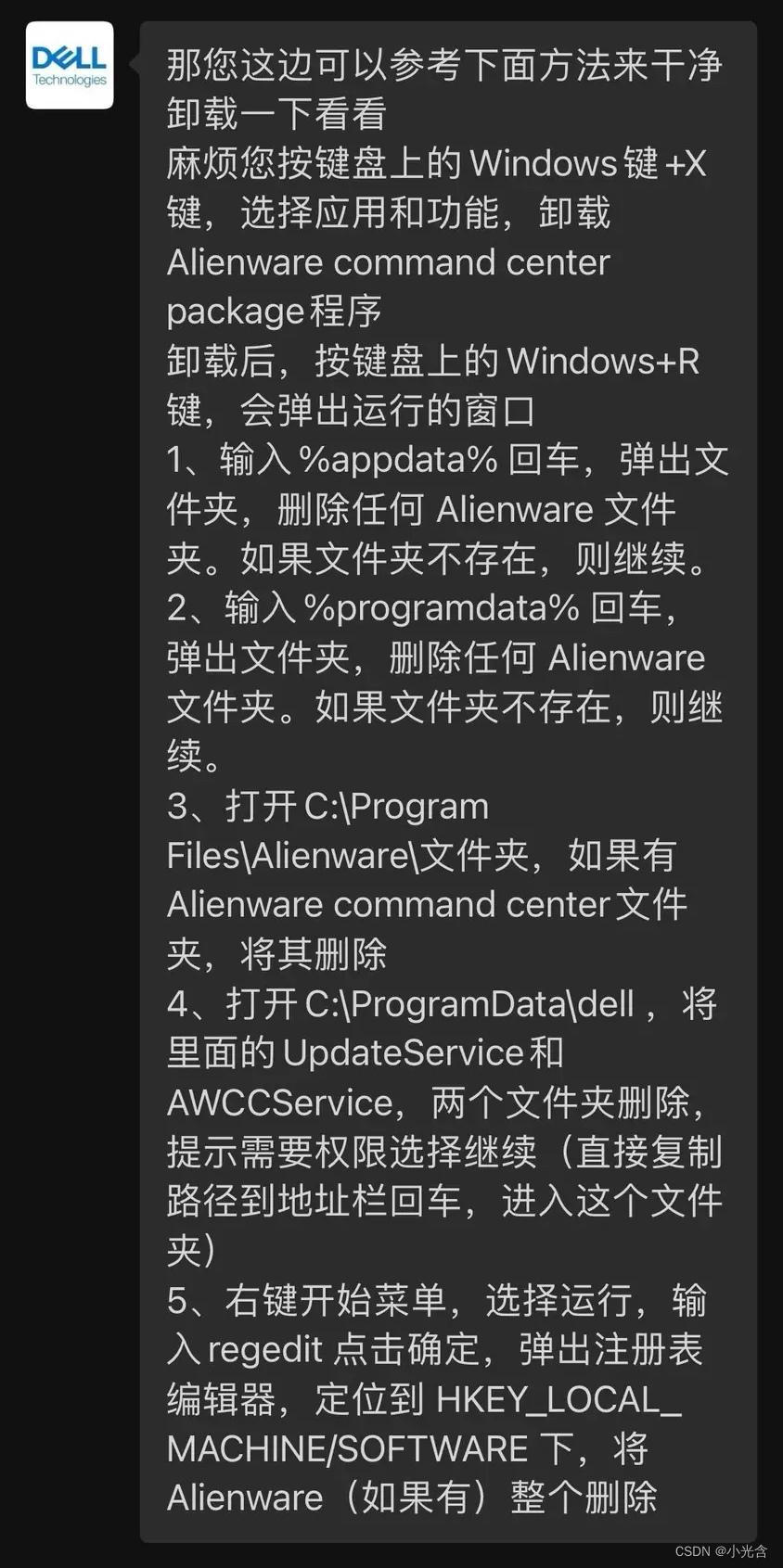

卸载,官方给的教程(我试了三天,一样的操作,不知道为什么就在最后一次成功卸载了,完全玄学)

AWCC真的不好用,卸载麻烦,注册表的每一个文件夹都要看一看

主要原因是之前删除的不干净,注册表有残留,但是无法正常启动,造成无法卸载

解决办法:

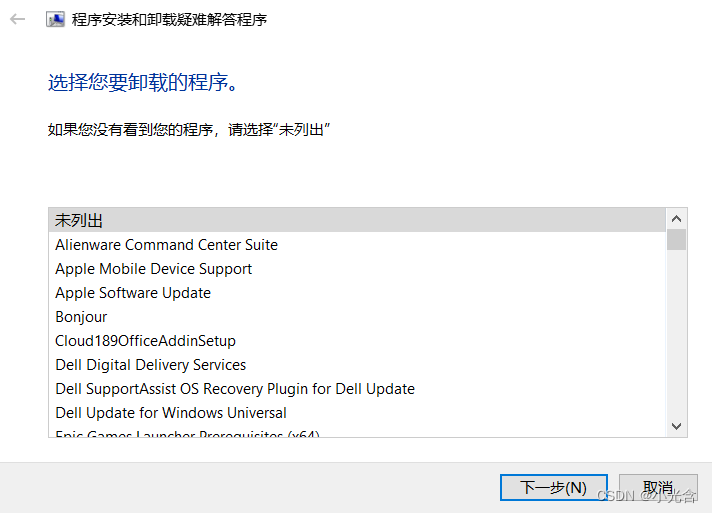

1、进微软官网——支持——搜索:Fix Problem,下载

2、之后通过这个卸载,再重新安装AWCC,完美解决

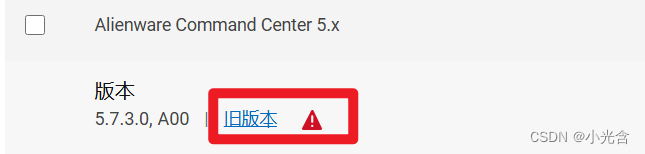

在官网下载当年你买电脑时,对应年份的“旧版本”

!!!下载安装完成后,先打开软件,如果可以正常打开,不要重启!!!

1、把软件上能点的功能都点一遍;

2、配置键盘灯光;

3、把软件上能配置的都配置一遍;

4、初次打开软件后,静置软件,让他自己下载,与适应系统;

5、完美解决;

注意:如果没有进行上述操作,只能重新安装。

替代AWCC的软件

- https://github.com/T-Troll/alienfx-tools

- https://github.com/AlexIII/tcc-g15

794

794

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?