技术背景

随着人工智能技术的飞速发展,视频生成作为生成式AI的重要分支,正逐渐成为研究和应用的热点领域。然而,传统的视频生成模型往往需要通过增大基础模型的参数量和预训练数据来提升性能,这不仅意味着高昂的计算资源需求,还限制了模型在实际应用中的灵活性。在大型语言模型(LLMs)领域,研究人员发现通过在测试阶段增加计算量可以有效提升模型性能,这种测试时扩展(Test-Time Scaling,TTS)的思路为视频生成领域带来了新的突破。

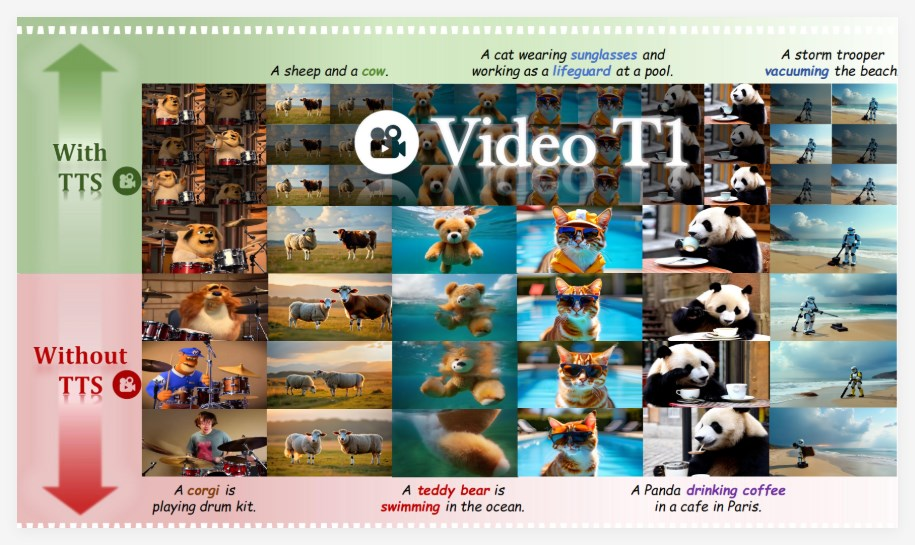

Video-T1的核心方法

Video-T1借鉴了LLMs中的TTS思想,并将其应用于视频生成,无需重新训练模型即可显著提升视频生成质量。其核心方法可以理解为在模型的“噪声空间”中寻找更优的视频生成轨迹,主要提出了两种搜索策略:

随机线性搜索

通过随机采样多个高斯噪声,让视频生成模型逐步去噪这些噪声,生成多个候选视频片段。然后利用测试验证器对这些候选视频进行评分,最终选择评分最高的视频作为最终生成结果。

Tree-of-Frames(ToF)方法

考虑到对所有帧同时进行全步去噪会导致巨大的计算成本,ToF采用了一种更高效的策略。它将视频生成过程分为三个阶段:

- 图像级对齐:初始帧的生成会影响后续帧的生成,通过对初始帧进行精细调整,确保后续帧的生成方向正确。

- 动态提示应用:在测试验证器中动态调整提示,重点关注运动稳定性和物理合理性,根据反馈指导启发式搜索过程。

- 整体质量评估:对生成的视频进行整体质量评估,选择与文本提示最匹配的视频。

ToF的自回归方式使得视频生成过程更加智能化,能够更高效地探索视频生成的可能性。

实验结果与性能提升

实验结果表明,随着测试时计算量的增加(即生成更多的候选视频),模型性能呈现出持续提升的趋势。这意味着即使使用相同的视频生成模型,通过投入更多的推理时间,也能生成更高质量、更符合文本提示的视频。研究人员在多个视频生成模型上进行了实验,结果均显示TTS能够一致地提升性能。

在常见的提示类别(如场景、物体)和易于评估的维度(如图像质量)上,Video-T1的TTS方法取得了显著的改进。例如,在描述“一只戴着太阳镜的猫在泳池边担任救生员”的视频中,经过TTS处理后的视频中,猫的形象更加清晰,救生员的动作也更加自然。

项目开源与使用

Video-T1的代码已经开源,项目地址为:https://github.com/liuff19/Video-T1。该项目的依赖环境包括Python 3.10及以上版本,以及一系列相关的库和模型检查点。用户可以通过克隆仓库、安装依赖、下载模型检查点等步骤来快速上手使用Video-T1。

应用场景与未来展望

Video-T1在多个领域具有广泛的应用前景,包括创意视频制作、影视制作、教育与培训、游戏开发、VR与AR等。它为内容创作者和广告行业提供了快速生成高质量、符合创意需求的视频素材的能力,提升了内容的吸引力和制作效率。

清华大学开源的Video-T1通过创新的测试时扩展策略,为视频生成领域提供了一种新的、有效的提升质量的方法。它避免了昂贵的重新训练过程,而是通过更智能地利用推理时间计算资源,从现有模型中释放出更大的能力。随着进一步的研究,我们有理由相信TTS技术将在视频生成领域发挥越来越重要的作用,为视频生成技术的发展和应用带来更多的可能性。

文档:https://liuff19.github.io/Video-T1/

代码:https://github.com/liuff19/Video-T1

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?