一些问题

与用于图像分类的全连接的DNN相比,CNN有什么优势?

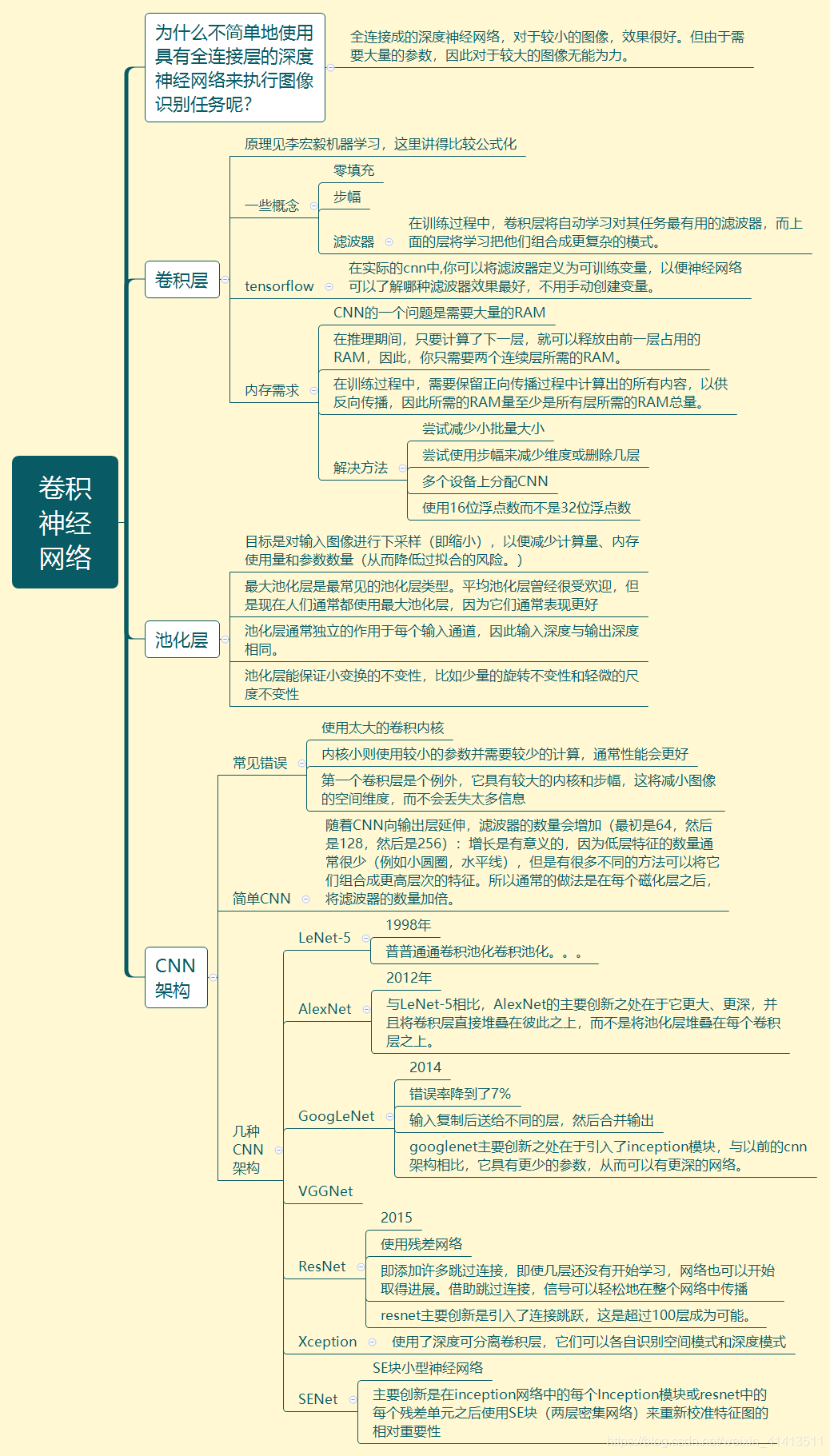

- 因为连续的层仅部分连接,并且由于其大量复用权重,所以CNN参数比全连接的DNN少得多,这使得其训练速度快的多,降低了过拟合的风险,并且需要的训练数据也少的多。

- CNN学会了可以检测到特定特征的内核后,并可以在图像中的任何位置检测到该特征。由于图像通常具有非常重复的特征,因此对于CNN而言,使用较少的训练实例,对比dnn更好的泛化图像处理任务。

- CNN中,较低的层通常在图像的较小区域中识别特征,而较高的层将较低的层的特征组合为较大的特征。

如果训练CNN时CPU内存不足,可以尝试哪五种方法来解决这个问题?

- 减小小批量的大小。

- 在一层或多层中使用较大的步幅来降低维度。

- 去除一层或多层。

- 使用16位浮点数而不是32位浮点数。

- 在多个设备上分布CNN

为什么要添加最大池化层,而不是具有相同步幅的卷积层?

- 最大池化层根本没有任何参数,而卷基层有很多。

关于CNN参数、RAM计算问题

相比于全连接的DNN,卷积神经网络(CNN)因其局部连接和权值共享特性,拥有更少的参数,训练更快,过拟合风险降低,需要的数据量也较小。CNN能有效地检测并定位图像中的特征。当训练CNN时,若CPU内存不足,可尝试减小批量大小、使用大步幅、去除层、降低精度或分布式训练。最大池化层相较于等步幅卷积层的优点在于其无参数。本文探讨了CNN在图像处理中的优势及训练优化方法。

相比于全连接的DNN,卷积神经网络(CNN)因其局部连接和权值共享特性,拥有更少的参数,训练更快,过拟合风险降低,需要的数据量也较小。CNN能有效地检测并定位图像中的特征。当训练CNN时,若CPU内存不足,可尝试减小批量大小、使用大步幅、去除层、降低精度或分布式训练。最大池化层相较于等步幅卷积层的优点在于其无参数。本文探讨了CNN在图像处理中的优势及训练优化方法。

4891

4891

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?