动态页面与静态页面

比较常见的页面形式可以分为两种:

静态页面

动态页面

静态页面和动态页面的区别

使用requests进行数据获取的时候一般使用的是respond.text来获取网页源码,然后通过正则表达式提取出需要的内容。

例如:

1import requests

2response = requests.get('https://www.baidu.com')

3print(response.text.encode('raw_unicode_escape').decode())

但是动态页面使用上述操作后发现,获取到的内容与实际相差很大。

例如我们打开如下页面:

https://www.aqistudy.cn/historydata/monthdata.php?city=北京

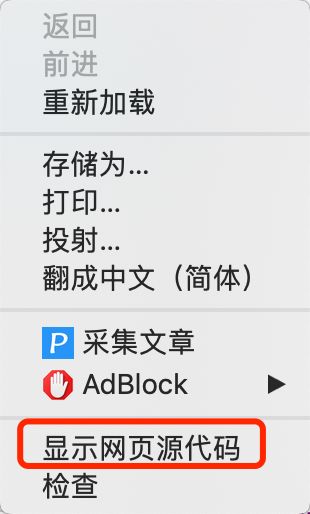

右键选择查看网页源代码

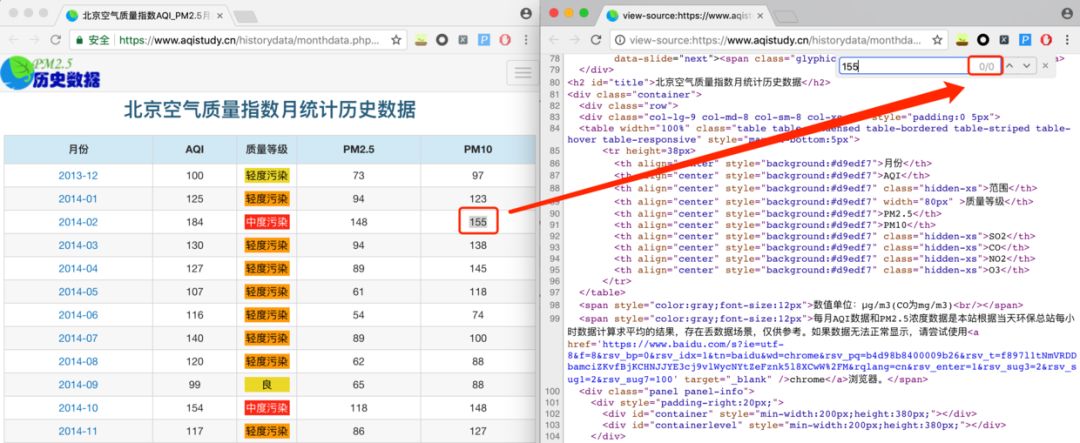

在网页源代码中查找页面中存在的一个数据:2014-02的PM10为155。

这时打开F12查看Elements 可以看到155在元素中有显示

综上基本可以明白静态页面和动态页面的区别了。

有两种方式可以获取动态页面的内容:

破解JS,实现动态渲染

使用浏览器模拟操作,等待模拟浏览器完成页面渲染

由于第一个比较困难所以选择方法二

需求分析

获取各个城市近年来每天的空气质量

日期

城市

空气质量指数

空气质量等级

pm2.5

pm10

so2

co

no2

o3

使用scrapy

scrapy操作的基本流程如下:

11.创建项目:scrapy startproject 项目名称

22.新建爬虫:scrapy genspider 爬虫文件名 爬虫基础域名

33.编写item

44.spider最后return item

55.在setting中修改pipeline配置

66.在对应pipeline中进行数据持久化操作

创建

打开命令行,输入scrapy startproject air_history ,创建一个名为air_history的scrapy项目

进入该文件夹,输入scrapy genspider area_spider "aqistudy.cn",可以发现在spiders文件夹下多了一个名为area_spider的py文件

文件目录结构大概如下:

1.

2├── air_history

3│ ├── __init__.py

4│ ├── items.py

5│ ├── middlewares.py

6│ ├── pipelines.py

7│ ├── __pycache__

8│ │ ├── __init__.cpython-36.pyc

9│ │ └── settings.cpython-36.pyc

10│ ├── settings.py

11│ └── spiders

12│ ├── area_spider.py

13│ ├── __init__.py

14│ └── __pycache__

15│ └── __init__.cpython-36.pyc

16└── scrapy.cfg

编写item

根据需求编写item如下,spider最后return item,把值传递给它

1import scrapy

2

3class AirHistoryItem(scrapy.Item):

4 # define the fields for your item here like:

5 data = scrapy.Field() #日期

6 city = scrapy.Field() #城市

7 aqi = scrapy.Field() #空气质量指数

8 level = scrapy.Field() #空气质量等级

9 pm2_5 = scrapy.Field() #pm2.5

10 pm10 = scrapy.Field() #pm10

11 so2 = scrapy.Field() #so2

12 co = scrapy.Field() #co

13 no2 = scrapy.Field() #no2

14 o3 = scrapy.Field() #o3

编写爬虫

首先可以得知首页是https://www.aqistudy.cn/historydata/

所以将它赋值给一个名为base_url的变量,方便后续使用

自动创建的爬出中携带了爬虫的名字,这个name在启动爬虫的时候需要用到,现在暂时用不到

1name = 'area_spider'

2allowed_domains = ['aqistudy.cn'] # 爬取的域名,不会超出这个顶级域名

3base_url = "https://www.aqistudy.cn/historydata/"

4start_urls = [base_url]

城市信息

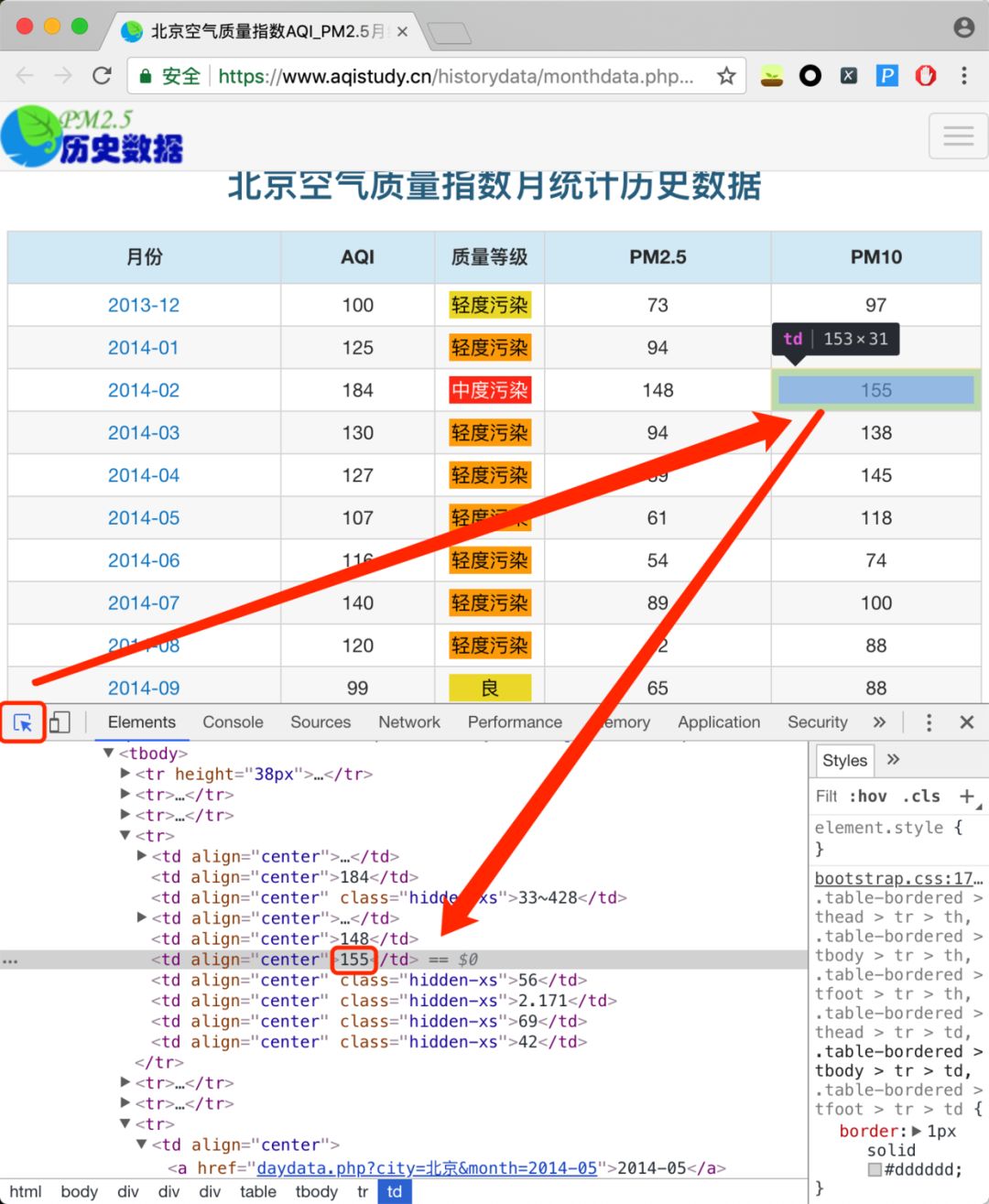

进入首页之后可以看到一大批的城市信息,所以我们第一步就是获取有哪些城市

1def parse(self, response):

2 print('爬取城市信息....')

3 url_list = response.xpath("//div[@class='all']/div[@class='bottom']/ul/div[2]/li/a/@href").extract() # 全部链接

4 city_list = response.xpath("//div[@class='all']/div[@class='bottom']/ul/div[2]/li/a/text()").extract() # 城市名称

5 for url, city in zip(url_list, city_list):

6 yield scrapy.Request(url=url, callback=self.parse_month, meta={'city': city})

使用插件XPath Helper可以对xpath进行一个测试,看看定位的内容是否正确

随意点击一个地区可以发现url变为https://www.aqistudy.cn/historydata/monthdata.php?city=北京

所以url_list获取到的是需要进行拼接的内容monthdata.php?city=城市名称

city_list的最后部分是text()所以它拿到的是具体的文本信息

将获取到的url_list和city_list逐个传递给scrapy.Request其中url是需要继续爬取的页面地址,city是item中需要的内容,所以将item暂时存放在meta中传递给下个回调函数self.parse_month

月份信息

1def parse_month(self, response):

2 print('爬取{}月份...'.format(response.meta['city']))

3 url_list = response.xpath('//tbody/tr/td/a/@href').extract()

4 for url in url_list:

5 url = self.base_url + url

6 yield scrapy.Request(url=url, callback=self.parse_day, meta={'city': response.meta['city']})

此步操作获取了每个城市的全部月份信息,并拿到了每个月份的url地址。把上面传递下来的city继续向下传递

最终数据

获取到最终的URL之后,把item实例化,然后完善item字典并返回item

1def parse_day(self, response):

2 print('爬取最终数据...')

3 item = AirHistoryItem()

4 node_list = response.xpath('//tr')

5 node_list.pop(0) # 去除第一行标题栏

6 for node in node_list:

7 item['data'] = node.xpath('./td[1]/text()').extract_first()

8 item['city'] = response.meta['city']

9 item['aqi'] = node.xpath('./td[2]/text()').extract_first()

10 item['level'] = node.xpath('./td[3]/text()').extract_first()

11 item['pm2_5'] = node.xpath('./td[4]/text()').extract_first()

12 item['pm10'] = node.xpath('./td[5]/text()').extract_first()

13 item['so2'] = node.xpath('./td[6]/text()').extract_first()

14 item['co'] = node.xpath('./td[7]/text()').extract_first()

15 item['no2'] = node.xpath('./td[8]/text()').extract_first()

16 item['o3'] = node.xpath('./td[9]/text()').extract_first()

17 yield item

使用中间件实现selenium操作

打开中间件文件middlewares.py

由于我是在服务器上进行爬取,所以我选择使用谷歌的无界面浏览器chrome-headless

1from selenium import webdriver

2from selenium.webdriver.chrome.options import Options

3

4chrome_options = Options()

5chrome_options.add_argument('--headless') # 使用无头谷歌浏览器模式

6chrome_options.add_argument('--disable-gpu')

7chrome_options.add_argument('--no-sandbox')

8# 指定谷歌浏览器路径

9webdriver.Chrome(chrome_options=chrome_options,executable_path='/root/zx/spider/driver/chromedriver')

然后进行页面渲染后的源码获取

request.url是传递到中间件的url,由于首页是静态页面,所以首页不进行selenium操作

1if request.url != 'https://www.aqistudy.cn/historydata/':

2 self.driver.get(request.url)

3 time.sleep(1)

4 html = self.driver.page_source

5 self.driver.quit()

6 return scrapy.http.HtmlResponse(url=request.url, body=html.encode('utf-8'), encoding='utf-8',request=request)

后续的操作也很简单,最后将获取到的内容正确编码后返回给爬虫的下一步

middlewares全部代码

1from scrapy import signals

2import scrapy

3from selenium import webdriver

4from selenium.webdriver.chrome.options import Options

5import time

6

7

8class AreaSpiderMiddleware(object):

9 def process_request(self, request, spider):

10 chrome_options = Options()

11 chrome_options.add_argument('--headless') # 使用无头谷歌浏览器模式

12 chrome_options.add_argument('--disable-gpu')

13 chrome_options.add_argument('--no-sandbox')

14 # 指定谷歌浏览器路径

15 self.driver = webdriver.Chrome(chrome_options=chrome_options,executable_path='/root/zx/spider/driver/chromedriver')

16 if request.url != 'https://www.aqistudy.cn/historydata/':

17 self.driver.get(request.url)

18 time.sleep(1)

19 html = self.driver.page_source

20 self.driver.quit()

21 return scrapy.http.HtmlResponse(url=request.url, body=html.encode('utf-8'), encoding='utf-8',

22 request=request)

使用下载器保存item内容

修改pipelines.py进行文件的存储

1import json

2

3class AirHistoryPipeline(object):

4 def open_spider(self, spider):

5 self.file = open('area.json', 'w')

6

7 def process_item(self, item, spider):

8 context = json.dumps(dict(item),ensure_ascii=False) + '\n'

9 self.file.write(context)

10 return item

11

12 def close_spider(self,spider):

13 self.file.close()

修改settings文件使中间件,下载器生效

打开settings.py文件

修改以下内容:DOWNLOADER_MIDDLEWARES使刚才写的middlewares中间件中的类,ITEM_PIPELINES是pipelines中的类

1BOT_NAME = 'air_history'

2SPIDER_MODULES = ['air_history.spiders']

3NEWSPIDER_MODULE = 'air_history.spiders'

4

5USER_AGENT = 'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_13_6) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/65.0.3325.181 Safari/537.36'

6

7DOWNLOADER_MIDDLEWARES = {

8 'air_history.middlewares.AreaSpiderMiddleware': 543,

9}

10

11ITEM_PIPELINES = {

12 'air_history.pipelines.AirHistoryPipeline': 300,

13}

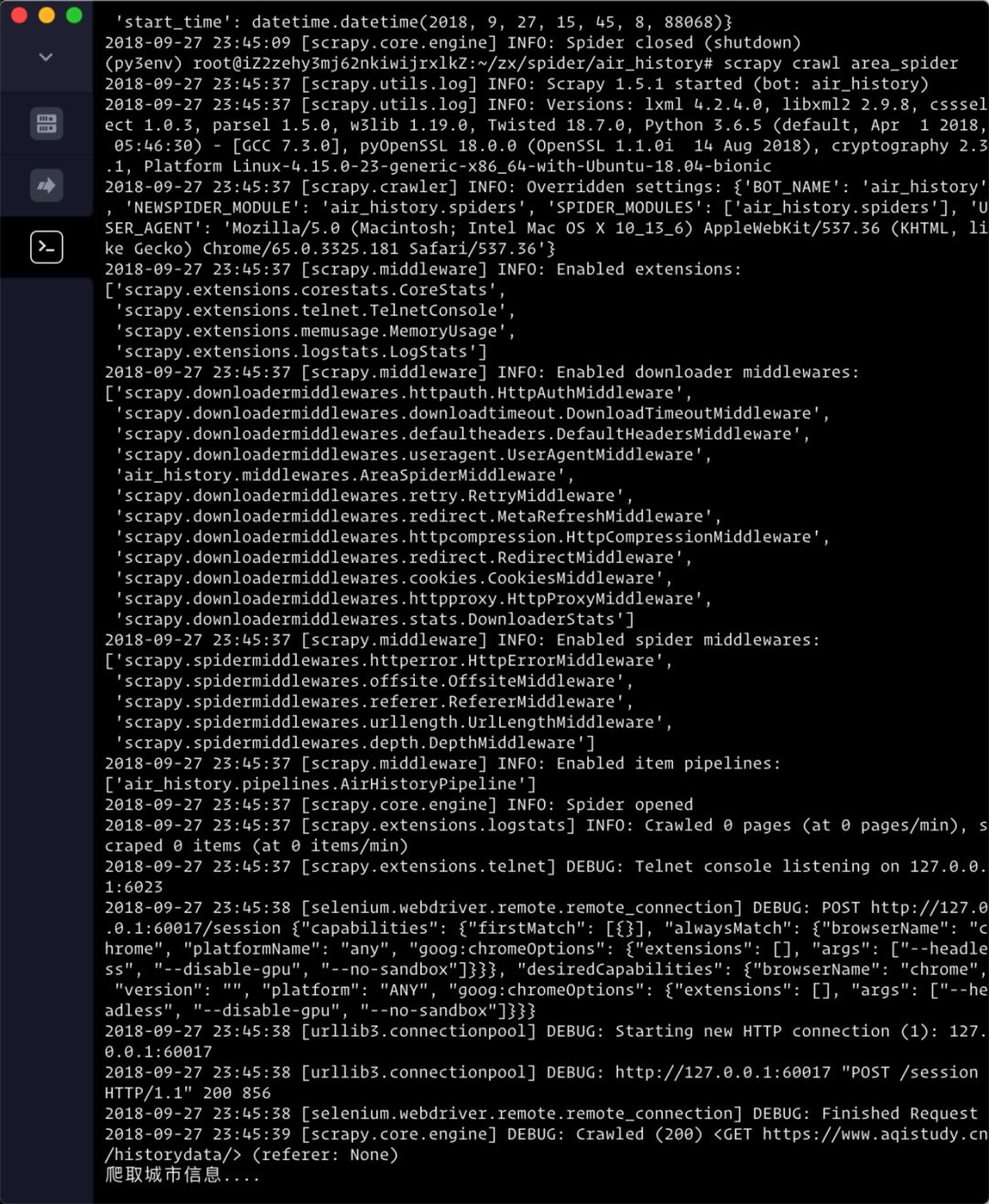

运行

使用scrapy crawl area_spider就可以运行爬虫

spider全部代码

1# -*- coding: utf-8 -*-

2import scrapy

3from air_history.items import AirHistoryItem

4

5

6class AreaSpiderSpider(scrapy.Spider):

7 name = 'area_spider'

8 allowed_domains = ['aqistudy.cn'] # 爬取的域名,不会超出这个顶级域名

9 base_url = "https://www.aqistudy.cn/historydata/"

10 start_urls = [base_url]

11

12 def parse(self, response):

13 print('爬取城市信息....')

14 url_list = response.xpath("//div[@class='all']/div[@class='bottom']/ul/div[2]/li/a/@href").extract() # 全部链接

15 city_list = response.xpath("//div[@class='all']/div[@class='bottom']/ul/div[2]/li/a/text()").extract() # 城市名称

16 for url, city in zip(url_list, city_list):

17 url = self.base_url + url

18 yield scrapy.Request(url=url, callback=self.parse_month, meta={'city': city})

19

20 def parse_month(self, response):

21 print('爬取{}月份...'.format(response.meta['city']))

22 url_list = response.xpath('//tbody/tr/td/a/@href').extract()

23 for url in url_list:

24 url = self.base_url + url

25 yield scrapy.Request(url=url, callback=self.parse_day, meta={'city': response.meta['city']})

26

27 def parse_day(self, response):

28 print('爬取最终数据...')

29 item = AirHistoryItem()

30 node_list = response.xpath('//tr')

31 node_list.pop(0) # 去除第一行标题栏

32 for node in node_list:

33 item['data'] = node.xpath('./td[1]/text()').extract_first()

34 item['city'] = response.meta['city']

35 item['aqi'] = node.xpath('./td[2]/text()').extract_first()

36 item['level'] = node.xpath('./td[3]/text()').extract_first()

37 item['pm2_5'] = node.xpath('./td[4]/text()').extract_first()

38 item['pm10'] = node.xpath('./td[5]/text()').extract_first()

39 item['so2'] = node.xpath('./td[6]/text()').extract_first()

40 item['co'] = node.xpath('./td[7]/text()').extract_first()

41 item['no2'] = node.xpath('./td[8]/text()').extract_first()

42 item['o3'] = node.xpath('./td[9]/text()').extract_first()

43 yield item

本文介绍如何结合Scrapy框架与Selenium浏览器自动化工具,爬取动态网页数据,具体展示了从项目创建、爬虫编写到数据持久化的全过程,特别针对空气质量历史数据的抓取进行了详细说明。

本文介绍如何结合Scrapy框架与Selenium浏览器自动化工具,爬取动态网页数据,具体展示了从项目创建、爬虫编写到数据持久化的全过程,特别针对空气质量历史数据的抓取进行了详细说明。

7261

7261

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?