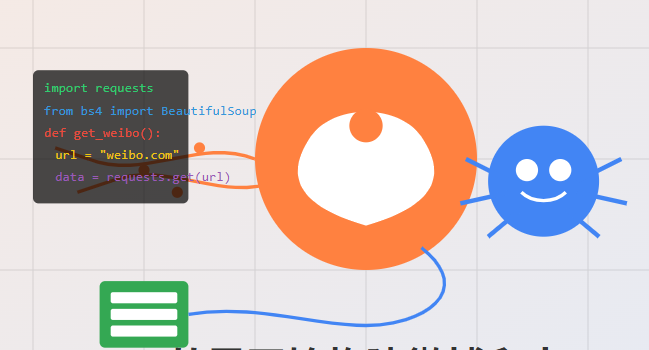

从零开始构建微博爬虫:实现自动获取并保存微博内容

前言

在信息爆炸的时代,社交媒体平台已经成为信息传播的重要渠道,其中微博作为中国最大的社交媒体平台之一,包含了大量有价值的信息和数据。对于研究人员、数据分析师或者只是想备份自己微博内容的用户来说,一个高效可靠的微博爬虫工具显得尤为重要。本文将详细介绍如何从零开始构建一个功能完善的微博爬虫,支持获取用户信息、爬取微博内容并下载图片。

项目概述

我们开发的微博爬虫具有以下特点:

- 功能全面:支持爬取用户基本信息、微博内容和图片

- 性能优化:实现了请求延迟、自动重试机制,避免被封IP

- 易于使用:提供简洁的命令行接口,支持多种参数配置

- 数据存储:支持CSV和JSON两种格式保存数据

- 容错机制:完善的错误处理,增强爬虫稳定性

- 自定义配置:通过配置文件灵活调整爬虫行为

技术选型

在构建微博爬虫时,我们使用了以下核心技术:

- Python:选择Python作为开发语言,其丰富的库和简洁的语法使爬虫开发变得简单高效

- Requests:处理HTTP请求,获取网页内容

- Pandas:数据处理和导出CSV格式

- tqdm:提供进度条功能,改善用户体验

- lxml:虽然本项目主要使用API接口,但保留XML解析能力以备扩展

- 正则表达式:用于清理HTML标签,提取纯文本内容

系统设计

架构设计

微博爬虫采用模块化设计,主要包含以下组件:

- 配置模块:负责管理爬虫的各种参数设置

- 爬虫核心:实现爬取逻辑,包括用户信息获取、微博内容爬取等

- 数据处理:清洗和结构化爬取到的数据

- 存储模块:将数据导出为不同格式

- 命令行接口:提供友好的用户交互界面

数据流程

整个爬虫的数据流程如下:

- 用户通过命令行指定爬取参数

- 爬虫初始化并请求用户信息

- 根据用户ID获取微博内容列表

- 解析响应数据,提取微博文本、图片URL等信息

- 根据需要下载微博图片

- 将处理后的数据保存到本地文件

实现细节

微博API分析

微博移动版API是我们爬虫的数据来源。与其使用复杂的HTML解析,直接调用API获取JSON格式的数据更为高效。我们主要使用了以下API:

- 用户信息API:

https://m.weibo.cn/api/container/getIndex?type=uid&value={user_id} - 用户微博列表API:

https://m.weibo.cn/api/container/getIndex?type=uid&value={user_id}&containerid={container_id}&page={page}

这些API返回的JSON数据包含了我们需要的所有信息,大大简化了爬取过程。

关键代码实现

1. 初始化爬虫

def __init__(self, cookie=None):

"""

初始化微博爬虫

:param cookie: 用户cookie字符串

"""

self.headers = DEFAULT_HEADERS.copy()

if cookie:

self.headers['Cookie'] = cookie

self.session

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

677

677

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?