在这个大AI盛行的时代,似乎每个人提起AI都能侃上几句,但是说到具体细节,又无从说起,所以今天我们采用图文并茂的方式带领大家理解所谓的深度学习

机器学习:

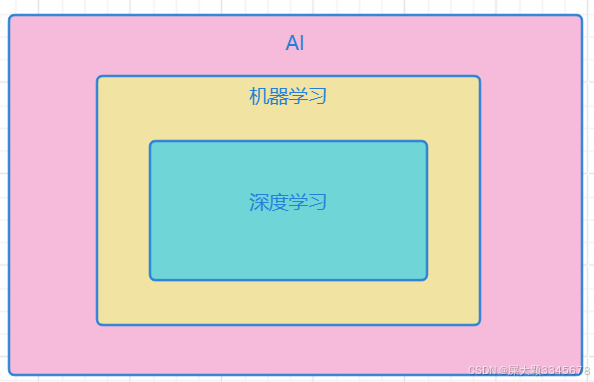

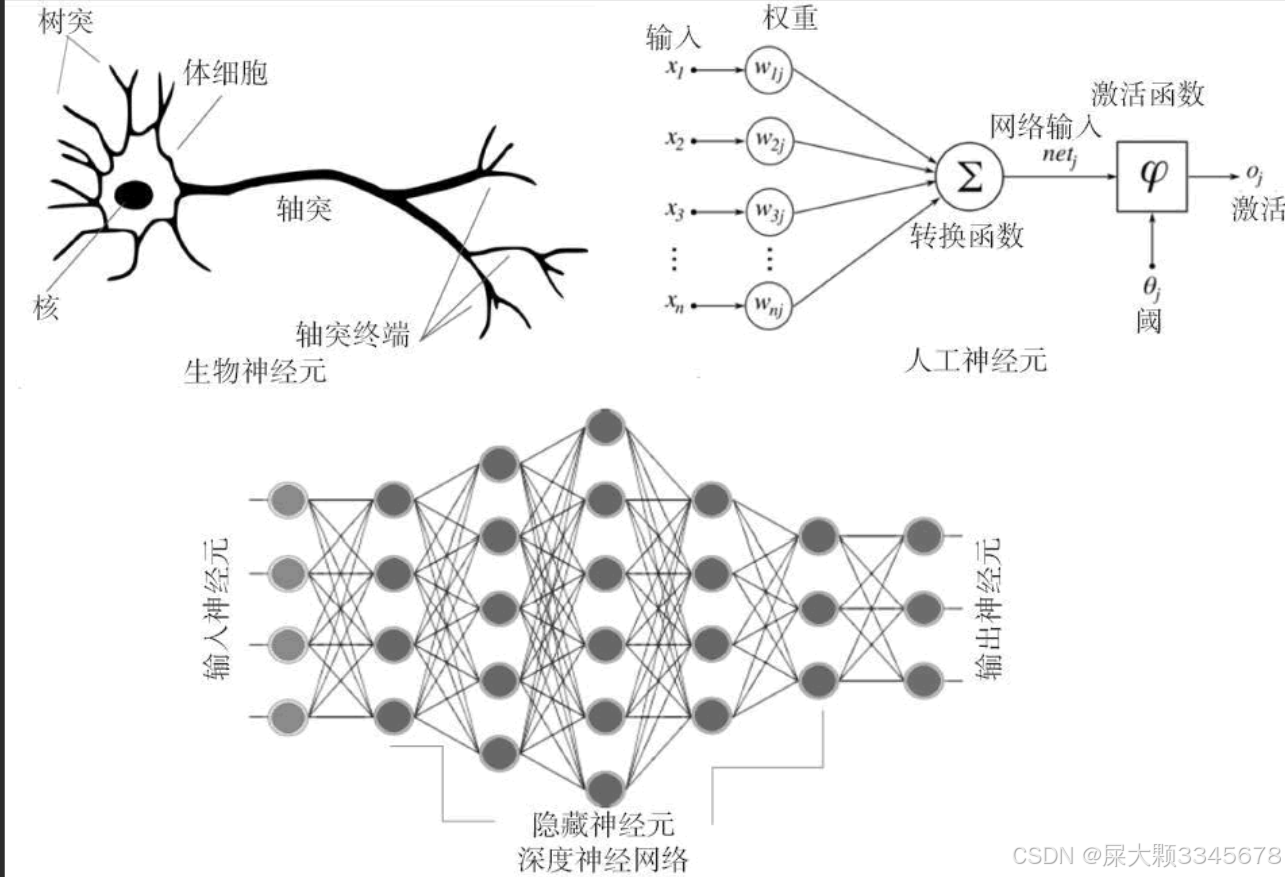

首先我们来看一张图

如图所示,AI>机器学习>深度学习

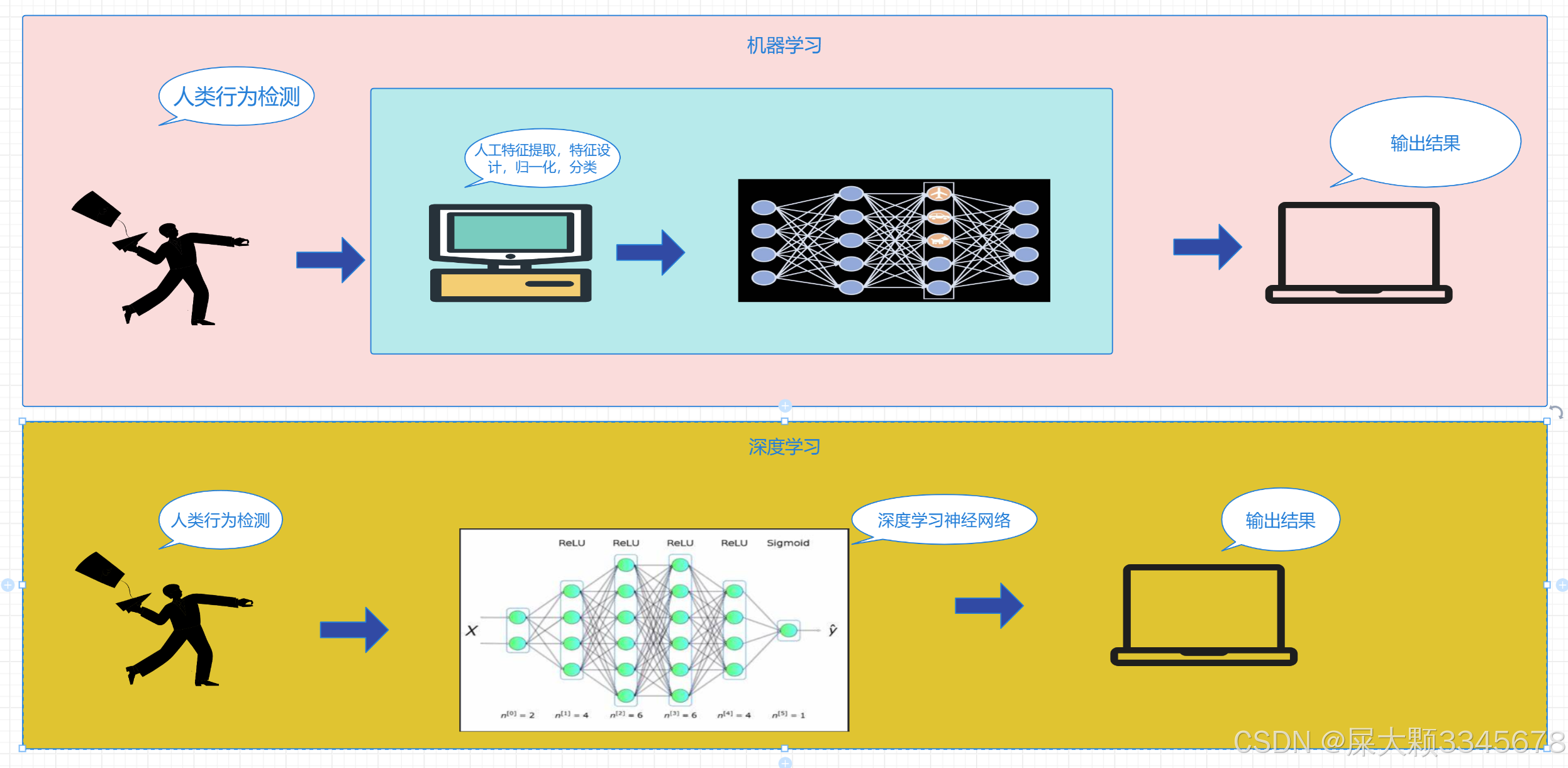

机器学习适用于结构化数据处理,需要人为的特征提取,简单点理解就是,特征明显,易于提取,且需要专业知识

反观深度学习特别擅长处理非结构化数据,如图像分类、自然语言处理,语音识别等

如果以上结论如果大家不能理解,那么就需要记住一个例子就行,如下:

机器学习(解决人与猪的区别)

深度学习(解决人与人的区别)

这样子是不是就有了具象的认识了

深度学习(人工神经网络 Artificial Neural Network,简称ANN):

人工神经网络(Artificial Neural Network,简称ANN)是一种模拟生物神经系统工作机制的数学模型和计算模型,主要用于解决复杂的模式识别、分类和预测等问题。它以大脑中神经元的连接方式为灵感,通过仿生学方式设计,模仿人脑的学习和思考过程。

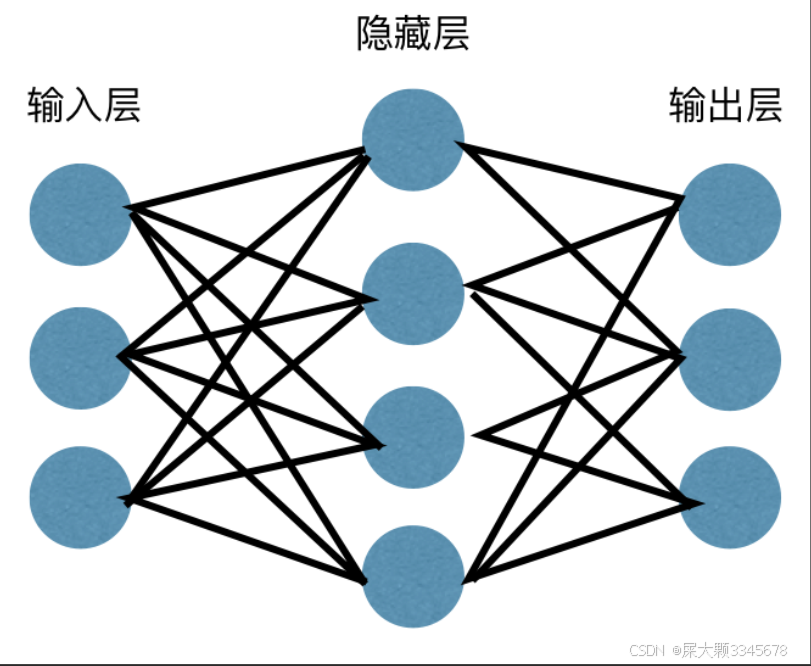

1. 结构组成

人工神经网络的基本结构包括输入层、隐藏层和输出层。这些层中的每个节点称为一个“神经元”,它们通过“权重”相互连接。

-

输入层:接受外部数据的输入(如图像、文本、信号等)。

-

隐藏层:位于输入层和输出层之间,处理输入数据,提取特征。隐藏层可以有多层,每层的神经元数量和层数由具体问题决定。

-

输出层:给出神经网络处理后的结果。

-

对于如上图所示,每一个圆圈代表一个神经元,每一层神经元都有连接,但是对于独立一层的神经元之间没有连接,从输入层---->隐藏层---->输出层,上一层的多个神经元都指向下一层的某一个神经元,万法归一,这就是我们经常讲到的算法(逻辑回归算法,这里要特别注意一下,逻辑回归算法不是线性回归,经常会有同学混淆,首先逻辑回归是解决分类问题,线性回归是解决数值预测问题), 在人工神经网络中,每个神经元通常接收来自上层神经元的多个输入,并产生一个输出,这个输出又作为下层神经元的输入,权重(weights) 是连接两个神经元之间的参数,它决定了输入信号在传递过程中对输出的影响程度,权重是神经网络中的重要参数,它连接了两个神经元并控制信号在传递过程中是被加强还是削弱,每个输入信号都会乘以其对应的权重,这相当于调节该输入在计算总输入信号时的重要性。权重越大,输入信号对最终输出的影响就越大;权重越小,输入信号对输出的影响就越小。权重可以为正,也可以为负。正权重意味着输入信号对输出有正向影响,而负权重意味着输入信号会反向影响输出,神经网络的训练过程就是不断调整这些权重 w,以使得网络的输出越来越接近预期的结果

| 特征 | 逻辑回归 | 线性回归 |

| 损失函数 | 对数似然损失 | 最小二乘法 |

| 公式 | logL(θ)=i=1∑n[yilog(yi^)+(1−yi)log(1−yi^)] | y=β0+β1x1+β2x2+⋯+βnxn+ε |

| 使用场景 | 线性变量预测 | 分类问题 |

| 模型 | 线性关系 | 概率预测 |

权重(考虑了一下还是说说):

每个神经元 i 从上一层神经元接收多个输入信号 x1,x2,…,xn ,每个输入信号都有一个相应的权重 w1,w2,…,wn。神经元的输出计算步骤如下:

-

加权求和:神经元对所有输入信号乘以其对应的权重并进行求和:

z=w1x1+w2x2+⋯+wnxn+b中 b 是一个偏置项(bias),用于调节神经元的输出。保证结果不为0

-

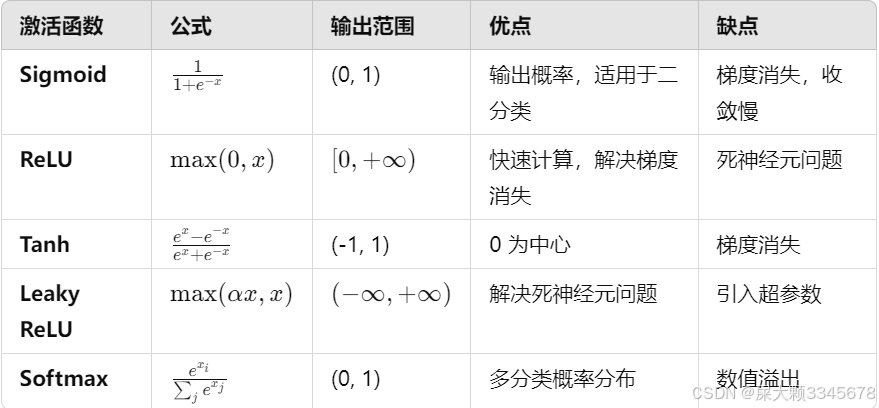

激活函数:将这个加权求和的结果 z 传递给一个激活函数 σ(z),得到该神经元的输出:

y=σ(z)常用的激活函数有 Sigmoid、ReLU、Tanh 等。

-

输出信号:最后,神经元将激活函数的输出 y传递给下一层神经元,继续计算。

选择合适的激活函数对于神经网络的性能至关重要,不同激活函数适合不同的应用场景

其实很容易理解,举个例子,如下图,人的神经元结构

为什么要叫做神经网络,树突(输入层,也可以叫做感知层吗,用来感知获取信息)---->轴突(隐藏层,传递信息)--->轴突末端(输出层,承担传递信息与输出信息,也会作为下一层神经元的输入层)

如何能具象化的理解,发挥一下想象力,一个简单的例子,中午去不去吃饭,能够影响你做决定的输入信号(比如,饿不饿,饭店远不远,有没有钱,要不要减肥),权重(饿到什么程度,距离多远能接受,钱包的余额,减肥的决心),这些都会是你做决定的概率输出,到了这里我们就不难理解,为什么深度学习要进行大量的数据训练了,把你以往做过的决定进行输入,根据你的决定来不断优化你的权重,这样子在我们建立的模型就可以用于推理出你今天的决定,实例可能不准确,大家将就,所以在我们的模型训练中,数据对于我们来说是相当重要的。

今天先聊到这里,后边我们会继续深入(为什么量子计算机是才是人工智能的起点?)

155

155

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?