参考学习 https://blog.youkuaiyun.com/gangchengzhong/article/details/76474129 和 https://my.oschina.net/u/2499632/blog/702814

及 https://blog.youkuaiyun.com/lsshlsw/article/details/49155087

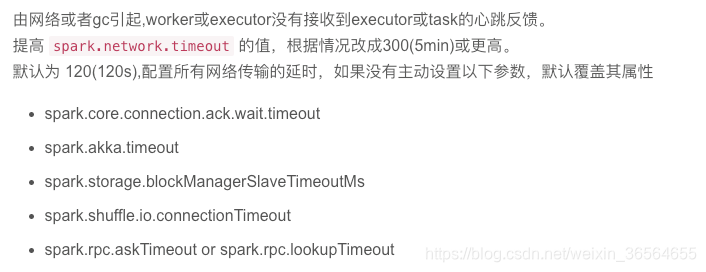

若出现各种timeout,executor lost ,task lost

spark.network.timeout 根据情况改成300(5min)或更高。,默认为 120(120s),配置所有网络传输的延时,如果没有主动设置以下参数,默认覆盖其属性

根据sparkUI中的日志显示出现shuffle FetchFailedException是因为出现了xxx.time.out,那么需要增大spark.network.timeout,从而允许有更多时间去等待心跳响应

本文介绍了如何解决 Spark 运行过程中出现的各种 timeout 问题,包括 executorlost 和 tasklost 错误。通过调整 spark.network.timeout 参数可以有效延长网络传输的等待时间,避免因超时导致的任务失败。

本文介绍了如何解决 Spark 运行过程中出现的各种 timeout 问题,包括 executorlost 和 tasklost 错误。通过调整 spark.network.timeout 参数可以有效延长网络传输的等待时间,避免因超时导致的任务失败。

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?