简介:文章讨论了如何使用开源OCR工具Tesseract来识别手机充值卡密码。介绍了Tesseract的基本工作原理、在Android平台上的集成步骤,包括安装库、数据准备、图像预处理、执行OCR、后处理以及错误率和性能优化。文章指出了一些实现中可能遇到的问题和相应的解决策略,如使用适合中文的字库和应用机器学习技术进行错误校正,以提高识别的准确性和性能。

1. Tesseract OCR工具介绍

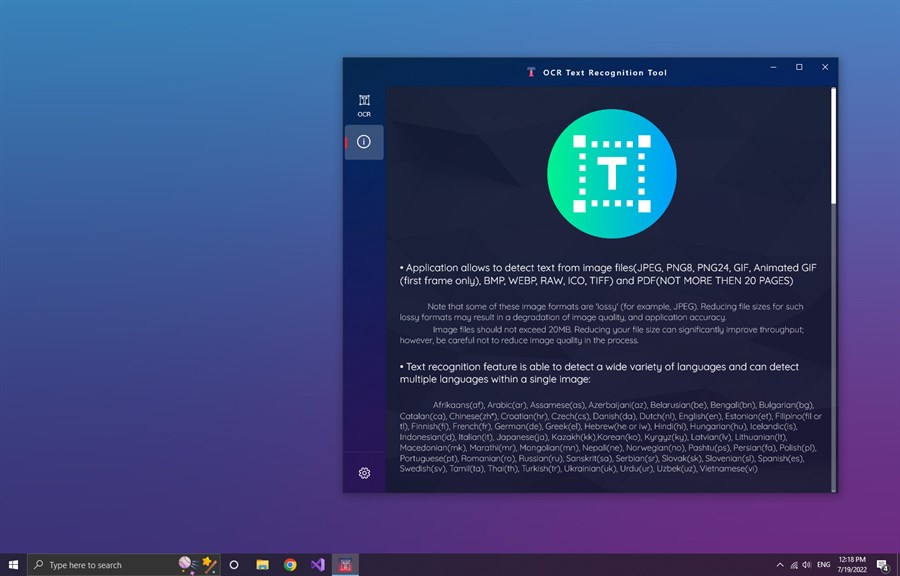

Tesseract是一个开源的光学字符识别(OCR)引擎,最初由HP开发,目前由Google赞助和维护。自从其开源以来,Tesseract成为了最流行的OCR引擎之一,特别受到研究界和开发者的青睐。它支持多种操作系统,包括Windows、Linux和macOS,并且可以识别超过100种语言的文本。

1.1 Tesseract的基本功能

Tesseract引擎可以处理各种类型的输入图像,包括扫描文档图像、照片以及屏幕截图。它还支持多种图像格式,如JPEG、PNG、BMP和TIFF。Tesseract的基本工作流程涉及图像预处理,通过算法对图像进行文字定位,然后通过字符分类器识别文字。

1.2 Tesseract的优势与局限

Tesseract的优势在于它能够识别多种语言,支持大量平台,并且可以通过训练改善特定字体或布局的识别效果。然而,Tesseract在处理复杂的布局和低质量图像时可能会遇到一些困难,特别是在有大量噪声或文字排列紧密的情况下。此外,它可能不如一些专有的OCR软件那样精确。

1.3 Tesseract的使用场景

由于其开源和跨平台特性,Tesseract被广泛应用于各种场景,包括但不限于:

- 数字化图书馆的文档扫描

- 自动化表单识别

- 街道名称或车牌的识别

- 机器学习和数据挖掘项目中的文本数据提取

小结

本章介绍了Tesseract OCR工具的基本信息,包括其功能、优势、局限性以及主要使用场景。通过这些内容,读者可以初步了解Tesseract,为其在后续章节中的更深入使用打下基础。

2. 图像识别技术在移动应用中的应用

2.1 图像识别技术概述

2.1.1 图像识别技术的历史发展

图像识别技术是一种让机器通过分析图片或视频内容来理解其含义的技术。它起源于20世纪50年代,当时研究者们试图教会计算机如何“看”。早期的研究集中在如何让计算机分辨简单的几何形状,而这些几何形状是数字图像的基本元素。

进入80年代,随着计算机视觉和机器学习领域的兴起,图像识别技术开始得到更快的发展。特别是随着数字图像获取技术的进步和图像处理算法的创新,图像识别技术开始向更复杂的场景和对象识别发展。

现代的图像识别技术,特别是基于深度学习的方法,在过去十年里取得了革命性的进步。这些技术通过构建复杂的神经网络,可以实现对图片内容的高精度识别和理解。

2.1.2 图像识别技术的现状与趋势

目前,图像识别技术已经成为人工智能领域研究和应用的热点。深度学习,尤其是卷积神经网络(CNN)的出现,使图像识别在精确度和应用范围上都得到了极大的扩展。

当前图像识别技术的现状是多方面的。一方面,这一技术已经能够实现面部识别、车牌识别等复杂任务。另一方面,它还广泛应用于医疗诊断、安全监控、自动驾驶等领域。随着技术的不断成熟和优化,图像识别在未来的应用前景是非常广阔的。

预计未来的发展趋势将包括进一步提升识别精度、缩短处理时间、降低计算成本以及拓展至更多领域应用。同时,随着边缘计算的发展,图像识别技术将在移动和嵌入式设备上得到更多应用,实现更快的实时处理。

2.2 图像识别技术在移动应用中的作用

2.2.1 提高用户体验

在移动应用中,图像识别技术可以大幅提升用户的交互体验。例如,在购物类应用中,用户可以利用图像识别技术来搜索和识别产品。这种“图片搜索”功能,只需用户上传或拍摄一张图片,系统便能提供与之相关的产品信息。

此外,图像识别技术在社交应用中也扮演着重要角色。通过识别人脸和物体,应用可以实现智能分类、标签建议等功能,极大地减少了用户手动编辑信息的麻烦。

2.2.2 移动应用中的具体应用案例

以移动支付为例,图像识别技术可以辅助用户更方便地完成支付过程。例如,一些支付应用引入了二维码和条形码识别,让用户通过扫描付款码轻松支付,省去了输入金额和账户信息的步骤。

在健康类应用中,用户可以通过手机摄像头捕捉皮肤问题并使用图像识别技术来诊断疾病风险。医生和医疗机构也可以使用这些技术进行远程诊断和患者跟踪。

在房地产领域,移动应用通过用户上传的房源图片,利用图像识别技术快速识别出房源的地理位置、装修风格等关键信息,从而为用户提供更加个性化的房源推荐。

综上所述,图像识别技术已经成为移动应用中不可或缺的一部分,它通过提供丰富的交互体验和便捷的服务来提升用户的满意度和使用粘性。

3. Android平台Tesseract库的安装

3.1 环境配置

3.1.1 安装Java开发环境

在Android开发中,Java是必不可少的一部分,因此安装Java开发环境是首先要做的。Java开发环境包括JDK(Java Development Kit)和JRE(Java Runtime Environment)。推荐使用Oracle JDK,但也可以使用OpenJDK。对于Android开发,我们主要使用JDK。

安装步骤如下: 1. 访问 Oracle官网 下载适合操作系统的JDK版本。 2. 运行下载的JDK安装包并遵循安装向导完成安装。 3. 在终端中输入 java -version 和 javac -version 验证是否安装成功。

3.1.2 安装Android SDK和NDK

Android SDK(Software Development Kit)是开发Android应用程序所需的软件包集合,包括编译器、调试器和其他工具。NDK(Native Development Kit)则允许我们用C和C++编写代码,提高性能。

安装步骤如下: 1. 安装Android Studio,这是官方推荐的Android开发环境,它内置了SDK和NDK的安装管理工具。 2. 打开Android Studio,进入SDK Manager进行Android SDK的安装,确保选择“Android SDK Command-line Tools”以及需要的API级别。 3. 在Android Studio的设置中,找到NDK设置并进行下载和安装。

3.2 Tesseract库安装步骤

3.2.1 下载和配置Tesseract库

Tesseract OCR库的Android版本可以从其 GitHub页面 下载源码,然后编译成适用于Android的库文件。但也有现成的库文件如tess-two,可以在GitHub上直接获取。

配置步骤如下: 1. 克隆tess-two库: bash git clone https://github.com/rmtheis/tess-two.git 2. 根据需要修改编译脚本 build.gradle ,如指定NDK版本、API级别等。 3. 运行Gradle任务 assembleRelease 来构建库文件。

3.2.2 集成Tesseract到Android项目中

为了将Tesseract库集成到Android项目中,可以采用Gradle依赖的方式。

集成步骤如下: 1. 在项目的 build.gradle 文件中添加依赖: gradle dependencies { implementation 'com.rmtheis:tess-two:1.0' } 2. 同步项目,确保依赖正确下载。 3. 将编译好的库文件复制到 libs 目录下。 4. 在项目中添加相应的权限和配置以使用该库。

安装小结

在这一章节中,我们从零开始介绍了如何在Android平台上安装Tesseract库。首先,我们配置了Java开发环境和Android SDK与NDK,这是开发Android应用的基本环境。接着,我们详细介绍了如何下载和配置Tesseract库,并且通过Gradle脚本将其集成到Android项目中。整个流程需要细心操作,确保每一步的正确性,以便在后续的应用开发中顺利使用Tesseract进行图像文字的识别工作。

4. 数据准备与图像预处理步骤

在进行光学字符识别(OCR)之前,我们需要经过精心准备的数据和经过优化处理的图像。本章我们将介绍如何准备数据和执行图像预处理步骤,以确保Tesseract OCR工具能够高效且准确地识别图像中的文字。

4.1 数据准备

4.1.1 收集充值卡图片数据

在数据准备阶段,获取高质量的原始图像数据至关重要。例如,在处理充值卡识别的场景中,首先需要收集大量的充值卡图片。这些图片应该涵盖不同角度、光照条件以及不同质量的图像,以确保训练模型能够适应各种实际使用场景。

- 收集图像时,使用高分辨率的数码相机或手机,以保持图像的清晰度。

- 拍摄时应保证图片中的文字清晰可见,避免反光或阴影。

- 图像文件的格式应选择常用的格式,如JPEG或PNG,以确保广泛的兼容性。

4.1.2 图片数据的格式转换

将收集的图片统一格式转换是数据准备的一个重要环节。不同的图像格式可能对后续的处理和识别过程产生影响。转换为常见的图像格式(如JPEG或PNG),可以确保兼容性和减少不必要的图像数据损耗。

- 使用图像处理软件(如Photoshop或GIMP)或编程语言中的图像库(如Python的Pillow库)进行图像格式转换。

- 在转换过程中,尽量保留原始图片的尺寸和色彩信息,避免不必要的压缩和质量损失。

- 确保转换后的图片大小适合OCR工具处理,避免过大的图片导致内存消耗过多或处理速度过慢。

4.2 图像预处理

图像预处理是OCR识别前的重要步骤,它能改善图像质量,增强文字特征,从而提高识别率。在本节中,我们将详细介绍图像预处理的三个关键步骤:灰度化处理、二值化处理以及去噪和边缘检测。

4.2.1 图像的灰度化处理

灰度化处理是将彩色图像转换为灰度图像的过程。灰度图像在处理上更加高效,且在文字识别中,彩色信息通常不是必须的。灰度化有助于减少计算量,并减少图像中的颜色噪声。

- 通过调整RGB通道的权重可以实现彩色到灰度的转换。

- 对于不同的图像,可能需要调整RGB权重系数以获得最佳的灰度效果。

- 在编程实现中,使用专门的图像处理库可以快速完成灰度化处理,例如Python的OpenCV库中的`cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)`。

4.2.2 图像的二值化处理

二值化处理是将灰度图像转换为黑白两种颜色的过程,即将每个像素点的亮度值设为0或255,从而减少图像的复杂度。二值化有助于进一步突出文字特征,便于Tesseract等OCR工具识别。

- 二值化处理通常基于某个阈值,该阈值将灰度值分为背景和前景(文字)。

- 使用Otsu方法自动计算阈值是一种常见的做法,Python代码示例:

```python

import cv2

# 读取图片

image = cv2.imread('path_to_image')

# 转换为灰度图像

gray_image = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

# 应用Otsu二值化方法

_, binary_image = cv2.threshold(gray_image, 0, 255, cv2.THRESH_BINARY + cv2.THRESH_OTSU)

# 显示结果

cv2.imshow('Binary Image', binary_image)

cv2.waitKey(0)

cv2.destroyAllWindows()

4.2.3 图像的去噪和边缘检测

图像在采集过程中难免会引入一些噪声,去噪可以清除或减少图像中的随机噪声,提高文字的可识别性。边缘检测则用于识别图像中的文字轮廓,增强文字特征。

- 使用中值滤波器等去噪算法可以有效地去除图像中的随机噪声。

- 边缘检测可以使用Sobel、Canny等算法,代码示例:

```python

# 使用Canny算法进行边缘检测

edges = cv2.Canny(binary_image, threshold1=100, threshold2=200)

# 显示边缘检测结果

cv2.imshow('Edges', edges)

cv2.waitKey(0)

cv2.destroyAllWindows()

- 去噪和边缘检测后的图像更适合OCR工具的识别,因为它们强调了图像中的重要特征并减少了干扰信息。

接下来,我们将进入第五章,了解如何执行OCR和进行后处理操作,以进一步提高图像中文字的识别准确率。

5. 执行OCR和后处理操作

5.1 OCR执行步骤

5.1.1 调用Tesseract OCR接口

在Android应用中实现OCR,第一步是调用Tesseract OCR引擎的接口。首先需要在项目中引入Tesseract库。以下是调用Tesseract接口的基本代码示例:

import net.sourceforge.tess-two.TessBaseAPI;

public class OcrEngine {

private TessBaseAPI tessBaseAPI;

public OcrEngine() {

// 初始化Tesseract API

tessBaseAPI = new TessBaseAPI();

}

public String doOCR(File imageFile) throws IOException {

// 设置Tesseract识别的语言,支持多种语言识别

tessBaseAPI.init("/path/to/tessdata", "eng"); // 例如英语

tessBaseAPI.setImage(imageFile);

String recognizedText = tessBaseAPI.getUTF8Text();

tessBaseAPI.end();

return recognizedText;

}

}

在上述代码中,首先导入TessBaseAPI类,然后创建OcrEngine类的实例,在构造函数中初始化Tesseract库。 doOCR 函数用于执行OCR识别操作,它接受一个图像文件作为参数,并返回识别出的文本。

5.1.2 识别结果的获取与解析

识别结果的获取是通过调用 getUTF8Text() 方法实现的,该方法将返回图像中的文本内容。解析识别结果时,通常需要结合实际应用的上下文来对结果进行格式化和校验。例如,如果识别的是充值卡号码,那么需要检查结果是否符合数字格式,并且是否在有效的卡号范围内。

5.2 后处理操作

5.2.1 识别结果的校验

校验过程可以使用正则表达式来确保识别结果符合预期格式。例如,对于一个16位数字的充值卡号码,可以使用以下校验代码:

public boolean validateCardNumber(String cardNumber) {

// 正则表达式验证16位数字的充值卡号码

String regex = "^[0-9]{16}$";

return cardNumber.matches(regex);

}

5.2.2 识别结果的存储与应用

识别结果需要被存储以便后续使用。一个简单的存储方法是使用SharedPreferences,适合存储少量数据,例如识别出的卡号:

SharedPreferences sharedPreferences = getSharedPreferences("AppPrefs", MODE_PRIVATE);

SharedPreferences.Editor editor = sharedPreferences.edit();

editor.putString("card_number", cardNumber);

editor.apply();

对于更复杂的数据存储需求,可以将数据保存到SQLite数据库或云端服务器中。此外,根据实际应用场景,可能还需要将识别结果用于其他业务逻辑处理,比如验证卡内余额、记录充值历史等。

简介:文章讨论了如何使用开源OCR工具Tesseract来识别手机充值卡密码。介绍了Tesseract的基本工作原理、在Android平台上的集成步骤,包括安装库、数据准备、图像预处理、执行OCR、后处理以及错误率和性能优化。文章指出了一些实现中可能遇到的问题和相应的解决策略,如使用适合中文的字库和应用机器学习技术进行错误校正,以提高识别的准确性和性能。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?