X = tf.placeholder(tf.float32)

y = tf.placeholder(tf.float32)

W = tf.Variable(tf.zeros([feature_num, 1]))

b = tf.Variable([-.3])

db = tf.matmul(X, tf.reshape(W, [-1, 1])) + b

hyp = tf.sigmoid(db)

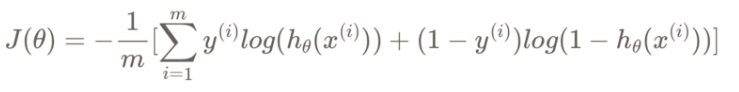

cost0 = y * tf.log(hyp)

cost1 = (1 - y) * tf.log(1 - hyp)

cost = (cost0 + cost1) / -sample_num

loss = tf.reduce_sum(cost)optimizer = tf.train.GradientDescentOptimizer(0.1)

train = optimizer.minimize(loss)

本文详细介绍了使用TensorFlow实现逻辑回归的过程,包括定义占位符、变量、计算预测值、损失函数、优化器以及训练过程。通过具体代码展示了如何利用梯度下降法最小化损失函数,实现对样本数据的拟合。

本文详细介绍了使用TensorFlow实现逻辑回归的过程,包括定义占位符、变量、计算预测值、损失函数、优化器以及训练过程。通过具体代码展示了如何利用梯度下降法最小化损失函数,实现对样本数据的拟合。

8435

8435

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?