这个论文应该算是把深度学习应用到图片识别(ILSVRC,ImageNet large-scale Visual Recognition Challenge)上的具有重大意义的一篇文章。因为在之前,人们一直质疑深度学习的强大有能力。

大家看看它的引用数目就知道它很厉害了,,9000多的引用。。

作者为:Hinton的学生与Hioton:

Krizhevsky A

Sutskever I

Hinton GE

要想训练好一个深层的神经网络,需要 :很大的 datasets, 很强大的硬件,很好的抵制overfitting的机制等。

文章用的dataset: Imagenet 数据集的一个subset, 包括:1.2M个样本,1000个种类。另外还有,50000的validation 数据集,150000的测试集。

ILSVRC是从2010年开始的,在2010年时,比赛的test dataset是公开的,以后的都不是公开的。这个挑战赛的常用的两个誤差标准:一个是top-1 error,一个是top-5 error,(这个在之前写的文章里都有提及到了)

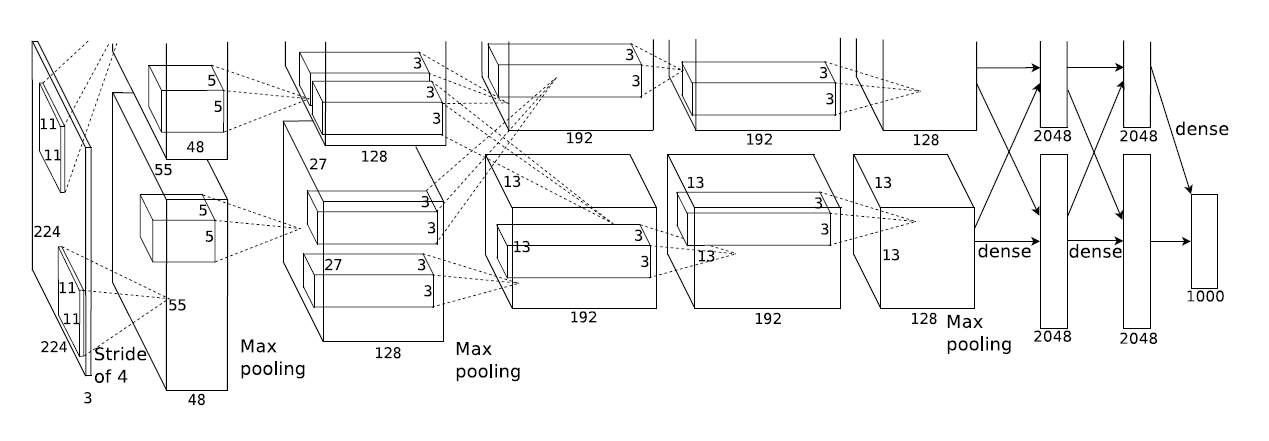

网络的结构:

整体是这样的,

224*224*3的输入, 后面5个卷积层,再后面三个全连接层,最后一个softmax层分类。

具体参数吧,图上写的很清楚的:你看看啊,输入层为 224*224*3, 第一层的卷积核大小为11*11*3,共96个,然后第二层的卷积层的输入为 55*55*48(是从上面96个卷积核生成的feature maps 中选择了一半),第二层的卷积核为:5*5*48,共256个,,等 。。。。后面的看看论文,里面有。。

不过要说明一点的是:对于选择不同的feature作为输入时,会根据是不是在同一个GPU进行选择,文章说明这一点了,可能目的为了用双GPU训练时,实现起来简单一些,且速度快一些吧。

结构相对几点重要的地方:

第一,使用的激活函数为:Rectified Linear Units(ReLUs). 可以很好地提高学习速度,因为这个激活函数为non-saturating function.

第二,训练在多块GPU上,不过它怎么实现的吧,看着的有点乱。。。不很明白,可能没有编程的原因,应该是这样的。

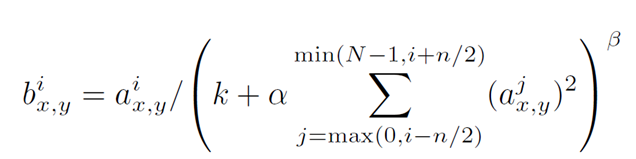

第三点,使用了 Local Response Normalization, (我的翻译为:局部响应标准化),公式是这样的:

公式怎么来的,没有说啊。不过它的目的就是在相对的局位置上,在相邻有不同的卷积核(文中也说了,这个卷积核的排序为任意且的训练之间就是选择了的哦)之间进行相互的一个侧向抑制。这么做的原因是因为:在现实中,动物的神经元之间就会有一个侧向抑制。参数的选择吧,要自己来调整。。

第四点,重叠pooling,这个不解释,就是在pooling的时候会发生重叠。

降低Overfitting的方法

第一点,也是常用的方法:人为扩大训练样本。

文中的方法1:在256*256的大样本中,选择5个224*224的patches(左上,左下,右上,右上,中间),再加上水平翻转,共10个了吧。

方法2: altering the intensities of the RGB channels in training images. 文中的方法是什么通过PCA(主成份分析)的方法啥的,反正看了一会没有看懂,也就不看了吧。

第二点: dropout机制, dropout的概率为0.5,有作用。。简单地说,就是在训练网络过程中,让一些的neunon的不起作用,这样训练出来的神经网络应该说是很均匀,不过过度依赖某些的units, 采用dropout时,注意一点:在测试的时候注意把进行dropout机制的那些神经元的输出乘以0.5.

其它细节:

batch sizes为:128,

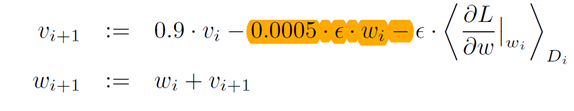

采用梯度下降法训练,权值更新公式:

等。。。

说一点:学习速率的改变方法:初始化为0.01,在训练过程中,当网络的validation error 不再下降时,把学习速率缩小10倍,如此反复进行3次就可以啦。

最后结果表明:效果很不错。

最后加一句,文中的原话:

Another way to probe the network’s visual knowledge is to consider the feature activations induced by an image at the last, 4096-dimensional hidden layer.

本文介绍了深度学习在ILSVRC图像识别挑战赛中的应用,使用包含1.2M样本的Imagenet数据集,通过五层卷积和三层全连接的神经网络结构,实现了显著的识别效果改进。文中详细讨论了网络架构、训练方法及如何减少过拟合。

本文介绍了深度学习在ILSVRC图像识别挑战赛中的应用,使用包含1.2M样本的Imagenet数据集,通过五层卷积和三层全连接的神经网络结构,实现了显著的识别效果改进。文中详细讨论了网络架构、训练方法及如何减少过拟合。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?