Teaching computers to learn to perform tasks from past experiences(recorded data)

一、Decision Tree(决策树)

——Example:for recommend app

二、Naive Bayes Algorithm(朴素贝叶斯)

——Example:for detecting Spam e-mails(垃圾邮件)

三、Gradient descent(梯度下降)

——Example:Minimize the Error

四、Linear Regression(线性回归)

——Example:Price of a house

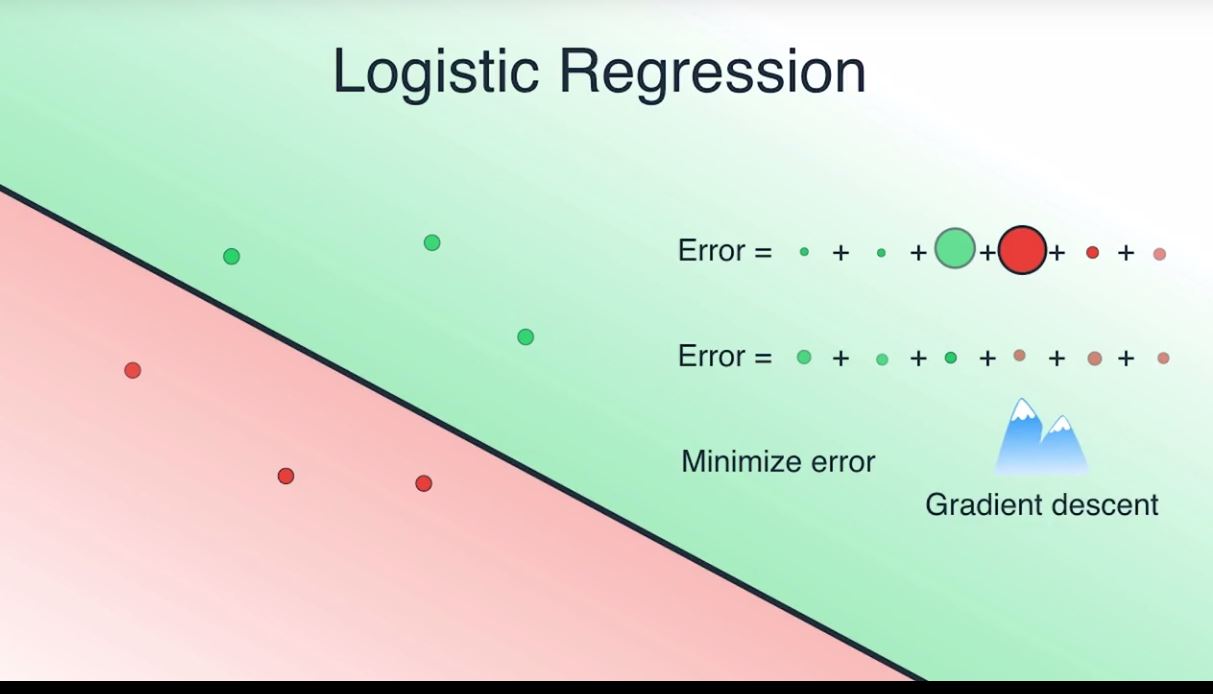

五、(对数几率回归)

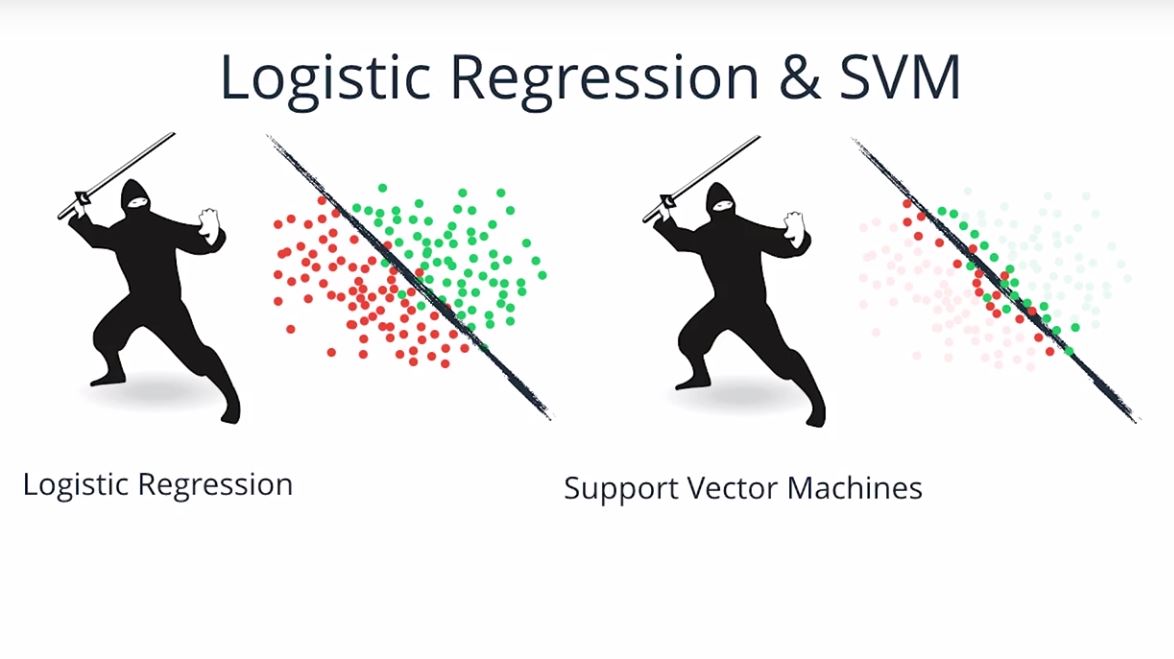

Logistic Regression(逻辑回归)

Log loss function (对数损失函数)——代表错误数目

最小化误差函数——结合梯度下降算法

爬山——每一步都走梯度下降最快的(误差减小更多)

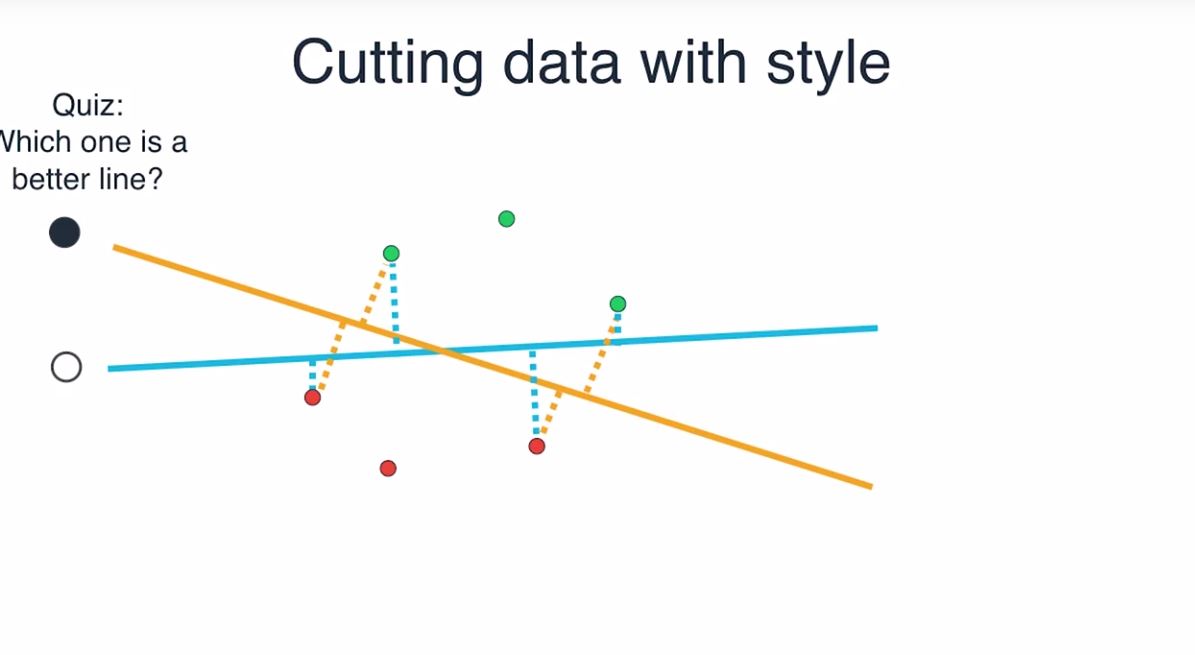

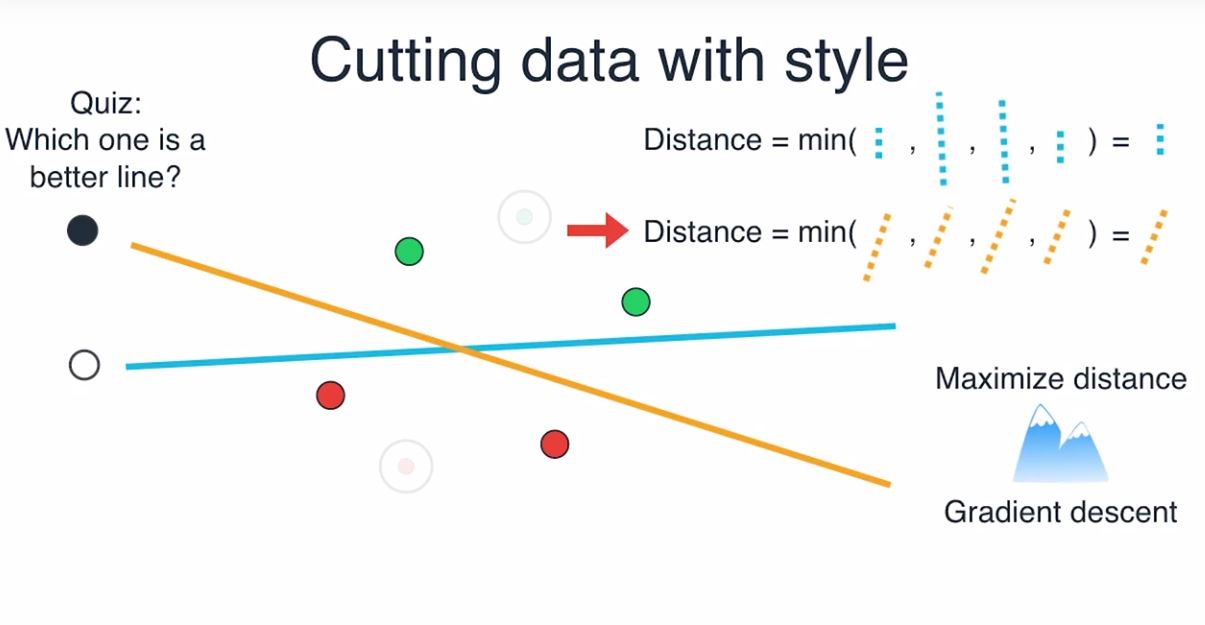

六、Support Vector Machine(支持向量机SVM)

- Cutting data with style

- Support——靠近边界的点被称为支撑(support)

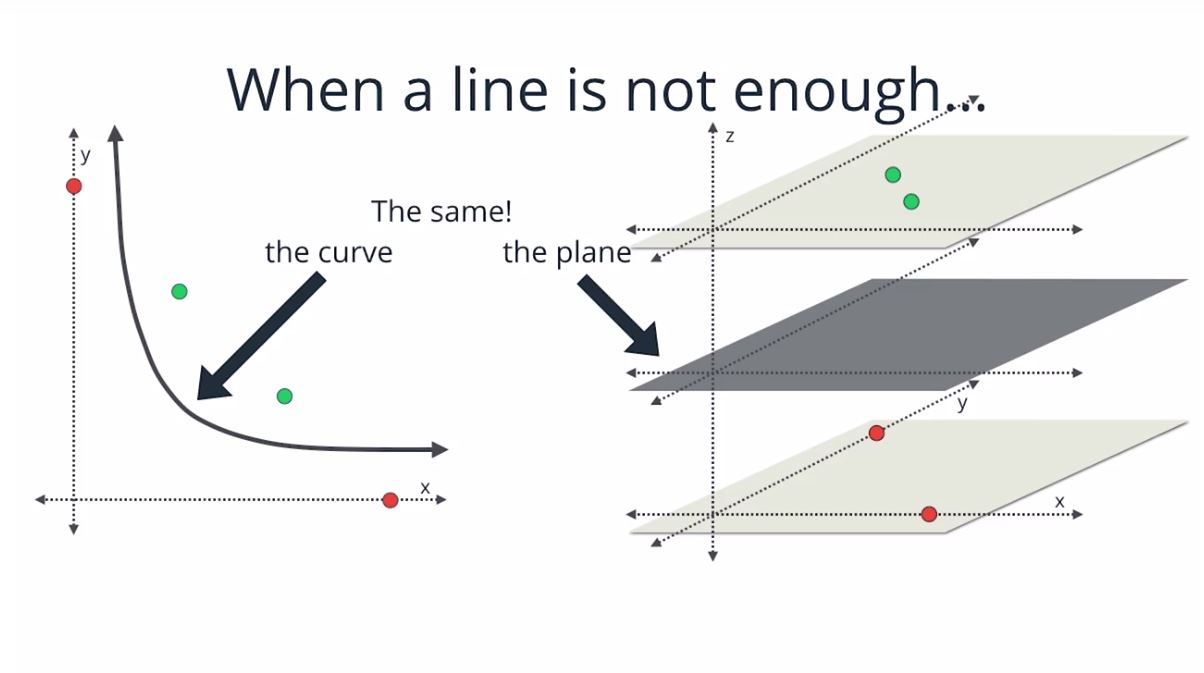

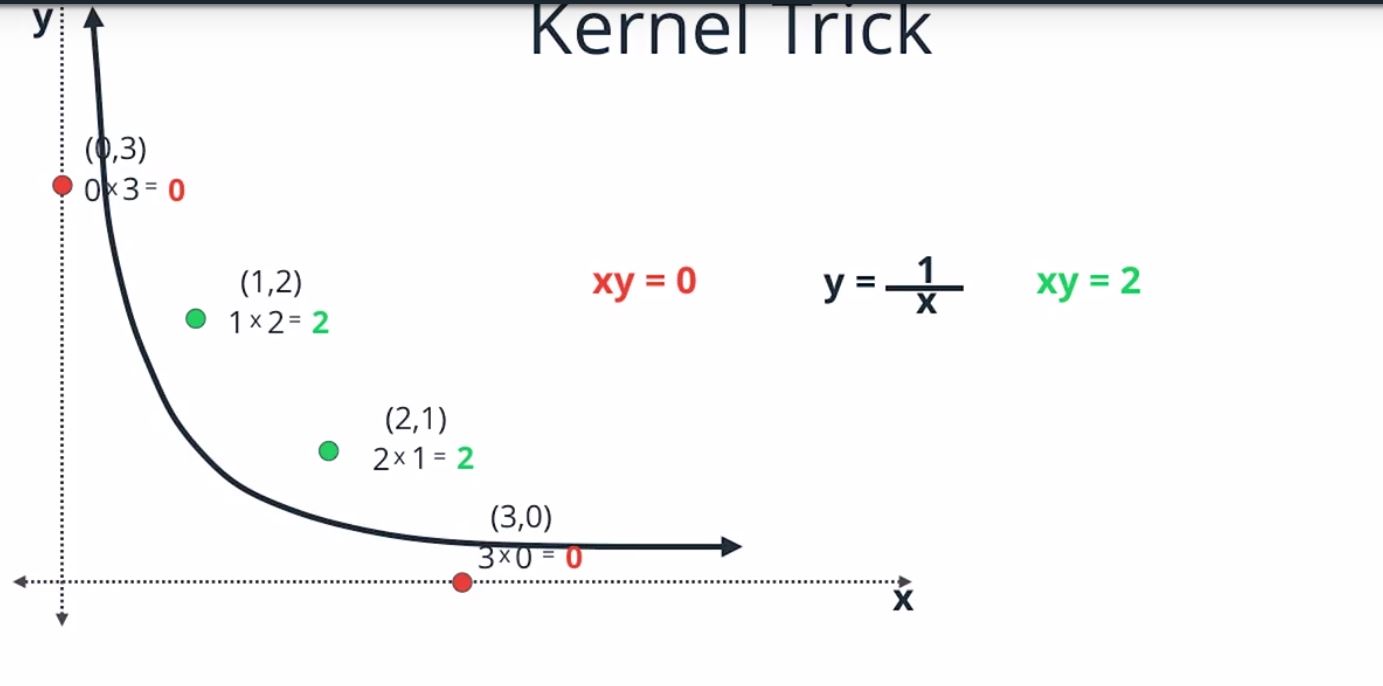

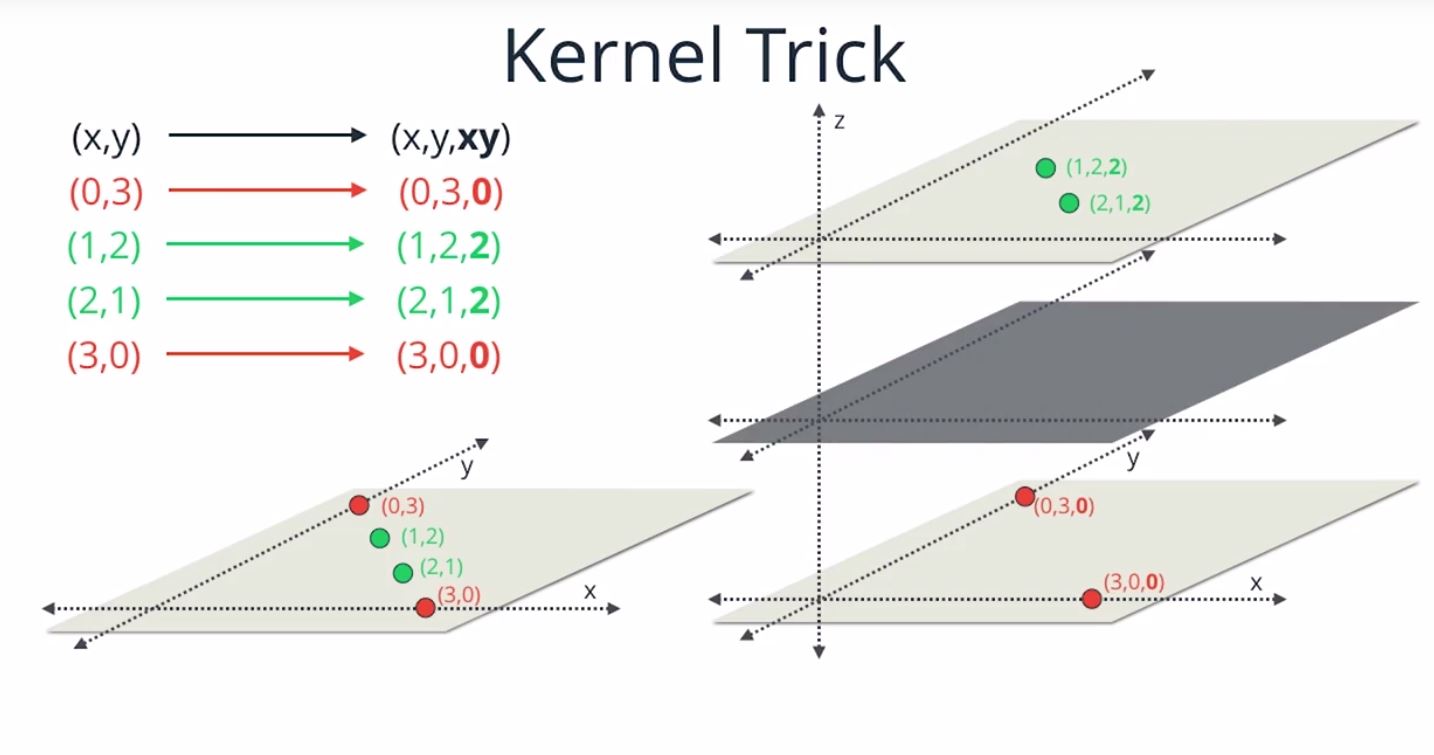

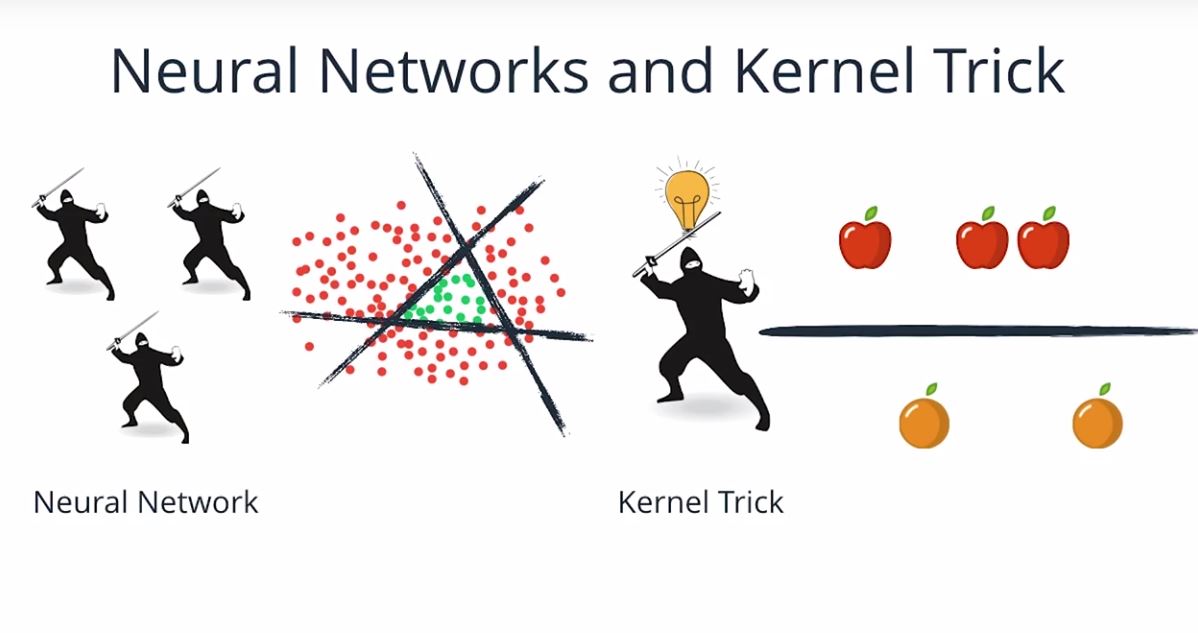

七、Kernel Trick(核函数)

- when a line is not enough

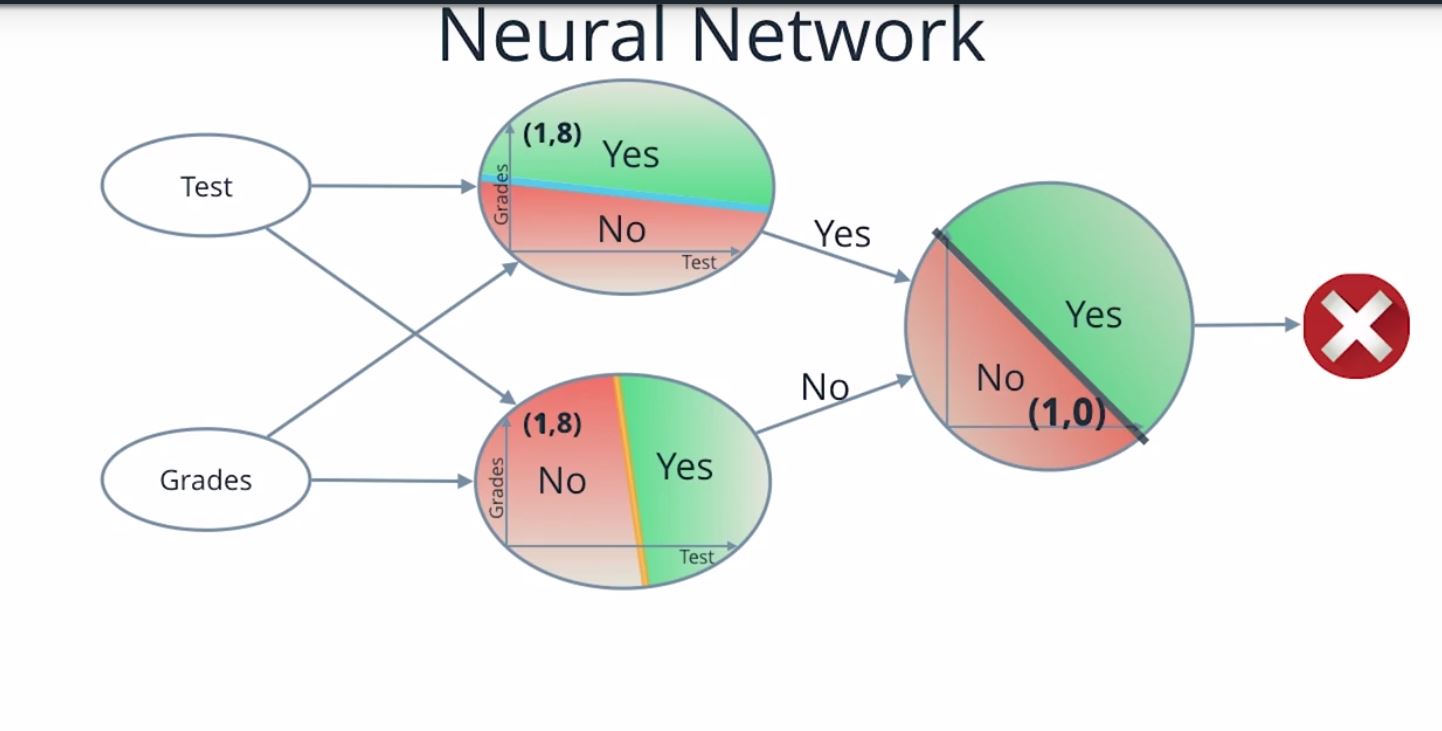

八、Neural Network(神经网络)

九、类比忍者

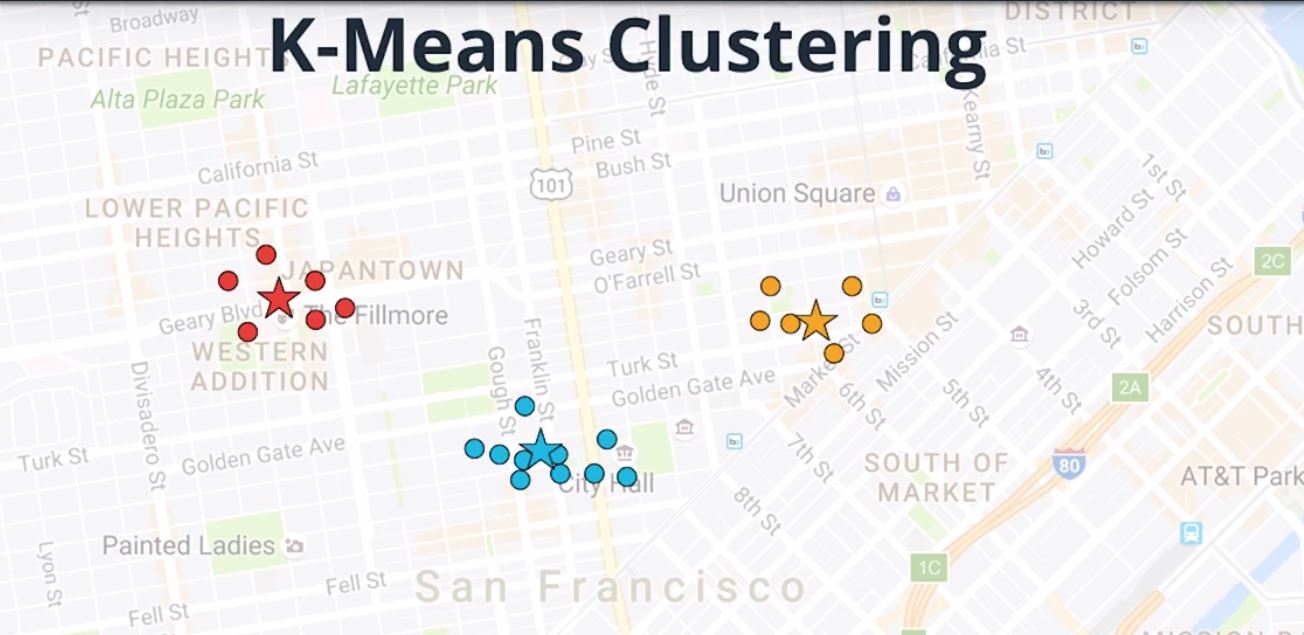

十、K均值聚类(K-Means Clustering)

- Example pizza parlors

- 需要预知最后分成几组

十一、层次聚类(Hierarchical Clustering)

- 无需预知最后聚类数目

阶段总结

1393

1393

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?