文档链接

#切换到spark安装目录,执行下面一条命令,192.168.0.10是master的ip,

examples/src/main/python/pi.py 是python 文件的路径

./bin/spark-submit --master spark://192.168.0.106:7077 examples/src/main/python/pi.py

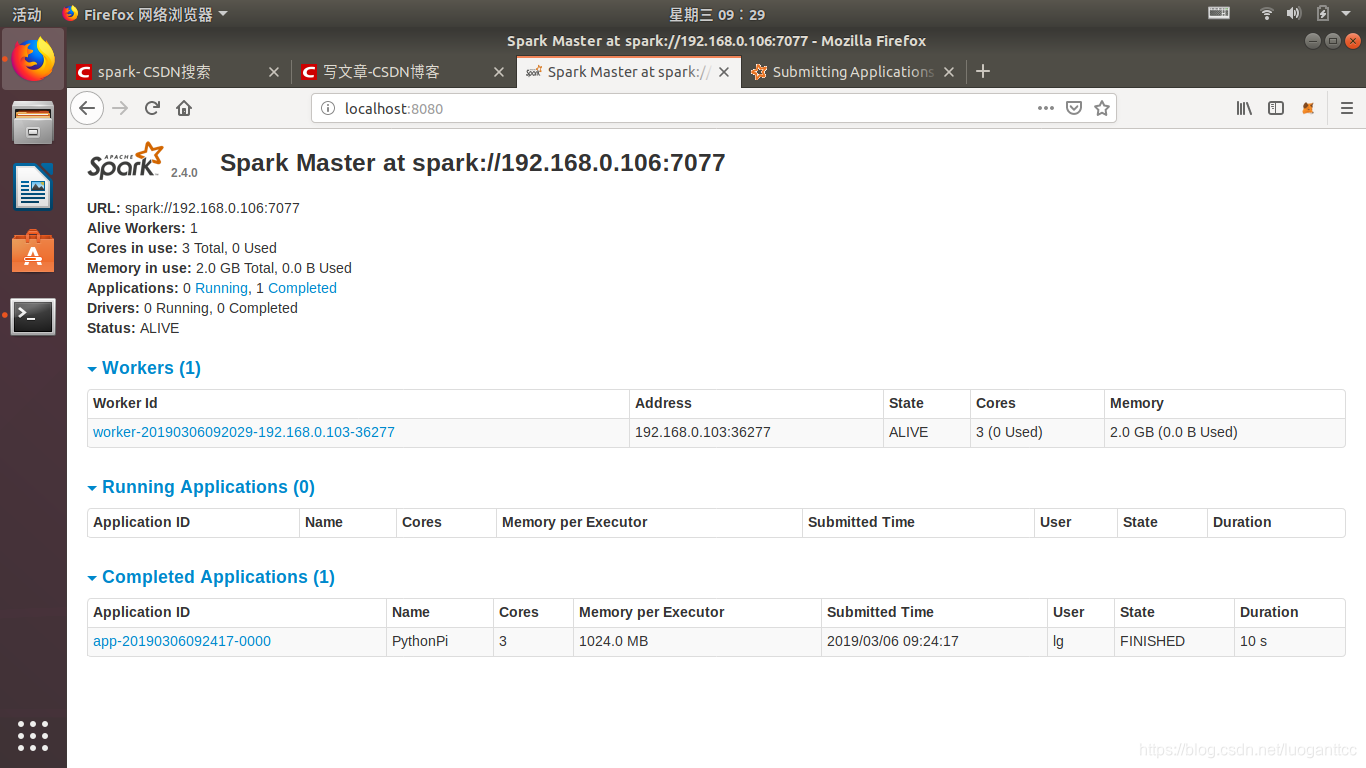

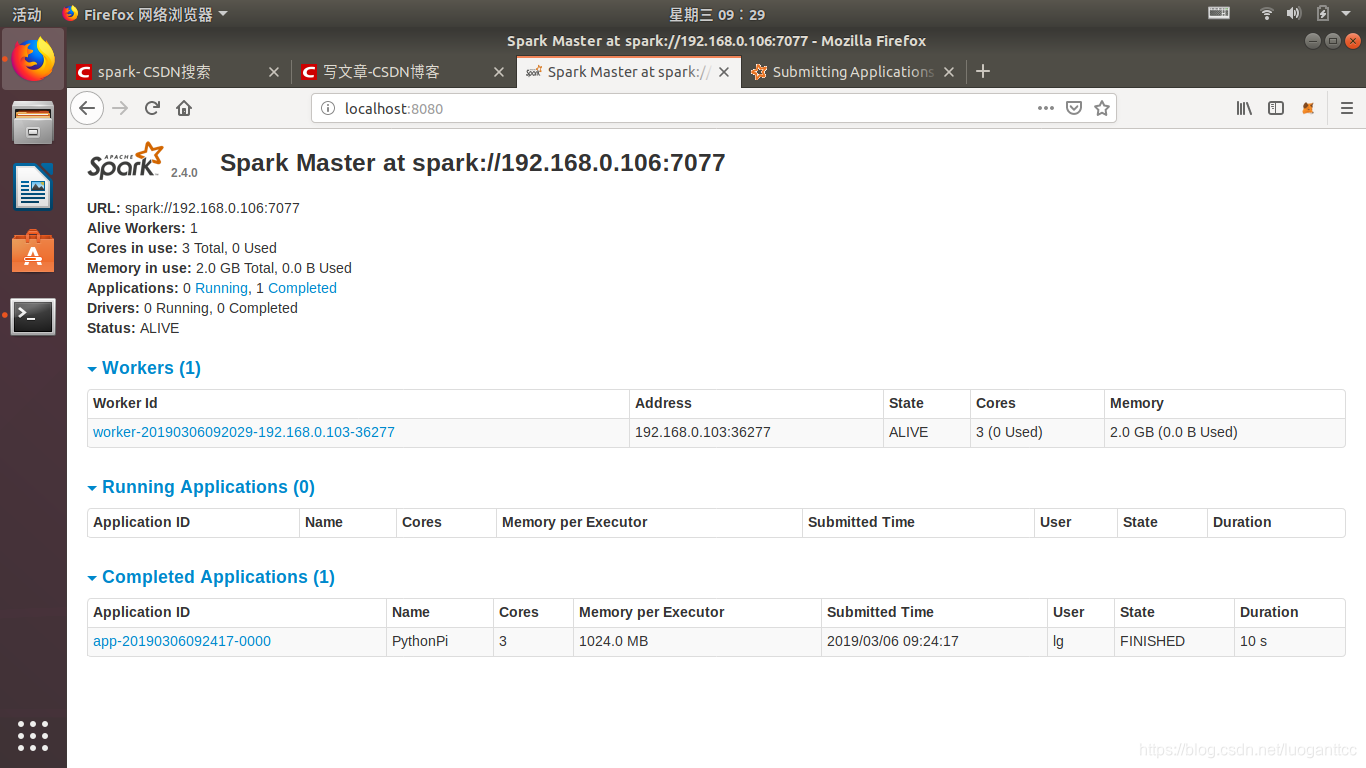

任务已经执行完毕,耗时10秒

Spark分布式计算实践

Spark分布式计算实践

本文介绍如何在Spark集群中运行Python脚本,通过具体实例展示分布式计算的执行过程及效率。在master节点上使用spark-submit命令提交pi.py计算任务,演示了从任务提交到完成的整个流程,最终耗时10秒。

本文介绍如何在Spark集群中运行Python脚本,通过具体实例展示分布式计算的执行过程及效率。在master节点上使用spark-submit命令提交pi.py计算任务,演示了从任务提交到完成的整个流程,最终耗时10秒。

文档链接

#切换到spark安装目录,执行下面一条命令,192.168.0.10是master的ip,

examples/src/main/python/pi.py 是python 文件的路径

./bin/spark-submit --master spark://192.168.0.106:7077 examples/src/main/python/pi.py

任务已经执行完毕,耗时10秒

转载于:https://www.cnblogs.com/luoganttcc/p/10525198.html

449

449

1250

1250

2859

2859

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?