1. 数据准备:收集数据与读取

2. 数据预处理:处理数据

3. 训练集与测试集:将先验数据按一定比例进行拆分。

4. 提取数据特征,将文本解析为词向量 。

5. 训练模型:建立模型,用训练数据训练模型。即根据训练样本集,计算词项出现的概率P(xi|y),后得到各类下词汇出现概率的向量 。

6. 测试模型:用测试数据集评估模型预测的正确率。

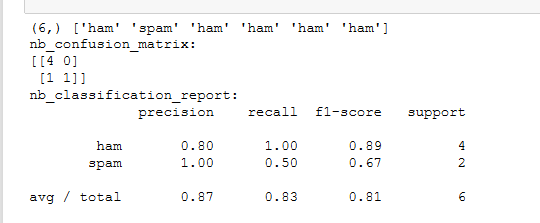

混淆矩阵

准确率、精确率、召回率、F值

7. 预测一封新邮件的类别。

!pip install nltk

import nltk

from nltk.corpus import stopwords

from nltk.stem import WordNetLemmatizer

##预处理

def preprocessing(text):

#text=text.decode('utf-8')

tokens=[word for sent in nltk.sent_tokenize(text) for word in nltk.word_tokenize(sent)]

stops=stopwords.words('english')

tokens=[token for token in token not in stops]

tokens=[token.lower() for tokens in tokens if len(token)>=3]

lmtzr= WordNetsLemmatize()

tokens=[lmtzr.lemmatize(token) for token in tokens]

preprocessed_text=''.jion(tokens)

return preprocessed_text

##读取数据集

import csv

file_path = r"D:\sms.txt"

sms=open(file_path,'r',encoding='utf-8')

sms_data=[]

sms_label=[]

csv_reader=csv.reader(sms,delimiter='\t')

for line in csv_reader:

sms_label.append(line[0])

sms_data.append(line[1])

sms.close()

from sklearn.model_selection import train_test_split

x_train,x_test,y_train,y_test = train_test_split(sms_data,sms_label,test_size=0.3,random_state=0,stratify=sms_label)

print(len(sms_data),len(x_train),len(x_test))

x_train

结果:

##将其向量化

from sklearn.feature_extraction.text import TfidfVectorizer

vectorizer=TfidfVectorizer(min_df=2,ngram_range=(1,2),stop_words='english',strip_accents='unicode')

X_train=vectorizer.fit_transform(x_train)

X_test=vectorizer.transform(x_test)

##朴素贝叶斯分类器

from sklearn.naive_bayes import MultinomialNB

clf=MultinomialNB().fit(X_train,y_train)

y_nb_pred=clf.predict(X_test)

##分类结果显示

from sklearn.metrics import confusion_matrix

from sklearn.metrics import classification_report

print(y_nb_pred.shape,y_nb_pred) #x_test的预测结果

print('nb_confusion_matrix:')

cm=confusion_matrix(y_test,y_nb_pred) #混淆矩阵

print(cm)

print('nb_classification_report:')

cr=classification_report(y_test,y_nb_pred) ##主要分类指标的文本报告

print(cr)

feature_names=vectorizer.get_feature_names() ##出现过的单词列表

coefs=clf.coef_ ##先验概率P(x_i|y),6034 feature_log_prob_

intercept=clf.intercept ##P(y),class_log_prior_;array;shape(n_classes,)Smoothed empirical log probability for each class

coefs_with_fns=sorted(zip(coefs[0],feature_name)) ##对数概率P(x_i|y)与单词x_i映射

n=10

top = zip(coefs_with_fns[:n],coefs_with_fns[:-(n+1):-1]) ##最大的10个与最小的10个单词

for (coef_1,fn_1),(coef_2,fn_2) in top:

print('\t%.4f\t%-15s\t\t%.4f\t%-15s'%(coef_1,fn_1,coef_2,fn_2)) ##查看准确率、召回率、F值、精确率

结果:

##预测一封新邮件的类别。

new_email=['新邮件']

vectorizer(new_email)

clf.predict(new_email)

本文详细介绍了一种基于朴素贝叶斯分类器的垃圾邮件过滤方法,包括数据预处理、特征提取、模型训练及评估等关键步骤。通过使用NLTK库进行文本预处理,TF-IDF向量化,以及利用混淆矩阵、准确率、精确率、召回率和F值来评估模型性能。

本文详细介绍了一种基于朴素贝叶斯分类器的垃圾邮件过滤方法,包括数据预处理、特征提取、模型训练及评估等关键步骤。通过使用NLTK库进行文本预处理,TF-IDF向量化,以及利用混淆矩阵、准确率、精确率、召回率和F值来评估模型性能。

2902

2902

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?