对于网络爬虫,我们是既爱又恨。一方面爬虫可以带来客观的流量,另一方面又会占用服务器资源。因此在面对爬虫时,进行爬虫管理很有必要。那么我们该如何防止网站被爬虫呢?

一、分辨爬虫的善恶

网络爬虫分为两种,一种是善意爬虫,例如百度、Google等搜索引擎的爬虫,另一种是恶意爬虫,它可能会利用网站漏洞,非法窃取网站数据,或者爬取网站内容,占用服务器资源。恶意爬虫的行为是我们所深恶痛觉的,必须想尽办法予以过滤和阻断。网站或者某一些网页不想被诸如百度、Googl等善意爬虫爬取时,我们也希望能采取一些措施。

二、如何防止网站被爬虫?

针对善意爬虫,几乎所有的搜索引擎爬虫,都会遵守robots协议,只要我们在网站的根目录下存放一个ASCII编码的文本文件,告诉搜索引擎哪些页面不能爬取,搜索引擎的蜘蛛便会遵照协议,不爬取指定页面的内容。

但是robots并不是一个规范,而是一种君子协议,它只对善意爬虫有效,并不能防止恶意爬虫。

针对恶意爬虫,我们可以采取以下措施来识别和阻断它。

1.限制User-Agent字段

User-Agent字段能识别用户所使用的操作系统、版本、CPU、浏览器等信息,如果请求来自非浏览器,就能识别其为爬虫,阻止爬虫抓取网站信息。

User-Agent字段虽然有效,但对于精心构造的爬虫来说,效果并不好。攻击者可以通过在恶意爬虫请求的User-Agent字段中带上baidu字符,伪装成百度爬虫绕过这一规则,无法被拦截。

2.限制IP

限制IP是最常见的手段之一,为了效率,恶意爬虫的请求频率往往比正常流量高,找出这些IP并限制其访问,可以有效降低恶意爬虫造成的危害。

不过限制IP也有自己的缺点,容易误伤正常用户,攻击者可以通过搭建IP池的方法,来解决这个问题。

3. 添加验证码

在登录页等页面,添加验证码,以识别是正常流量还是恶意爬虫,也是一种基本的操作。不过如今爬虫技术,早已能解决验证码的问题,例如二值化、中值滤波去噪等等。

4.Cookies限制

根据业务需求,可对Cookies进行限制,要求用户登录后才能使用某些功能或权限,并针对同一账号的访问速度进行限制。

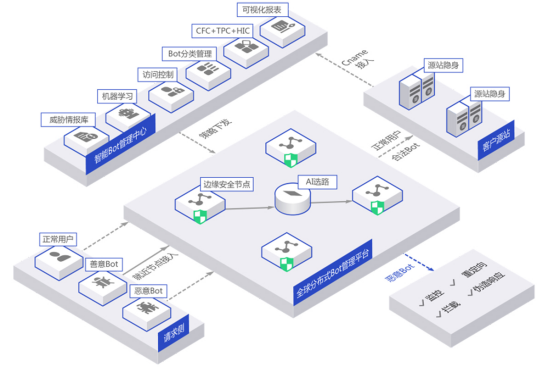

5.使用爬虫管理产品

蔚可云提供了BotGuard爬虫管理产品,通过交互验证、大数据分析、合法性验证等策略,帮助企业实时检测、管理和阻断恶意爬虫。

本文介绍了如何区分善意与恶意网络爬虫,并提供了多种防止网站被恶意爬虫侵扰的方法,包括利用robots协议、限制User-Agent字段、限制IP、添加验证码及Cookies限制等。

本文介绍了如何区分善意与恶意网络爬虫,并提供了多种防止网站被恶意爬虫侵扰的方法,包括利用robots协议、限制User-Agent字段、限制IP、添加验证码及Cookies限制等。

895

895

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?