DeepSeek和豆包在解不定积分等数学问题上的表现存在显著差异

今天无意用DeepSeek解不定积分,结果让人诧异,以下截图就是DeepSeek对不定积分的解析结果;

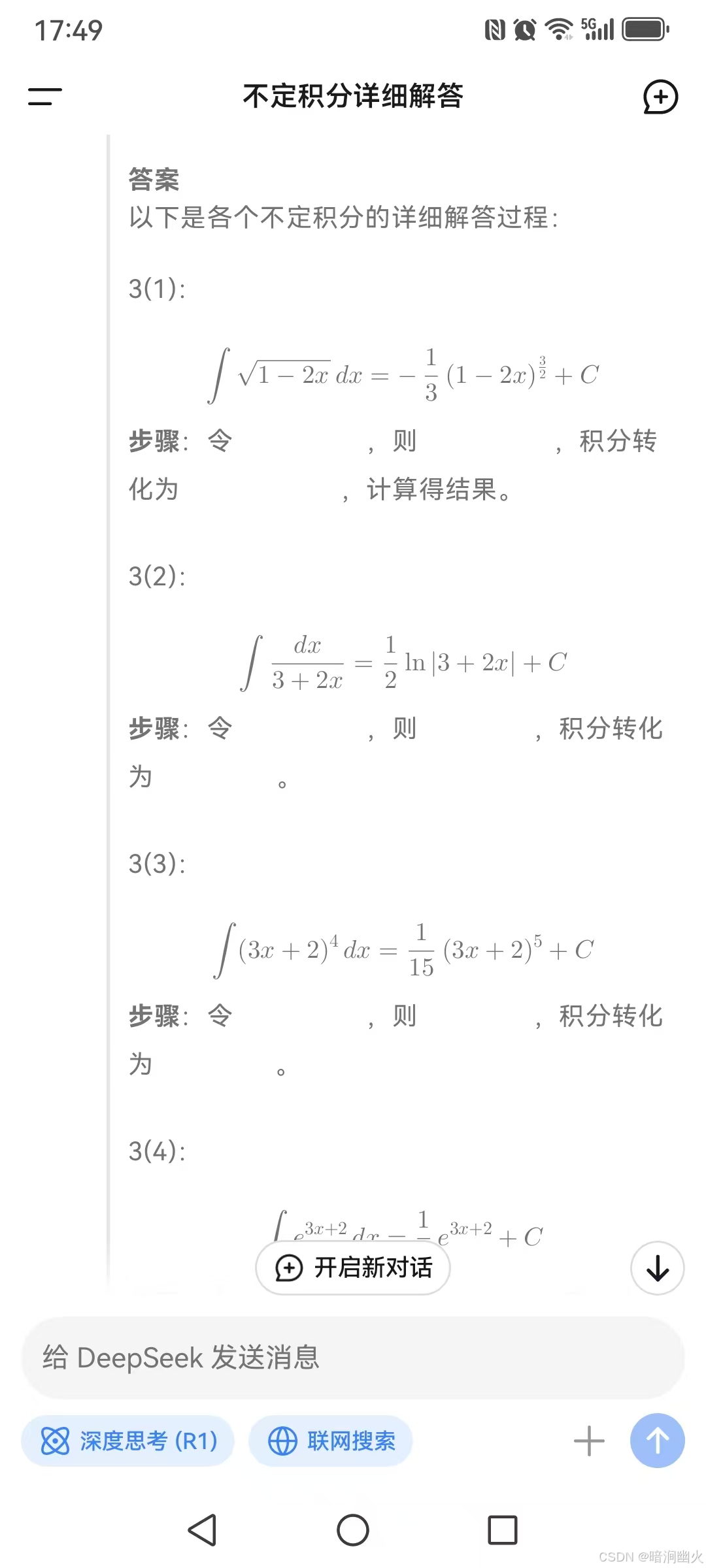

后来我又用豆包来解同样的不定积分,还是原来的题目,但豆包的解题结果还是让人满意的,以下截图就是豆包对不定积分的解析结果;

DeepSeek和豆包在解不定积分等数学问题上的表现存在显著差异,主要体现在功能定位、技术优势及适用场景等方面。以下是我对两者的综合对比分析:

DeepSeek和豆包的不同方面

模型类型方面

豆包是多模态的,DeepSeek是专注于自然语言处理的大语言模型。

功能特点方面

DeepSeek在数学推理和代码生成方面优势显著,能解决复杂数学问题,而豆包在多模态任务处理更好。

性能表现方面

DeepSeek在数学测试中正确率高,而豆包可能在复杂专业领域需要提升。

应用场景

DeepSeek适合编程、学术,豆包适合实时数据和语音交互。

价格方面

DeepSeek的成本更低,可能更适合需要频繁使用的场景。这些信息都说明DeepSeek在数学问题处理上更强,所以解不定积分可能更好用,但我出现的这种情况可能属于特例。

深度思考模式

DeepSeek展示了更详细的思考分析过程,而豆包在第二次提问时才有更多思考。

哲学问题方面

DeepSeek偏向技术导向,引用更多科学理论。这说明在数学问题解答的详细性和逻辑性上,DeepSeek可能更胜一筹。

综合来看

DeepSeek在数学推理、代码生成方面有优势,且成本更低,适合解不定积分这类需要逻辑推理的任务,但在显示方面还待优化。豆包虽然多模态强,但数学方面可能不如DeepSeek。此外,DeepSeek在MATH 500测试中正确率高,而豆包在逻辑推理上略逊。

5662

5662

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?