- 感知机

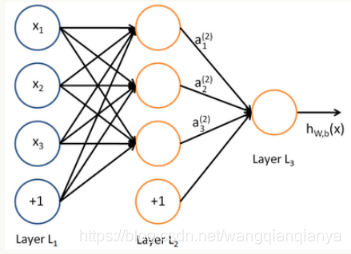

即神经元,感知机算法即神经网络算法,一般指浅层神经网络。

理论上单隐层神经网络可以拟合所有函数,但需要的神经元数量会要很多,且易出现梯度消失情况。而深度神经网络层数增加,表示的特征更多,神经元数量减少。

- 输入层:为训练数据,n为每个样本的特征数。

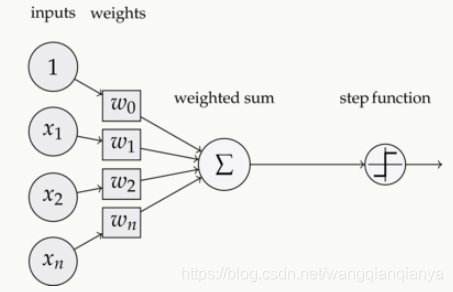

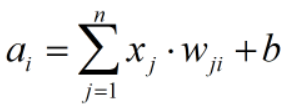

- W为权重,前一层的每个神经元与后一层每一个神经元之间都有一个权重,随机初始化。b/w0为偏置,每层有一个偏置。下一层每个神经元的值有前一层输入与权重计算而得:

若为分类问题,最终输出由计算值输入激活函数得![]()

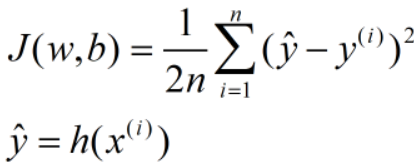

- 目标:最小化损失函数:

1/2n是为了求导方便。

- 前向传播求得y^后再反向传播更新W与b

- 归一化:特征缩放

当输入的训练数据的特征值太大或有的很大有的很小时,计算量变大且误差会大(影响W的更新),所以对于输入,我们可以将所有输入层神经元的值归一化到[0,1]之间:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?