目录

一、机器学习 (ML) 的不确定性

1、不确定性的两大主要影响因素

(1)数据集里的噪点数据

(2)有限的数据集

2、概率论基础

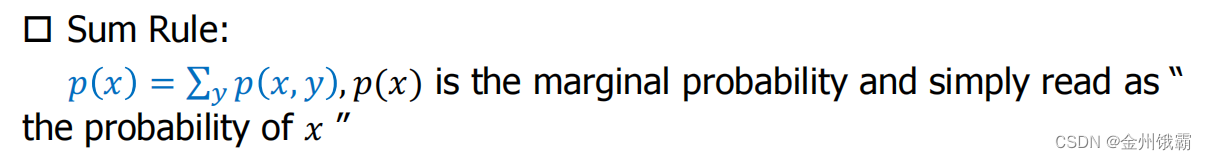

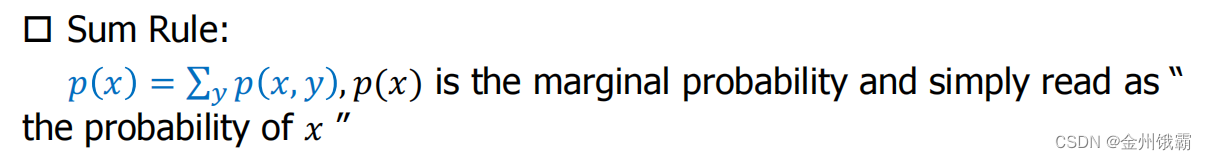

(1)求和法则:

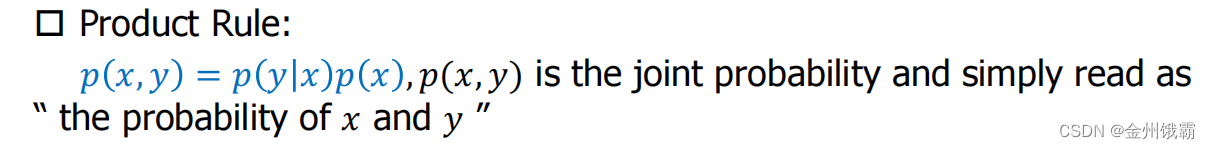

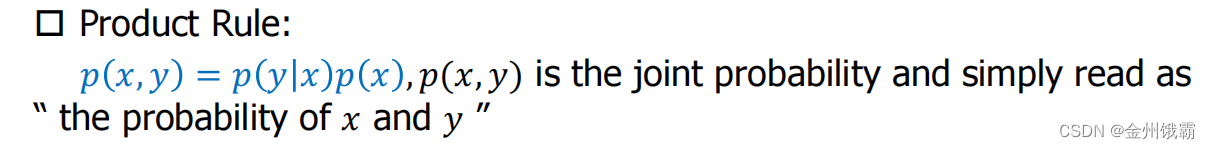

(2)连乘法则:

(3)贝叶斯理论:其中p(x)称为标准化常量(或者叫归一化常量),防止概率之和加起来超过1,p(y|x)称为后验概率(Posterior probability),p(x|y)称为似然概率(Likelihood probability),p(y)称为先验概率(Priori probability)

目录

1、不确定性的两大主要影响因素

(1)数据集里的噪点数据

(2)有限的数据集

2、概率论基础

(1)求和法则:

(2)连乘法则:

(3)贝叶斯理论:其中p(x)称为标准化常量(或者叫归一化常量),防止概率之和加起来超过1,p(y|x)称为后验概率(Posterior probability),p(x|y)称为似然概率(Likelihood probability),p(y)称为先验概率(Priori probability)

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?