本篇继续上篇的未完部分。前面介绍完了反复迭代训练的例子,本篇继续介绍多目录数据训练模型的例子。

4. 多目录数据训练

本例在前面的批量数据训练和反复迭代训练的基础上做修改,将数据文件存放于多个目录下,而非仅存放于一个目录下,以便于支持数据的分散式获取,例如:按日期获取,不同日期获取的数据存放于不同的目录下;或者按提供者分组,将不同人提供的数据存放于不同的目录下。注:此处存放数据的多个目录的名称同样需要使用数字编号,以便统一处理。

(1)创建项目并导入SDK

按照前面文章的介绍进行项目创建,并导入SDK,详细内容请参考前面的文章。

(2)编码

整体代码依旧分为四部分,即神经网络初始化、训练数据读取、网络模型训练、模型保存,其中的数据读取和模型训练两部分放在三层的循环之中,内层循环用于读取一个目录下的所有数据进行训练,中间层的循环用于读取多个目录,外层循环用于迭代直至所有数据都不会引起模型的增长为止。整体的代码如下所示:

void main(void)

{

FILE* pFile = NULL;

char strFoldName[256] = { 0 };

char strFileName[256] = { 0 };

int nPieces = 0; //训练数据中(一局对弈)的棋子数

int narrSteps[1000] = { 0 }; //对弈中从第一子到最后一子的信息:X坐标、Y坐标、落子者(黑为-1,白为1)

int nFileIndexStart = 1; //第一个数据文件的名称所对应的数字

int nFoldIndexStart = 1; //第一个目录的名称所对应的数字

int* parrSteps = NULL;

bool bAgain = false; //标志着是否还要再循环一次迭代

int nInterCount = 0; //迭代次数

InitWithoutModelFile(15, 15, 5);

do

{

nInterCount++;

bAgain = false;

nFoldIndexStart = 1;

bool bNext = true; //需要继续操作下一个目录

sprintf(strFoldName, "D:/Data/%d", nFoldIndexStart++);

while (bNext)

{

bNext = false;

nFileIndexStart = 1;

sprintf(strFileName, "%s/%d.txt", strFoldName, nFileIndexStart++);

while ((pFile = fopen(strFileName, "r")) != NULL)

{

bNext = true;

printf("%d: %s\n", nInterCount, strFileName);

nPieces = 0;

parrSteps = narrSteps;

while (fscanf(pFile, "%d %d %d", parrSteps, parrSteps + 1, parrSteps + 2) == 3)

{

parrSteps += 3;

nPieces++;

}

fclose(pFile);

bAgain = bAgain || TrainNetwork(narrSteps, nPieces, 15, 15);

sprintf(strFileName, "%s/%d.txt", strFoldName, nFileIndexStart++);

}

sprintf(strFoldName, "D:/Data/%d", nFoldIndexStart++);

}

} while (bAgain);

SaveModel("D:/Model/model.mod");

}

首先,调用SDK的函数InitWithoutModelFile(15,15,5)进行神经网络初始化,此处表示从空模型初始化为15x15棋盘上的五子棋,若想在已有模型上进行追加训练,则调用的是InitFromModelFile()函数。若想训练的是六连子模型,则只需将第三个参数从5改为6即可。

然后,使用一个while循环来逐个打开和读取数据文件,并使用读取的数据调用TrainNetwork()函数来训练神经网络模型。在该while循环外再包一层while循环,用来依次递增目录,即逐个目录遍历,该层循环的控制变量bNext在指定目录不存在或为空目录时为false,此时会中止目录的继续遍历,进入外层循环。在该while循环外面再包一层do循环,用于对整批数据进行迭代,直到整批数据都不会再对模型产生增长为止。注:在do循环表示的迭代中,一开始就要将目录名称对应的数值nFoldIndexStart重置为1(起始目录名称),而且要将bAgain重置为false以免受上一轮的影响;而在中间的循环内,一开始的时候就要将文件名称对应的数值nFileIndexStart重置为1(起始文件名称),而且要将bNext重置为false以便在遇到不存在的目录或空目录时退出本层循环。

最后,在模型训练结束之后调用SDK函数SaveModel()保存训练得到的模型。

总体上,本例代码与循环迭代训练的代码相差不大,只是在两层循环中间增加了一层循环用于遍历各个目录。若仅仅想使用若干个目录中的数据文件进行一次训练,不需要迭代的话,只需将最外层的do循环去掉即可。

(3)测试

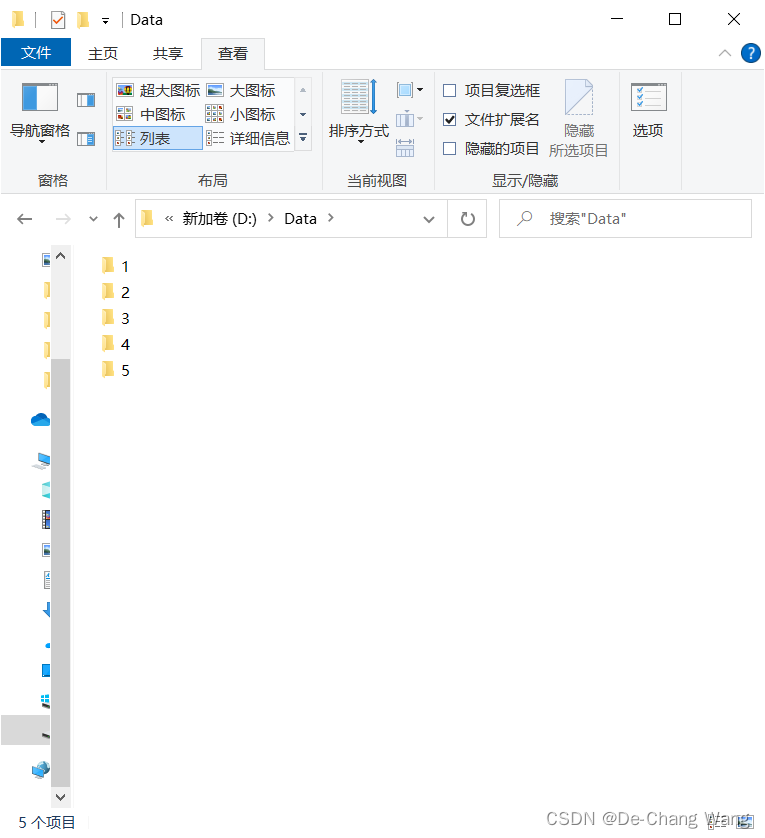

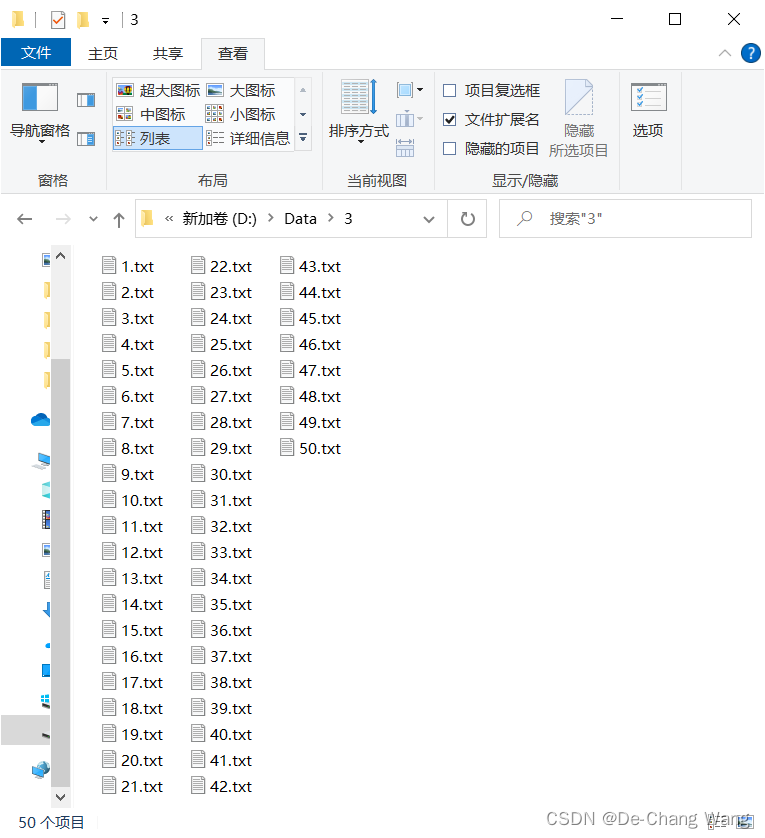

至此为止,多目录数据训练的例子已经编码完成,我们将之前用的211个训练数据拆分到多个目录下,每个目录下放置50个文件,如下图所示:

运行程序之后可以在D盘的Model目录下看到新训练出的模型文件model.mod,可以将该模型用于之前文章中介绍的“神经网络五子棋(家庭版)”等软件中进行测试。

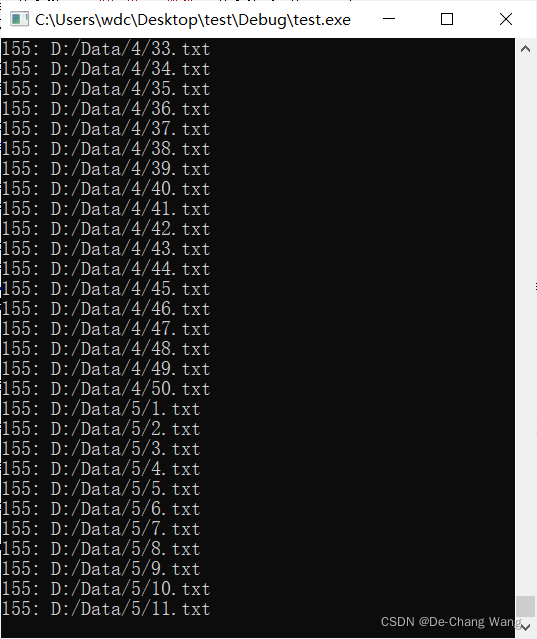

本例的运行时间依然较长,整批数据也是迭代了155次,如下图所示:

(4)后续

多目录数据训练例程已经介绍完毕,其它的例程请继续关注后续文章。

本例的完整代码如下所示:

#include "stdio.h"

#include "Inter.h"

#pragma comment(lib, "AIWZQDll.lib")

void main(void)

{

FILE* pFile = NULL;

char strFoldName[256] = { 0 };

char strFileName[256] = { 0 };

int nPieces = 0; //训练数据中(一局对弈)的棋子数

int narrSteps[1000] = { 0 }; //对弈中从第一子到最后一子的信息:X坐标、Y坐标、落子者(黑为-1,白为1)

int nFileIndexStart = 1; //第一个数据文件的名称所对应的数字

int nFoldIndexStart = 1; //第一个目录的名称所对应的数字

int* parrSteps = NULL;

bool bAgain = false; //标志着是否还要再循环一次迭代

int nInterCount = 0; //迭代次数

InitWithoutModelFile(15, 15, 5);

do

{

nInterCount++;

bAgain = false;

nFoldIndexStart = 1;

bool bNext = true; //需要继续操作下一个目录

sprintf(strFoldName, "D:/Data/%d", nFoldIndexStart++);

while (bNext)

{

bNext = false;

nFileIndexStart = 1;

sprintf(strFileName, "%s/%d.txt", strFoldName, nFileIndexStart++);

while ((pFile = fopen(strFileName, "r")) != NULL)

{

bNext = true;

printf("%d: %s\n", nInterCount, strFileName);

nPieces = 0;

parrSteps = narrSteps;

while (fscanf(pFile, "%d %d %d", parrSteps, parrSteps + 1, parrSteps + 2) == 3)

{

parrSteps += 3;

nPieces++;

}

fclose(pFile);

bAgain = bAgain || TrainNetwork(narrSteps, nPieces, 15, 15);

sprintf(strFileName, "%s/%d.txt", strFoldName, nFileIndexStart++);

}

sprintf(strFoldName, "D:/Data/%d", nFoldIndexStart++);

}

} while (bAgain);

SaveModel("D:/Model/model.mod");

}

本文介绍了一种在多个目录中存储训练数据的方法,通过多层循环遍历不同目录下的文件,实现了模型的迭代训练。文章提供了完整的代码示例,展示了如何在每次迭代中更新模型,直至模型收敛。

本文介绍了一种在多个目录中存储训练数据的方法,通过多层循环遍历不同目录下的文件,实现了模型的迭代训练。文章提供了完整的代码示例,展示了如何在每次迭代中更新模型,直至模型收敛。

1263

1263

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?