文章目录

前言

机器学习是一门多领域交叉学科,它作为计算机专业研究生必学的课程之一,利用就读研究生前的时间对其进行提前学习是十分必要的。本周首先进行一些基础概念的学习。

一、什么是机器学习

1.机器学习≈Looking for Function,寻找人类无法写出的复杂函数。

如:

speech recognition 语音识别

image recognition 图片识别

playing go 下围棋

2.深度学习是机器学习的分支,以人工神经网络为架构,对数据进行表征学习。

机器学习的方法:

Supervised Learning 监督式学习

Self-supervised Learning 监督式学习

一些术语:

Pre-train Model(Foundation Model) 基础模型

CNN(Convolutional neural networks) 卷积神经网络

Generative Adversarial Networks 生成对抗式网络

Reinforcement Learning 强化学习

二、Function种类

Regression(回归):输出scalar(数值),如预测PM2.5的数值。

Classification(分类):让机器做选择题,如辨别是否为垃圾邮件,阿尔法狗等。有二元选择题或多元选择题。

Structured Learning(结构学习):让机器进行创造性活动,例如画图,写作文章。

三、如何找Function

1. function with unknown parameters(写出带有未知参数的函数)

(based on domain knowledge)

y:进化后的cp值 Xcp:进化前的cp值(feature)

w(weight)和b(bias)代表未知参数

由此抽象出的函数function称为Model(模型)。

以上这些具体化的function的集合是Linear Model,我们可以将其扩展为:

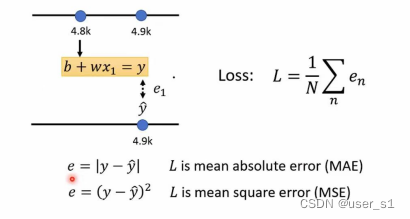

2. 定义Loss Function

该Loss function函数实际上是一种评估函数,用以衡量一组参数的好坏。

最常用的方法包括MAE和MSE。

3. Optimization(最优化)

寻找最好的w和b,使得L最小。

方法:Gradient Descent (梯度下降算法)

首先假设只有一个参数w

a.随机选择一个初始值w0

b.先计算w对Loss的微分,即求w0点在Loss图像的斜率k。

(w往低的地方取点)

若k<0,则把w值变大,Loss值就会变小。若k>0,则把w值变小,Loss值就会变小。

w的step不仅取决于当前点斜率,还受到Learning rate(学习速率)的影响。

再求

,即为学习率。这种需要自己设定的数值叫做 Hyperparamenters。

,即为学习率。这种需要自己设定的数值叫做 Hyperparamenters。

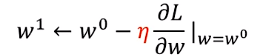

得出

c.反复上述过程。

如果learning rate比较大,那么每踏出一步,参数w更新的幅度也会比较大,机器学习的速度就会比较快。但若learning rate过大,可能会跳过最合适的点(global minima)。

当微分为0的时候,参数就会卡在该点上停止更新,此时并未找出最优解global minima。微分为0时被称为Local minima。

当有两个参数时,用一个参数的情形去类推即可。两种情形本质相同。

Model Bias:Linear models较为简单,有很多缺陷,需要使用更复杂的models。

New Models:More Features

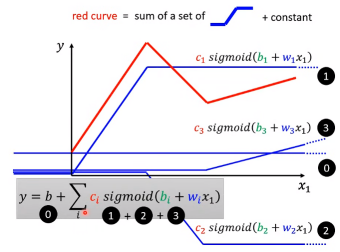

如下图使用常数加直线的方法不断合成逼近原复杂函数。

求法如下:

求法如下:

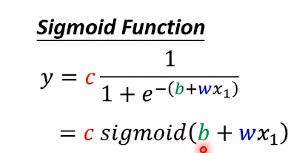

使用sigmoid function,改变c,b,w的值可获得不同的sigmoid function。

总结

通过本周对机器学习以及深度学习一些概念的了解,进一步认识到了数学和科学的重要性。机器学习中需要用到很多概率论,统计学,逼近论等等数学知识。在学习机器学习的同时不能忽视数学的继续学习。

913

913