为什么要使用深层神经网络

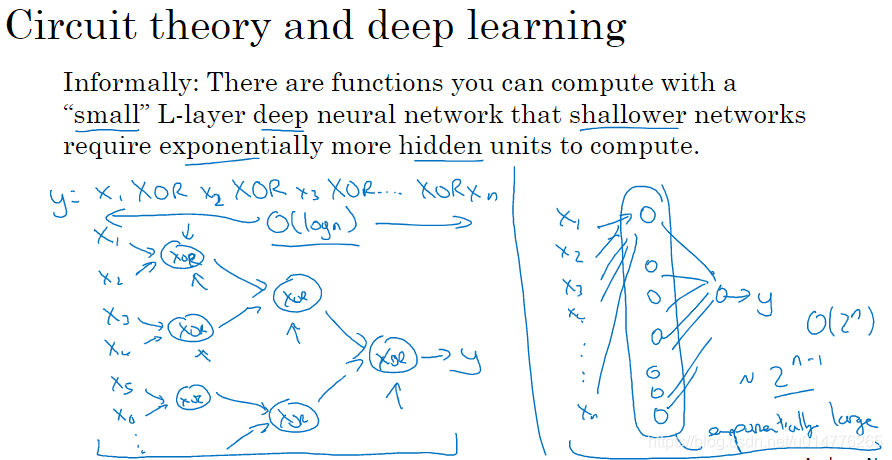

电路定理来解释:

如果使用多层神经网络,计算上面的x1 XOR x2 …,其算法的复杂度为O(logn)

使用单层神经网络,其算法的复杂度为O(2n)

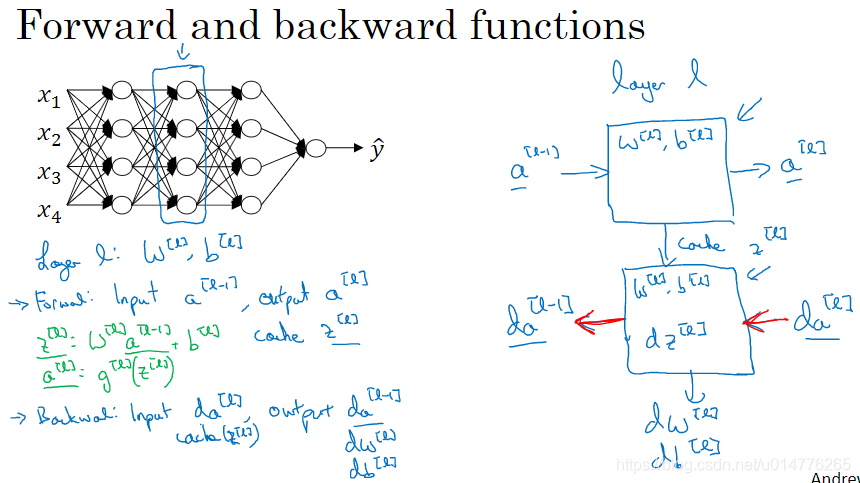

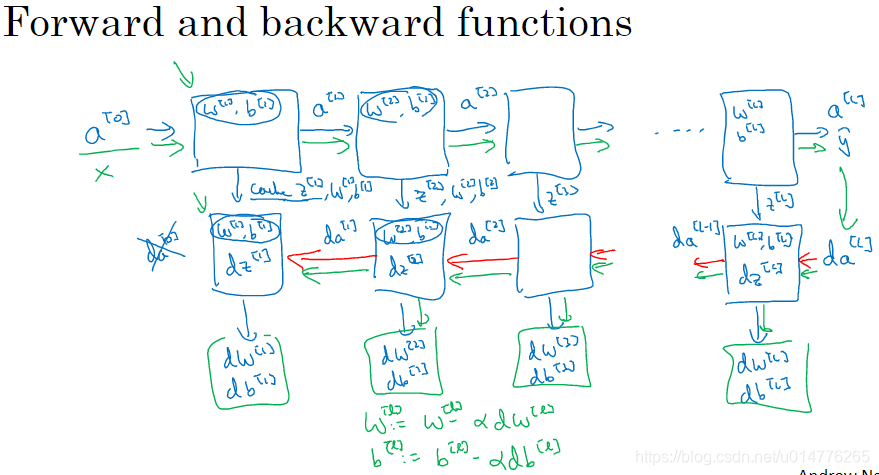

搭建深层神经网络块

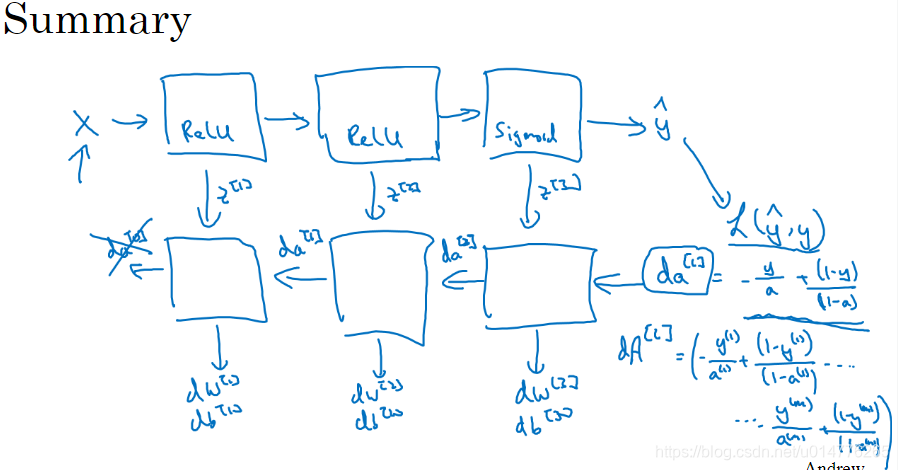

向前传播和向后传播如何计算

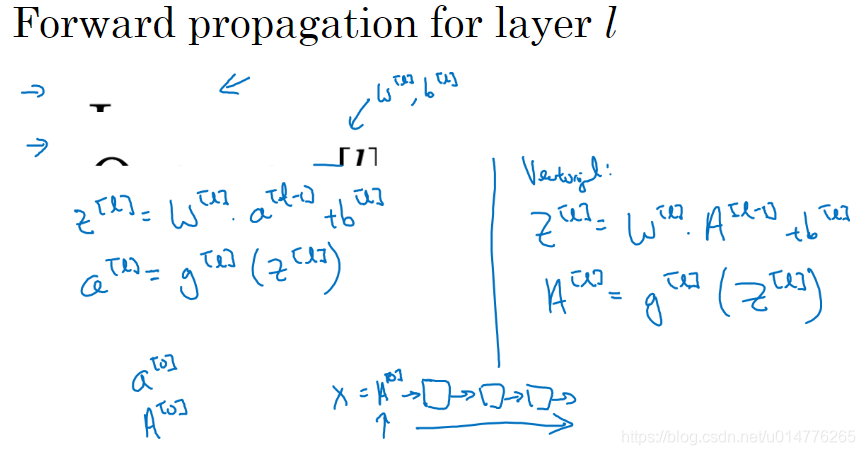

前向和反向传播

前向传播公式

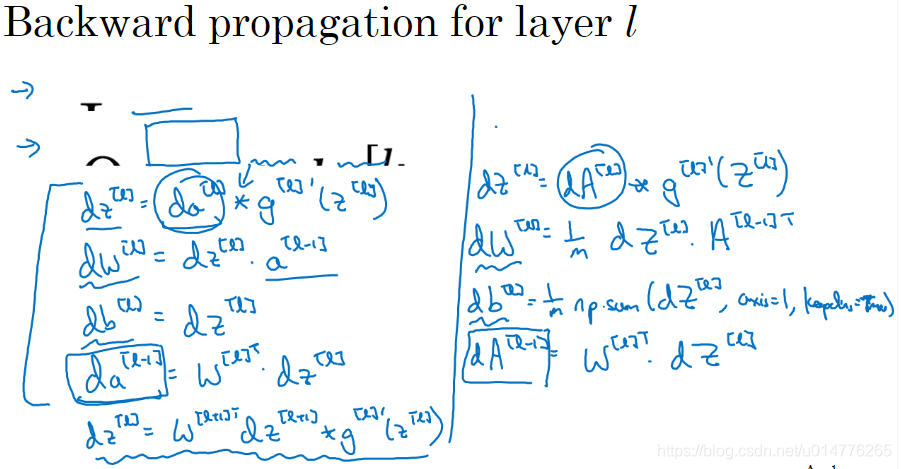

反向传播公式

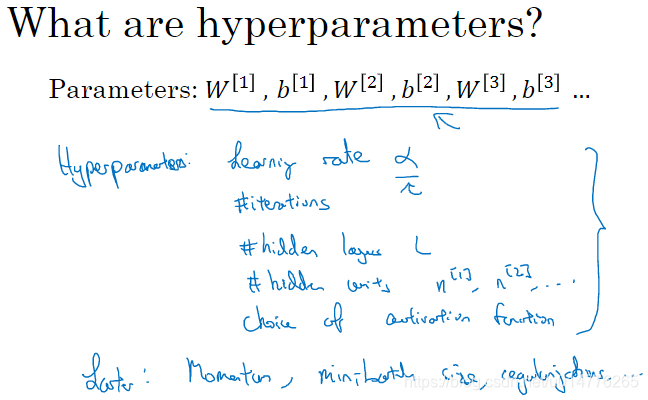

参数VS超参数

超参数能决定W,b的值。我们目前有很多的超参数,如:

learning rate

iterations

number of hidden layers

number of hidden units

choice of activation

momentum

mini batch size

regularization parameters

本文深入探讨了深层神经网络相较于单层神经网络在算法复杂度上的优势,通过电路定理解释了深层网络如何以O(logn)的复杂度计算x1XORx2…,而单层网络则需O(2n)。此外,文章还涵盖了搭建深层神经网络、前向与反向传播计算、超参数选择等关键主题。

本文深入探讨了深层神经网络相较于单层神经网络在算法复杂度上的优势,通过电路定理解释了深层网络如何以O(logn)的复杂度计算x1XORx2…,而单层网络则需O(2n)。此外,文章还涵盖了搭建深层神经网络、前向与反向传播计算、超参数选择等关键主题。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?