具体需求

- 使用的版本为Scrapy2.12,其他版本自测

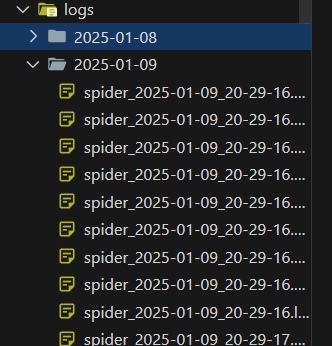

日志记录按照时间来存储,

比如当天的日志就建立当天的文件夹并将当天的日志放入

希望可以按照等级来记录

ERROR放置在ERROR文件夹

示例如下

第一步

pip install loguru

拦截scrapy日志记录,转换为loguru(不按照等级归类)

- 使用

InterceptHandler类- 这个类是Python标准库l

ogging模块中的Handler类的子类。它的目的是拦截由Scrapy产生的标准日志,并将它们转发到Loguru日志库进行处理。

- 这个类是Python标准库l

class InterceptHandler(logging.Handler):

- 实现

emit方法: 这是Handler子类必须实现的一个方法,它描述了当一个日志消息被处理时应该执行的动作。

class InterceptHandler(logging.Handler):

def emit(self, record):

pass

- 完善

emit方法

from loguru import logger

import sys

import os

import logging

# 创建日志目录

LOG_DIR = "logs"

if not os.path.exists(LOG_DIR):

os.makedirs(LOG_DIR)

# 获取当前日期作为子目录名

CURRENT_DATE = "{time:YYYY-MM-DD}"

LOG_PATH = os.path.join(LOG_DIR, CURRENT_DATE)

# 创建一个自定义的日志处理器,将Scrapy的日志转发到loguru

class InterceptHandler(logging.Handler):

def emit(self, record):

# 获取对应的loguru级别

try:

level = logger.level(record.levelname).name

except ValueError:

level = record.levelno

# 找到发出日志的模块

frame, depth = logging.currentframe(), 2

while frame.f_code.co_filename == logging.__file__:

frame = frame.f_back

depth += 1

logger.opt(depth=depth, exception=record.exc_info).log(

level, record.getMessage()

)

# 配置loguru

# logger.remove() # 注释掉这行,不要移除默认的控制台输出

# 添加控制台输出

logger.add(sys.stdout, level="DEBUG")

# 添加文件输出

logger.add(

os.path.join(LOG_DIR, CURRENT_DATE, "spider_{time:YYYY-MM-DD_HH-mm-ss}.log"),

rotation="500 B", # 设置为500字节,便于测试

#rotation="3 MB", # 每个文件最大3MB

retention=None, # 日志永久保留

#retention="10 days", # 保留10天的日志

level="DEBUG",

encoding="utf-8"

)

# 配置Scrapy日志

logging.basicConfig(handlers=[InterceptHandler()], level=logging.DEBUG)

# Scrapy设置

LOG_ENABLED = True # 启用Scrapy的日志

LOG_LEVEL = 'DEBUG' # 设置日志级别

- 你也可以测试测试

import scrapy

from loguru import logger

class BaiduSpider(scrapy.Spider):

name = "baidu"

allowed_domains = None

start_urls = ["https://dreamlove.top"]

def parse(self, response):

print("响应的内容response.url",response.url)

# 测试日志分片

for i in range(100):

logger.error(f"这是一条测试日志消息,编号:{i} " * 3) # 重复3次使消息更长

按照等级归类

- 效果如下

logs/

└── 2024-03-21/ # 日期文件夹

├── debug/ # DEBUG级别日志

│ ├── spider_2024-03-21_10-30-00.log

│ └── spider_2024-03-21_10-30-00.1.log

├── info/ # INFO级别日志

│ ├── spider_2024-03-21_10-30-00.log

│ └── spider_2024-03-21_10-30-00.1.log

├── warning/ # WARNING级别日志

│ └── spider_2024-03-21_10-30-00.log

├── error/ # ERROR级别日志

│ └── spider_2024-03-21_10-30-00.log

└── critical/ # CRITICAL级别日志

└── spider_2024-03-21_10-30-00.log

from loguru import logger

import sys

import os

import logging

# 创建日志目录

LOG_DIR = "logs"

if not os.path.exists(LOG_DIR):

os.makedirs(LOG_DIR)

# 获取当前日期作为子目录名

CURRENT_DATE = "{time:YYYY-MM-DD}"

LOG_PATH = os.path.join(LOG_DIR, CURRENT_DATE)

# 添加不同级别的日志文件

log_levels = {

"DEBUG": "debug",

"INFO": "info",

"WARNING": "warning",

"ERROR": "error",

"CRITICAL": "critical"

}

# 创建一个自定义的日志处理器,将Scrapy的日志转发到loguru

class InterceptHandler(logging.Handler):

def emit(self, record):

# 获取对应的loguru级别

try:

level = logger.level(record.levelname).name

except ValueError:

level = record.levelno

# 找到发出日志的模块

frame, depth = logging.currentframe(), 2

while frame.f_code.co_filename == logging.__file__:

frame = frame.f_back

depth += 1

logger.opt(depth=depth, exception=record.exc_info).log(

level, record.getMessage()

)

# 配置loguru

logger.remove() # 清除默认的处理器

# 添加控制台输出

logger.add(sys.stdout, level="DEBUG")

# 添加文件输出

for level, folder in log_levels.items():

logger.add(

os.path.join(LOG_DIR, CURRENT_DATE, folder, "spider_{time:YYYY-MM-DD_HH-mm-ss}.log"),

rotation="500 B", # 设置为500字节,便于测试

retention=None, # 日志永久保留

level=level,

encoding="utf-8",

filter=lambda record, l=level: record["level"].name == l

)

# 配置Scrapy日志

logging.basicConfig(handlers=[InterceptHandler()], level=logging.DEBUG)

# Scrapy设置

LOG_ENABLED = True # 启用Scrapy的日志

LOG_LEVEL = 'DEBUG' # 设置日志级别

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?