windows下安装spark

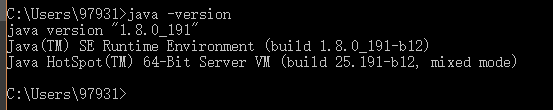

1、安装jdk

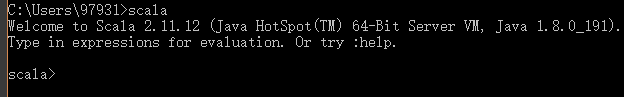

2、安装scala

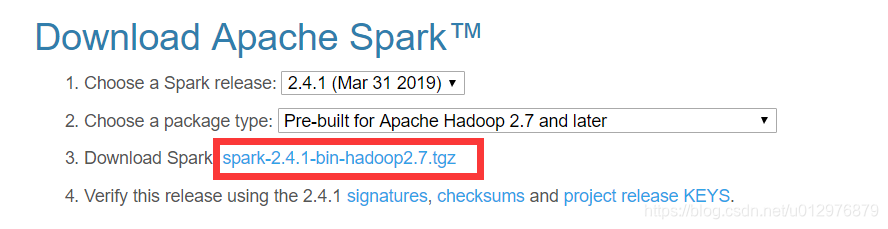

3、下载spark

spark下载地址

3.1安装spark

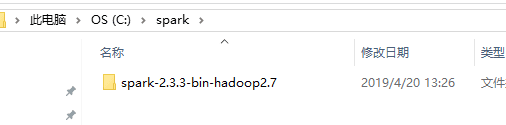

将下载的文件解压到一个目录,注意目录不能有空格,比如说不能解压到C:\Program Files

作者解压到了这里,

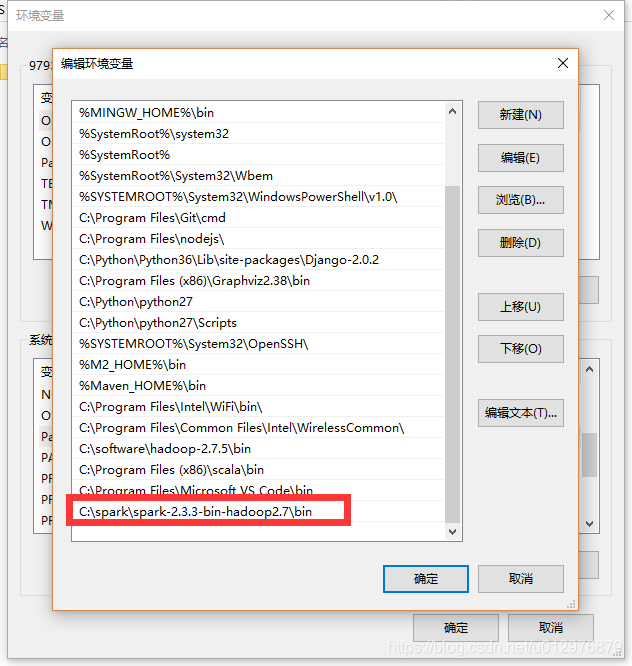

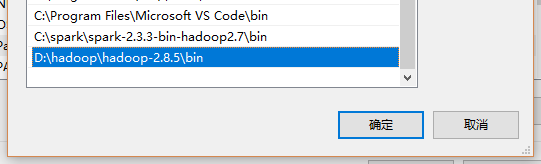

将spark的bin路径添加到path中

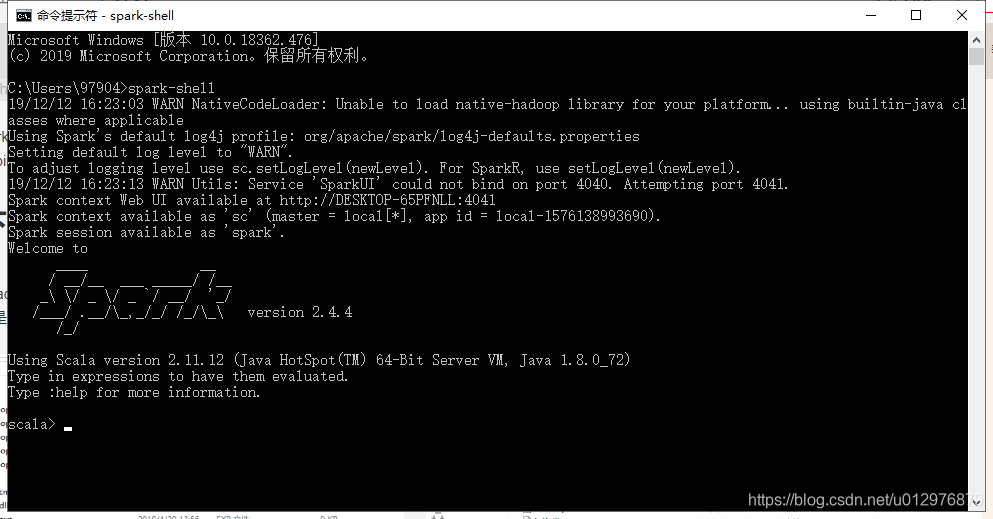

cmd输入spark-shell,成功安装啦,有个报错是因为还没安装Hadoop,

4、安装hadoop

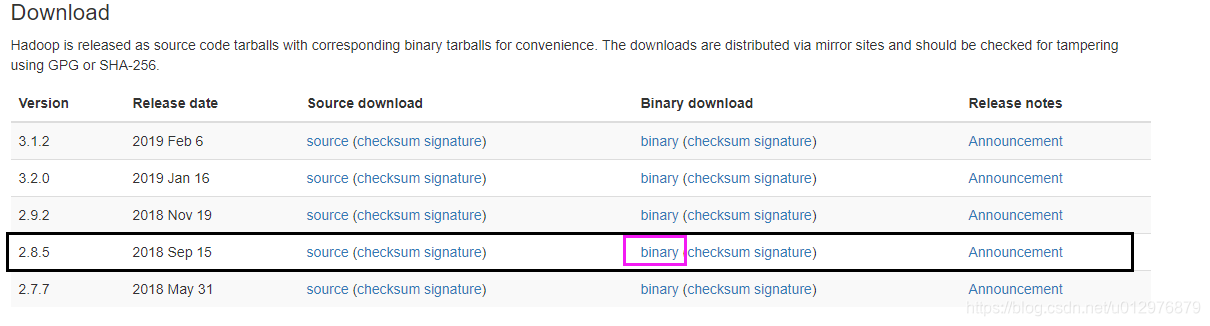

由于spark版本为spark-2.3.3-bin-hadoop2.7,我们选择下2.8.5版本的Hadoop

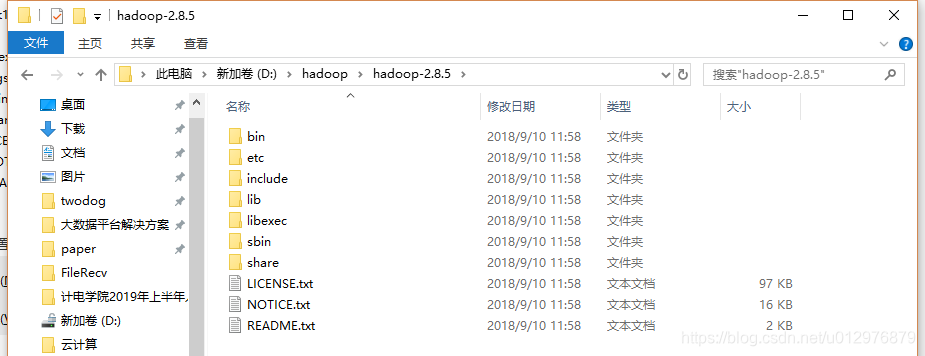

解压

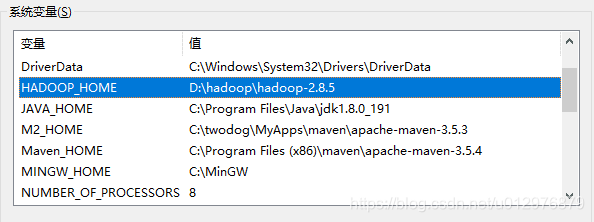

添加环境变量,新建一个HADOOP_HOME(必须要添加HADOOP_HOME不然会报错)

在path添加(必须要添加path不然会报错)

到此运行spark-shell还会有没安装的时候那个报错,接下来需要替代Hadoop里的bin文件来解决这个错。

5、下载winutils

下载地址

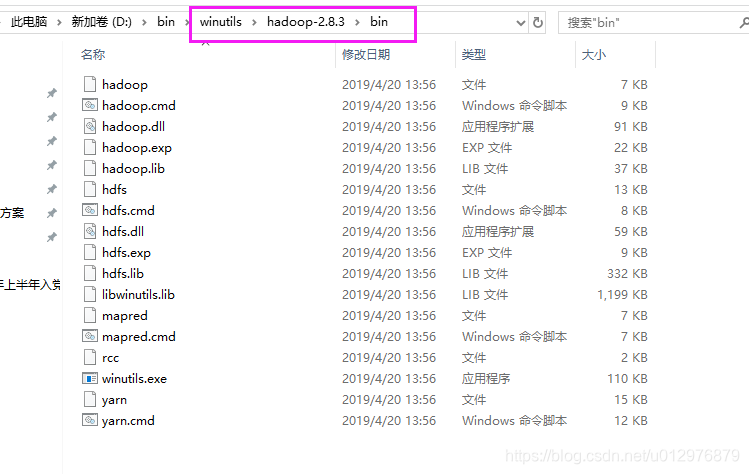

笔者用的是hadoop2.8.5版本的,下载的winutils上hadoop2.8.3版本的bin,实测也是可行的。

接下来将bin替换原来Hadoop中的bin

6、运行spark-shell成功啦

本文详细介绍了在Windows环境下安装Spark的步骤,包括安装JDK、Scala、Spark、Hadoop及解决常见错误的方法。

本文详细介绍了在Windows环境下安装Spark的步骤,包括安装JDK、Scala、Spark、Hadoop及解决常见错误的方法。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?