知乎专栏同步发布: https://zhuanlan.zhihu.com/p/41133862

本来打算自己写写的,但是发现了David Foster的神作,看了就懂了。我也就不说啥了。

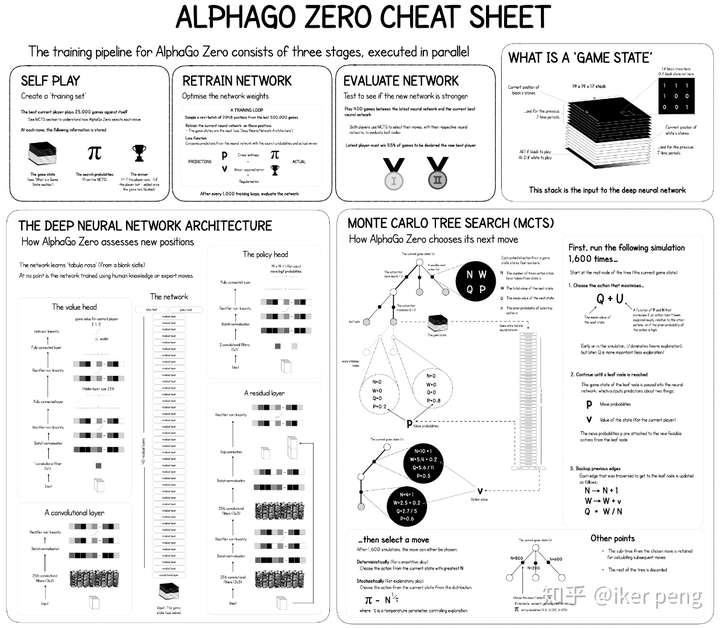

看不清的话,原图在后面的连接也可以找到。

没懂?!!!那我再解释下。

AlphaGo Zero主要由三个部分组成:自我博弈(self-play),训练和评估。和AlphaGo 比较,AlphaZero最大的区别在于,并没有采用专家样本进行训练。通过自己和自己玩的方式产生出训练样本,通过产生的样本进行训练;更新的网络和更新前的网络比赛进行评估。

在开始的时候,整个系统开始依照当前最好的网络参数进行自我博弈,那么假设进行了10000局的比赛,收集自我博弈过程中所得到的数据。这些数据当中包括:每一次的棋局状态以及在此状态下各个动作的概率(由蒙特卡罗搜索树得到);每一局的获胜得分以及所有棋局结束后的累积得分(胜利的+1分,失败得-1分,最后各自累加得分),得到的数据全部会被放到一个大小为500000的数据存储当中;然后随机的从这个数据当中采样2048个样本,1000次迭代更新网络。更新之后对网络进行评估:采用当前被更新的网络和未更新的网络进行比赛400局,根据比赛的胜率来决定是否要接受当前更新的

本文深入解读AlphaZero的运作原理,包括自我博弈、训练和评估过程。AlphaZero不再依赖专家样本,而是通过自我对弈生成训练数据。网络结构包含特征提取、价值网络和策略网络,用于指导蒙特卡罗搜索树决策。详细阐述了蒙特卡罗搜索树的工作方式,以及在训练中如何选择和评估动作。

本文深入解读AlphaZero的运作原理,包括自我博弈、训练和评估过程。AlphaZero不再依赖专家样本,而是通过自我对弈生成训练数据。网络结构包含特征提取、价值网络和策略网络,用于指导蒙特卡罗搜索树决策。详细阐述了蒙特卡罗搜索树的工作方式,以及在训练中如何选择和评估动作。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1210

1210

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?