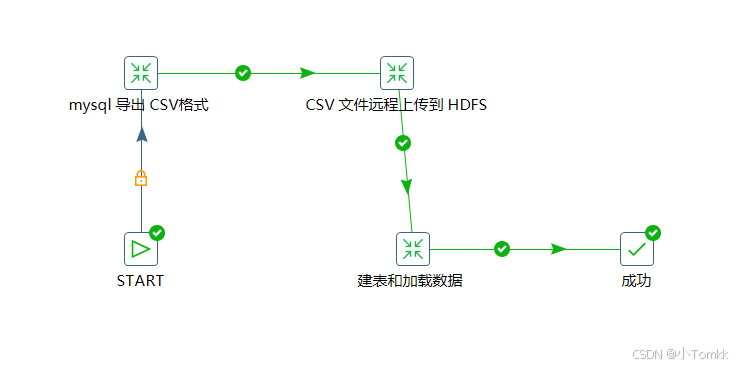

kettle 远程mysql 表导入到 hadoop hive

(教学用 )

文章目录

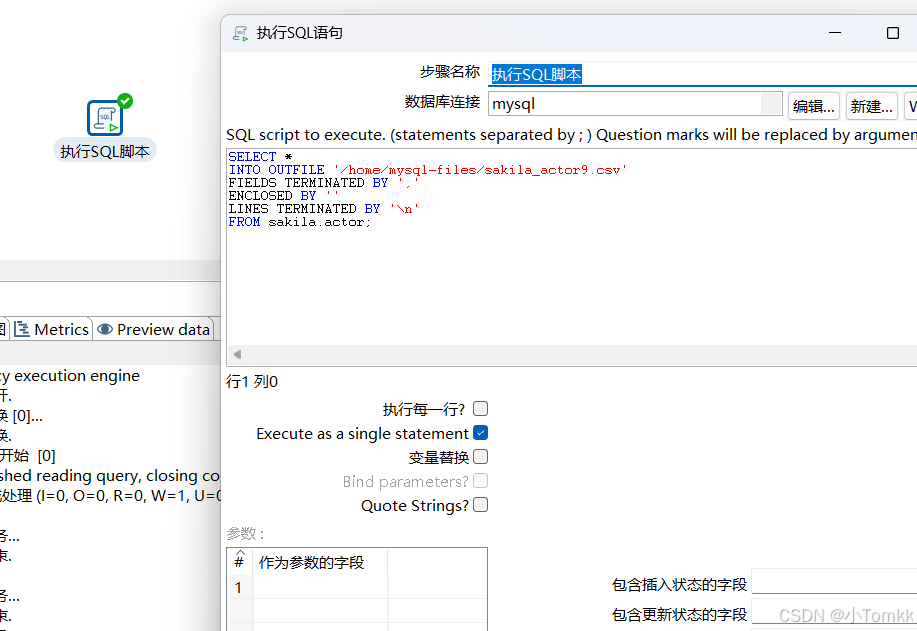

创建 对象 执行 SQL 语句 -mysql 导出 CSV格式

SELECT *

INTO OUTFILE '/home/mysql-files/sakila_actor9.csv'

FIELDS TERMINATED BY ','

ENCLOSED BY ''

LINES TERMINATED BY '\n'

FROM sakila.actor;

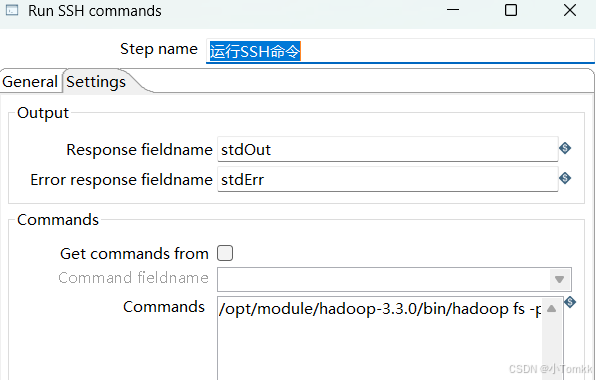

CSV 文件远程上传到 HDFS

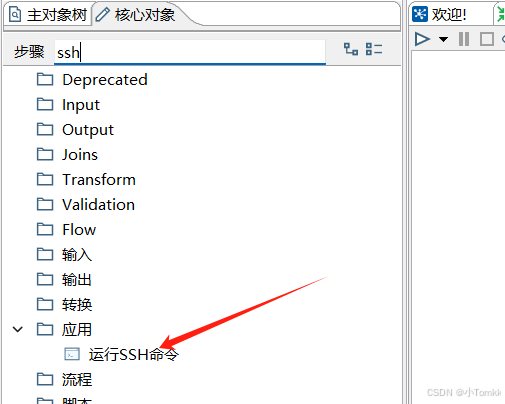

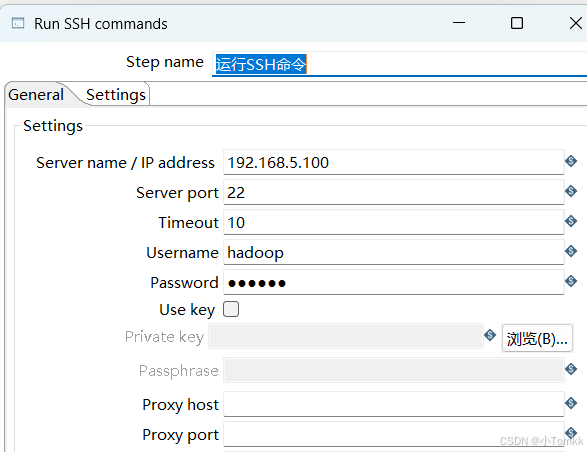

运行 SSH 命令

远程登录 run SSH 并执行 hadoop fs -put

/opt/module/hadoop-3.3.0/bin/hadoop fs -put /home/mysql-files/sakila_actor9.csv /user/hive/warehouse/

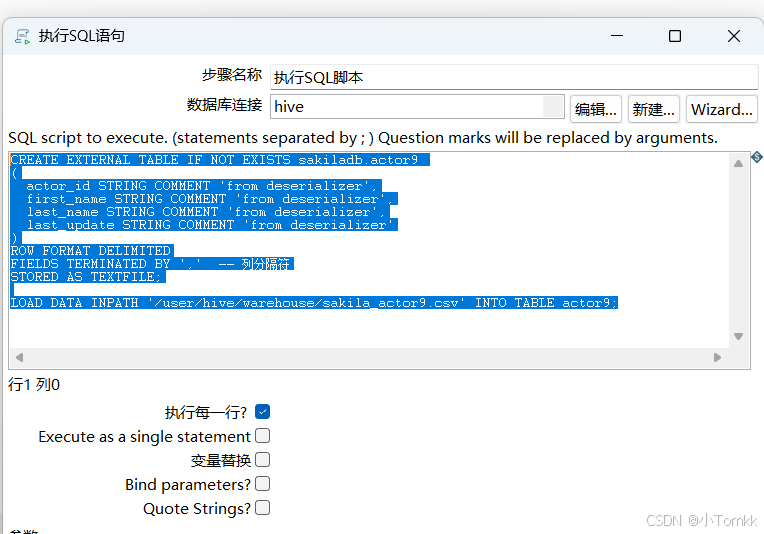

建表和加载数据

CREATE EXTERNAL TABLE IF NOT EXISTS sakiladb.actor9

(

actor_id STRING COMMENT 'from deserializer',

first_name STRING COMMENT 'from deserializer',

last_name STRING COMMENT 'from deserializer',

last_update STRING COMMENT 'from deserializer'

)

ROW FORMAT DELIMITED

FIELDS TERMINATED BY ',' -- 列分隔符

STORED AS TEXTFILE;

LOAD DATA INPATH '/user/hive/warehouse/sakila_actor9.csv' INTO TABLE actor9;

总结

通过 Kettle (Pentaho Data Integration),我们能够轻松地将远程 MySQL 数据库中的数据导出到 CSV 文件,上传到 HDFS,并最终将数据导入 Hive。这样,我们可以利用 Hadoop 的强大计算能力来进行数据处理和分析。以下是整个过程的概览:

导出 MySQL 数据为 CSV 格式:使用 Table Input 和 Text File Output 步骤。

上传 CSV 文件到 HDFS:通过 SSH Connection 执行 hadoop fs -put 命令。

在 Hive 中创建表并加载数据:使用 CREATE TABLE 和 LOAD DATA 命令。

这个过程不仅适用于 MySQL 和 Hive,也可以根据需要适配其他数据源和目标系统。

1544

1544

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?