事先声明:本文是写给自己看的,发在这里是因为掘金图床真的好方便orz(是的之前在掘金上,但是后来掘金的文中代码块标红,好难看!),本系列将按照我自己的逻辑整理,知识点并没有全写上,还可能会出现随心所欲中英文混杂的情况,公式也打算截图,如果你碰巧看到我的想要照着看也不是不行,但网上总结得比我好的太多了,甚至可以去找找看Stanford自己整理的笔记,内容很全,不过是全英文的,而且排版有点反人类

深度学习介绍

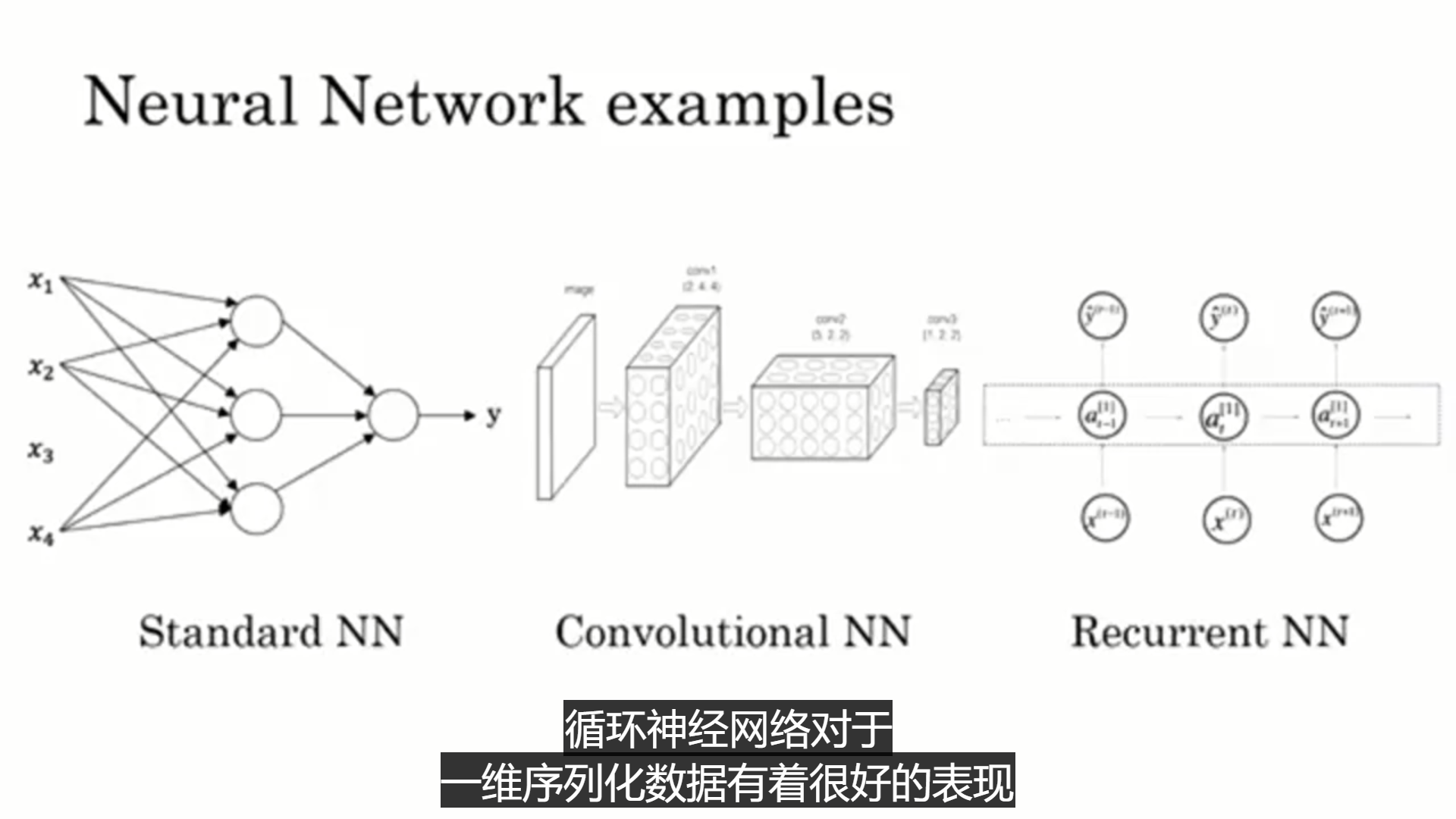

常用模型

- 标准神经网络:构成神经网络的主要部分

- 卷积神经网络:常用于图像应用

- 循环神经网络:常用于一维可序列化的模型,如语音识别(语音输入为随时间变化的序列),自然语言处理(输入为可序列化分析的单词或句子)

监督学习

从给定的训练数据集中学习出一个函数(模型参数),当新的数据到来时,可以根据这个函数预测结果,数据都是带标签的,与无监督学习(Unsepervised Learning),半监督式/强化学习(Reinforcement Learning)相区分

一般根据预测结果分类分作两类

- 回归(Regression):预测结果为连续型的值或无限可列个

- 分类(Classification):预测结果为有限可列个值

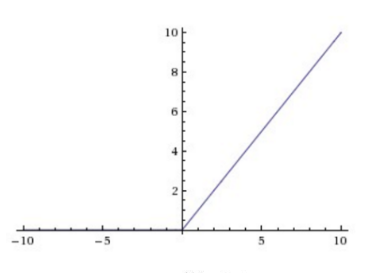

ReLU函数(线性整流函数)

ReLU函数是深度学习中的常用函数,其全称为线性整流函数(Rectified Linear Unite),取值方式为y=max(0,x),图像如下

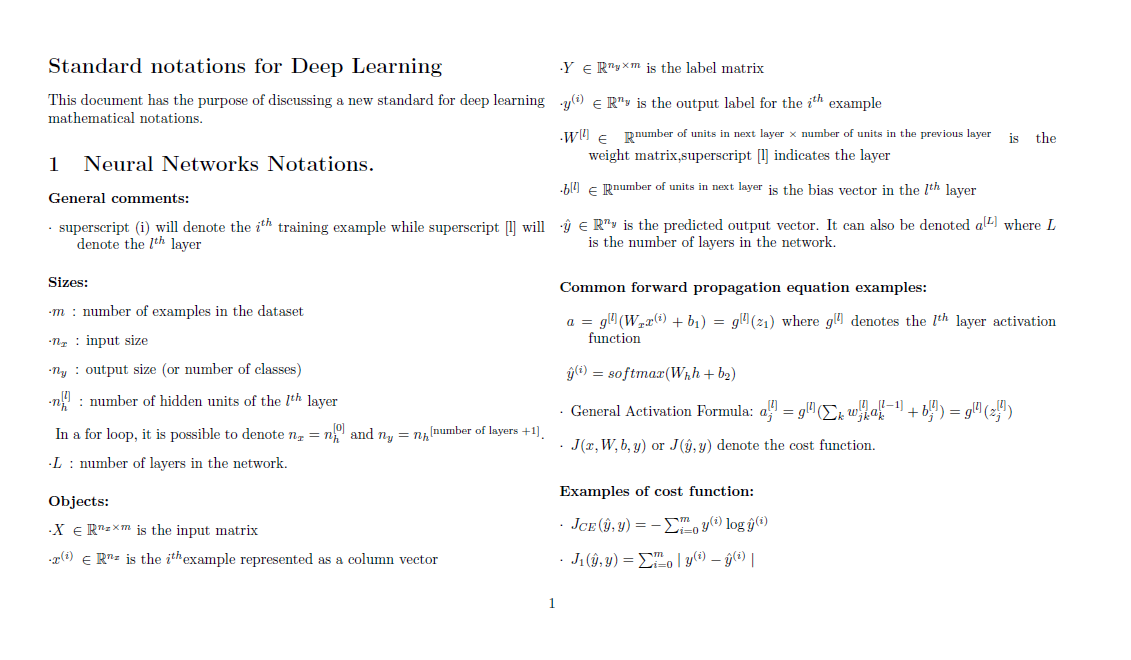

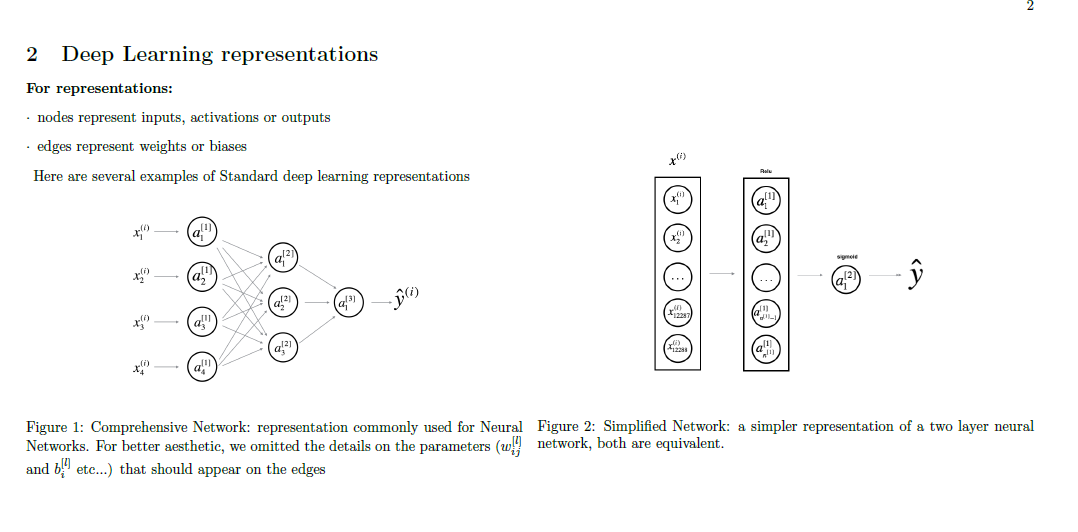

标准符号

逻辑斯蒂回归

以逻辑斯蒂回归为例,介绍了一些深度学习的基础,如梯度下降的方法,求损失函数代价函数的方式,以及它们的意义

用途

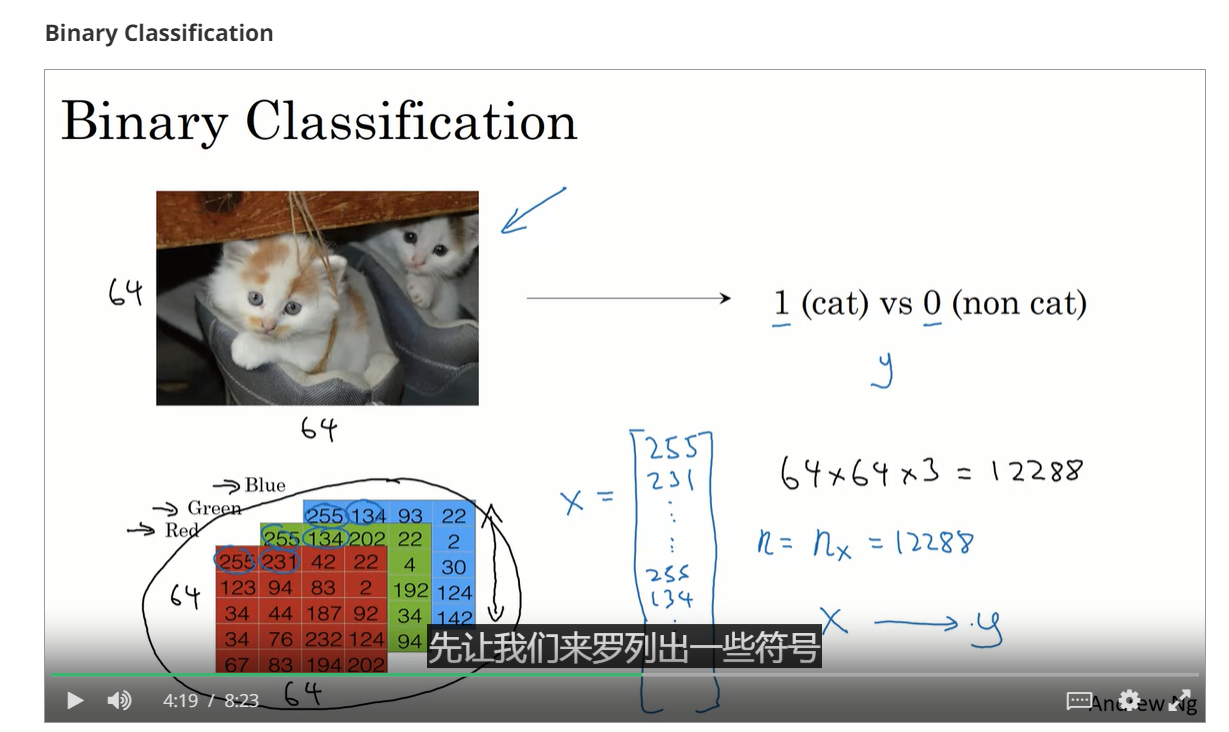

逻辑斯蒂回归(Logistic Regression)一般用于二元分类问题(Binary Classification),

公式

Y ^ = σ ( w T X + b ) \hat{Y}=\sigma (w^TX+b) Y^=σ(wTX+b)

其公式中的各项数据含义如下:

- 输入

X:假设输入为一张64*64的图片,那么依次取出R、G、B矩阵中的所有像素值,我们可以得到一个64*64*3的向量,将其记作x,即为一个输入;将样本集中每个样本的x(i)按列排成(64*64*3)*m的矩阵,记作X - 输出

Yhat:Yhat是一个1*m的矩阵,每个值代表相应的x的输出,其中的hat代表预测值 - 参数

wb:需要利用梯度下降等方法寻找的参数,以使后续的代价函数最小化 σ:sigmoid函数,用以归一化,将括号中的值限定在(0,1)范围内, σ ( z ) = 1 1 + e − z \sigma(z)=\frac{1}{1+e^{-z}} σ(z)=1+e−z1

损失函数与代价函数

- 损失函数:对单个样本的偏差估计值

- 代价函数:总体的样本的偏差量

在逻辑斯蒂回归中,损失函数(Lost function)为

L

(

y

^

,

y

)

=

−

(

y

log

(

y

^

)

+

(

1

−

y

)

log

(

1

−

y

^

)

)

L(\hat{y},y)=-(y\log{(\hat{y})+(1-y)\log(1-\hat y)})

L(y^,y)=−(ylog(y^)+(1−y)log(1−y^))

代价函数(Cost function)为

J

(

w

,

b

)

=

1

m

∑

i

=

1

m

L

(

y

^

(

i

)

,

y

(

i

)

)

J(w,b)=\frac{1}{m}\sum_{i=1}^m L(\hat y^{(i)},y^{(i)})

J(w,b)=m1i=1∑mL(y^(i),y(i))

推导会单独写一篇文章,见逻辑斯蒂回归中损失函数和代价函数的推导

梯度下降

在上一部分,我们得到了关于w和b的代价函数,因此接下来将使用梯度下降(Gradient Descent)尝试找到该凸函数上的整体最优解,分为以下两步:

- 初始化

w和b,一般将其置为0 - 沿梯度绝对值减小方向更新

w和b,

公式为

w

:

=

w

−

α

∂

J

(

w

,

b

)

∂

w

w := w-\alpha \frac{\partial J(w,b)}{\partial w}

w:=w−α∂w∂J(w,b)

b

:

=

b

−

α

∂

J

(

w

,

b

)

∂

b

b := b-\alpha \frac{\partial J(w,b)}{\partial b}

b:=b−α∂b∂J(w,b)

在这里应注意两点

- 对于有

m个样本的样本集,整体的w和b其实都是一样的(这里还不太懂) - 式子中的

α为学习率,代表了我们更新梯度的速率(learning rate),可以粗略理解为步长

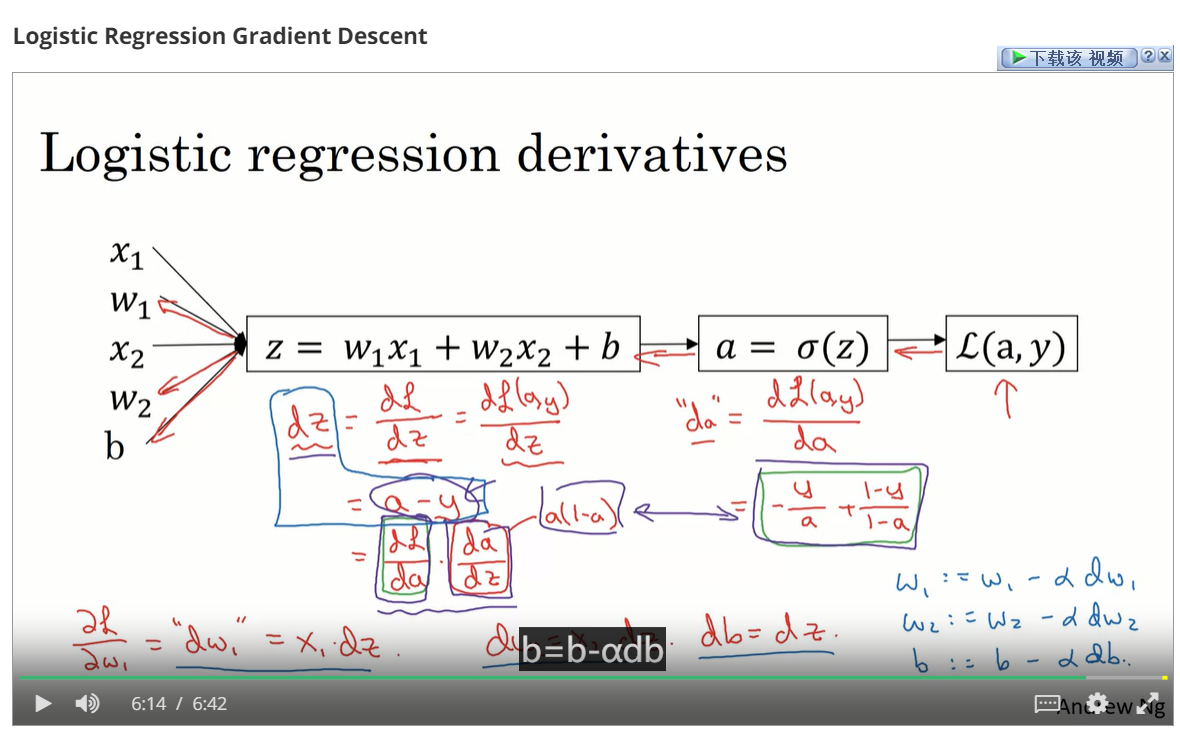

正向传播与反向传播

- 正向传播:在计算图上自左向右计算

- 反向传播:在计算图上自右向左计算

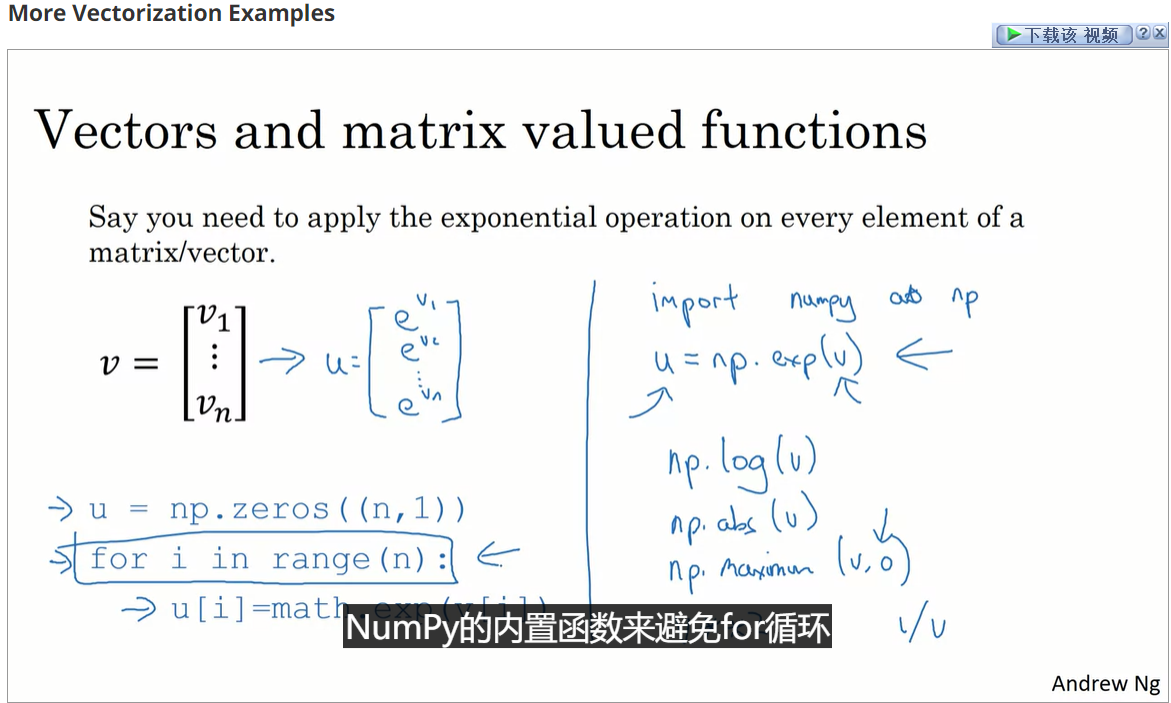

向量化计算

向量化(Vectorizing)的目的是通过内置的函数或是numpy函数来提高模型处理大量数据集的速度,进而提高整个模型的效率,避免使用for循环

方式

利用numpy所自带的函数来减少for循环的使用次数

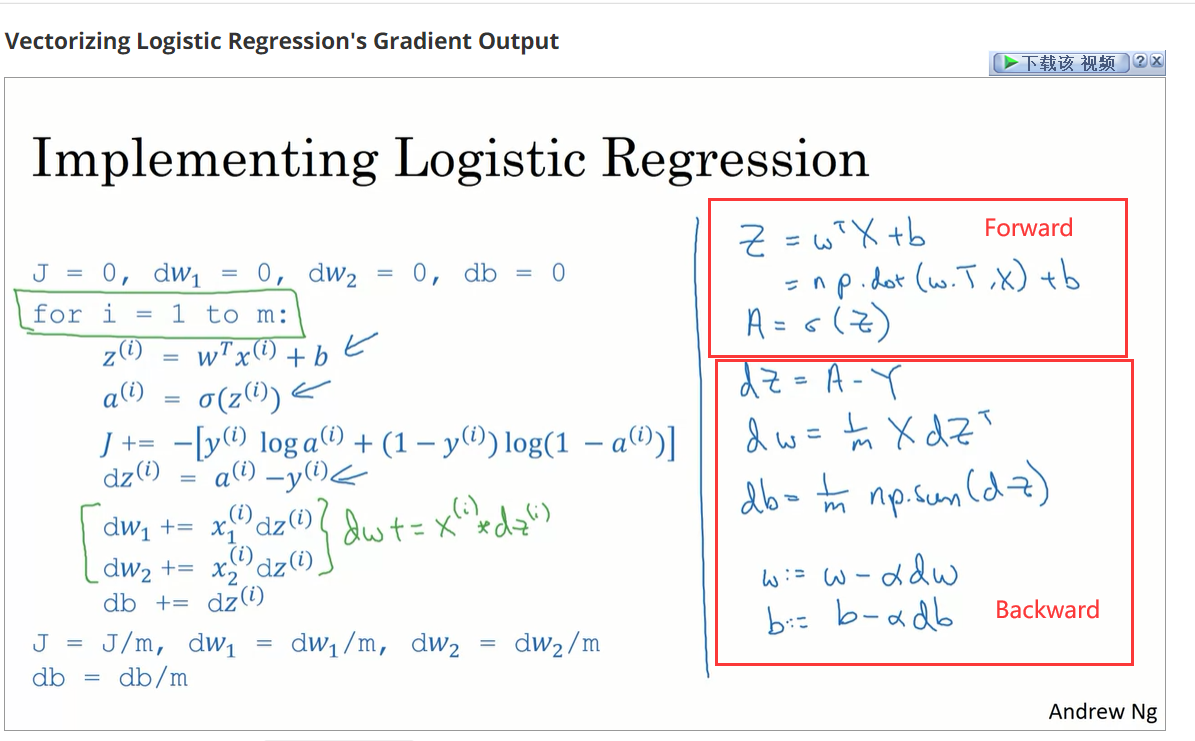

逻辑斯蒂回归中的向量化

Z = np.dot(w.T,X) + b

在式子当中,X是一个n_x * m维的矩阵,w.T代表w的转置,dot即为点乘

Python中的广播机制与NumPy

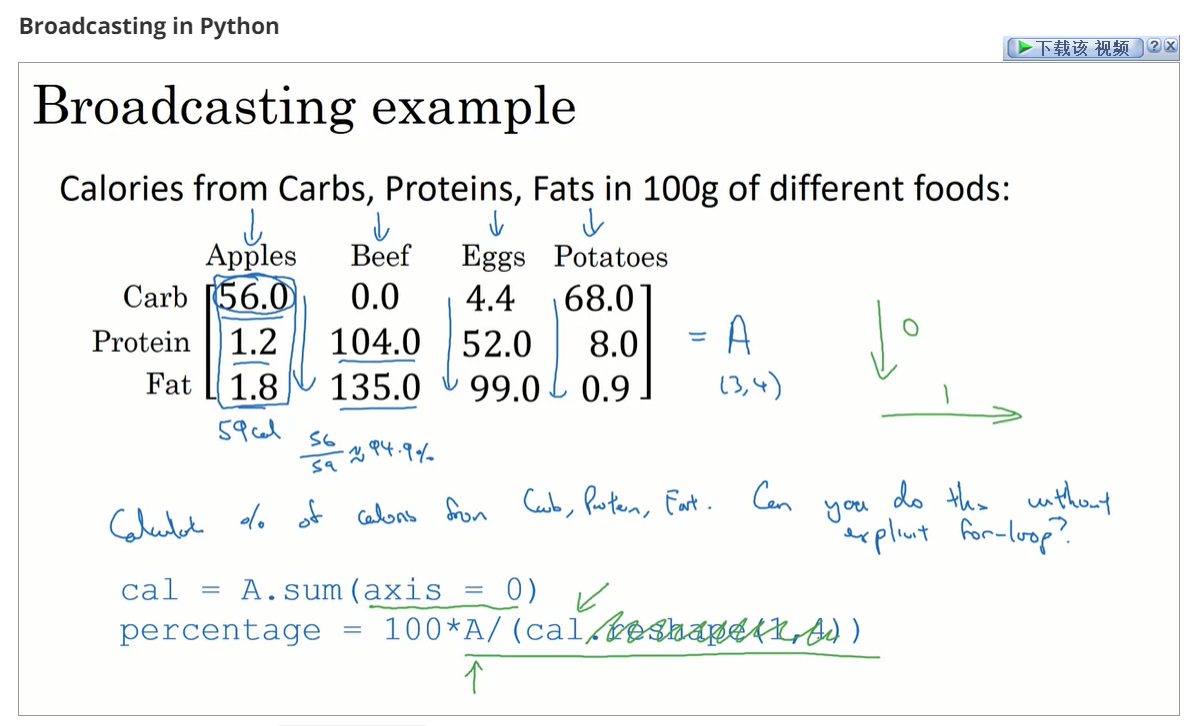

例程

cal = A.sum(axis = 0)axis为sum()的参数,其中0或1分别代表将每列从上到下相加或将每行从左至右相加,不共用内存

percentage = 100*A/(cal.reshape(1,4))reshape()将cal矩阵重塑为1*4的矩阵,其中重塑后的矩阵与原矩阵元素个数相同,仅改变形状,且与原矩阵共用内存- 在进行

/运算时,广播机制将自动将cal扩展(可以简单理解成向上复制了几行),在此例中每一列除的除数都是一样的

注意

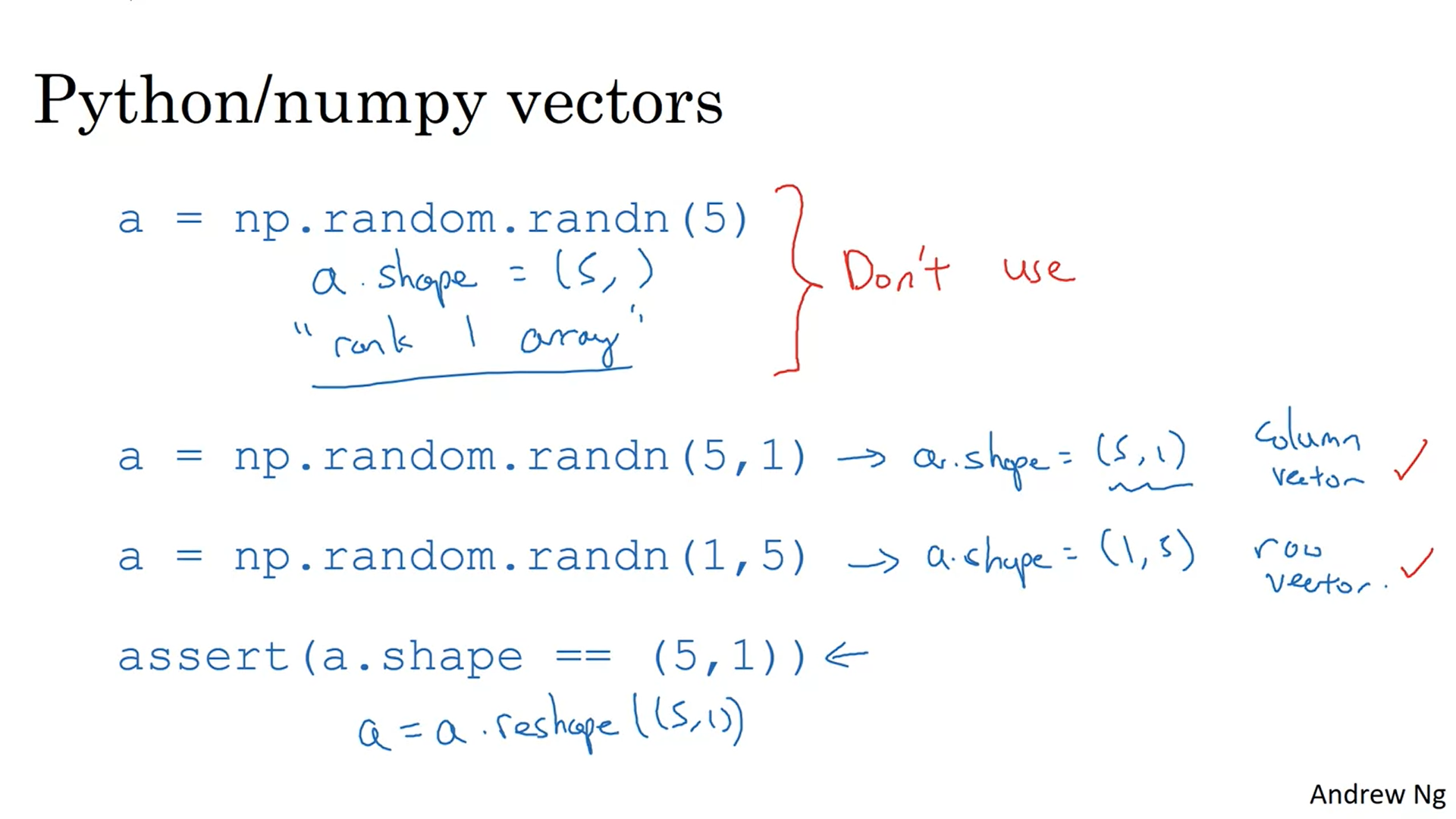

- (×) 不要使用形如

a.shape = (5,)的秩(rank)为1的向量,因为其在计算和转置过程中会出现奇怪的bug - (√) 在产生向量时,完整写出想要的尺寸

- (√) 加入断言或是采用

reshape()保证矩阵的尺寸

易混点

数组维度的含义

数组的维度指的是数组的深度(需要几个量来确定某个元素的位置),与秩(rank)区分开

损失函数与代价函数

Q: What is the difference between the cost function and the loss function for logistic regression?

A: The loss function computes the error for a single training example; the cost function is the average of the loss functions of the entire training set.

本文介绍了深度学习的基本概念,包括常用模型如标准神经网络、卷积神经网络和循环神经网络,以及监督学习、无监督学习和强化学习的区别。深入探讨了逻辑斯蒂回归,包括其公式、损失函数和代价函数的推导,以及梯度下降法的应用。

本文介绍了深度学习的基本概念,包括常用模型如标准神经网络、卷积神经网络和循环神经网络,以及监督学习、无监督学习和强化学习的区别。深入探讨了逻辑斯蒂回归,包括其公式、损失函数和代价函数的推导,以及梯度下降法的应用。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?