实现手写体识别的原理和代码实现

1.原理简单介绍

本次实现的手写体识别,是通过卷积神经网络来实现的。

卷积神经网络的主要结构可以分成

卷积层

池化层

全连接层

卷积层: 使用卷积层,可以保持图像数据的形状不变,输入图像数据时,卷积层会以三维数据的形式接收输入数据,并且同样以三维数据输出至下一层。卷积层的作用类似图像处理之中的滤波处理

池化层: 池化层有三个特点:

- 池化层和卷积层不同,没用要学习的参数,只是从目标区域中取最大值(平均值)

- 池化层中数据数据和输出数据的通道数不会发生变化,计算是按通道独立进行的

- 池化层对微小的位置变化具有鲁棒性

全连接层: 是网络最后在通过多次的卷积,池化操作之后,对提取出来的特征通过全连接层来实现分类输出。

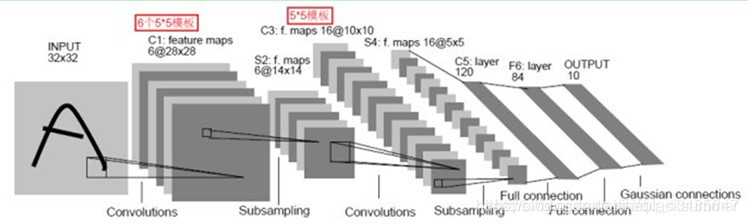

下图是一张卷积神经网络的结构原理图:

首先输入的图像是3232 的图像,通过第一层卷积层,提到了2828的图像,将这张图像经过第一层池化层得到1414的图像,我们把卷积,池化层的组合叫做卷积组,通过两个卷积组,得到55的图像特征,放到后面的全连接层中,进行分类,得到其不同的类别。

代码:

import os

os.environ[“CUDA_VISIBLE_DEVICES”] = “-1”

import tensorflow as tf

#import numpy as np # 习惯加上这句,但这边没有用到

from tensorflow.examples.tutorials.mnist import input_data

#import matplotlib.pyplot as plt

mnist = input_data.read_data_sets(‘MNIST_data/’, one_hot=True)

sess = tf.InteractiveSession()

#1、权重初始化,偏置初始化

#为了创建这个模型,我们需要创建大量的权重和偏置项

#为了不在建立模型的时候反复操作,定义两个函数用于初始化

def weight_variable(shape):

initial = tf.truncated_normal(shape,stddev=0.1)#正太分布的标准差设为0.1

return tf.Variable(initial)

def bias_variable(shape):

initial = tf.constant(0.1,shape=shape)

return tf.Variable(initial)

#2、卷积层和池化层也是接下来要重复使用的,因此也为它们定义创建函数

#tf.nn.conv2d是Tensorflow中的二维卷积函数,参数x是输入,w是卷积的参数

#strides代表卷积模块移动的步长,都是1代表会不遗漏地划

本文通过Tensorflow利用卷积神经网络(CNN)实现Mnist手写体识别。介绍了CNN的基本结构,包括卷积层、池化层和全连接层,并展示了详细的代码实现过程,包括权重和偏置初始化、卷积和池化函数的定义。在训练过程中应用了dropout防止过拟合,并在测试集上评估了模型的准确性。

本文通过Tensorflow利用卷积神经网络(CNN)实现Mnist手写体识别。介绍了CNN的基本结构,包括卷积层、池化层和全连接层,并展示了详细的代码实现过程,包括权重和偏置初始化、卷积和池化函数的定义。在训练过程中应用了dropout防止过拟合,并在测试集上评估了模型的准确性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1707

1707

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?