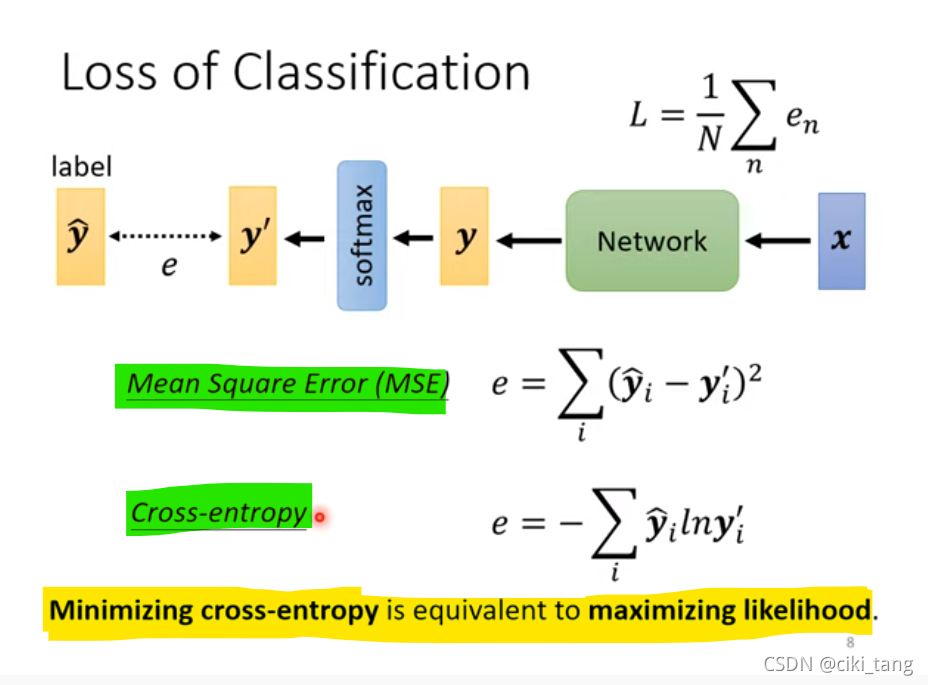

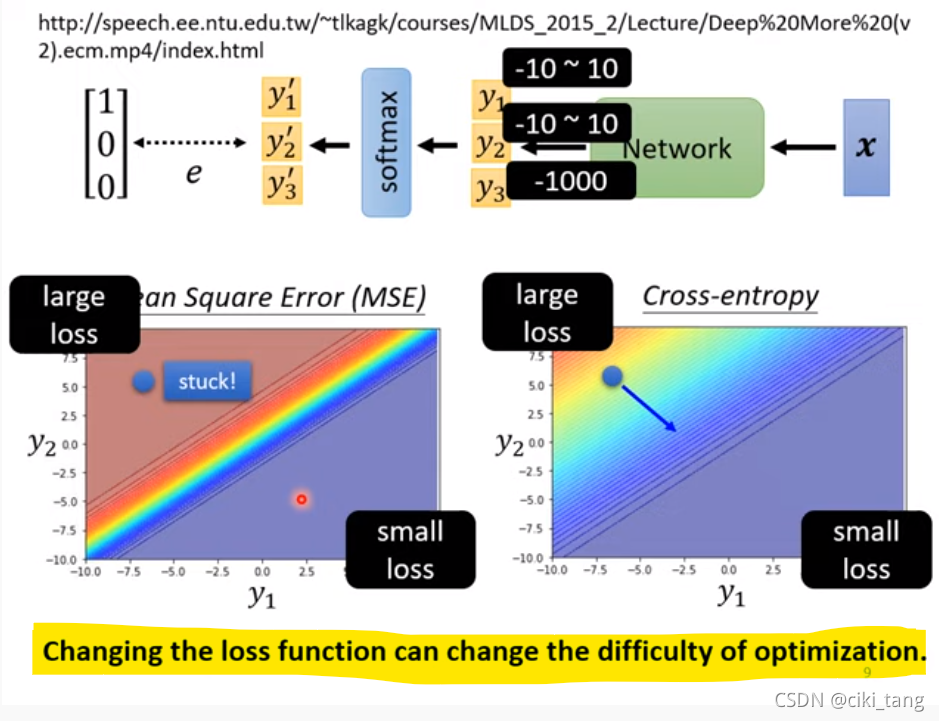

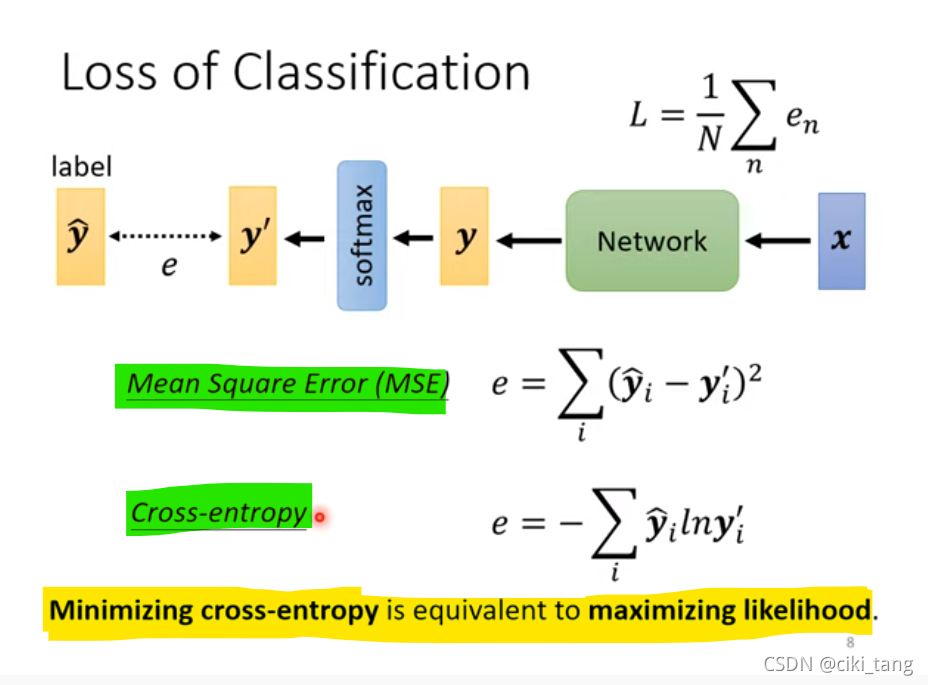

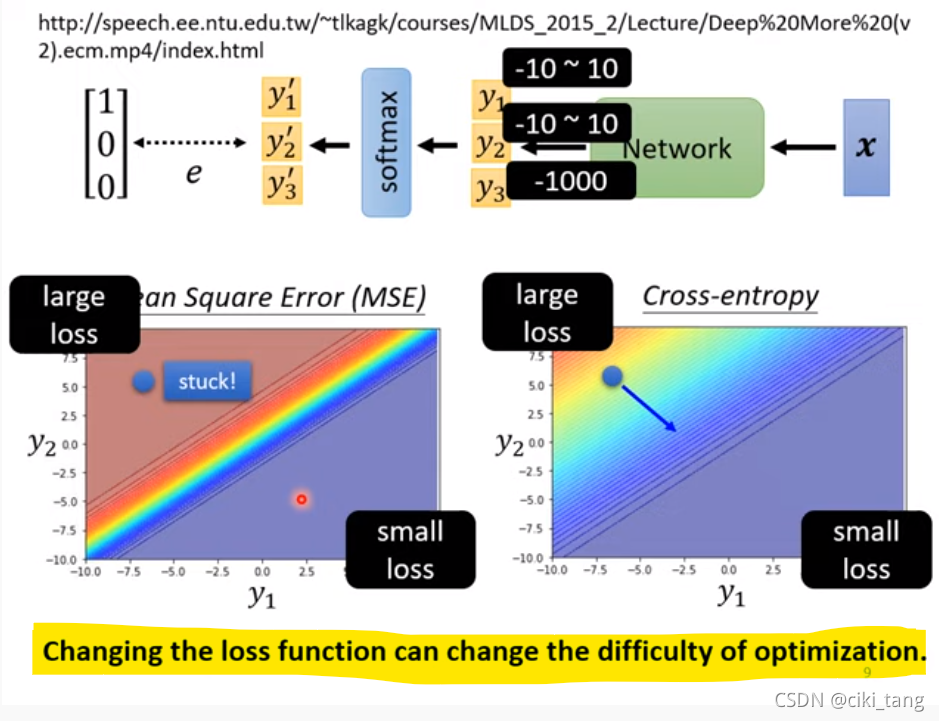

cross entropy 更好用到 classification上, pytorch 中, cross entropy 绑定 softmax,已经放到 cross entropy 里面

cross entropy 更好用到 classification上, pytorch 中, cross entropy 绑定 softmax,已经放到 cross entropy 里面

1113

1113

82

82

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?