关于分类和回归的区别就是一个是离散一个是连续。

另外逻辑回归(可以看出来就是为了分类)和线性回归的区别:softmax函数的目的就是输出0~1之间的预测(比如输出使用了 ),

),

就是所谓的做逻辑回归,其loss是交叉熵(可以说专门用于逻辑回归)的变种(信息熵还是什么的,就是忽略错误的估计项,自己去复习)。线性回归是没有范围的,如y=wx+b是输出任意值,所以其损失函数也一般是用最小二分法,用于做线性回归预测(比如boundingbox的坐标等预测)。

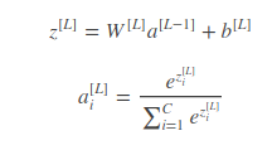

softmax思想如下

采用 Logistic Regression进行多分类的思路是:选取某个分类作为正样本,其他分类作为负样本建立一个二分类模型;以此类推建立多个(有几个分类就建几个)二分类模型;对多个二分类模型的输出值进行大小比较,把样例归为输出值最大的那类

本文深入解析了分类与回归两种机器学习任务的区别,重点阐述了逻辑回归与线性回归的工作原理及应用场合,同时介绍了softmax函数在多分类问题中的运用。

本文深入解析了分类与回归两种机器学习任务的区别,重点阐述了逻辑回归与线性回归的工作原理及应用场合,同时介绍了softmax函数在多分类问题中的运用。

757

757

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?