TRANSACTIONS ON IMAGE PROCESSING2021: Affinity Space Adaptation for Semantic Segmentation Across Domains跨域语义分割的关联性空间适应

0.摘要

基于深度学习的密集像素标注语义分割算法取得了良好的性能。然而,语义分割在野外的推广仍然具有挑战性。本文研究了语义分割中的无监督域自适应问题。由于源领域和目标领域具有不变的语义结构,我们建议利用这种跨领域的不变性,利用结构化语义分割输出中成对像素之间的并发模式。这与大多数现有的方法不同,后者试图根据图像、特征或输出级别中的单个像素级信息来适应域。具体地说,我们对相邻像素之间的关联关系(称为源域和目标域的关联空间)进行域适应。为此,我们制定了两种关联空间适应策略:关联空间清理策略和对抗性关联空间对齐策略。大量的实验表明,所提出的方法在跨域语义分割的几个具有挑战性的基准上比一些最先进的方法具有更好的性能。

1.概述

在一个特定的领域不能很好地概括在一个新的领域。这是因为源训练图像和目标测试图像之间存在域转移。为了克服这个问题,人们通常求助于大量像素级标记的目标数据,这既昂贵又乏味。因此,语义分割在实际应用中仍然具有挑战性。

为了解决上述问题,近年来研究了非监督域适应(UDA)方法,该方法只提供源域的标注,而不提供目标域的标注。这种UDA问题已被广泛用于图像分类,其中大多数之前的工作试图匹配源和目标分布,通过对抗学习[9]学习领域不变特征。同样,在语义分割领域,最近的方法试图通过最小化图像样式[10]、中间特征[11]-[13]或网络输出空间[14]的分布之间的差异来弥合域间隙。现有的方法表明,图像、特征和输出级别的对齐在跨域语义分割中起着重要作用。

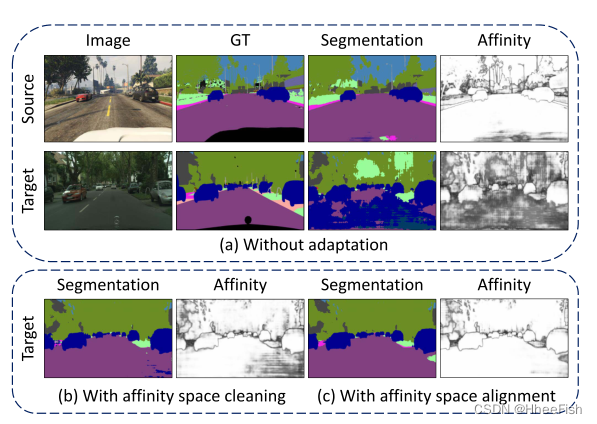

考虑到语义分割是一个结构化的预测问题,具有跨领域的鲁棒性,可以假设结构化知识有利于跨领域的语义切分。相邻像素输出之间的关联关系包含了丰富的空间结构和局部上下文信息,揭示了结构知识。因此,我们引入了关联性空间的概念,该空间建立在每个像素的预测输出与其所有相邻像素之间的关联性关系之上。我们的目标是在这个概念的基础上,对语义分割进行域适应。具体来说,我们探索了这一概念在两个方案中不同视角下的两种实施,以实现这种关联力空间适应。首先,我们设计了一种关联力损失,在源图像和目标图像的关联力空间中都强制高关联力,并在源区域上分割损失。因为一幅图像(包括源域和目标域)是由一些连续的语义区域组成的先验。属于同一语义的相邻像素在两个不同语义区域的相邻像素中占主导地位。因此,这种设计的关联力损失就相当于关联力空间的清洗,将关联力空间规整,使得目标域几乎处处都接近于源域的高值关联力空间。事实上,如图1(a)所示,如果没有适应性,目标域的关联力空间就不是很干净,因为存在许多低关联力。提出的关联空间清理(见图1(b))将为源和目标域产生干净且相似的关联映射。其次,我们还研究了对抗性训练,以直接对齐目标域和源域的关联空间分布。如图1©所示,对抗性关联空间适应也能有效地对齐关联空间。

综上所述,本文的主要贡献包括三个方面:1)我们引入了关联力空间的概念,通过利用相邻像素之间的共现输出模式来强调结构,从而在语义分割中进行域适应;2)提出了关联空间适应性的两种有效方案:关联空间损失清洗和关联空间对抗性对齐;3)在多个具有挑战性的跨域语义分割基准上,提出的关联性空间适应方法比一些最新的方法取得了更好的性能。

本文的其余部分组织如下。我们在第二节简要回顾了一些相关的工作,然后在第三节提出了方法。第四节给出了广泛的实验结果。最后,第五部分对全文进行了总结并提出了一些看法。

2.相关工作

图1所示。提出了由跨域输出结构相似驱动的亲和空间适应性。我们建议匹配亲和空间,揭示源和目标域之间的输出结构。(a)为源领域和目标领域不需要自适应的分割结果。(b)和©分别为提出的亲和性空间适应的亲和性空间清理(ASC)和亲和性空间对齐(ASA)策略的分割结果。对于亲和可视化,我们展示了每个像素的预测与其所有相邻像素之间的平均余弦相似度。

我们首先回顾了第II-A节中一些关于语义切分的代表性著作,然后是第II-B节中一些利用成对关联的相关著作。然后,我们简要回顾了一些最近的领域适应方法跨领域的语义分割在第II-C节。第II-D节给出了所提方法与一些相关工作的比较。

2.1.语义分割

语义分割是计算机视觉的一项基本任务。目标是为图像的每个像素分配一个类别标签。自FCN[1]和U-Net[15]以来,在深度神经网络的驱动下,语义分割取得了很大的进展。.

许多方法被提出,以提高分割性能。例如,Deeplab[4],[16]表明通过扩大卷积扩大感受野可以显著提高性能。通过atrous空间金字塔池(ASPP)[4]、[16]、金字塔空间池(PSP)[3]或上下文编码[5]利用上下文信息也可以提高分割精度。其他一些方法[2]、[7]、[17]试图结合成对关系来提供结构化推理,有助于缓解语义分割中的不一致性问题。最近,DANet[18]和OCNet[19]提出利用自我注意机制来捕获远程依赖,从而获得优异的性能。

这些完全监督的方法依赖于大量像素级注释数据。然而,[20]声称,专家在每幅图像的像素级注释上花费了90分钟。提出了一些弱监督方法来利用容易获得的注释,如图像级标签[21]、[22]、绑定框[23]、[24]或涂鸦[25],以规避像素级注释的昂贵成本。解决注释问题的另一个方向是利用合成数据集,例如GTA5[20]和SYNTHIA[26]。虽然带注释的合成数据很容易收集,但在实际场景中应用时,由于合成数据和真实数据之间的域转移,在合成数据上训练的模型性能急剧下降。

2.2.成对的关联性

成对像素关联在计算机视觉任务中有着悠久的应用历史。在早期的视觉[27]中,局部关联力被用来表征内在的几何结构。在[28]和[29]中,两两关联作为聚类线索参与了分割。近年来,成对像素关联与卷积神经网络(CNN)相结合,为语义或实例分割提供结构推理。示例为[2],[4],[7],[17],[30]。在[2]和[4]中,作者通过条件随机场(CRF)利用了成对关联性。为了提高分割精度,在[7]中提出了一种基于关联度的自适应丢失算法。在[17]中,作者提出了学习关联力的空间传播网络,以提高语义切分。在[30]中,作者显式地回归了成对的关联,用于分离具有相同语义的实例,以便进行实例分割

2.3.领域自适应

域适应旨在解决源域和目标域之间的域转移问题。为了跨域图像分类,开发了多种方法[31]-[38]。其主要思想是通过对抗性学习来最小化域间分布的差异。

与分类上的适应相似,大多数现代的语义分割适应模型也依赖对抗性学习来适应中间特征级别[11]、[39]-[41]或输出级别[14]、[42]、[43]的域。首先在[11]中通过对抗网络对源和目标域的全局特征进行比对,解决UDA语义分割问题。最近,在[41]中引入了一个意义感知的信息瓶颈来对潜在特征空间中的域进行对齐。[14]、[42]-[44]表明,在输出级比对域可能比在特征级比对域更好地进行跨域语义分割。在[14]中,作者首先提出在结构化输出上显式对齐域,然后通过引入新的损失函数[42]、[43]或额外的补丁级输出空间对齐[44]来改进或扩展结构化输出域。

除了平等对待每个语义类别的分布(即特征级或输出级)对齐策略外,一些[44]-[46]方法倾向于提高某些特定类别或区域的性能。在[45]中,Luo等人提出了一个类别级对抗网络,它自适应地为类别级适应的对抗损失加权。SSF-DAN[46]利用伪标签获取每个类的语义特征,进行分离适配,从而在不太频繁的类上提高性能。在[44]中,Tsai等人考虑了多模式的逐patch输出分布,并在[14]上附加了一个patch对齐模块,进一步提高了适应性能。这些最新的方法表明,类或区域条件适应有利于基于分布对齐的跨域语义分割。

在[10],[44],[47]-[50]中,像图像平移和自训练这样的技术已经被证明是有用的,或者是对基于分布对齐的领域适应方法的补充。在[10]中,作者利用CycleGAN[51]生成额外的目标数据,并在特征层上进行对抗性适应。DCAN[47]同时进行图像级和特征级适配。DISE[49]将图像分解为领域不变结构和领域特定纹理,以便更好地进行图像平移和标签转移。在CBST[48]中,作者提出了一个新的类平衡自训练框架,该框架考虑了类分布的不平衡和空间先验。最近,BDL[50]提出了一种双向学习框架,使图像翻译模型、分割适应模型和自训练模型交替学习,进一步提高了性能。

还有一些方法通过有效利用源数据[52],设计损失函数[43],[53],课程模型适应[54],[55],或自集成策略[56],[57]来寻求减少域间隙

2.4.和相关工作的比较

现有的无监督域自适应方法主要是基于图像中单个像素级信息、中间特征或输出水平进行域对齐。尽管这些方法在跨领域中取得了显著的性能,但结构和上下文表示并没有得到明确的利用。我们建议在结构化语义分割的输出级别中,通过利用成对像素之间的共发生模式来突出结构。该方法对输出预测中相邻像素间的关联关系给出的关联空间进行域自适应。我们采用两种关联空间适应策略:关联空间清理策略和对抗性关联空间对齐策略。虽然我们提出的方法是受一些完全监督分割方法中涉及的成对关联性的重要性的驱动,但我们以不同的方式利用成对关联性,通过构建一个关联性空间并对其进行域适应。这首次证明了关联关系有利于UDA在语义分割中的应用。

3.方法

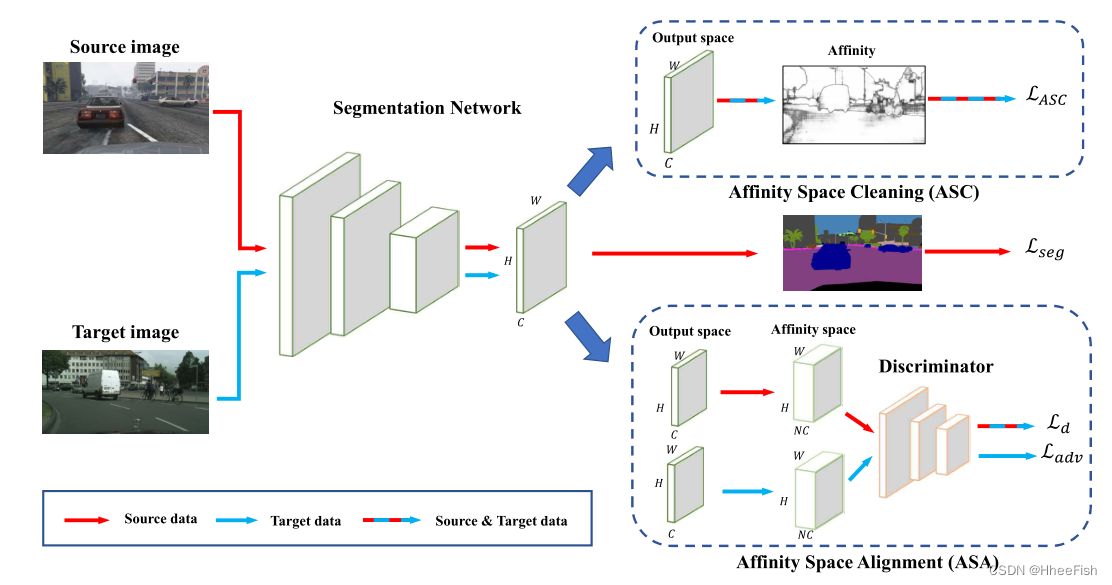

图2所示。所提方法的概述。对于具有亲和空间清洗的亲和空间适应,在源域和目标域都施加了基于亲和的损失LASC。在对抗性亲和空间对齐策略中,我们利用对抗性训练使跨域的亲和空间看起来相似。红色箭头用于源域,蓝色箭头用于目标域,混合箭头表示两个域。对于这两种亲和空间适应方案,分割损失Lseg也计算在分割预测之间,并提供源图像的注释。

3.1.概述

给定源数据XS⊂RH×W×3带有密集像素级注释的YS⊂(1,…, C)H×W和目标数据XT⊂RH×W×3没有注释。语义分割中的无监督域适应(UDA)旨在训练一个对目标数据XT性能良好的模型,其中h和w分别是图像的高度和宽度,C是类的数量。考虑到语义分割是一个结构化的预测问题,我们利用成对的共现模式,揭示了输出结构在不同域之间是不变的。具体来说,我们引入了关联力空间的概念,它建立在输出空间中相邻像素之间的关联力基础上。我们使用UDA对关联空间进行语义分割,而不是对单个像素的信息(来自图像、特征或输出水平)进行语义分割。为此,我们提出了两种基于关联空间概念的适应方案,关联空间描述相邻像素之间的相似性,并根据提出的方案有不同的实现。第一种策略通过关联性空间清理损失隐性规格化关联性空间(见3.2节)。第二个是一个对抗性框架,它显式地对齐跨域的关联分布(见3.3节)。关联空间适应框架的流程如图2所示。用于跨域进行语义分割的网络体系结构见第3.4节。

3.2.关联空间清理

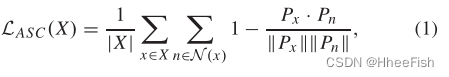

语义分割可以看作是一个结构化的预测问题。即使目标图像没有地面真实值,我们仍然可以对输出结构施加一些限制。事实上,根据对输出空间中相邻像素之间关联力的观察(见图1),我们注意到关联力是不干净的,即在没有自适应的大部分目标图像上关联性都很低。对于期望的语义分割,仅在相邻语义区域的边缘关联性较低,从而得到清晰的关联性图。因此,我们提出在源图像和目标图像上都存在关联力空间的清理损失,以迫使网络产生干净的输出空间的关联力映射。对于图像X,建议的关联空间清理(ASC)损失公式如下:

其中N(x)是像素x的4个或8个空间相邻邻居的集合,|·|表示基数(即集合中包含的元素的“个数”),P表示Softmax输出预测,||·||是向量的大小。最大限度地减少这种关联空间清理损失鼓励高关联性无处不在。虽然在边界像素上的ASC并不完全有意义,但在大多数情况下,在期望的分割中,位于同一语义区域的成对相邻像素优于来自两个不同语义区域的相邻像素。采用这种方法进行结构推理是合理的,使目标域的关联空间规整到接近源域的关联空间。对于目标图像Xt,最小化这种关联清理损失。对于带有ground truth注释y的源图像Xs,我们可以优化以下交叉熵损失用于分割:

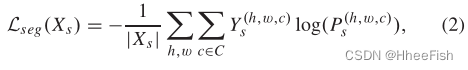

其中Ys是ground-truth注解的独热表示。该关联空间适应方案最终要最小化的

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1599

1599

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?