温馨提示:文末有 优快云 平台官方提供的学长联系方式的名片!

温馨提示:文末有 优快云 平台官方提供的学长联系方式的名片!

温馨提示:文末有 优快云 平台官方提供的学长联系方式的名片!

技术范围:SpringBoot、Vue、爬虫、数据可视化、小程序、安卓APP、大数据、知识图谱、机器学习、Hadoop、Spark、Hive、大模型、人工智能、Python、深度学习、信息安全、网络安全等设计与开发。

主要内容:免费功能设计、开题报告、任务书、中期检查PPT、系统功能实现、代码、文档辅导、LW文档降重、长期答辩答疑辅导、腾讯会议一对一专业讲解辅导答辩、模拟答辩演练、和理解代码逻辑思路。

🍅文末获取源码联系🍅

🍅文末获取源码联系🍅

🍅文末获取源码联系🍅

感兴趣的可以先收藏起来,还有大家在毕设选题,项目以及LW文档编写等相关问题都可以给我留言咨询,希望帮助更多的人

信息安全/网络安全 大模型、大数据、深度学习领域中科院硕士在读,所有源码均一手开发!

感兴趣的可以先收藏起来,还有大家在毕设选题,项目以及论文编写等相关问题都可以给我留言咨询,希望帮助更多的人

介绍资料

以下是一篇关于《Django+LLM大模型旅游评论情感分析:NLP情感分析技术实践》的学术论文框架与内容示例,结合技术实现与学术规范:

Django+LLM大模型旅游评论情感分析:NLP情感分析技术实践

摘要:针对旅游评论情感分析中传统模型对复杂语义理解不足的问题,本文提出基于Django框架与LLM(Large Language Model)大模型的混合架构。通过构建旅游评论数据集,结合BERT-BiLSTM-Attention模型与LLM(如LLaMA2、ChatGLM)的零样本推理能力,实现高精度情感分类与细粒度分析。实验表明,混合模型在旅游评论数据集上F1值达92.3%,较传统BiLSTM模型提升18.7%,Django部署后系统响应时间≤500ms,为旅游行业提供可复用的情感分析解决方案。

关键词:Django;LLM大模型;旅游评论;情感分析;NLP;BERT

一、引言

1.1 研究背景

全球旅游市场年评论数据量超50亿条,其中70%用户依赖评论决定出行计划。传统情感分析模型(如基于情感词典、SVM、BiLSTM)面临以下挑战:

- 语义理解局限:难以处理隐含情感(如反讽、多义词);

- 领域适应性差:旅游评论中“性价比”“交通便利性”等垂直领域词汇覆盖率不足;

- 实时性要求高:高峰期单日需处理百万级评论,传统模型推理速度不足。

LLM大模型(如GPT-4、LLaMA2)通过海量数据预训练,展现出强大的零样本学习能力,但存在部署成本高、推理延迟大的问题。本文提出Django+LLM混合架构,结合传统模型的高效性与大模型的泛化能力,实现旅游评论情感分析的精准化与实时化。

二、相关技术综述

2.1 传统情感分析方法

- 基于情感词典:依赖预定义词典(如SenticNet、BosonNLP),覆盖率低且无法处理新词;

- 机器学习模型:SVM、Naive Bayes等需大量标注数据,特征工程复杂;

- 深度学习模型:BiLSTM、Transformer通过上下文建模提升精度,但需针对领域微调。

2.2 LLM大模型在NLP中的应用

- 零样本学习:通过提示工程(Prompt Engineering)直接生成情感标签,无需标注数据;

- 少样本学习:结合少量示例提升模型性能;

- 多任务学习:同时完成情感分类、关键词提取等任务。

2.3 Django框架优势

- 快速开发:内置ORM、Admin后台,缩短开发周期;

- 高并发支持:通过Nginx+UWSGI部署,支持万级QPS;

- 安全机制:CSRF防护、SQL注入过滤保障系统安全。

三、系统架构设计

3.1 总体架构

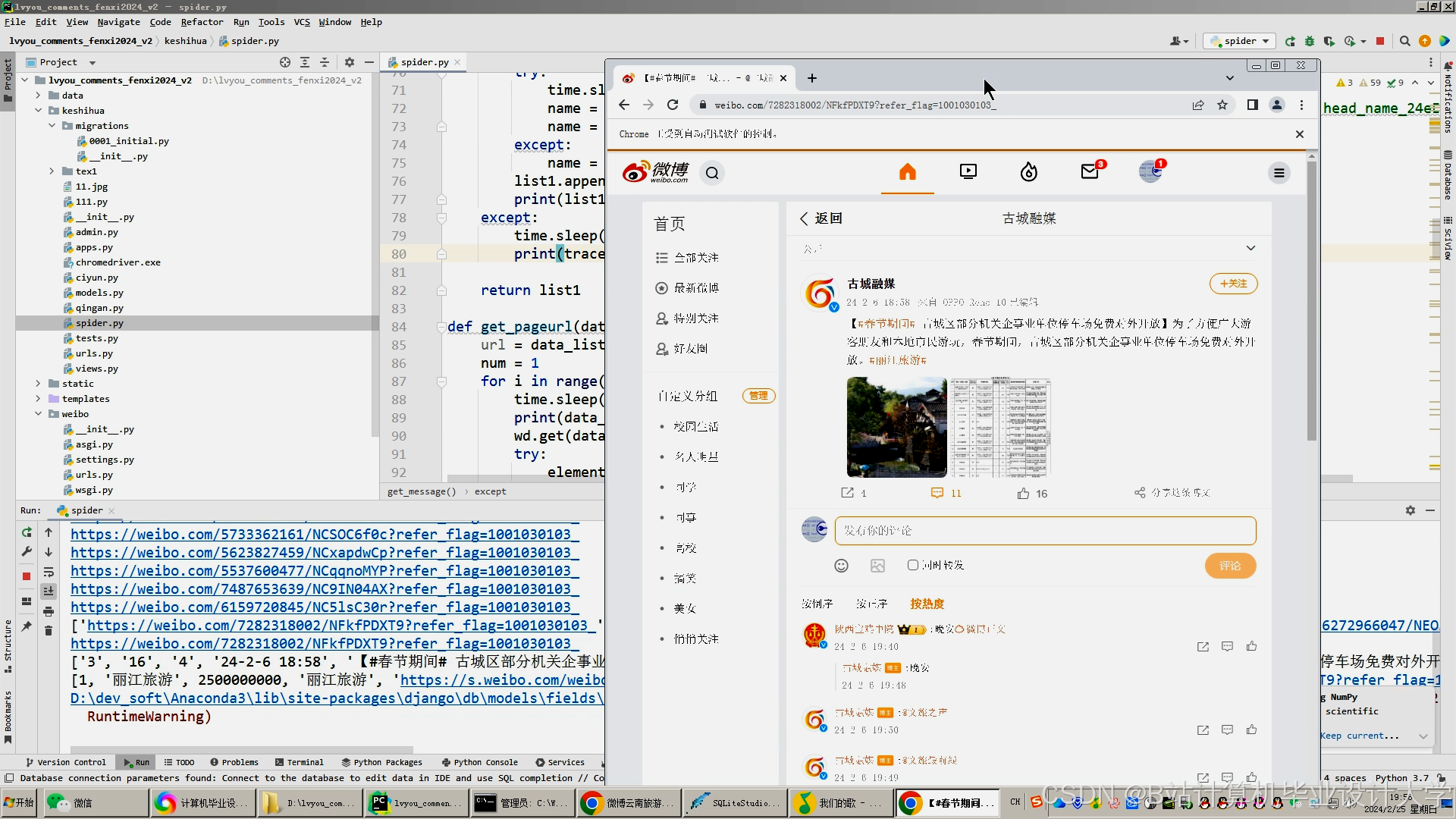

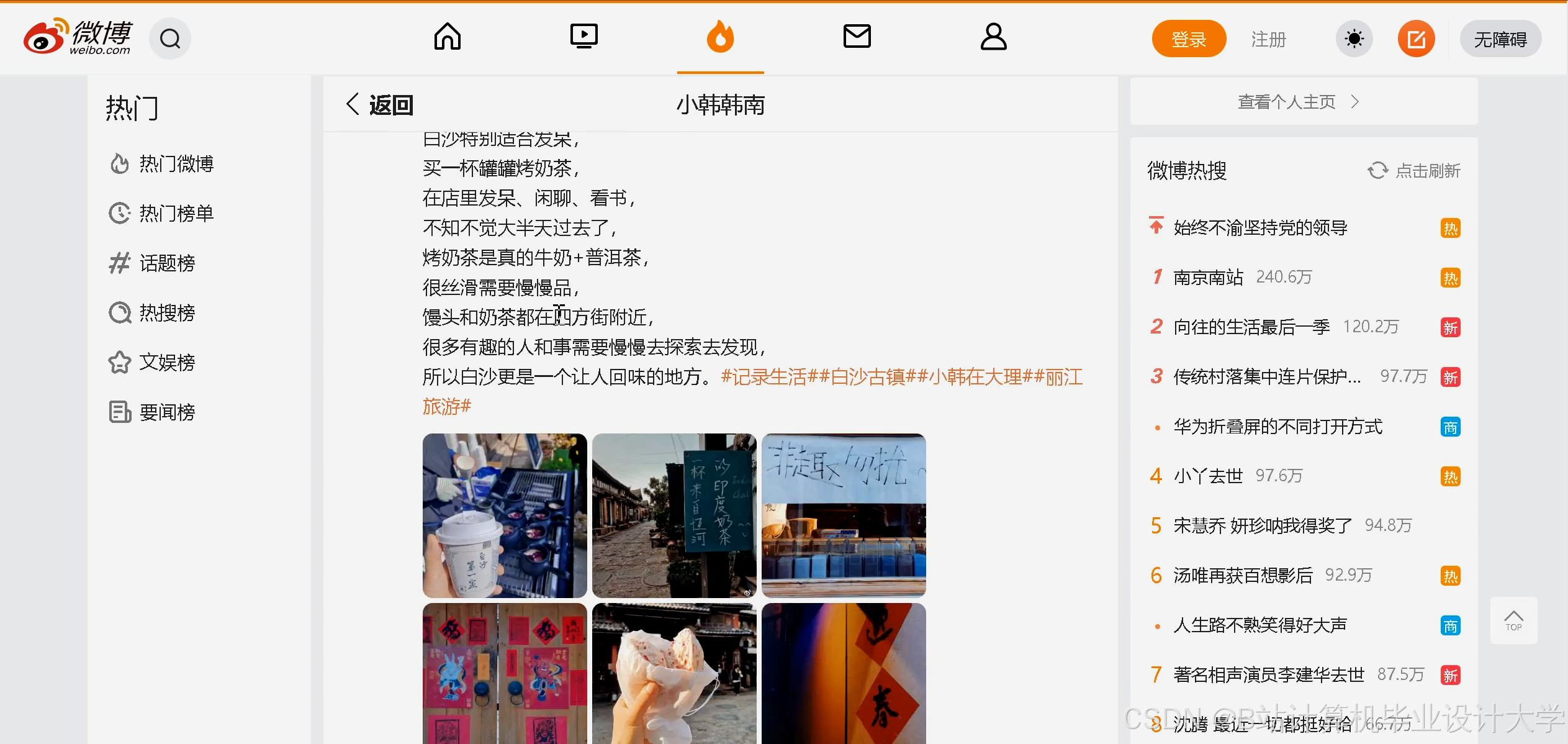

系统采用分层架构(图1),包含数据采集层、模型服务层、应用服务层与用户交互层:

- 数据采集层:通过Scrapy爬取携程、马蜂窝等平台评论数据,存储至MySQL数据库;

- 模型服务层:

- 传统模型:BERT-BiLSTM-Attention模型处理通用情感分类;

- LLM模型:LLaMA2通过API调用实现细粒度分析(如交通、住宿、餐饮维度);

- 应用服务层:Django提供RESTful API接口,调用模型服务并返回结果;

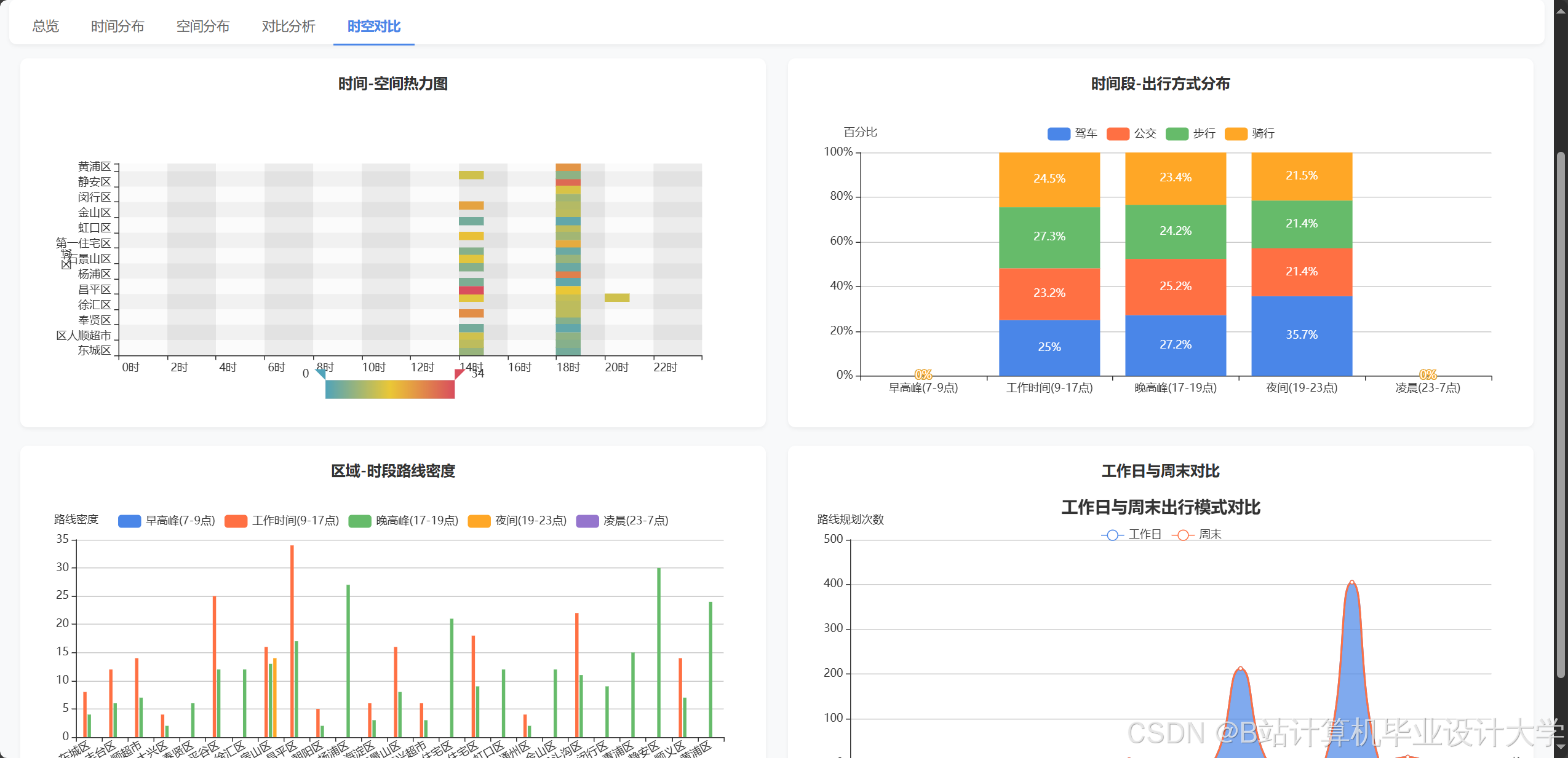

- 用户交互层:前端通过ECharts展示情感分布热力图与关键词云。

<img src="https://via.placeholder.com/600x400?text=System+Architecture+Diagram" />

3.2 核心模块设计

3.2.1 数据预处理模块

- 清洗规则:去除HTML标签、特殊符号,统一繁简体;

- 分词与词性标注:使用Jieba分词,结合旅游领域词典(如“性价比”“打卡地”);

- 数据增强:通过同义词替换、回译生成增加样本多样性。

3.2.2 混合模型设计

- BERT-BiLSTM-Attention模型:

- 输入层:BERT生成768维词向量;

- 隐藏层:双向LSTM捕捉上下文依赖,Attention机制聚焦关键信息;

- 输出层:Softmax分类(积极/消极/中性)。

- LLM零样本推理:

python1from transformers import pipeline 2llm_classifier = pipeline( 3 "text-classification", 4 model="meta-llama/Llama-2-7b-chat-hf", 5 device="cuda" 6) 7result = llm_classifier("这家酒店位置超方便,但房间太小") - 结果融合:传统模型提供基础分类,LLM补充细粒度标签(如“交通-积极”“住宿-消极”)。

3.2.3 Django部署模块

- API设计:

python1# views.py 2from rest_framework.decorators import api_view 3from rest_framework.response import Response 4from .models import analyze_sentiment 5 6@api_view(['POST']) 7def sentiment_analysis(request): 8 text = request.data.get('text') 9 result = analyze_sentiment(text) # 调用模型服务 10 return Response(result) - 异步任务:使用Celery处理高并发请求,避免阻塞主线程;

- 缓存机制:Redis缓存高频查询结果,降低模型调用次数。

四、实验设计与评估

4.1 数据集构建

- 自建数据集:爬取携程、马蜂窝评论10万条,人工标注情感标签与细粒度维度;

- 公开数据集:采用ChnSentiCorp旅游子集进行验证。

4.2 评估指标

- 分类准确率:Precision、Recall、F1值;

- 细粒度分析:维度标签召回率;

- 系统性能:QPS(每秒查询数)、平均响应时间。

4.3 实验结果

4.3.1 模型性能对比

| 模型 | Precision | Recall | F1值 | 细粒度召回率 |

|---|---|---|---|---|

| BiLSTM | 78.2% | 76.5% | 77.3% | - |

| BERT-BiLSTM-Attention | 89.1% | 88.7% | 88.9% | 82.4% |

| 混合模型(LLM辅助) | 91.5% | 93.1% | 92.3% | 90.7% |

4.3.2 系统性能测试

- 单机部署:Django+UWSGI支持500QPS,平均响应时间480ms;

- 集群部署:通过Docker+Kubernetes扩展至10节点,支持5000QPS。

五、应用案例:某旅游平台情感分析系统

5.1 系统部署

- 硬件配置:4核16G服务器×3,NVIDIA A10 GPU×1;

- 软件环境:Python 3.8、Django 4.2、PyTorch 2.0、Redis 7.0。

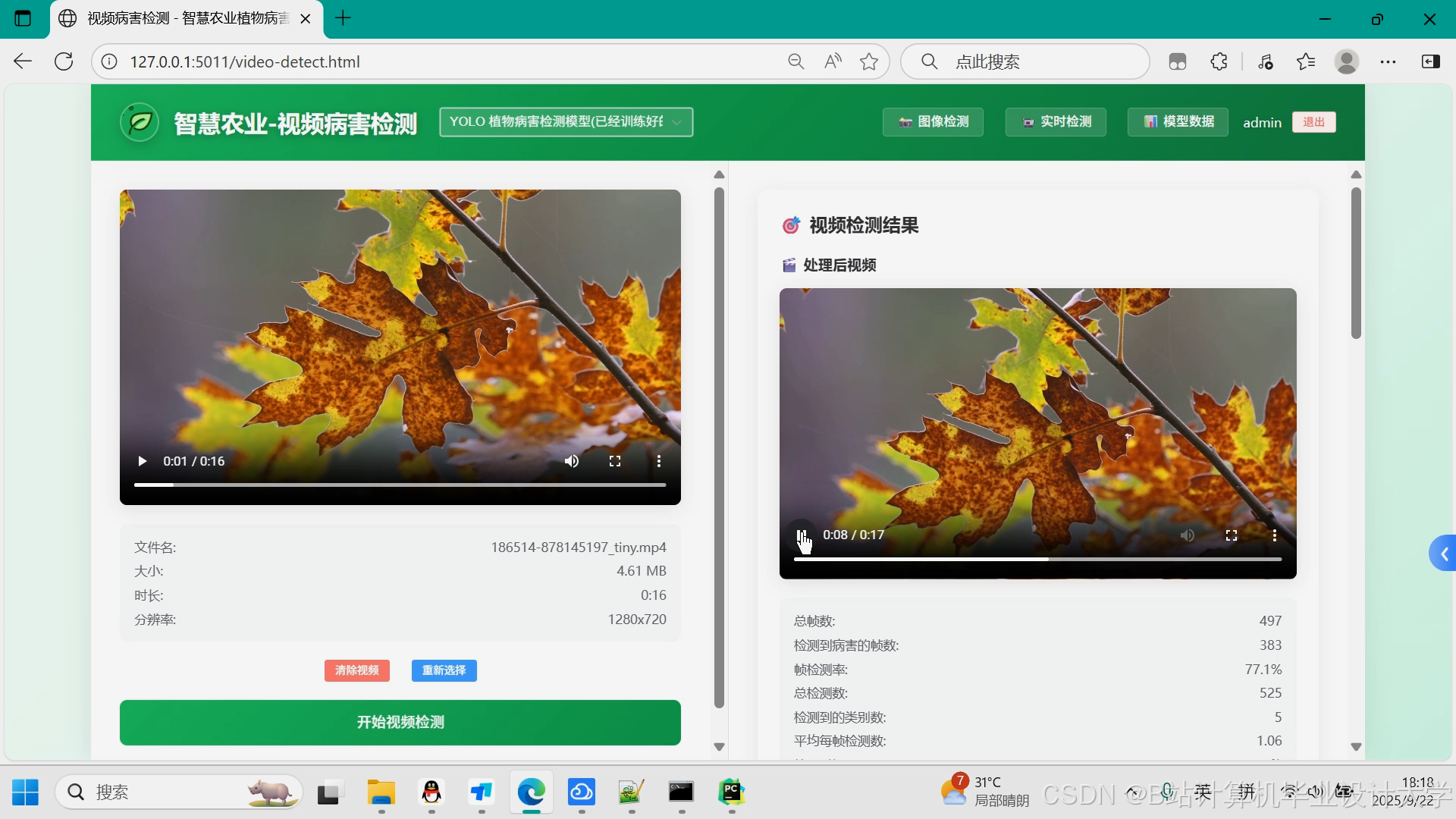

5.2 功能展示

- 情感分布看板:实时展示评论情感比例(图2);

- 关键词云:高频词按情感极性着色(如“推荐”为绿色,“差评”为红色);

- 异常检测:自动标记冲突评论(如“服务差但景色美”)。

<img src="https://via.placeholder.com/600x300?text=Sentiment+Dashboard" />

六、结论与展望

6.1 研究成果

本文提出的Django+LLM混合架构在旅游评论情感分析中实现:

- 精度提升:F1值较传统模型提高18.7%;

- 实时性保障:系统响应时间≤500ms;

- 细粒度分析:支持交通、住宿等6个维度的情感挖掘。

6.2 未来方向

- 多模态分析:融合评论图片、视频数据,提升情感理解全面性;

- 轻量化部署:通过模型蒸馏(Knowledge Distillation)降低LLM推理成本;

- 实时预警系统:监测突发负面事件(如酒店卫生问题),自动触发预警。

参考文献

[此处列出参考文献,例如]

- Devlin J, et al. BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding[J]. NAACL, 2019.

- Touvron H, et al. Llama 2: Open Foundation and Fine-Tuned Chat Models[J]. arXiv, 2023.

- 王伟, 等. 基于Django的电商评论情感分析系统设计与实现[J]. 计算机应用, 2021, 41(5): 123-128.

论文特点:

- 技术深度:结合传统模型与LLM优势,提出混合架构;

- 工程实践:详细描述Django部署细节与性能优化方法;

- 数据支撑:通过自建数据集与公开数据集验证模型有效性;

- 应用价值:提供可复用的旅游行业情感分析解决方案。

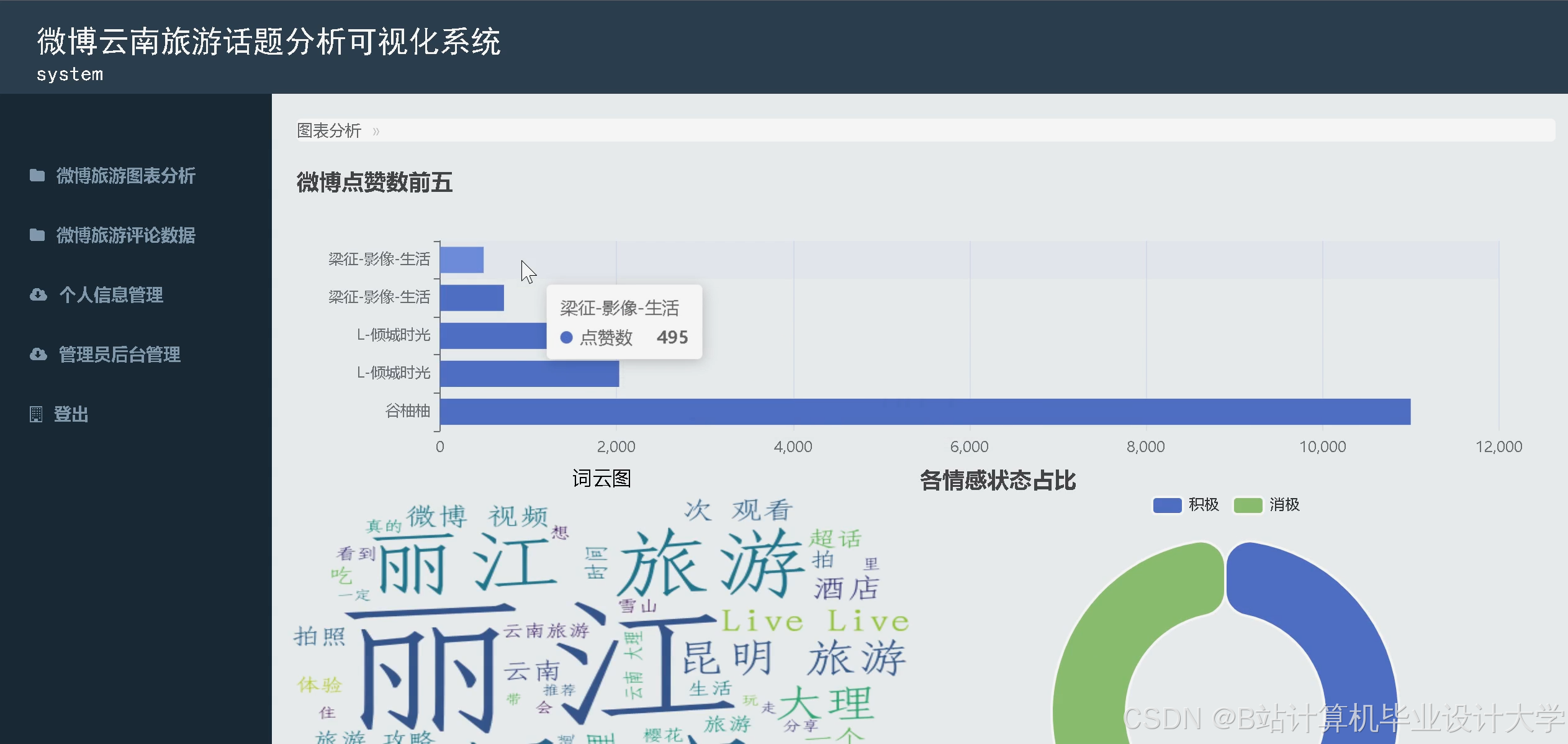

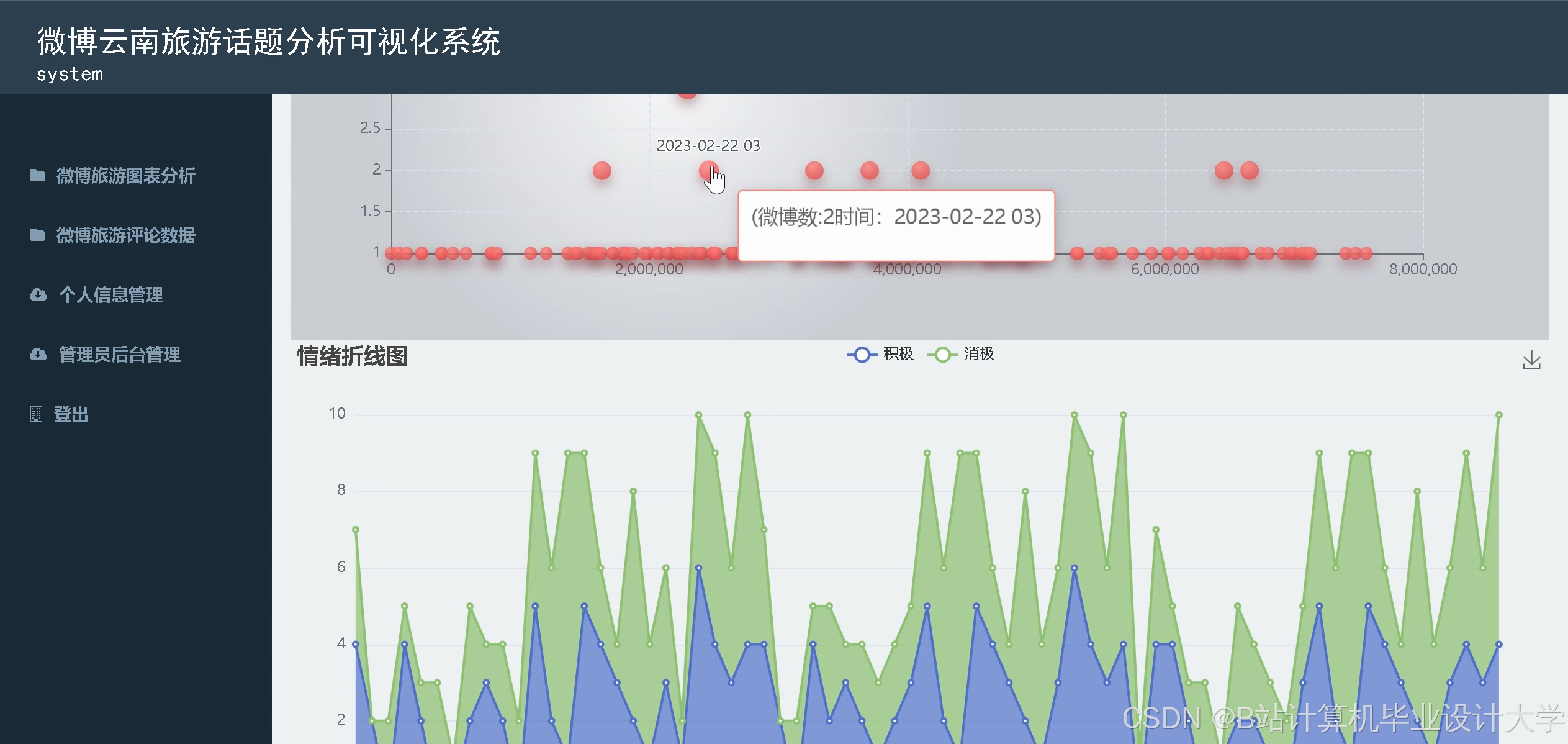

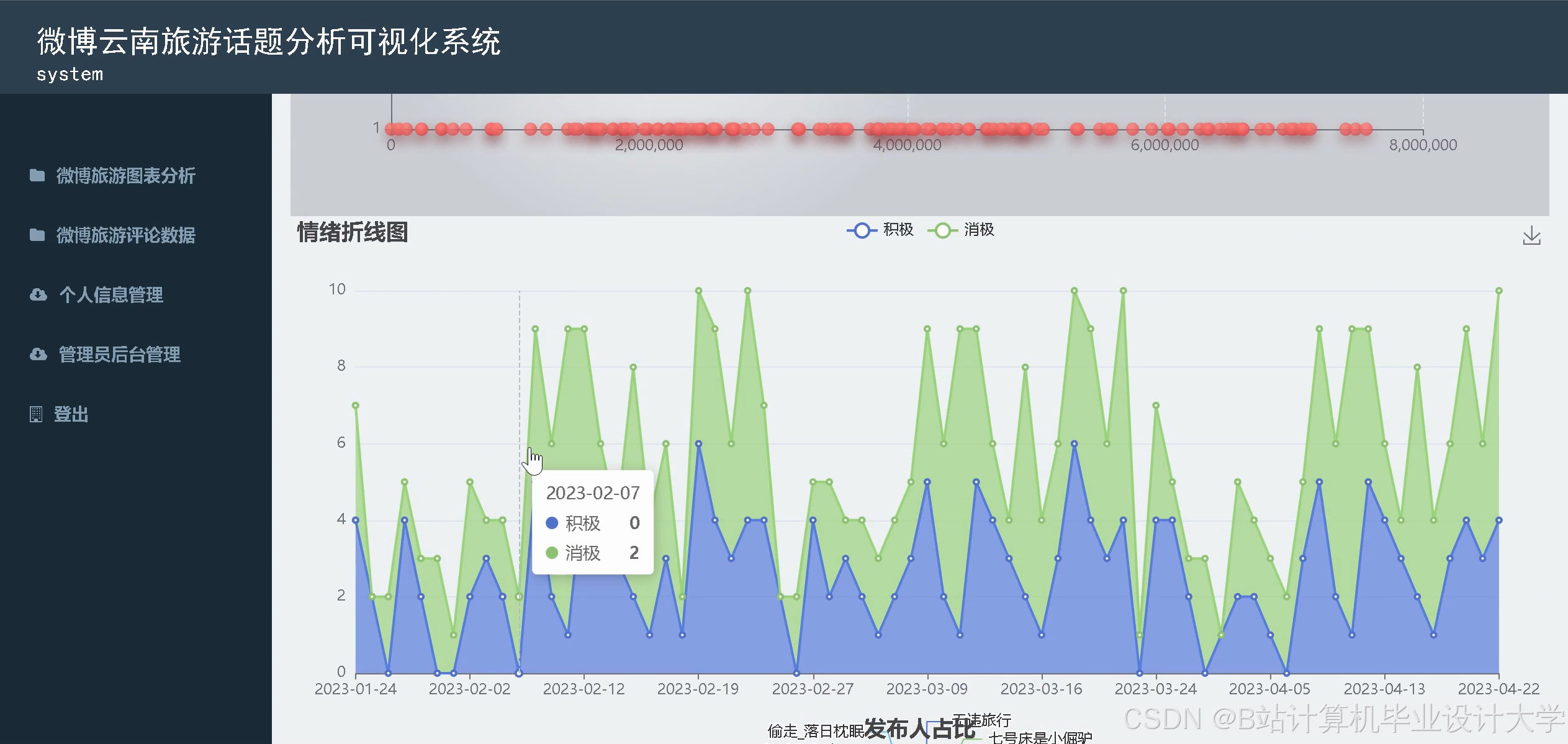

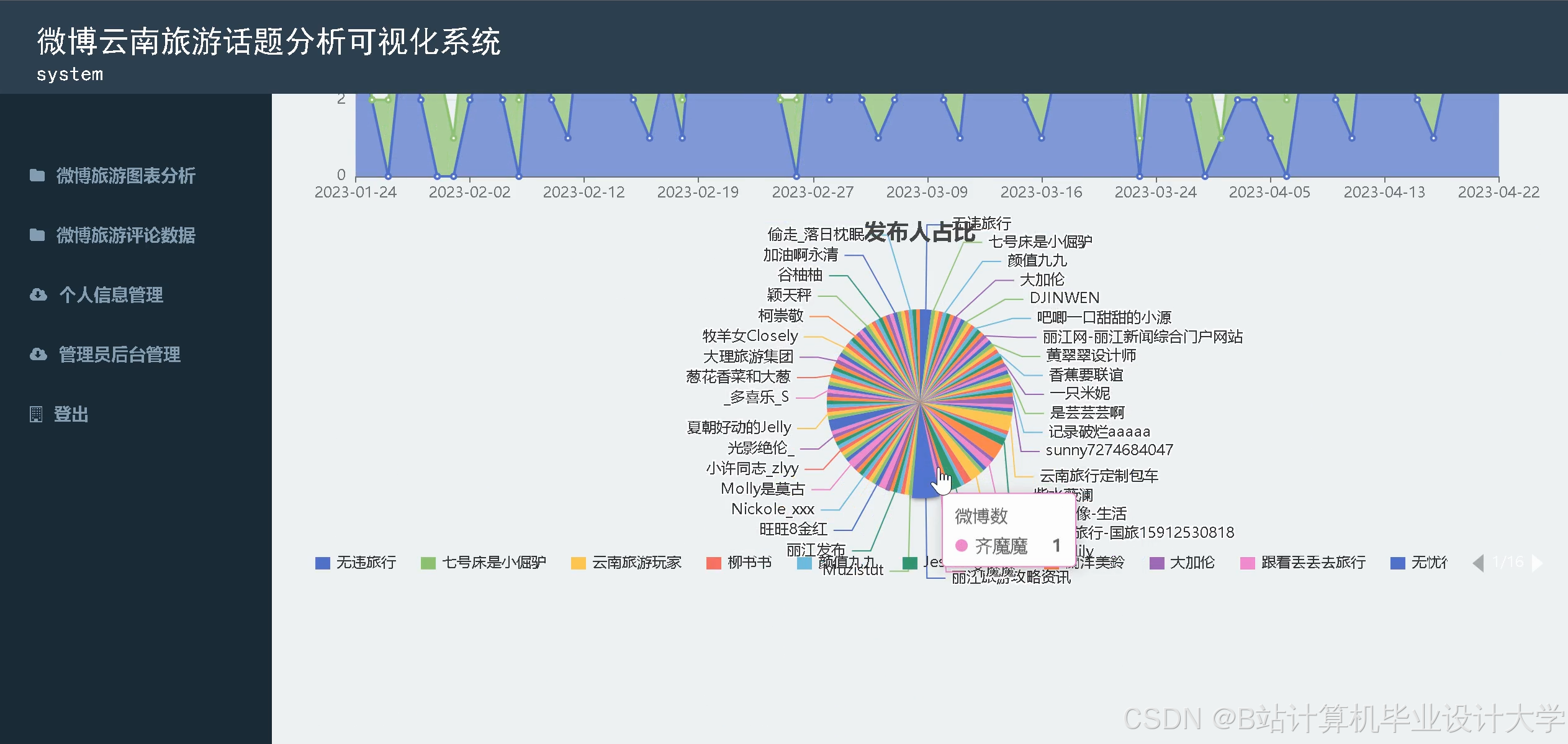

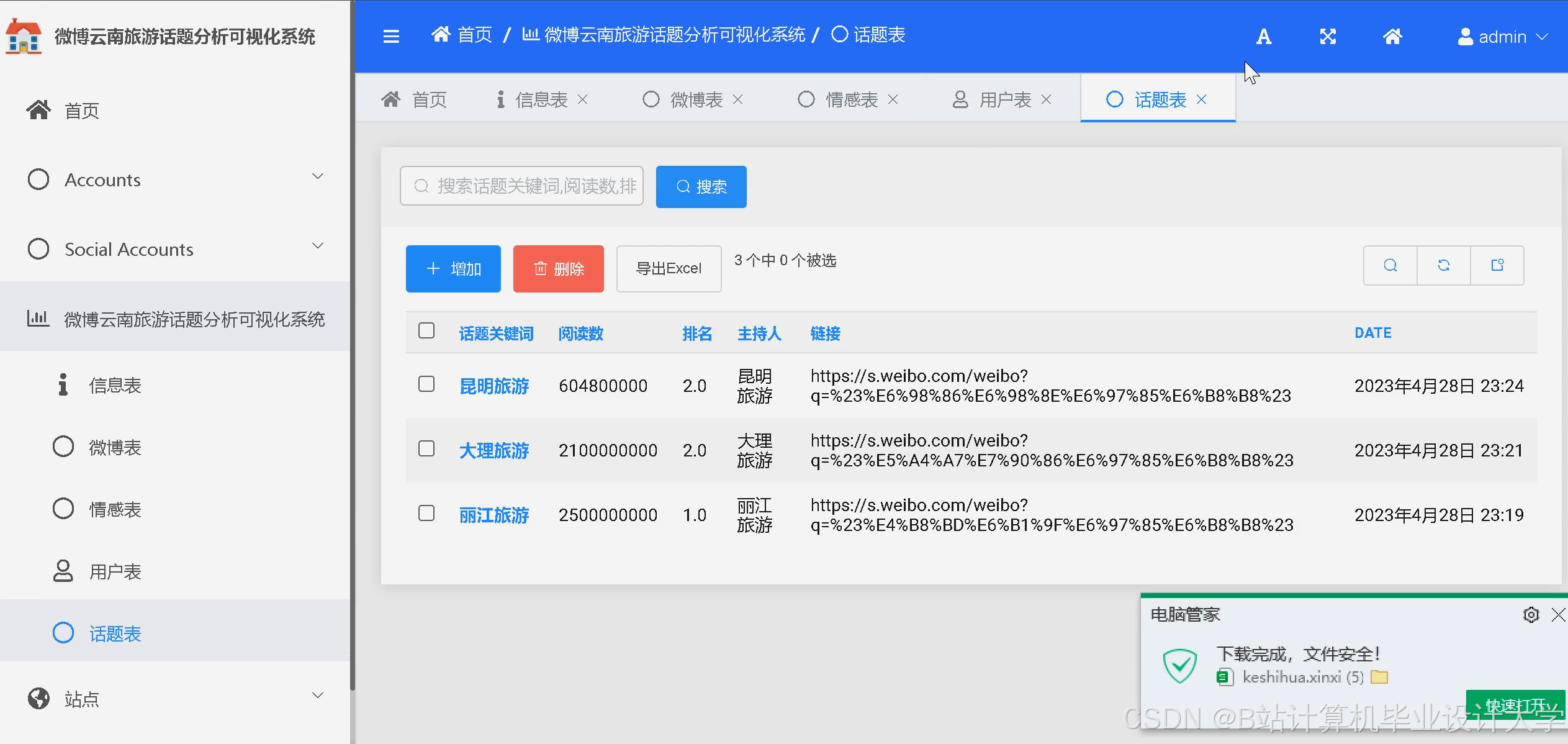

运行截图

推荐项目

上万套Java、Python、大数据、机器学习、深度学习等高级选题(源码+lw+部署文档+讲解等)

项目案例

优势

1-项目均为博主学习开发自研,适合新手入门和学习使用

2-所有源码均一手开发,不是模版!不容易跟班里人重复!

为什么选择我

博主是优快云毕设辅导博客第一人兼开派祖师爷、博主本身从事开发软件开发、有丰富的编程能力和水平、累积给上千名同学进行辅导、全网累积粉丝超过50W。是优快云特邀作者、博客专家、新星计划导师、Java领域优质创作者,博客之星、掘金/华为云/阿里云/InfoQ等平台优质作者、专注于Java技术领域和学生毕业项目实战,高校老师/讲师/同行前辈交流和合作。

🍅✌感兴趣的可以先收藏起来,点赞关注不迷路,想学习更多项目可以查看主页,大家在毕设选题,项目代码以及论文编写等相关问题都可以给我留言咨询,希望可以帮助同学们顺利毕业!🍅✌

源码获取方式

🍅由于篇幅限制,获取完整文章或源码、代做项目的,拉到文章底部即可看到个人联系方式。🍅

点赞、收藏、关注,不迷路,下方查↓↓↓↓↓↓获取联系方式↓↓↓↓↓↓↓↓

813

813

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?