实际上,应用程序运行得稳定与否,取决于硬件资源供给与计算需要是否匹配。这就好比是赛车组装,要得到一辆高性能的车子,我们并不需要每一个部件都达到“顶配”的要求,而是要让组装配件之间相互契合、匹配,才能让车子达到预期的马力输出。

因此,不妨从硬件资源的角度切入,去探索开发者必须要关注的配置项都有哪些。

内存

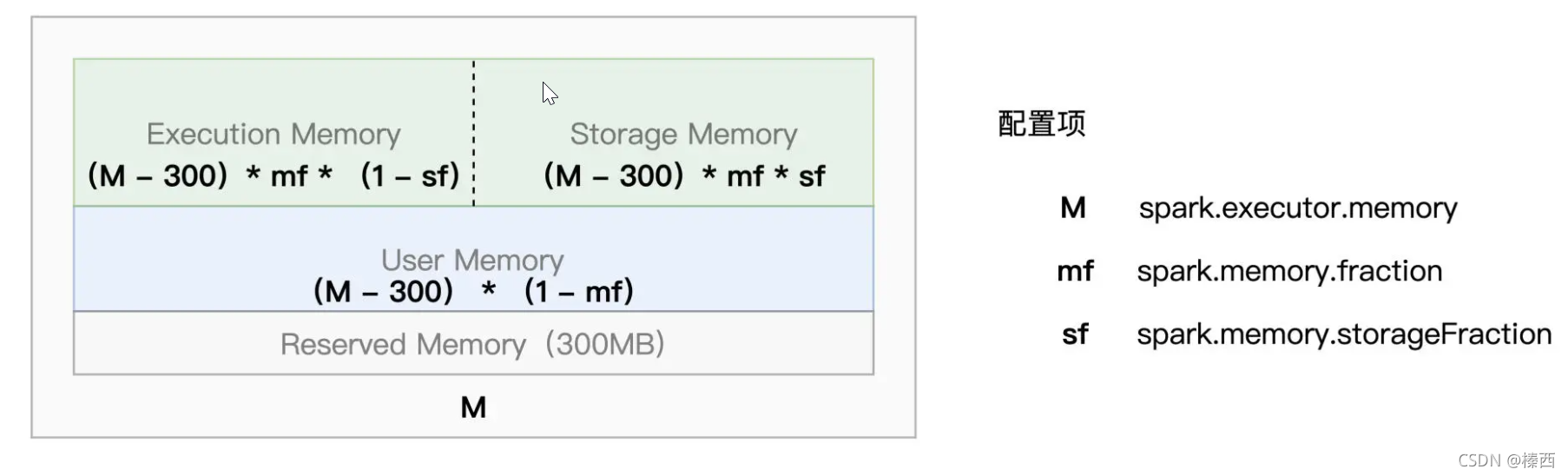

说起内存,不妨先来回顾一下 Spark 的内存划分。对于给定的 Executor Memory,Spark 将 JVM Heap 划分为 4 个区域,分别是 Reserved Memory、User Memory、Execution Memory 和 Storage Memory。

结合图解,其中 Reserved Memory 大小固定为 300MB,其他 3 个区域的空间大小,则有 3 个配置项来划定,它们分别是 spark.executor.memory、spark.memory.fraction、spark.memory.storageFraction。

为了后续叙述方便,分别把它们简称为 M、mf 和 s

本文深入探讨了Spark的内存划分、CPU配置、内存与CPU的平衡以及磁盘配置,强调了如何通过合理设置配置项实现Spark性能优化。讨论了Executor Memory的四个区域,重点介绍了内存配置项spark.executor.memory、spark.memory.fraction和spark.memory.storageFraction的设置原则,以及CPU相关配置spark.executor.instances和spark.executor.cores对并发度的影响。文章还提醒注意磁盘配置spark.local.dir的重要性,建议避免使用默认的/tmp目录。最后,介绍了配置项的设置途径,包括配置文件、命令行参数和SparkConf对象。

本文深入探讨了Spark的内存划分、CPU配置、内存与CPU的平衡以及磁盘配置,强调了如何通过合理设置配置项实现Spark性能优化。讨论了Executor Memory的四个区域,重点介绍了内存配置项spark.executor.memory、spark.memory.fraction和spark.memory.storageFraction的设置原则,以及CPU相关配置spark.executor.instances和spark.executor.cores对并发度的影响。文章还提醒注意磁盘配置spark.local.dir的重要性,建议避免使用默认的/tmp目录。最后,介绍了配置项的设置途径,包括配置文件、命令行参数和SparkConf对象。

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?