目前的同步方法有以下三种

-

查询hive库,发送kafka消息,应用消费kafka,写入mysql库

-

查询hive库,spark dataset save jdbc方式写入

-

如果是tidb库,官方支持tisprk方式写入

各自优缺点

-

把hive数据查出来,在发送kafka增加了复杂性,引入了kafka,出现问题多了一个排查范围,但是这种方式能够利用kafka削峰,不至于将tidb打垮,缺点:消息是无序的,所以最后一条的消费情况无法确认,需要借助redis来记录数据消费情况以及总数,因为kafka速度较快只能借助redis辅助记录。

-

通过spark dataset jdbc方式需要控制partition分区数,防止把db打垮,使用dataset.repartition(n)

-

tispark方式是通过tidb官方的spark插件,支持直连pd server 直接将数据写入tidb region ,速度很快,但是官方不再维护了这个插件,tispark也支持直接通过spark sql查询tidb与hive表进行join,但是太慢了

dataset查询tidb收集,计算慢问题

tispark查询大数据量的tidb会异常的慢,因为spark节点的通信将非常耗时,因为tidb不再spark集群内,所以网络将成为瓶颈,故不建议使用tispark查询大批量的tidb数据

sparkSession.sql(" select ifnull(max(convert_id),'') as convert_id from tidb_catalog.%s.%s where convert_id in ('%s')")当执行tidb查询的时候,触发计算的操作,如count,isempty,filter过滤等都异常的慢,所以要避免使用tispark进行查询tidb操作,spark job的excutor 进行计算的时候会和tidb进行网络交互,会比和hive交互慢很多,使用tispark查询tidb只能查询小数据量数据

这里介绍下tispark方式同步hive数据到tidb

通过阅读官方文档增加以下配置

https://docs-archive.pingcap.com/zh/tidb/v3.0/tispark-overview

https://docs.pingcap.com/zh/tidb/stable/tispark-overview

查看tidb版本

select tidb_version();

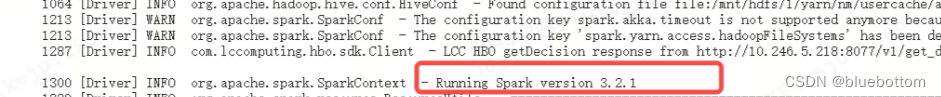

查看spark版本

代码实现

/**

获取tispark

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?