Stable-Diffusion: 开启文本到图像生成的新时代

本项目使用Stable-Diffusion作为文生图的大模型,下面详细介绍一下这个大模型。随着深度学习技术的飞速发展,人工智能在图像生成领域取得了显著的成果。特别是近年来,生成式对抗网络(GAN)和变分自编码器(VAE)等大模型的出现,使得文本到图像的生成成为可能。Stable-Diffusion作为一种新兴的文本到图像生成模型,以其高效、稳定和高质量的生成能力,受到了广泛关注。本文将详细介绍Stable-Diffusion的原理、技术特点、优化技巧以及在各个领域的应用。

一、引言

文本到图像生成任务旨在根据给定的文本描述生成相应的图片。这项任务在计算机视觉和自然语言处理领域具有广泛的应用,如智能广告生成、虚拟现实、图像编辑等。传统的文本到图像生成方法主要基于模板匹配和规则生成,这些方法受限于规则和模板的覆盖范围,无法生成多样化的图片。近年来,随着深度学习技术的发展,基于卷积神经网络(CNN)和循环神经网络(RNN)的方法逐渐成为主流。然而,这些方法生成的图片质量较低,无法满足实际应用需求。

生成式对抗网络(GAN)和变分自编码器(VAE)的出现为文本到图像生成任务带来了新的希望。GAN通过生成器和判别器的博弈学习数据分布,VAE通过最大化边际对数似然的下界学习数据分布。这些大模型在文本到图像生成任务上取得了显著的成果,但仍然存在生成速度慢、训练不稳定等问题。

Stable-Diffusion作为一种新兴的文本到图像生成模型,通过引入去噪扩散过程和条件生成过程,实现了高效、稳定和高质量的文本到图像生成。本文将详细介绍Stable-Diffusion的原理、技术特点、优化技巧以及在各个领域的应用。

二、Stable-Diffusion原理

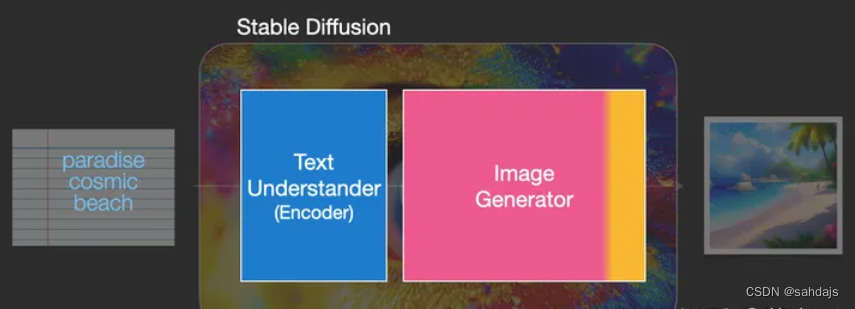

Stable-Diffusion是一种基于去噪扩散过程的文本到图像生成模型。它由去噪扩散过程和条件生成过程两部分组成。

1. 去噪扩散过程

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3107

3107

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?