计算机视觉四大基本任务

四大基本任务:图像分类、目标定位、目标检测、图像分割

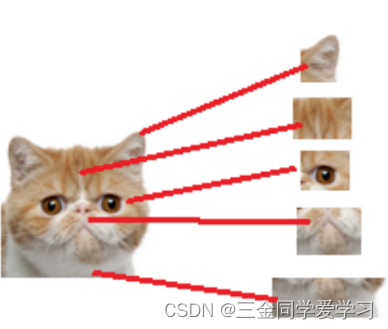

图像分类(Image Classification)(图1):图像分类是根据图像的语义信息对不同类别的图像进行区分 。通过训练深度学习模型,如卷积神经网络(CNN),可以实现对图像内容的自动分类,如区分图像中是否包含特定物体、识别手写数字等。

目标定位(Object Localization)(图2):图像分类和定位是在图像分类的基础上,进一步要求模型能够定位出图像中目标物体的位置。这通常通过在模型输出中添加边界框(bounding box)来实现,边界框可以标出目标物体在图像中的位置。如目标跟踪、人脸识别等。

目标检测(Object Detection)(图3):要求模型能够在图像中自动检测出多个目标物体的存在,并为每个物体提供边界框和类别标签。如自动驾驶、安防监控、医疗图像分析等。

图像分割(Image Segmentation)(图4):图像分割是将图像划分为多个具有相同或相似性质的区域的过程。这些区域可以是基于像素的(如语义分割Semantic segmentation),也可以是基于物体的(如实例分割Instance segmentation)。图像分割的目标是将图像中的不同物体或区域进行准确的划分和标识,以便进行后续的图像分析和处理。图像分割在医学影像分析、自动驾驶、卫星图像解析等领域都有广泛的应用。

图像分割:语义分割、实例分割、全景分割

语义分割:语义分割的目标是为图像中的每个像素分配一个语义标签,以指示它属于哪个类别。这意味着它将图像划分为不同的区域,每个区域都具有相同的语义标签。语义分割不关心每个物体的具体实例,只关注像素级别的语义标签。

实例分割:目标检测和语义分割的结合,实例分割的目标是对每个物体实例进行独立的分割,从而可以识别和跟踪图像中的每个物体。语义分割不区分属于相同类别的不同实例,实例分割区分同类的不同实例。

全景分割:语义分割和实例分割的结合,即要对所有目标都检测出来,又要区分出同个类别中的不同实例。实例分割只对图像中的目标进行检测和按像素分割,区分不同实例,而全景分割是对图中的所有物体包括背景都要进行检测和分割,区分不同实例。

目标检测技术路线分支

单阶段检测、双阶段检测

单阶段检测:单阶段目标检测模型是指没有独立地提取候选区域(Region Proposal)的过程,而是直接输入图像得到图中存在的物体类别和相应的位置信息。这种方法的典型代表有SSD(Single Shot multibox-Detector)和YOLO(You Only Look Once)系列模型等。单阶段目标检测方法通过一次计算完成物体位置估计和类别分类,因此速度较快,计算成本相对较低。但是,由于在小目标的定位和检测上容易产生较高的误检率,其精度相对较低。

双阶段检测:双阶段目标检测模型则包含两个独立的网络模型:生成候选目标框的区域建议网络(Region Proposal Network,RPN)和对这些框进行分类和边界框回归的网络。这种方法的典型代表有R-CNN、Fast R-CNN和Faster R-CNN等。双阶段目标检测方法通过两个阶段的计算,能够更精确地生成候选框并减少误检率,因此其精度较高。但是,由于需要进行两个阶段的计算,其速度相对较慢。在大目标和复杂场景中,双阶段目标检测模型能够提供更好的检测性能。

卷积神经网络基本结构

卷积层

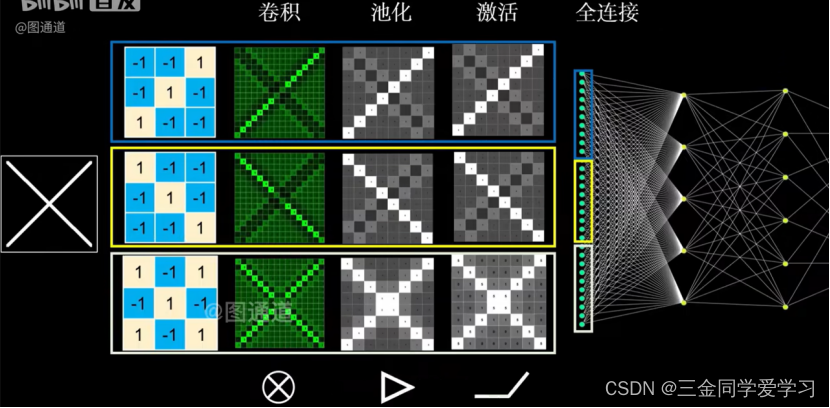

神经网络中的卷积层是卷积神经网络(Convolutional Neural Network,CNN)的核心组成部分。卷积层的主要作用是对输入数据进行特征提取,通过卷积操作将原始图像转换成特征图(Feature Map),从而实现对图像的有效表征。

在卷积层中,每个神经元只与输入数据的一个局部区域相连,这个局部区域称为该神经元的感受野(Receptive Field)。每个神经元都使用一个可学习的卷积核(或称为滤波器)对输入图像进行卷积操作,以提取出该局部区域的特征。卷积核的大小、数量和滑动步长等参数都是可以设置的,这些参数会影响特征提取的效果和计算效率。

卷积操作的过程可以看作是对输入数据进行滤波,通过不同的卷积核可以提取出不同的特征,如边缘、纹理、颜色等。卷积层的输出是一组特征图,每个特征图都对应一个卷积核,特征图上的每个像素值都是该卷积核在输入数据上滑动并进行卷积操作的结果。

池化层

池化层通常位于卷积层之后,用于对卷积层提取出的特征进行下采样(Subsampling)或池化(Pooling)操作,以减少特征的维度和计算量,同时提高模型的鲁棒性。

池化层的作用主要有以下几个方面:

1.特征降维:通过池化操作,将特征图的尺寸减小,从而减少后续层的计算量和参数数量。这有助于降低模型的复杂度,减少过拟合的风险。

2.特征不变性:池化操作可以使模型更加关注是否存在某些特征而不是特征具体的位置。因此,即使输入图像发生一些微小的平移或形变,模型仍然能够提取出有效的特征。

3.防止过拟合:由于池化层能够减小特征的维度,从而在一定程度上减少了模型的复杂度,这有助于防止过拟合现象的发生。

注:防止过拟合(模型在训练数据上表现得比在未见过的测试数据上表现更好的现象,就是学习到不该学习到的特征,泛化能力小)

常见的池化操作包括最大池化(Max Pooling)和平均池化(Average Pooling)。最大池化是在每个池化窗口内选择最大的值作为输出,这有助于保留输入数据中的显著特征。平均池化则是在每个池化窗口内计算所有值的平均值作为输出,这有助于提取输入数据的整体特征。除了这两种基本的池化方式外,还有一些其他的池化方法,如重叠池化(Overlapping Pooling)等。

非线性激活函数

[参考视频:非线性激活函数]

【【深度学习 搞笑教程】19 激活函数 sigmoid tanh ReLU LeakyReLU ELU Swish | 草履虫都能听懂 零基础入门 | 持续更新】https://www.bilibili.com/video/BV1Kc411D7uo?vd_source=f27e752a0579221ea41fb49c44eeed37

(https://www.bilibili.com/video/BV1Kc411D7uo?vd_source=f27e752a0579221ea41fb49c44eeed37)

神经网络中的非线性激活函数是用于引入非线性因素的关键组件。由于线性模型的表达力有限,无法处理复杂的非线性问题,因此在神经网络中引入非线性激活函数是非常必要的。非线性激活函数的作用是将神经元的输出进行非线性变换,从而增加模型的复杂度和表达能力。

常见的非线性激活函数包括Sigmoid、Tanh、ReLU(Rectified Linear Unit)和Softmax等。这些函数具有不同的特点和适用场景。

Sigmoid函数:Sigmoid函数将输入值映射到0到1之间,具有平滑的曲线。它曾经被广泛使用,但由于其。

Tanh函数:Tanh函数将输入值映射到-1到1之间,也具有平滑的曲线。与Sigmoid函数相比,Tanh函数的输出范围更大,因此在某些情况下可能表现更好。然而,它同样存在梯度消失和计算量大等问题。

ReLU函数:ReLU函数是一种分段线性函数,当输入值小于0时输出为0,当输入值大于等于0时输出等于输入值。ReLU函数具有计算量小、收敛速度快和能够缓解梯度消失问题等优点,因此在深度学习中得到了广泛应用。

Softmax函数:Softmax函数通常用于多分类问题的输出层,将神经元的输出转换为一个概率分布。它将输入值映射到0到1之间,并且所有输出的概率之和为1。

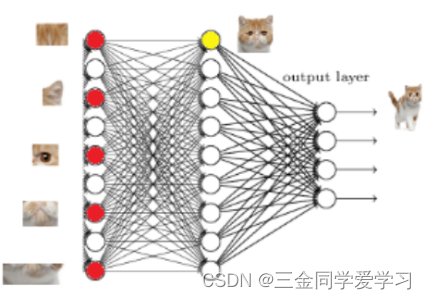

全连接层

全连接层(fully connected layers,FC)在整个卷积神经网络中起到“分类器”的作用。如果说卷积层、池化层和激活函数等操作是将原始数据映射到隐层特征空间的话,全连接层则起到将学到的“分布式特征表示”映射到样本标记空间的作用。

[参考视频:可视化神经网络]

【图解,卷积神经网络(CNN可视化)】https://www.bilibili.com/video/BV1x44y1P7s2?vd_source=f27e752a0579221ea41fb49c44eeed37

(https://www.bilibili.com/video/BV1x44y1P7s2?vd_source=f27e752a0579221ea41fb49c44eeed37)

注:本文章图片均来源于b站up主及知乎博客,仅用于学习记录,无任何商业用途。

本文详细介绍了计算机视觉的四大基本任务——图像分类、目标定位、目标检测和图像分割,特别是语义分割、实例分割和全景分割的区别。此外,文章还探讨了目标检测的单阶段和双阶段技术路线,以及卷积神经网络的结构,包括卷积层、池化层和非线性激活函数的作用。

本文详细介绍了计算机视觉的四大基本任务——图像分类、目标定位、目标检测和图像分割,特别是语义分割、实例分割和全景分割的区别。此外,文章还探讨了目标检测的单阶段和双阶段技术路线,以及卷积神经网络的结构,包括卷积层、池化层和非线性激活函数的作用。

1875

1875

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?