本教程安装环境为windows+anaconda。最终可实现直接在pycharm中进行yolov5深度学习训练。

一、安装anaconda

因anaconda服务器在境外可能存在网络问题,所以这里使用清华源镜像进行下载。

网址:Index of /anaconda/archive/ | 清华大学开源软件镜像站 | Tsinghua Open Source Mirror

按照需要选择自己需要的版本。

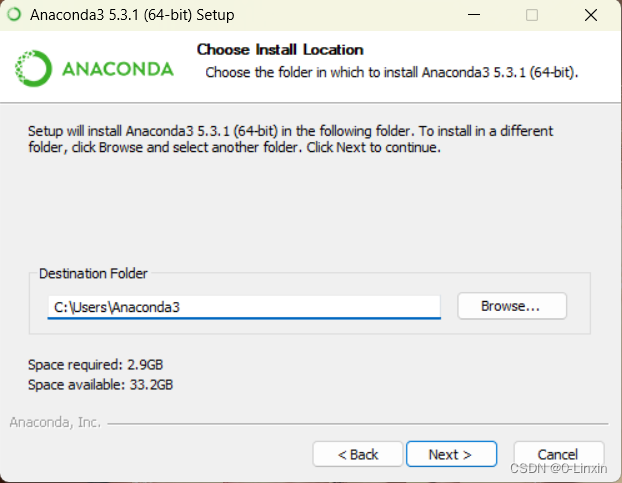

1、运行安装包,一路默认路径就ok,但是需要记清楚路径,因为后期有需要可以进行环境变量配置。

finish后,记得将两个对勾取消。

如果不想改变电脑主环境,可无需配置环境变量,因为anaconda自带命令窗口。

2、环境变量配置

自行配置path路径

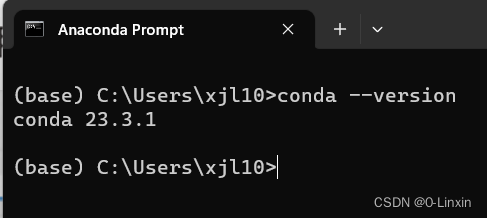

3、测试是否安装成功

配置了环境变量的直接进入cmd,输入语句 conda --version即可。

如果未进行环境变量配置的同学,可以进入anaconda自带的命令窗口查看。

二、安装CUDA(也可以不安装:如果电脑没有英伟达的显卡)

CUDA安装与否决定这下载pytorch时的选择。

(一)CUDA概述

2006年,NVIDIA公司发布了CUDA(Compute Unified Device Architecture),是一种新的操作GPU计算的硬件和软件架构,是建立在NVIDIA的GPUs上的一个通用并行计算平台和编程模型,它提供了GPU编程的简易接口,基于CUDA编程可以构建基于GPU计算的应用程序,利用GPUs的并行计算引擎来更加高效地解决比较复杂的计算难题。它将GPU视作一个数据并行计算设备,而且无需把这些计算映射到图形API。操作系统的多任务机制可以同时管理CUDA访问GPU和图形程序的运行库,其计算特性支持利用CUDA直观地编写GPU核心程序。

CUDA提供了对其它编程语言的支持,如C/C++,Python,Fortran等语言。只有安装CUDA才能够进行复杂的并行计算。主流的深度学习框架也都是基于CUDA进行GPU并行加速的,几乎无一例外。还有一个叫做cudnn,是针对深度卷积神经网络的加速库。

CUDA在软件方面组成有:一个CUDA库、一个应用程序编程接口(API)及其运行库(Runtime)、两个较高级别的通用数学库,即CUFFT和CUBLAS。CUDA改进了DRAM的读写灵活性,使得GPU与CPU的机制相吻合。另一方面,CUDA提供了片上(on-chip)共享内存,使得线程之间可以共享数据。应用程序可以利用共享内存来减少DRAM的数据传送,更少的依赖DRAM的内存带宽。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?