1,SVM算法导入

1.1,定义

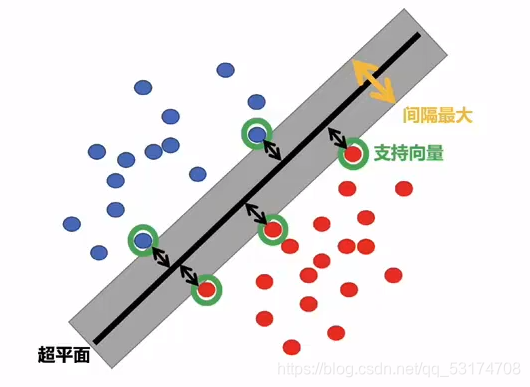

有时候,人们会把支持向量机称为大间距分类器。

SVM全称support vector machine(支持向量机),即寻找到一个超平面使样本分成两类,并且间隔最大,

1.2,超平面最大间隔介绍

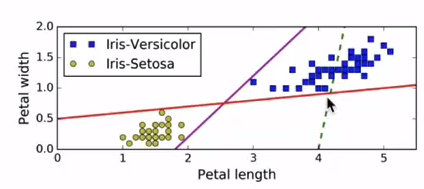

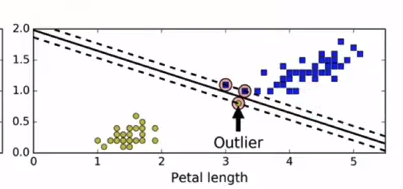

如图,三条线代表了三种可能的线性分类器的决策边界。虚线非常糟糕,其余两个模型在这个训练集上表现完美,但它们的决策边界与事例过于接近,导致在面对新事例时,表现可能不会太好。

上图的这个实线代表SVM分类树的决策边界,不仅分离了两个类别,且尽可能远离最近的训练事例。

1.3硬间隔和软间隔

1.3.1硬间隔

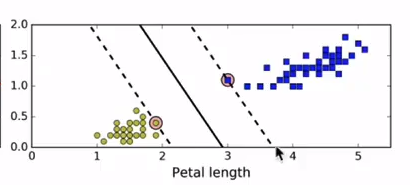

硬间隔分类:严格的让所有实例都不在最大间隔之间,并且位于正确的一边。

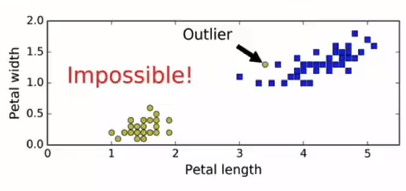

硬间隔分类有两个问题,首先,它在数据线性可分离的时候才有效,其次,它对异常值非常敏感。

这个就无法使用硬间隔来分类;

这个虽然实现了硬间隔,但是可以看到,为了照顾某个特殊变量,分离效果是非常不好的。

1.3.2软间隔

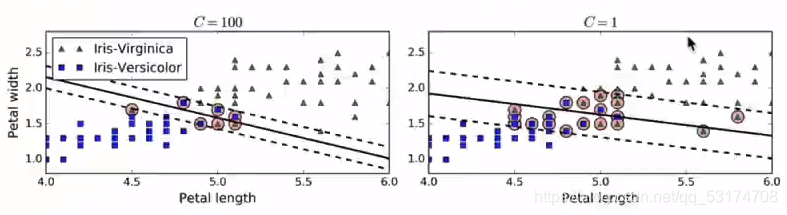

软间隔:目标是尽可能在保持最大间隔宽度和限制间隔违例(即位于最大间隔之上,甚至在错误的一边的实例)之间找到良好的平衡,这既是软间隔分类。

如图没虽然有一些错误实例,但是与最大间隔有了平衡,上面的C是什么意思呢?

超参数C(可以理解为惩罚),C越小,惩罚越小,间隔越宽,同时错误样本(间隔违例)越多。(C具体在后面讲到)。

2.SVM算法api初步使用

from sklearn import svm

X = [[0,0]

本文深入探讨了支持向量机(SVM)算法,包括其作为大间距分类器的概念,超平面最大间隔的重要性,以及硬间隔和软间隔的区别。介绍了SVM的API使用,特别是`svm.SVC()`函数,以及参数如`C`的作用。接着,讲解了SVM的损失函数,如0/1损失和Hinge损失,并阐述了核函数的概念和常见类型。最后,讨论了SVM的参数配置,如`C`参数如何影响模型的泛化能力和对异常值的敏感性。

本文深入探讨了支持向量机(SVM)算法,包括其作为大间距分类器的概念,超平面最大间隔的重要性,以及硬间隔和软间隔的区别。介绍了SVM的API使用,特别是`svm.SVC()`函数,以及参数如`C`的作用。接着,讲解了SVM的损失函数,如0/1损失和Hinge损失,并阐述了核函数的概念和常见类型。最后,讨论了SVM的参数配置,如`C`参数如何影响模型的泛化能力和对异常值的敏感性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?