目录

(2)、使用类设计模型(继承 torch.nn.Module)

1、使用PyTorch深度学习框架写深度学习代码的步骤

(1)、准备数据集

import torch

# import torch.nn.functional as F

x_data = torch.Tensor([[1.0], [2.0], [3.0]])

y_data = torch.Tensor([[0], [0], [1]])(2)、使用类设计模型(继承 torch.nn.Module)

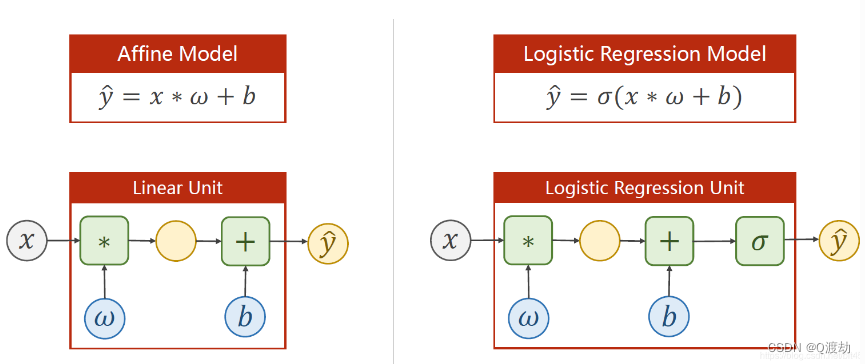

- 逻辑斯蒂回归和线性模型的明显区别是在线性模型的后面,添加了激活函数(非线性变换)

class LogisticRegressionModel(torch.nn.Module):

def __init__(self):

super(LogisticRegressionModel, self).__init__()

self.linear = torch.nn.Linear(1, 1)

def forward(self, x):

# y_pred = F.sigmoid(self.linear(x))

y_pred = torch.sigmoid(self.linear(x))

return y_pred

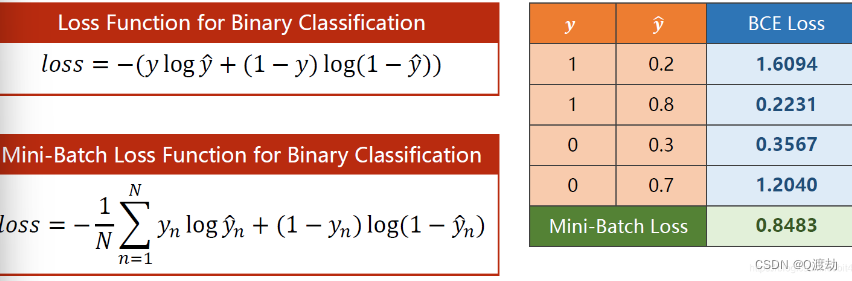

(3)、使用PyTorch的API构建损失函数和优化器

- 分布的差异:KL散度,cross-entropy交叉熵

# 默认情况下,loss会基于element平均,如果size_average=False的话,loss会被累加。

criterion = torch.nn.BCELoss(size_average=False)

optimizer = torch.optim.SGD(model.parameters(), lr=0.01)(4)、循环训练模型

- 每一次循环都要构建计算图进行前向传播(forward)、后向传播计算各个位置的偏导数并将导数值保存在定义的参数中(backward)、梯度下降不断更新梯度值(update)

for epoch in range(1000):

y_pred = model(x_data)

loss = criterion(y_pred, y_data)

print(epoch, loss.item())

optimizer.zero_grad()

loss.backward()

optimizer.step()2、测试训练好的模型

print('w = ', model.linear.weight.item())

print('b = ', model.linear.bias.item())

x_test = torch.Tensor([[10.0]])

y_test = model(x_test)

print('y_pred = ', y_test.data)

print('y_pred = ', y_test[0][0].item())

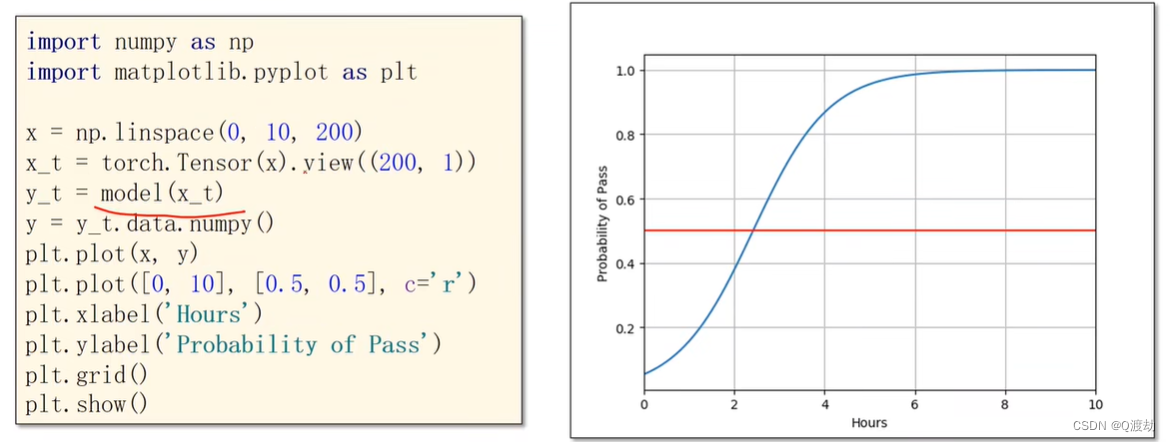

3、绘图

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?