MultiGradICON

1.介绍

1)选择多通道相似性度量。2)将多通道配准任务纳入训练。3)探索基于多通道配准网络输入的单模、多通道和随机化的图像相似性损失策略来扩展uniGradICON。

相似性度量:最大化图像对之间的互信息(MI)+ 局部NCC(LNCC)/ 或其平方变体以及局部MI

此外还参考了 MIND通过计算图像局部邻域的自相似性来提取特征,适用于多模态图像配准。自相似性上下文MIND-SC,通过重新定义邻域布局和使用有效的量化方案来提高匹配的鲁棒性。

2.相关工作

多模态配准方法:1.通过图像合成将多模式问题转换为单模式 2.如果相同对象的已经对准的图像可用(例如,磁共振成像(MRI)中的多参数序列),则通过仅使用用于对象之间的相似性损失的单模对而将多模对作为学习公式的输入来简化多模配对 3.训练两种模式的分割模型,然后使用用于相似性损失的分割[13]。使用从图像分割计算的骰子损失来训练多模式配准网络[26,45,29,23]。这里,分割或者通过手动[26,45]、通过自动分割算法[29]或者通过标签-图像对合成[23]来获得。

3.方法

3.1结构

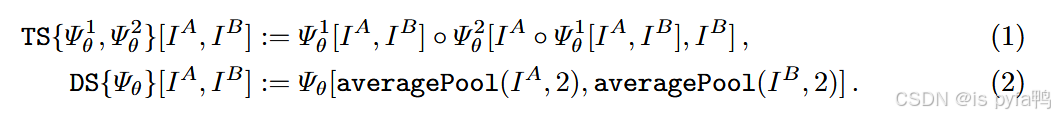

TwoStep (TS)&DownSample (DS)

两步配准 和 下采样

Φθ =

![]()

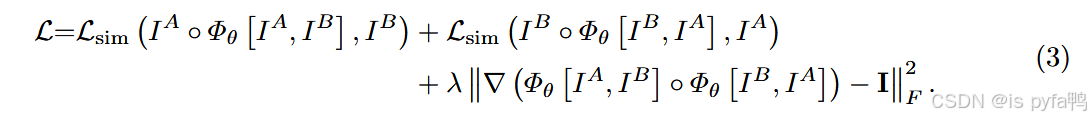

3.2训练损失

1-LNCC2(负平方的局部正则化互相关):作为图像相似性指标。通过平方操作,增强了对局部区域内的相似性度量,使得配准过程更加敏感于局部细节,从而提高多模态图像配准的精度。因此,它更适合一般的多峰图像配准。

MIND-SSC(带自相似性上下文的模态独立邻域描述符):适用于多模态任务,尤其是在模态差异较大的情况下。

1)为每个患者挑选一个特定模式并继续进行多模式图像相似性损失;或者2)如果所有患者具有相同的模式集以简单地使用矢量值图像。

为每个患者选择一个随机的模式作为深度配准网络的输入,并选择另一个随机的模式来计算多模式相似性损失。在预期中,该策略将使用所有可能的输入和损失组合来训练网络。

Pi 代表病人 (ILA,ILB)用于相似性计算,(IA,IB)用于预测变形场

实例优化(Instance Optimization, IO) 是一种用于进一步提升配准精度的技术。它通常在预训练模型的基础上,针对特定的图像对进行微调,以优化配准结果。

3.3数据

随机翻转输入图像并应用随机仿射变换;当使用在T1w MRIs上训练的网络时,倒置0-1标准化CT扫描(1-CT)可以增强CT图像的分割准确性,这表明倒置CT扫描可能更类似于T1 w MRI

4.结果

基于图像相似性损失计算策略的三种不同的方法:1)基线多GradICON-B方法,输入和损失计算使用相同模态。2)多GradICON-F,损失计算随机选择相同模态。3)多GradICON-R,损失计算随机选择不同模态。

4.1单模态表现

表2 使用不同相似性损失函数(如 1−LNCC² 和 MIND-SSC)以及是否进行实例优化(Instance Optimization, IO)的实验结果。

COPDGene(肺部CT);HCP(大脑T1w MRI);L2R Abdomen(腹部CT);OAI(膝盖MRI); mTRE(平均靶标注册误差,单位为毫米):用于评估配准精度,值越小表示配准效果越好。%|J|<0:表示雅可比行列式小于零的体素百分比,用于评估变换的可逆性,值越小越好。

-

uniGradICON 在其训练数据集上表现优异,尤其是在单模态任务中,例如在 COPDGene 和 L2R Abdomen 数据集上,其mTRE和DICE分数优于multiGradICON的变体。

-

multiGradICON 在其训练数据集中表现稍逊于uniGradICON,但在多模态任务中表现更好。例如,在 HCP 数据集上,multiGradICON的DICE分数显著高于uniGradICON。

-

相似性损失函数的影响:使用1−LNCC²作为损失函数时,uniGradICON和multiGradICON的性能普遍优于使用MIND-SSC的情况。这表明1−LNCC²更适合这些数据集。

-

实例优化(IO):经过50步实例优化后,multiGradICON和uniGradICON之间的性能差距显著缩小。例如,在 COPDGene 数据集上,经过IO后,multiGradICON的mTRE与uniGradICON的差距从约3mm缩小到约0.19mm。

-

模态选择策略的影响:multiGradICON-F(固定模态损失计算)在单模态任务中表现更好,但在多模态任务中表现较差。而multiGradICON-R(随机模态损失计算)在多模态任务中表现更好,但在单模态任务中稍逊一筹。

总的来说:multiGradICON 虽然在单模态任务中稍逊于 uniGradICON,但在多模态任务中表现出色,尤其是在模态差异较大时。此外,相似性损失函数的选择和模态选择策略对配准性能有显著影响。通过实例优化,multiGradICON能够进一步提升性能,缩小与uniGradICON的差距。

表3 multiGradICON 在单模态配准任务中的性能表现,特别是在那些 uniGradICON 训练过程中未见过的单模态数据集上。

HCP(Human Connectome Project):大脑 T1w/T2w MRI;Brats-Reg:大脑 T1w/T1ce/T2w/FLAIR MRI;UK Biobank:颈部到膝盖的 T2w MRI 和 DIXON MRI(水/脂肪分离)。

表三表明,multiGradICON 在单模态任务中能够很好地泛化到未见过的模态,尤其是在使用随机化损失计算策略时。与 uniGradICON 相比,multiGradICON 在新模态上的表现接近甚至更好,尤其是在经过实例优化后。这验证了 multiGradICON 在多模态和单模态任务中的通用性和鲁棒性。

5.结论及有待改进的地方

证明了相似度损失随机化可以带来多模式注册的好处。

只研究了使用1−LNCC2作为训练损失,而存在许多其他多峰相似性度量。MultiGradICON不能可靠地在Dixon脂肪和水图像之间配准。在这种情况下,使用分割作为图像相似性损失的一部分可能会显示出好处。一般来说,用分段或模拟数据进行网络输入和相似性损失的训练可能是今后工作的一个富有成效的途径。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?