前言

文的文字及图片来源于网络,仅供学习、交流使用,不具有任何商业用途,版权归原作者所有,如有问题请及时联系我们以作处理。

作者:一棵程序树

PS:如有需要Python学习资料的小伙伴可以加点击下方链接自行获取http://t.cn/A6Zvjdun

我们以财经分栏为例,这里我们观察网页源码可以看到这些新闻的排布都是放在一个无序列表中,每一条新闻都是一个li,那么我们只要获取了所有的li(即li对应的ul)就能进一步解析。所以我们通过beautfulsoup来解析源码。那么获取所有li就很简单了,一行代码

二、首页要爬取的内容(上图绿色方框中的内容)

1、详情页的链接地址(一行代码)

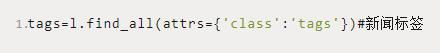

2、该条新闻所属的标签(一行代码)

那么步骤如下:

2.1 先定义我们获取网页源码的函数</

Python爬虫实践:腾讯热点新闻爬取与词频分析

Python爬虫实践:腾讯热点新闻爬取与词频分析

本文介绍了如何使用Python爬取腾讯网的热点新闻,包括获取首页内容、解析详情页、数据更新和词频统计。通过BeautifulSoup解析HTML,筛选新闻链接和标签,同时避免重复数据,最后对新闻内容进行词频统计。

本文介绍了如何使用Python爬取腾讯网的热点新闻,包括获取首页内容、解析详情页、数据更新和词频统计。通过BeautifulSoup解析HTML,筛选新闻链接和标签,同时避免重复数据,最后对新闻内容进行词频统计。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+