你们好,我是金金金。

场景

最近

DeepSeek那是相当的火啊,我们也本地部署个耍耍呗~话不多说,开搞!

下载

Ollama

- 是什么?

Ollama是一个开源的大型语言模型(LLM)平台,旨在让用户能够轻松地在本地运行、管理和与大型语言模型进行交互

根据不同环境下载不同版本,下载地址:https://ollama.com/download

- 下载好了直接安装即可,安装也很简单 下一步下一步即可。

- Ollama貌似是没有让你选择安装目录的直接给你安装到C盘了,有一种方法可以自定义

- 在你下载好的程序目录当中,打开

cmd,输入命令符安装 - 然后在

cmd窗口输入:OllamaSetup.exe /DIR=E:\MySoftware\Ollama

语法:软件名称 /DIR=这里放你上面创建好的Ollama指定目录

然后

Ollama就会进入安装,点击Install后,可以看到Ollama的安装路径就变成了我们指定的目录了

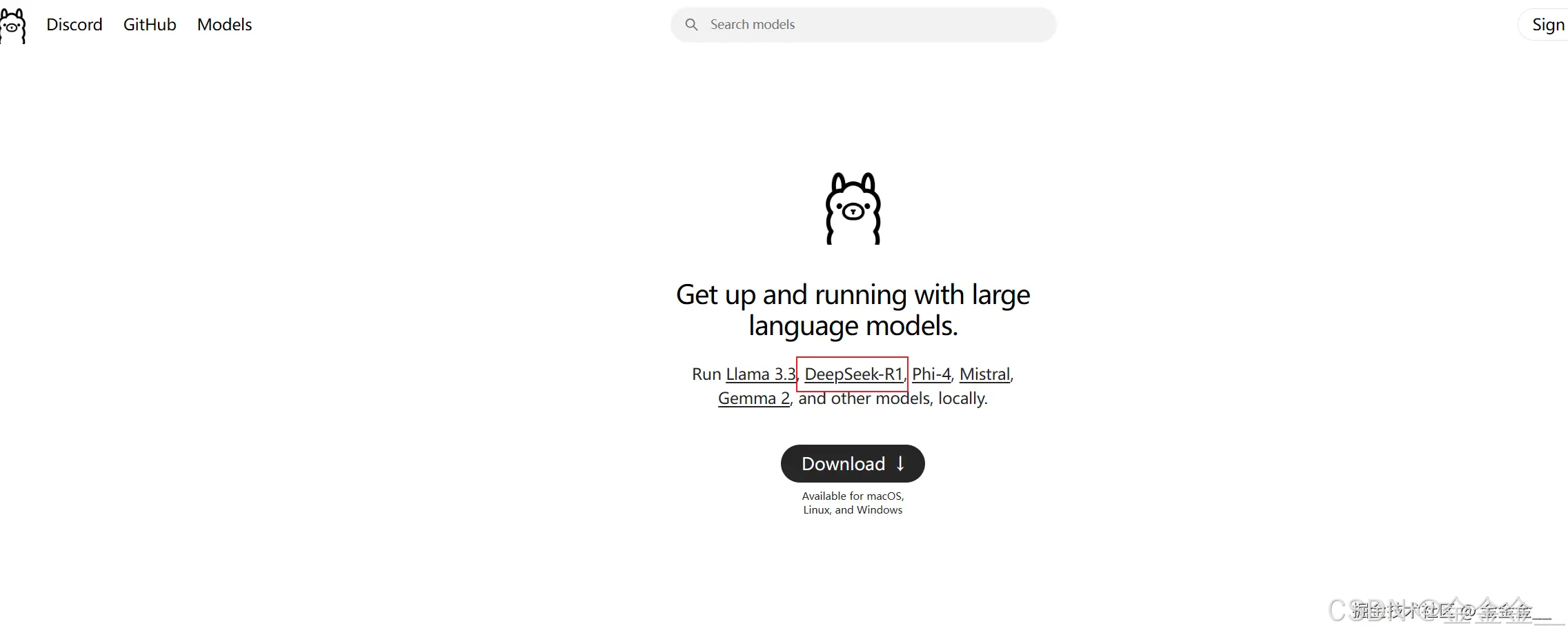

进入Ollama官网

- 进入

Ollama官方网站后,可以看到Ollama已经支持DeepSeek-R1的部署

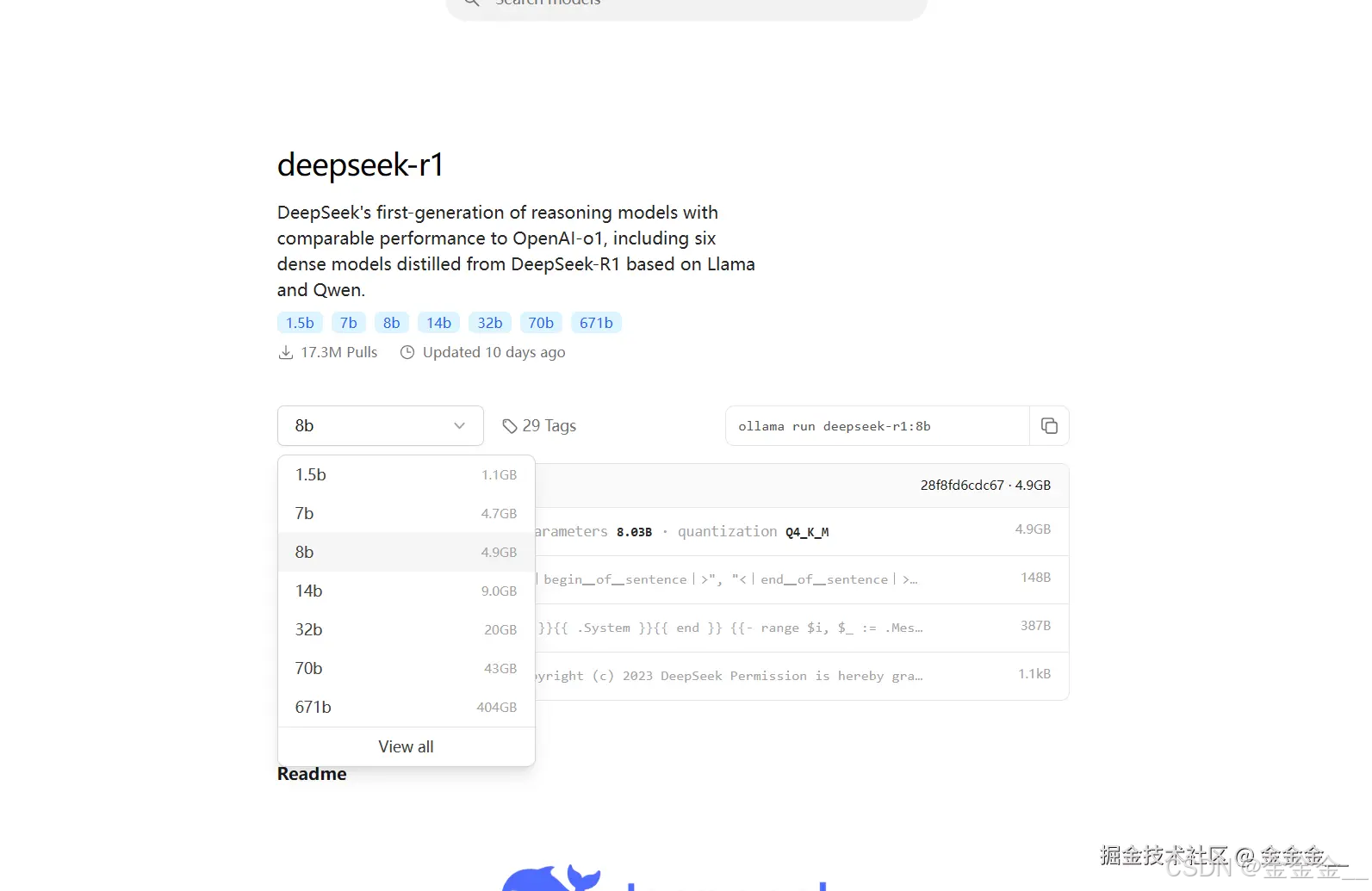

- 点击

DeepSeek-R1的链接可以看到有关deepseek-r1的详细介绍

-

目前

deepseek-r1模型大小提供了7个选择:1.5b、7b、8b、14b、32b、70b、671b,根据你们自己电脑的配置选择需要安装的模型,我这里选择的是8b模型(通常模型大小(参数量)越大,模型的理解和生成能力越强,但也会消耗更多的计算资源) -

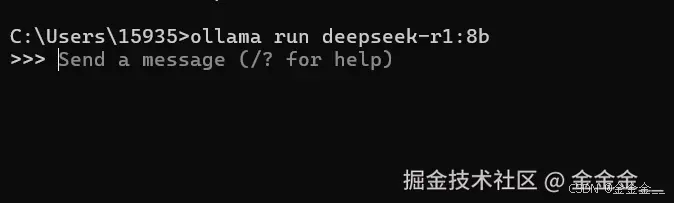

复制对应的命令 在cmd命令窗口中执行即可

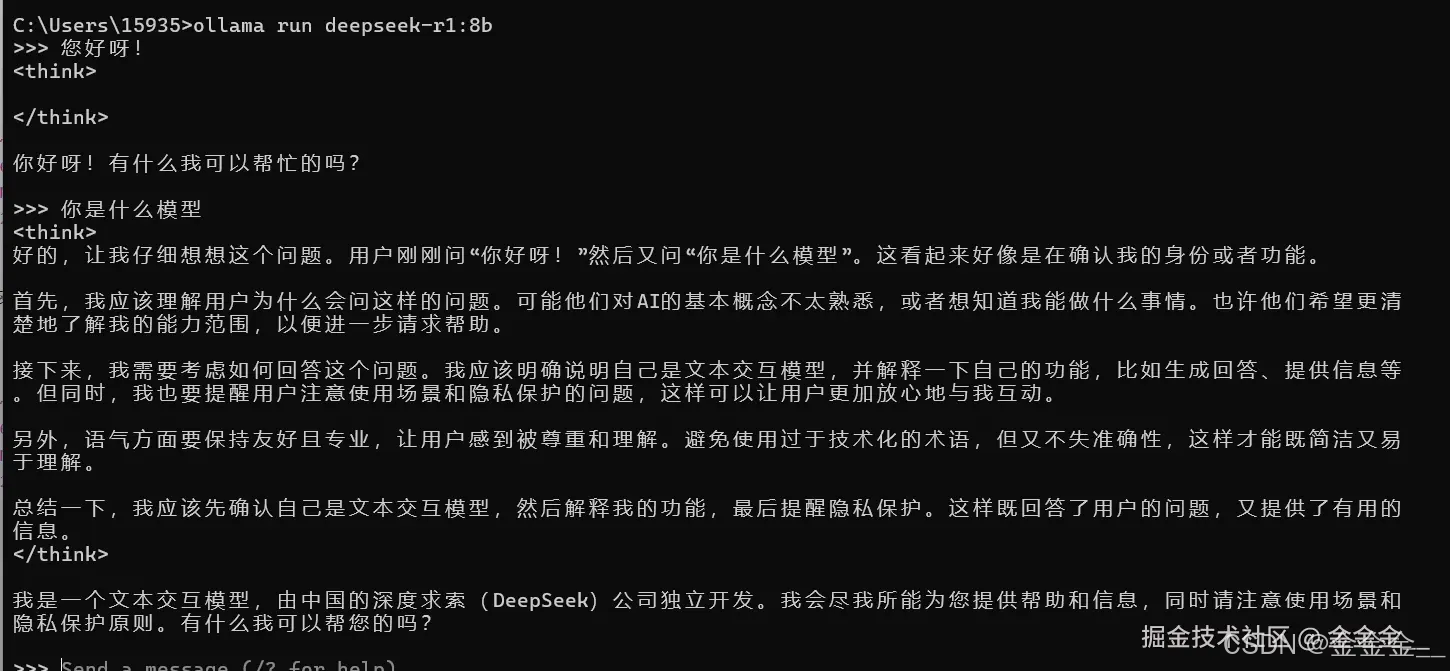

- 静静等就行(可能需要挂梯子),以下图片为安装好之后的效果

- 发个信息测试

如此就成功了!

可视化

在命令行交互可读性太差了,而且操作特别不方便,所以还需要一个可视化ui页面,我这里使用的是

Chatbox

Chatbox AI是一款AI客户端应用和智能助手,支持众多先进的AI模型和API,可在Windows、MacOS、Android、iOS、Linux和网页版上使用

- 下载

Chatbox客户端,下载地址:https://chatboxai.app/zh#

- 下载好了打开软件如下:

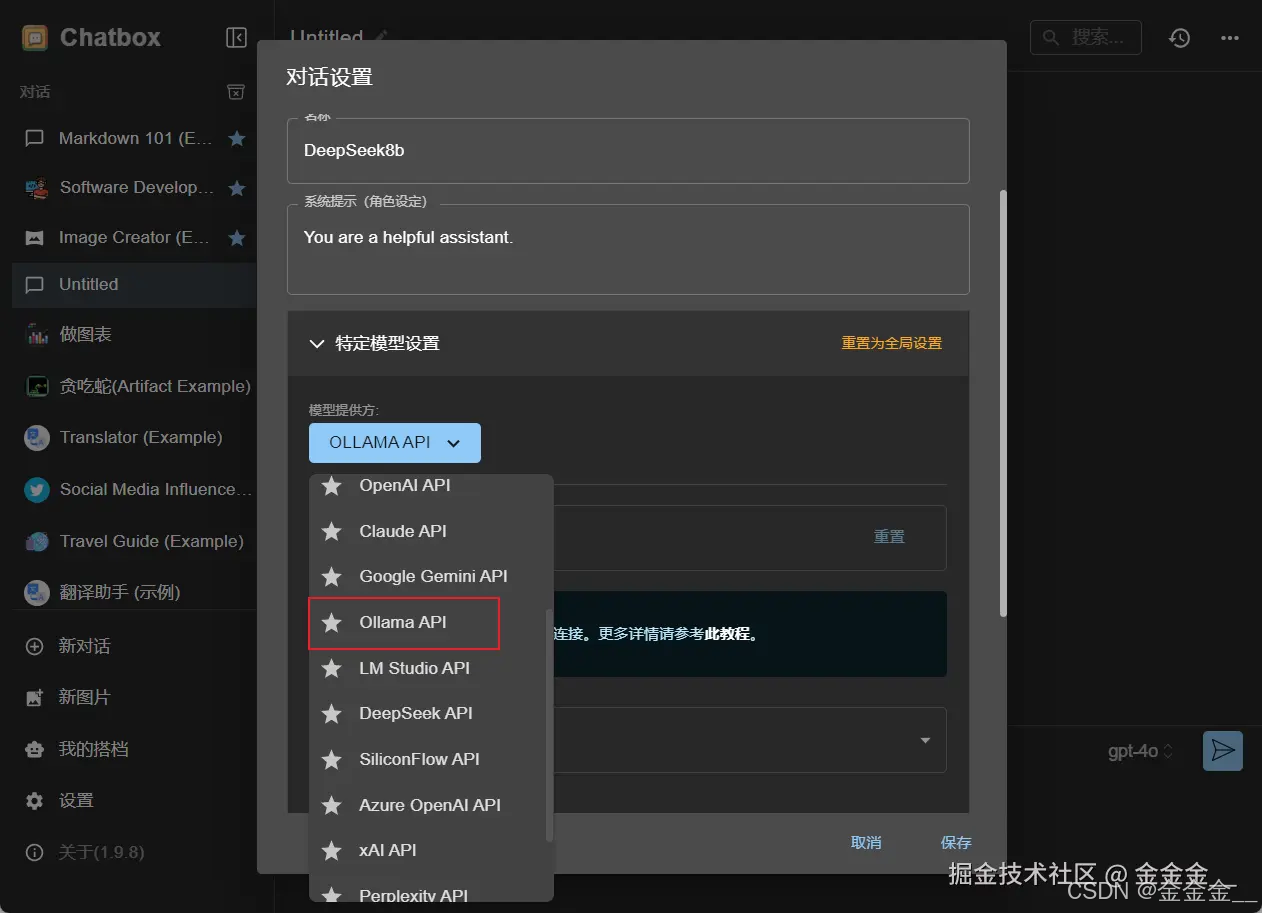

- 使用本地我们下载好的

DeepSeek模型,对话设置-模型提供方选择Ollama API

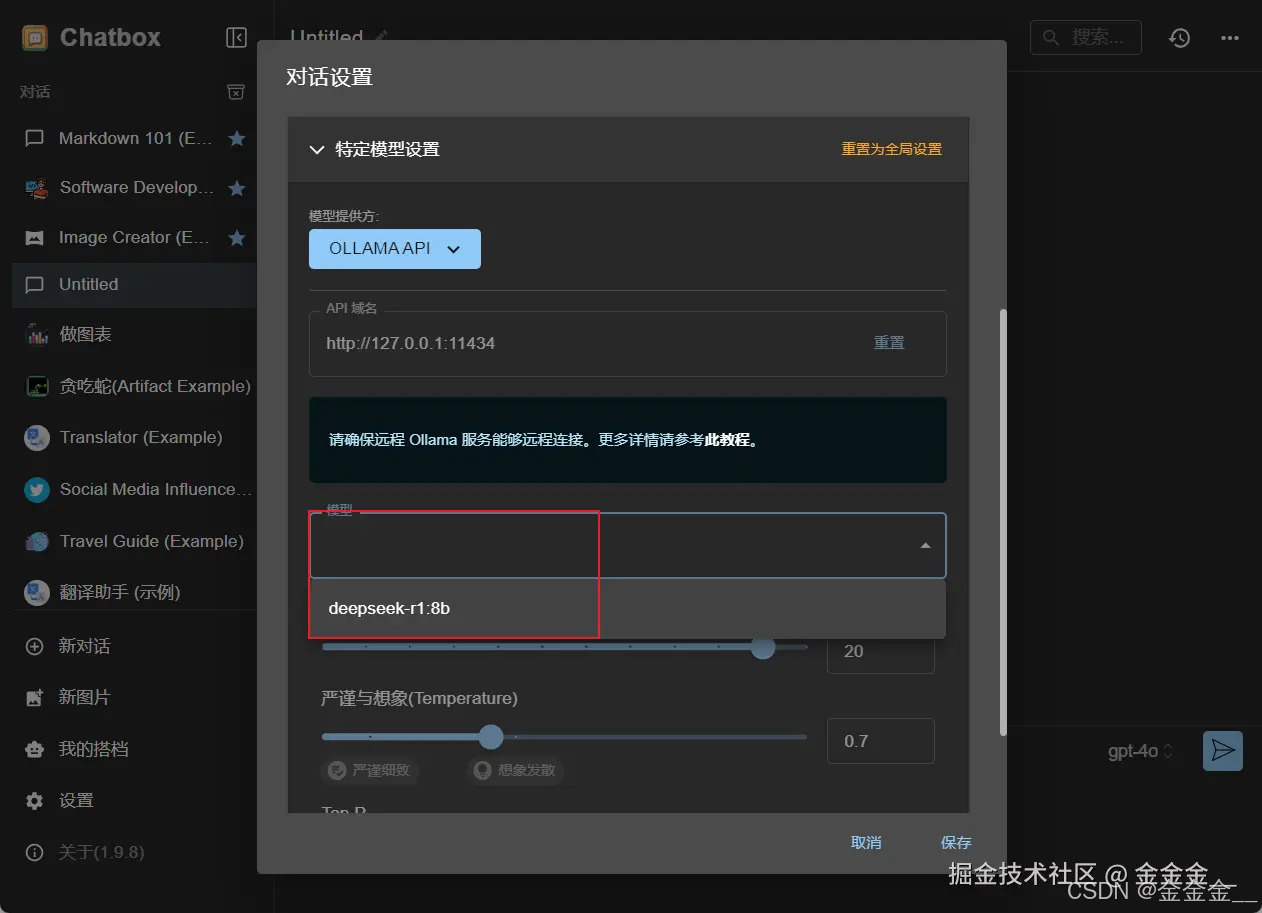

- 模型选择你本地下载的即可,点击保存

- 测试

开始使用吧!

总结

- 下载Ollama

- 下载指定模型

- 下载AI可视化客户端

- 选择本地模型

- 编写有误还请大佬指正,万分感谢。

212

212

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?