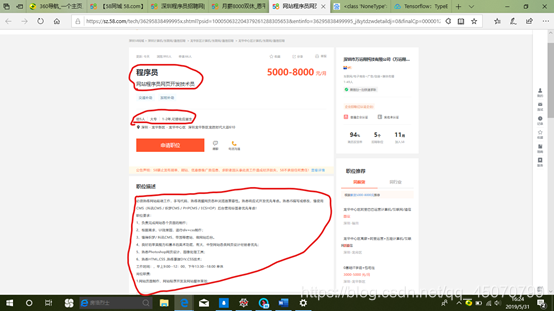

从招聘网站招聘者的角度上,分析程序员工作能力的需求,利用python的requests,BeautifulSoup4和正则来爬取深圳58同城程序员的招聘信息,数据分析则以云词图展示,主要用jieba、worldcloud,pandas这几个包来生成云词图。

一、数据爬取分成四部分:

整理好网站的头部信息,保证请求时,可以正常获取网页信息

获得二级网址的网址列表,此处是对一级网址进行解析,寻找一级网址里面包含的各个招聘信息并生成对应的网址列表

对二级网址中的指定标签进行爬取

建立csv文件

二、云词图生成分成四部分:

创建文件和停用词组,以便后面的停用词判断

词频统计,用pandans进行统计

设置云词属性

生成词云

数据爬取

第一部分,获取头部信息,对于大多数网页,若想用requests这个包爬取其中的信息,在请求时务必加网页头部信息和关闭重定向!!获取头部信息这里给出两种办法,第一种是直接从网页代码获取,让头部信息变成字典样式

def headers_information(h):

lst=headers.split('\n')

m=[]

for i in lst:

key=i.split(':')[0]

value=i.split(':')[1]

m.append([str(key),value])

return(dict(m))

print(headers_information(headers))

第二种直接添加

h={"User-Agent" : "User-Agent:Mozilla/5.0(compatible; MSIE 9.0; Windows NT 6.1; Trident/5.0;"},

r=requests.get(url, allow_redirects=False,headers=h)

第二部分,获得二级网址的网址列表,确定了一级网址以后,这里有个页码的问题,因为我们要爬取多页,所以用for循环遍历页码数,用BeautifulSoup对爬取而来的n个一级网址进行解析,

def url_analysis(u,s,h,n):

'''

用于分析网页,最后得到一个含有二级网址的标签列表

u:起始网址

s:二级网址包含的特定字段

n:页码

h:头部信息

'''

m=[]

for i in range(1,n+1):

r=requests.get(url=u+str(i)+'/',allow_redirects=False,headers=h)

soup=BeautifulSoup(r.text,'lxml')

r2=soup.find_all('a',href=re.compile(s))

for j in r2:

r3=j.attrs['href']

m.append(r3)

return(m)

第三部分,对二级网址中的指定标签进行爬取,这里爬取以下部分,另外注意一点,获取的有些二级网址对应的标签为空,此时会返回None,我们也要进行判断

def content(u,h):

'''

爬取标签信息

u:二级网址

h:头部信息

'''

r=requests.get(url=u,allow_redirects=False,headers=h)

soup=BeautifulSoup(r.text,'lxml')

t=soup.find('span',class_='pos_title')

name=soup.find('span',class_='pos_name')

number=soup.find('span',class_="item_condition pad_left_none")

stu=soup.find('span',class_="item_condition")

exprience=soup.find('span',class_="item_condition border_right_None")

discribe=soup.find('div',class_="posDes")

m=[t,',',name,',',number,',',stu,',',exprience,',',discribe,',','\n']

if m[0]!=None:

return[m[0].text,',',m[2].text,',',m[4].text,',',m[6].text,',',m[8].text,',',m[10].text,',','\n']

else:

return[None, ',', None, ',', None, ',', None, ',', None, ',', None, ',','\n']

第四部分,建立csv文件,注意,列表要是有None是写不进去会报错的,所以我们也要进行筛选

f=open(r'C:\Users\格格巫\Desktop\txt1.csv','w+',encoding='utf-8')

f.seek(0)

f.write('title,name,number,stu,exprience,discribe\n')

for i in url_analysis(web_u,web_s,h,n):

data=content(i,h)

if data[0]!=None:

f.writelines(data)

print(data)

else:

continue

f.close()

数据分析

这里主要用的两个库是jieba和wordcloud,jieba 是一个python实现的中文分词组件,它有三种模式,今天我们使用是它的普通模式,wordcloud是python制作云词图的库,在统计了词频的频数后,我们准备用云词图的形式展现,云词图中字体大的,说明统计得出的频数越高,先把爬取下来的csv文件整理一下,把文件的汉字都去掉,留下招聘者对应聘者编程方面的要求

第一部分,创建文件和停用词组,进而判断关键词在不在停用词组中,若不在则记录下来

import numpy as np

import pandas as pd

import jieba

import jieba.analyse

import codecs

import os

import wordcloud

from PIL import Image

import matplotlib.pyplot as plt

pd.set_option('max_colwidth',500)

path=os.getcwd()+'/chengxuyuan58.csv'

f=open(path,encoding='UTF-8')

data=pd.read_csv(f, header=0,encoding='utf-8',dtype=str).astype(str)

segments = []

stopwords = [line.strip() for line in codecs.open('stoped.txt', 'r', 'utf-8').readlines()]

for index, row in data.iterrows():

content = row[4]

words = jieba.cut(content)

splitedStr = ''

for word in words:

#停用词判断,如果当前的关键词不在停用词库中才进行记录

if word not in stopwords:

# 记录全局分词

segments.append({'word':word, 'count':1})

splitedStr += word + ' '

第二部分,词频统计,我们主要使用pandas的DataFrame,加载、保存csv数据源,处理数组进行去重、统计

Sg = pd.DataFrame(segments)# 词频统计

Word = Sg.groupby('word')['count'].sum()#导出csv文件

Word.to_csv('keywords.csv',encoding='utf-8')#制作云词图

第三部分,设置词云属性

mask = np.array(Image.open('wordcloud.jpg')) # 定义词频背景

wc = wordcloud.WordCloud(

font_path='C:/Windows/Fonts/simhei.ttf', # 设置字体格式

mask=mask, # 设置背景图

max_words=50, # 最多显示词数

max_font_size=1000, # 字体最大值

background_color="white",)

第四部分,生成词云

wc.generate_from_frequencies(Word) # 从字典生成词云

wc.recolor(color_func=wordcloud.get_single_color_func('blue')) # 将词云颜色设置为背景图方案

plt.figure(figsize=(8,8))

plt.imshow(wc) # 显示词云

plt.axis('off') # 关闭坐标轴

plt.show() # 显示图像

总结:我们用requests去请求网站以及用BeautifulSoup进行解析,这里再次强调requests请求网页信息时,一定记得加上请求头部,至于两种请求的选择,各有千秋,爬取数据时,先确定一级网址,之后确定二级网址,最后确定需要爬取二级网址中的哪些标签,第二部分,worldcloud和jieba是生成词云的关键,jiaba用来对导入文件的分词,pandas的DataFrame加载、保存csv数据源,处理数组进行去重、统计,最后便由worldcloud生成云词图,云词中可以看出来,PHP,JavaScript,CSS,HTML,MySQL字体是比较大的,说明招聘者比较看重程序员这些方面的工作能力

本文从招聘者角度分析程序员工作能力需求,通过Python的requests、BeautifulSoup4和正则爬取深圳58同城的招聘信息,并使用jieba、wordcloud、pandas生成词云图。数据爬取包括获取头部信息、解析二级网址、爬取指定标签和建立CSV文件。数据分析阶段,首先创建停用词组,然后统计词频,最后生成突出PHP、JavaScript、CSS、HTML、MySQL等技能的词云图。

本文从招聘者角度分析程序员工作能力需求,通过Python的requests、BeautifulSoup4和正则爬取深圳58同城的招聘信息,并使用jieba、wordcloud、pandas生成词云图。数据爬取包括获取头部信息、解析二级网址、爬取指定标签和建立CSV文件。数据分析阶段,首先创建停用词组,然后统计词频,最后生成突出PHP、JavaScript、CSS、HTML、MySQL等技能的词云图。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?