爬虫基本思路

第一步:爬取网页

第二步:解析数据

第三步:保存数据

具体操作:

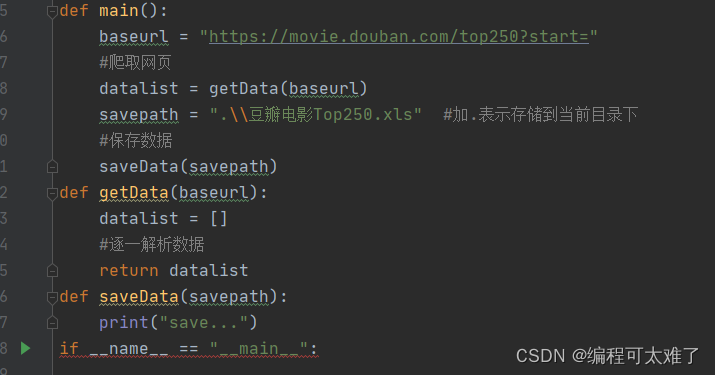

第一步:在获取网页的时候,我们要有一个baseurl作为访问对象。

baseurl = “网页地址”

datalist = getData(baseurl)

第三步:保存数据

需要有保存路径savapath

savepath = “.\存储位置.xls” 加.表示存储在当前目录下,xls表示excel存储

saveData(savepath)

定义getData函数:

def getData(baseurl)

datalist = [] 将数据存入列表中

在getData函数中进行第二步:

进行逐一处理数据

然后将数据返回给datalist

定义saveData函数:

def saveData(savepath):

编写函数体

if name == “main”: 程序入口

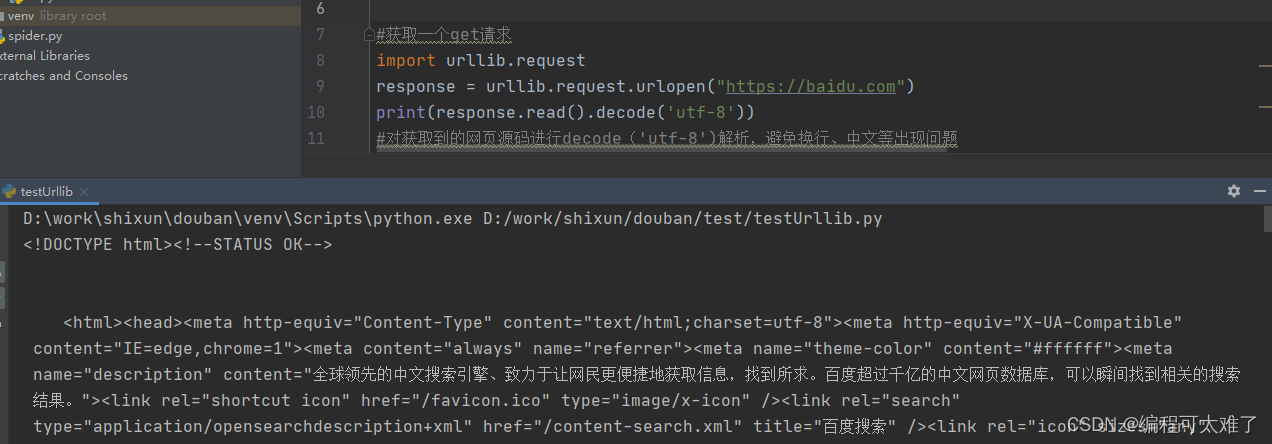

补充urllib

在当前项目中新建一个文件夹,在文件夹下新建一个test文件用来测试urllib。

获取get请求

在打开网页链接的时候,要用到urllib.request.urlopen()方法,括号中填入要打开的网址。

对访问的网页,可以用一个变量进行接收,可以直接将接收到的结果打印出来。

在打印的时候,

本文详细介绍了Python爬虫的基本思路,包括爬取网页、解析数据和保存数据的步骤。此外,还深入讲解了如何使用urllib库进行GET和POST请求,处理响应状态和头信息,以及如何设置延时和伪装身份访问网站,例如在访问豆瓣时避免被识别为爬虫。

本文详细介绍了Python爬虫的基本思路,包括爬取网页、解析数据和保存数据的步骤。此外,还深入讲解了如何使用urllib库进行GET和POST请求,处理响应状态和头信息,以及如何设置延时和伪装身份访问网站,例如在访问豆瓣时避免被识别为爬虫。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2841

2841

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?