上代码:

import requests

url = "https://www.taobao.com" #获取淘宝界面url

try:

r = requests.get(url) #获取url 的信息

r.raise_for_status()

#r.status_code是http请求的返回状态,200表示连接成功,404表示连接失败,这时该抛出异常,进行处理

r.encoding = r.apparent_encoding

#r.apparent_encoding是从内容中分析出响应的内容编码方式

print(r.text[:90000])

#r.text是url对应的页面内容,输出前部分内容

except:

print("爬取失败")

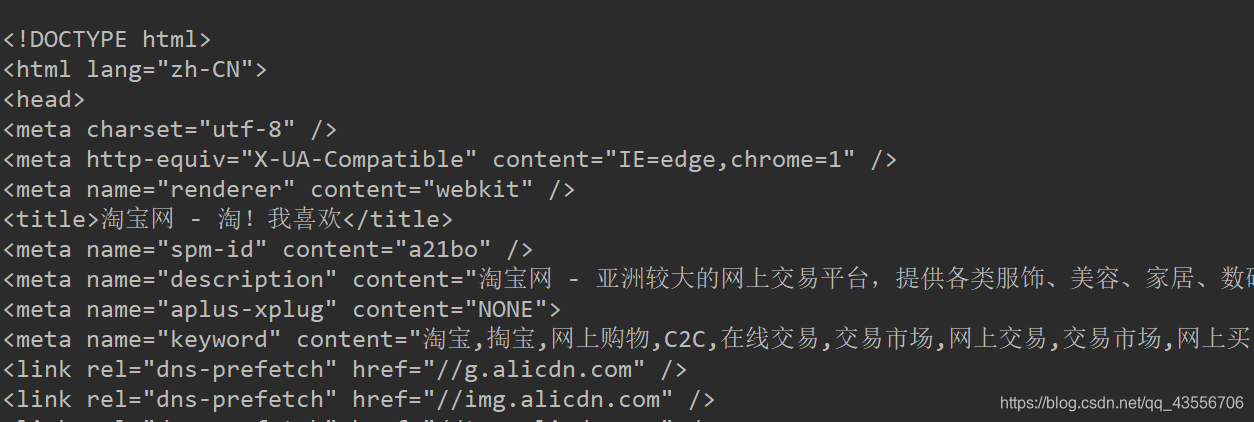

以下为部分截图内容:

本文展示了一个使用Python的requests库来爬取淘宝网站页面内容的简单示例。通过发送HTTP请求并处理响应,实现了对指定URL内容的获取与解析。

本文展示了一个使用Python的requests库来爬取淘宝网站页面内容的简单示例。通过发送HTTP请求并处理响应,实现了对指定URL内容的获取与解析。

766

766

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?