文章目录

- SpringCloudAlibaba

- 一、微服务介绍

- 二、 微服务环境搭建

- 三、 Nacos Discovery--服务治理

- 第四章 Sentinel--服务容错

- 第五章 Gateway--服务网关

- 第六章 Sleuth--链路追踪

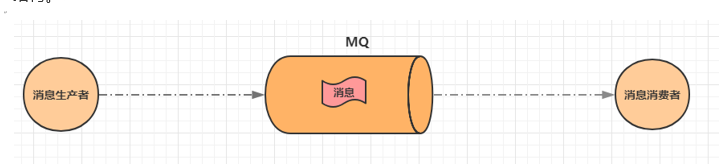

- 第七章 Rocketmq--消息驱动

- 第八章 SMS--短信服务

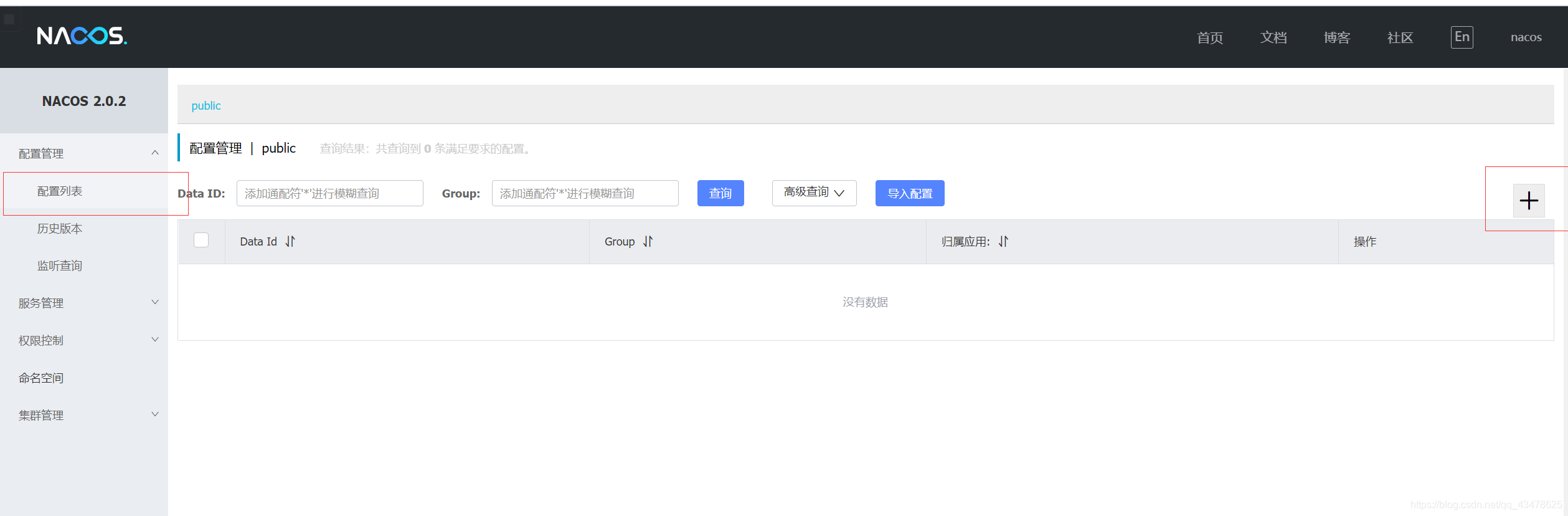

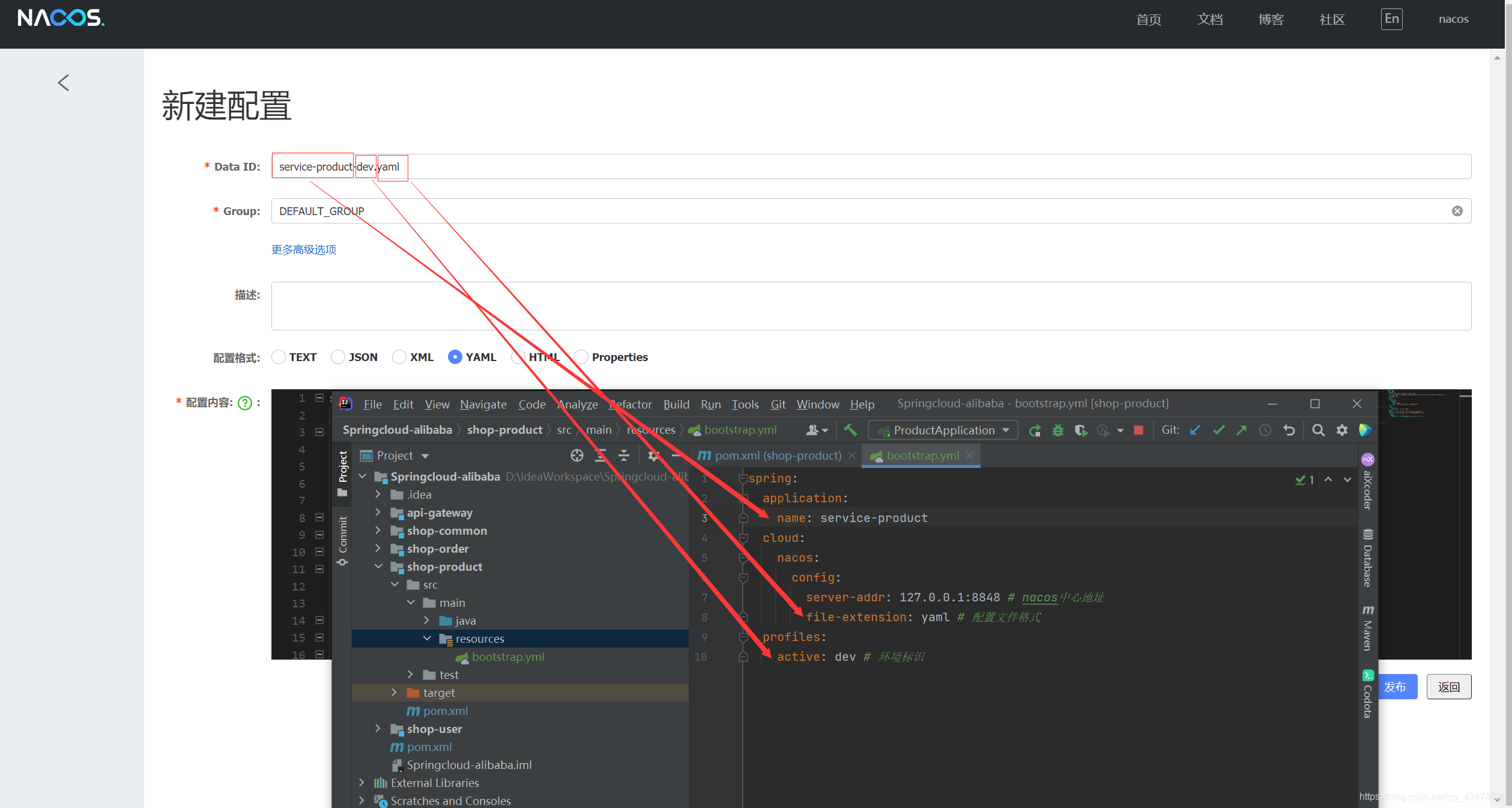

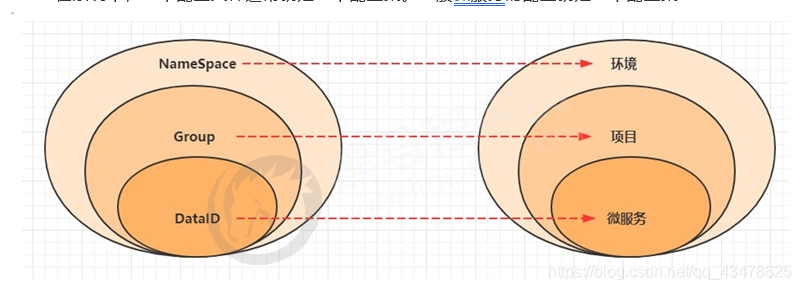

- 第九章 Nacos Config--服务配置

- 第十章 Seata--分布式事务

SpringCloudAlibaba

一、微服务介绍

1.1 系统架构演变

随着互联网的发展,网站应用的规模也在不断的扩大,进而导致系统架构也在不断的进行变化。

从互联网早起到现在,系统架构大体经历了下面几个过程: 单体应用架构--->垂直应用架构--->分布式架构

--->SOA架构--->微服务架构,当然还有悄然兴起的Service Mesh(服务网格化)。

接下来我们就来了解一下每种系统架构是什么样子的, 以及各有什么优缺点。

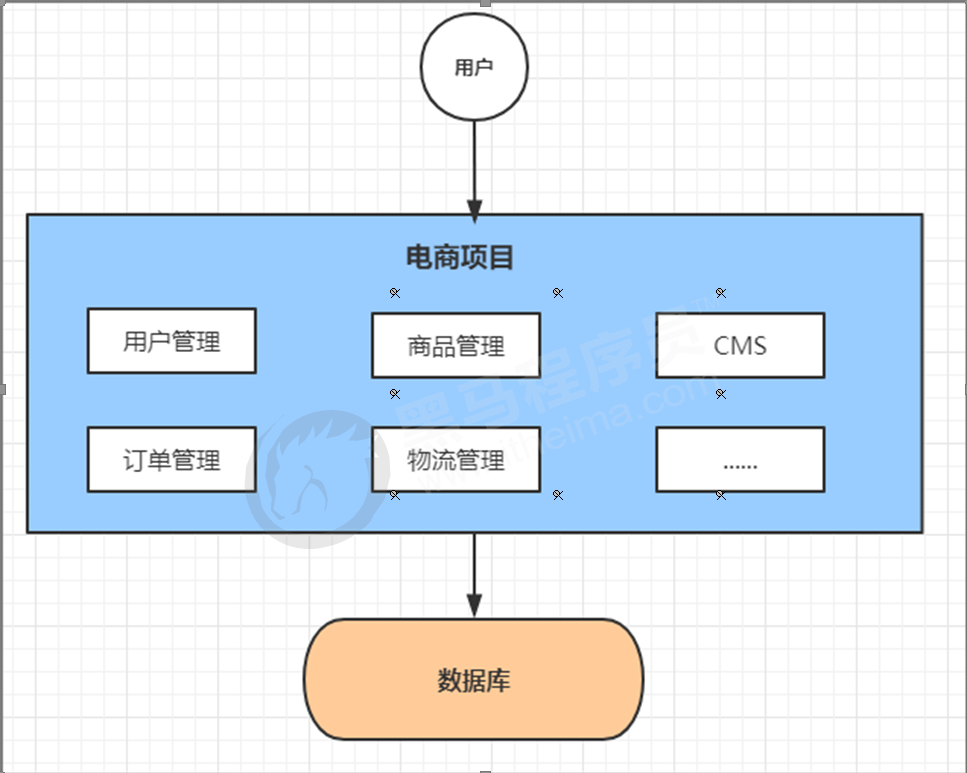

1.1.1 单体应用架构

互联网早期,一般的网站应用流量较小,只需一个应用,将所有功能代码都部署在一起就可以,这样

可以减少开发、部署和维护的成本。

比如说一个电商系统,里面会包含很多用户管理,商品管理,订单管理,物流管理等等很多模块,

我们会把它们做成一个web项目,然后部署到一台tomcat服务器上。

优点:

- 项目架构简单,小型项目的话, 开发成本低

- 项目部署在一个节点上, 维护方便

缺点:

- 全部功能集成在一个工程中,对于大型项目来讲不易开发和维护

- 项目模块之间紧密耦合,单点容错率低

- 无法针对不同模块进行针对性优化和水平扩展

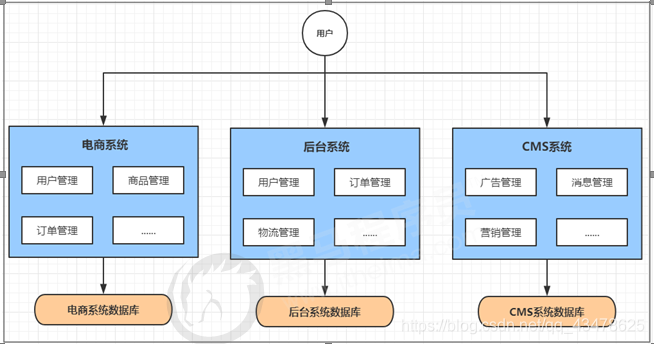

1.1.2 垂直应用架构

优点:

- 系统拆分实现了流量分担,解决了并发问题,而且可以针对不同模块进行优化和水平扩-- 展 一个系统的问题不会影响到其他系统,提高容错率

缺点: - 系统之间相互独立, 无法进行相互调用

- 系统之间相互独立, 会有重复的开发任务

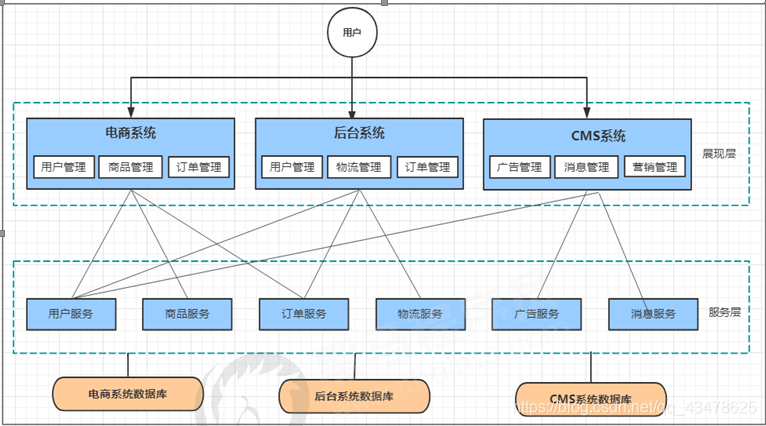

1.1.3 分布式架构

当垂直应用越来越多,重复的业务代码就会越来越多。这时候,我们就思考可不可以将重复的代码 抽取出来,做成统一的业务层作为独立的服务,然后由前端控制层调用不同的业务层服务呢?

优点:

- 抽取公共的功能为服务层,提高代码复用性

缺点: - 系统间耦合度变高,调用关系错综复杂,难以维护

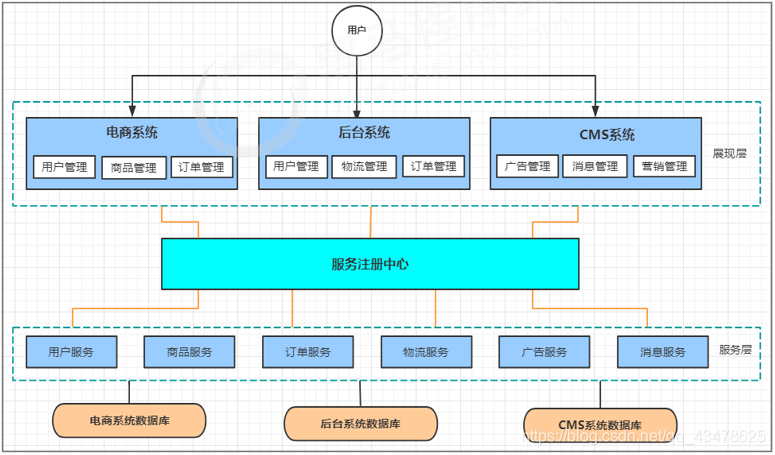

1.1.4 SOA架构

在分布式架构下,当服务越来越多,容量的评估,小服务资源的浪费等问题逐渐显现,此时需增加 一个调度中心对集群进行实时管理。此时,用于资源调度和治理中心(SOA Service Oriented Architecture,面向服务的架构)是关键。

优点:

- 使用注册中心解决了服务间调用关系的自动调节

缺点: - 服务间会有依赖关系,一旦某个环节出错会影响较大( 服务雪崩 )

- 服务关心复杂,运维、测试部署困难

1.1.5 微服务架构

使用注册中心解决了服务间调用关系的自动调节

优点:

- 服务原子化拆分,独立打包、部署和升级,保证每个微服务清晰的任务划分,利于扩展

- 微服务之间采用Restful等轻量级http协议相互调用

缺点:

- 分布式系统开发的技术成本高(容错、分布式事务等)

1.2 微服务架构介绍

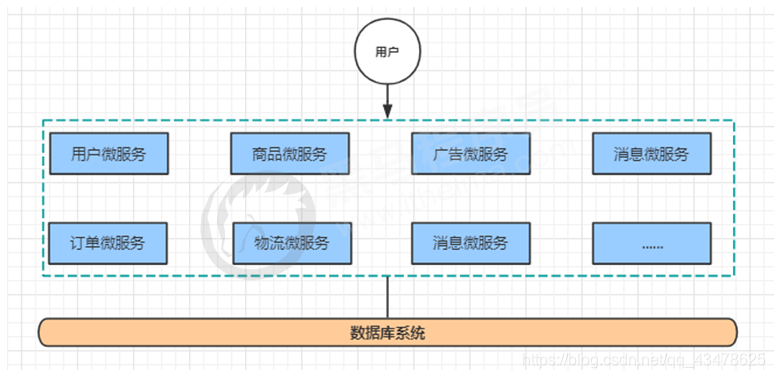

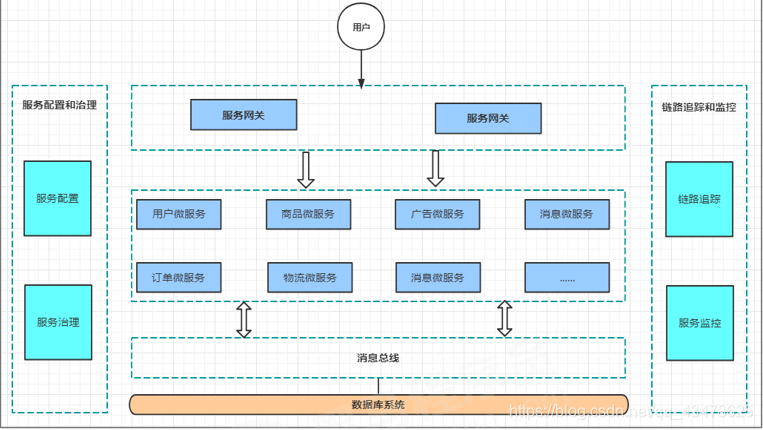

微服务架构, 简单的说就是将单体应用进一步拆分,拆分成更小的服务,每个服务都是一个可以独立运行的项目

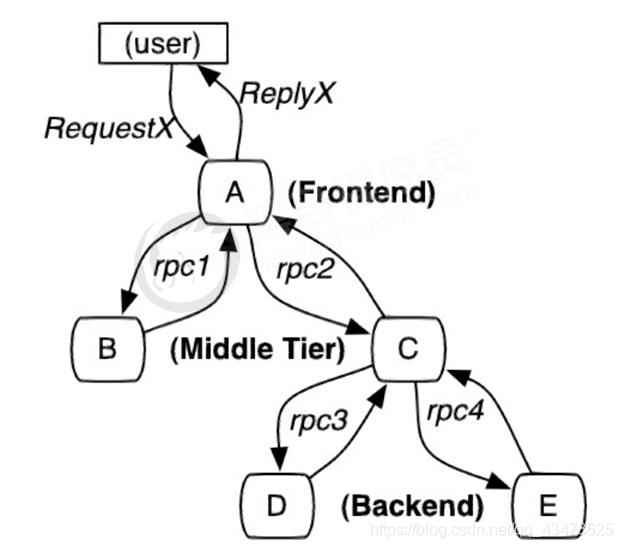

1.2.1 微服务架构的常见问题

一旦采用微服务系统架构,就势必会遇到这样几个问题:

- 这么多小服务,如何管理他们?(服务治理 注册中心[服务注册 发现 剔除])

- 这么多小服务,他们之间如何通讯?(restful rpc)

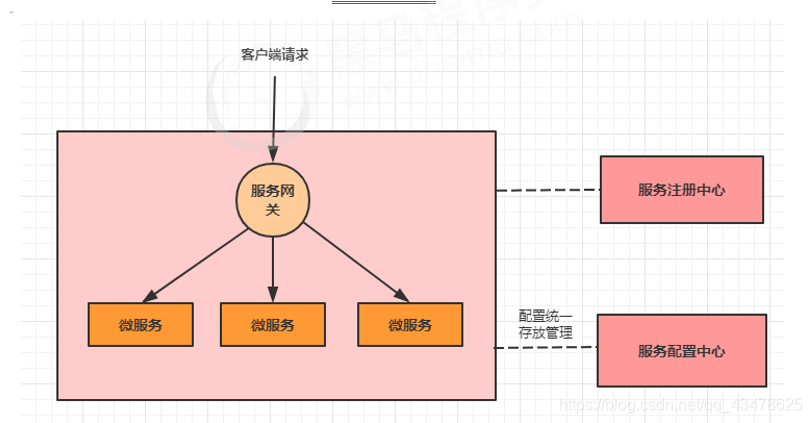

- 这么多小服务,客户端怎么访问他们?(网关)

- 这么多小服务,一旦出现问题了,应该如何自处理?(容错)

- 这么多小服务,一旦出现问题了,应该如何排错? (链路追踪)

对于上面的问题,是任何一个微服务设计者都不能绕过去的,因此大部分的微服务产品都针对每一 个问题提供了相应的组件来解决它们。

1.2.2 微服务架构的常见概念

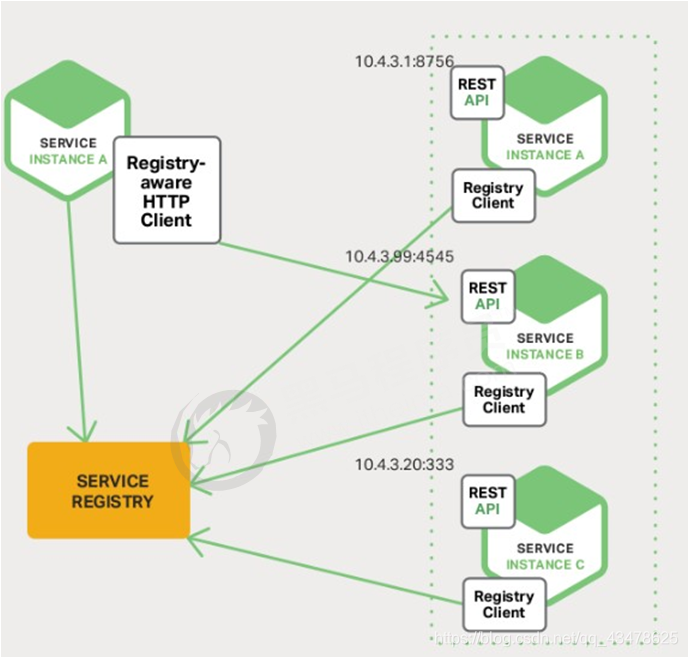

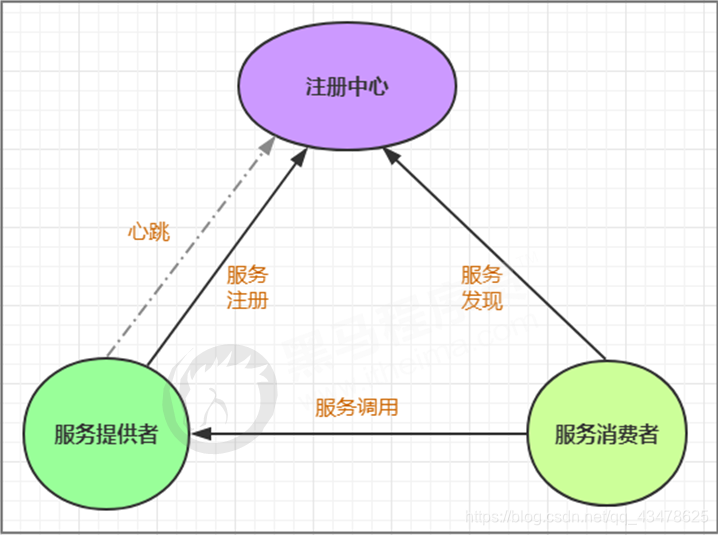

1.2.2.1 服务治理

服务治理就是进行服务的自动化管理,其核心是服务的自动注册与发现。

服务注册:服务实例将自身服务信息注册到注册中心。

服务发现:服务实例通过注册中心,获取到注册到其中的服务实例的信息,通过这些信息去请求它们提 供的服务。

服务剔除:服务注册中心将出问题的服务自动剔除到可用列表之外,使其不会被调用到。

1.2.2.2 服务调用

在微服务架构中,通常存在多个服务之间的远程调用的需求。目前主流的远程调用技术有基于HTTP的RESTful接口以及基于TCP的RPC协议。

- REST(Representational State Transfer)

这是一种HTTP调用的格式,更标准,更通用,无论哪种语言都支持http协议 - RPC(Remote Promote Call)

一种进程间通信方式。允许像调用本地服务一样调用远程服务。RPC框架的主要目标就是让远程服 务调用更简单、透明。RPC框架负责屏蔽底层的传输方式、序列化方式和通信细节。开发人员在使 用的时候只需要了解谁在什么位置提供了什么样的远程服务接口即可,并不需要关心底层通信细节 和调用过程。

区别和联系

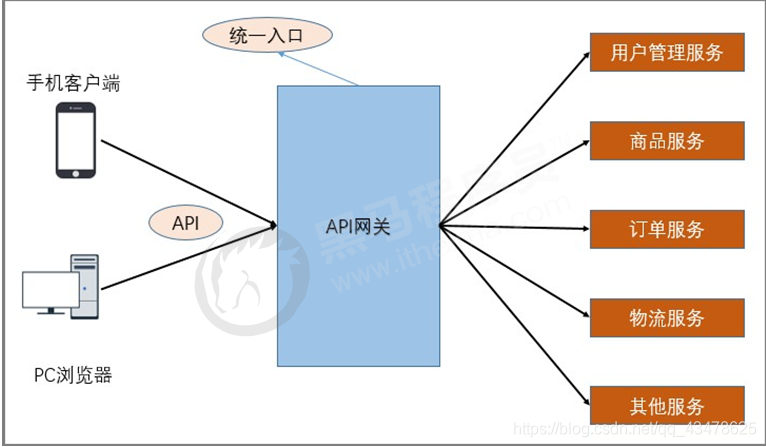

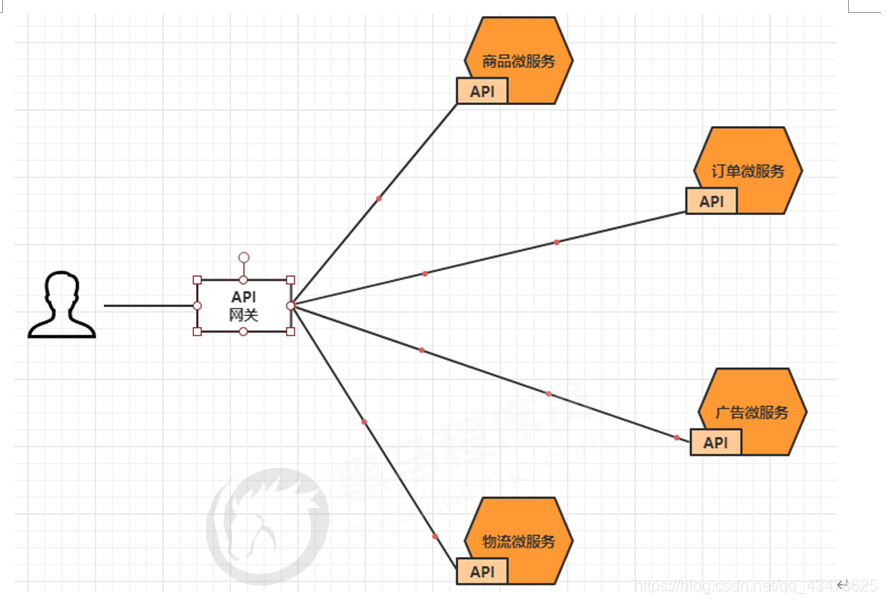

1.2.2.3 服务网关

随着微服务的不断增多,不同的微服务一般会有不同的网络地址,而外部客户端可能需要调用多个 服务的接口才能完成一个业务需求,如果让客户端直接与各个微服务通信可能出现:

- 客户端需要调用不同的url地址,增加难度

- 在一定的场景下,存在跨域请求的问题

- 每个微服务都需要进行单独的身份认证

针对这些问题,API网关顺势而生。

API网关直面意思是将所有API调用统一接入到API网关层,由网关层统一接入和输出。一个网关的 基本功能有:统一接入、安全防护、协议适配、流量管控、长短链接支持、容错能力。有了网关之后, 各个API服务提供团队可以专注于自己的的业务逻辑处理,而API网关更专注于安全、流量、路由等问题。

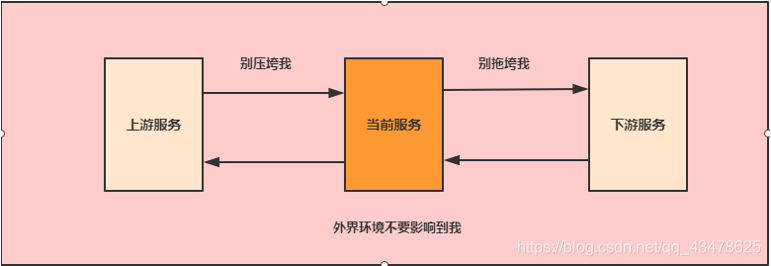

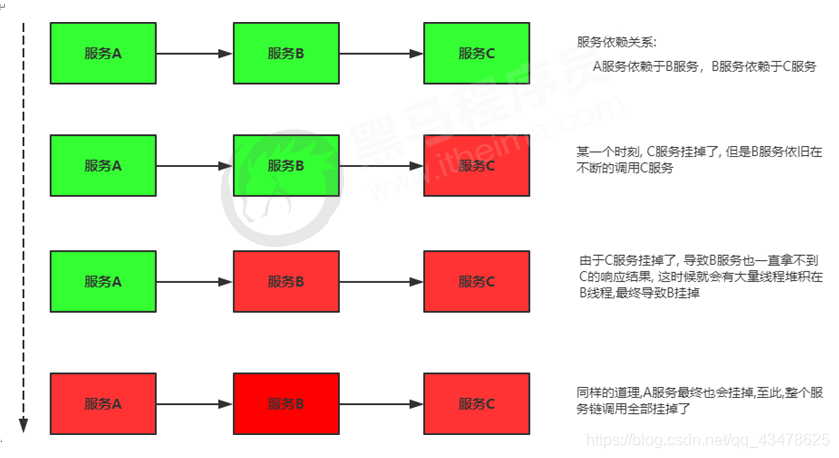

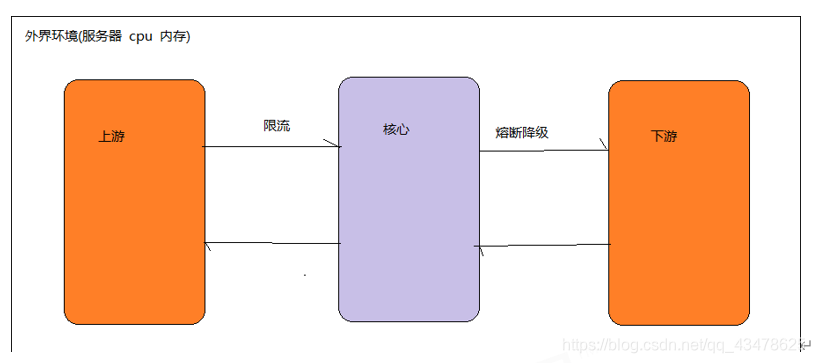

1.2.2.4 服务容错

在微服务当中,一个请求经常会涉及到调用几个服务,如果其中某个服务不可用,没有做服务容错 的话,极有可能会造成一连串的服务不可用,这就是雪崩效应。

我们没法预防雪崩效应的发生,只能尽可能去做好容错。服务容错的三个核心思想是:

- 不被外界环境影响

- 不被上游请求压垮

- 不被下游响应拖垮

1.2.2.5 链路追踪

随着微服务架构的流行,服务按照不同的维度进行拆分,一次请求往往需要涉及到多个服务。互联 网应用构建在不同的软件模块集上,这些软件模块,有可能是由不同的团队开发、可能使用不同的编程 语言来实现、有可能布在了几千台服务器,横跨多个不同的数据中心。因此,就需要对一次请求涉及的 多个服务链路进行日志记录,性能监控即链路追踪

1.2.3 微服务架构的常见解决方案

1.2.3.1 ServiceComb

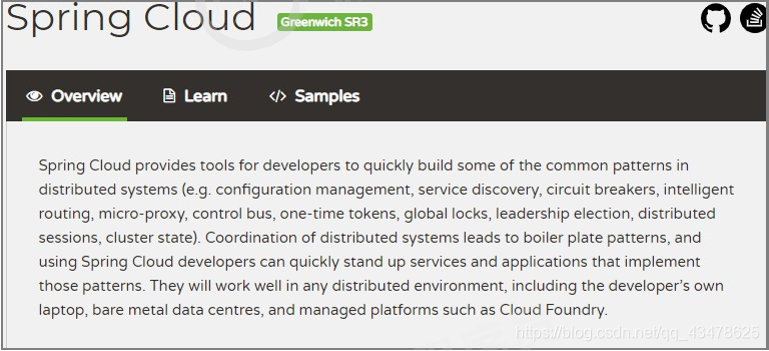

1.2.3.2 SpringCloud

Spring Cloud是一系列框架的集合。它利用Spring Boot的开发便利性巧妙地简化了分布式系统基础设施的开发,如服务发现注册、配置中心、消息总线、负载均衡、断路器、数据监控等,都可以用Spring Boot的开发风格做到一键启动和部署。

Spring Cloud并没有重复制造轮子,它只是将目前各家公司开发的比较成熟、经得起实际考验的服务框架组合起来,通过Spring Boot风格进行再封装屏蔽掉了复杂的配置和实现原理,最终给开发者留出了一套简单易懂、易部署和易维护的分布式系统开发工具包。

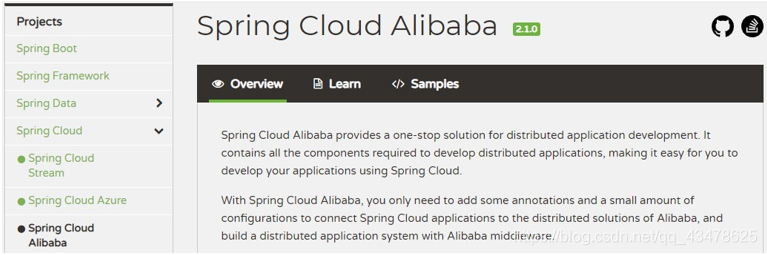

1.2.3.3 SpringCloud Alibaba

Spring Cloud Alibaba 致力于提供微服务开发的一站式解决方案。此项目包含开发分布式应用微服务的必需组件,方便开发者通过 Spring Cloud 编程模型轻松使用这些组件来开发分布式应用服务。

1.3 SpringCloud Alibaba介绍

Spring Cloud Alibaba 致力于提供微服务开发的一站式解决方案。此项目包含开发分布式应用微服务的必需组件,方便开发者通过 Spring Cloud 编程模型轻松使用这些组件来开发分布式应用服务。

依托 Spring Cloud Alibaba,您只需要添加一些注解和少量配置,就可以将 Spring Cloud 应用接入阿里微服务解决方案,通过阿里中间件来迅速搭建分布式应用系统。

1.3.1 主要功能

- 服务限流降级:默认支持 WebServlet、WebFlux, OpenFeign、RestTemplate、Spring Cloud Gateway, Zuul, Dubbo 和 RocketMQ 限流降级功能的接入,可以在运行时通过控制台实时修改限流降级规则,还支持查看限流降级 Metrics 监控。

- 服务注册与发现:适配 Spring Cloud 服务注册与发现标准,默认集成了 Ribbon 的支持。

- 分布式配置管理:支持分布式系统中的外部化配置,配置更改时自动刷新。

- 消息驱动能力:基于 Spring Cloud Stream 为微服务应用构建消息驱动能力。

- 分布式事务:使用 @GlobalTransactional 注解, 高效并且对业务零侵入地解决分布式事务问题。

- 阿里云对象存储:阿里云提供的海量、安全、低成本、高可靠的云存储服务。支持在任何应用、任 何时间、任何地点存储和访问任意类型的数据。

- 分布式任务调度:提供秒级、精准、高可靠、高可用的定时(基于 Cron 表达式)任务调度服务。同时提供分布式的任务执行模型,如网格任务。网格任务支持海量子任务均匀分配到所有Worker(schedulerx-client)上执行。

- 阿里云短信服务:覆盖全球的短信服务,友好、高效、智能的互联化通讯能力,帮助企业迅速搭建 客户触达通道

1.3.2 组件

- Sentinel:把流量作为切入点,从流量控制、熔断降级、系统负载保护等多个维度保护服务的稳 定性。

- Nacos:一个更易于构建云原生应用的动态服务发现、配置管理和服务管理平台。- - RocketMQ:一款开源的分布式消息系统,基于高可用分布式集群技术,提供低延时的、高可靠 的消息发布与订阅服务。

- Dubbo:Apache Dubbo™ 是一款高性能 Java RPC 框架。

- Seata:阿里巴巴开源产品,一个易于使用的高性能微服务分布式事务解决方案。

- Alibaba Cloud ACM:一款在分布式架构环境中对应用配置进行集中管理和推送的应用配置中心产品。

- Alibaba Cloud OSS: 阿里云对象存储服务(Object Storage Service,简称 OSS),是阿里云提供的海量、安全、低成本、高可靠的云存储服务。您可以在任何应用、任何时间、任何地点存储和 访问任意类型的数据。

- Alibaba Cloud SchedulerX: 阿里中间件团队开发的一款分布式任务调度产品,提供秒级、精准、高可靠、高可用的定时(基于 Cron 表达式)任务调度服务。

- Alibaba Cloud SMS: 覆盖全球的短信服务,友好、高效、智能的互联化通讯能力,帮助企业迅速搭建客户触达通道。

二、 微服务环境搭建

2.1 案例准备

2.1.1 技术选型

maven: 3.5.4

数据库: MySQL8.0

持久层: SpringData Jpa

其它: SpringCloud Alibaba 技术栈

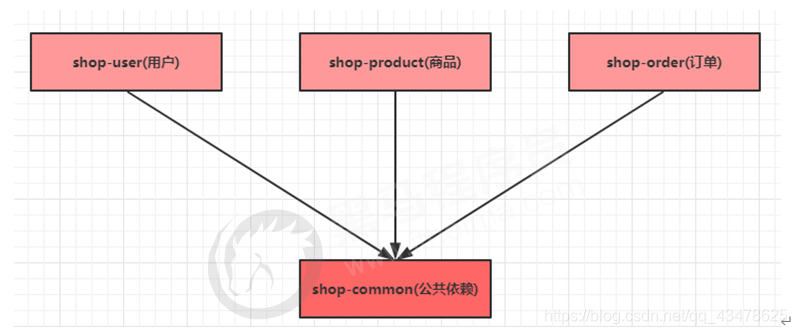

2.1.2 模块设计

springcloud-alibaba 父工程

shop-common 公共模块【实体类】

shop-user 用户微服务 【端口: 807x】

shop-product 商品微服务 【端口: 808x】

shop-order 订单微服务 【端口: 809x】

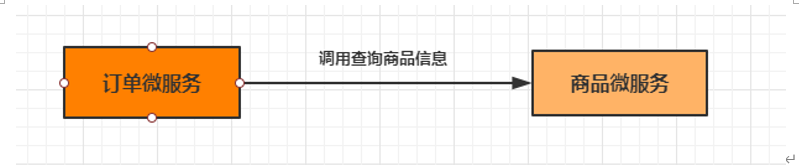

2.1.3 微服务调用

在微服务架构中,最常见的场景就是微服务之间的相互调用。我们以电商系统中常见的用户下单为 例来演示微服务的调用:客户向订单微服务发起一个下单的请求,在进行保存订单之前需要调用商品微 服务查询商品的信息。

我们一般把服务的主动调用方称为服务消费者,把服务的被调用方称为服务提供者。

在这种场景下,订单微服务就是一个服务消费者, 商品微服务就是一个服务提供者。

2.2 创建父工程

创建一个maven工程,然后在pom.xml文件中添加下面内容

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<parent>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-parent</artifactId>

<version>2.1.3.RELEASE</version>

</parent>

<groupId>com.hmx</groupId>

<artifactId>Springcloud-alibaba</artifactId>

<version>1.0-SNAPSHOT</version>

<properties>

<maven.compiler.source>8</maven.compiler.source>

<maven.compiler.target>8</maven.compiler.target>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

<project.reporting.outputEncoding>UTF- 8</project.reporting.outputEncoding>

<spring-cloud.version>Greenwich.RELEASE</spring-cloud.version>

<spring-cloud-alibaba.version>2.1.0.RELEASE</spring-cloud-alibaba.version>

</properties>

<dependencyManagement>

<dependencies>

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-dependencies</artifactId>

<version>${spring-cloud.version}</version>

<type>pom</type>

<scope>import</scope>

</dependency>

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-alibaba-dependencies</artifactId>

<version>${spring-cloud-alibaba.version}</version>

<type>pom</type>

<scope>import</scope>

</dependency>

</dependencies>

</dependencyManagement>

</project>

2.3 创建基础模块

1 创建shop-common模块,在pom.xml中添加依赖

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<parent>

<artifactId>Springcloud-alibaba</artifactId>

<groupId>com.hmx</groupId>

<version>1.0-SNAPSHOT</version>

</parent>

<modelVersion>4.0.0</modelVersion>

<artifactId>shop-common</artifactId>

<properties>

<maven.compiler.source>8</maven.compiler.source>

<maven.compiler.target>8</maven.compiler.target>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-data-jpa</artifactId>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

</dependency>

<dependency>

<groupId>com.alibaba</groupId>

<artifactId>fastjson</artifactId>

<version>1.2.75</version>

</dependency>

<dependency>

<groupId>mysql</groupId>

<artifactId>mysql-connector-java</artifactId>

<version>8.0.25</version>

</dependency>

</dependencies>

</project>

- 创建实体类

package com.hmx.domain;

import lombok.Data;

import javax.persistence.Entity;

import javax.persistence.GeneratedValue;

import javax.persistence.GenerationType;

import javax.persistence.Id;

/**

* @program: Springcloud-alibaba

* @description:

* @author: hmx

* @create: 2021-07-24 22:58

**/

//用户

@Entity(name = "shop_user")

@Data

public class User {

@Id

@GeneratedValue(strategy = GenerationType.IDENTITY)

private Integer uid;//主键

private String username;//用户名

private String password;//密码

private String telephone;//手机号

}

package com.hmx.domain;

import lombok.Data;

import javax.persistence.Entity;

import javax.persistence.GeneratedValue;

import javax.persistence.GenerationType;

import javax.persistence.Id;

/**

* @program: Springcloud-alibaba

* @description:

* @author: hmx

* @create: 2021-07-24 23:00

**/

//商品

@Entity(name = "shop_product") @Data

public class Product {

@Id

@GeneratedValue(strategy = GenerationType.IDENTITY)

private Integer pid;//主键

private String pname;//商品名称

private Double pprice;//商品价格

private Integer stock;//库存

}

package com.hmx.domain;

import lombok.Data;

import javax.persistence.Entity;

import javax.persistence.GeneratedValue;

import javax.persistence.GenerationType;

import javax.persistence.Id;

/**

* @program: Springcloud-alibaba

* @description:

* @author: hmx

* @create: 2021-07-24 23:02

**/

//订单

@Entity(name = "shop_order") @Data

public class Order {

@Id

@GeneratedValue(strategy = GenerationType.IDENTITY)

private Long oid;//订单id

private Integer uid;// 用 户 id private String username;//用户名

private Integer pid;//商品id

private String pname;//商品名称private Double pprice;//商品单价

private Integer number;//购买数量

}

2.4 创建用户微服务

步骤:

1 创建模块 导入依赖

2 创建SpringBoot主类

3 加入配置文件

4 创建必要的接口和实现类(controller service dao)

新建一个shop-user 模块,然后进行下面操作

同下

2.5 创建商品微服务

1 创建pom.xml

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<parent>

<artifactId>Springcloud-alibaba</artifactId>

<groupId>com.hmx</groupId>

<version>1.0-SNAPSHOT</version>

</parent>

<modelVersion>4.0.0</modelVersion>

<artifactId>shop-user</artifactId>

<properties>

<maven.compiler.source>8</maven.compiler.source>

<maven.compiler.target>8</maven.compiler.target>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>com.hmx</groupId>

<artifactId>shop-common</artifactId>

<version>1.0-SNAPSHOT</version>

</dependency>

</dependencies>

</project>

- 编写主类

package com.hmx;

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

/**

* @program: Springcloud-alibaba

* @description:

* @author: hmx

* @create: 2021-07-24 23:24

**/

@SpringBootApplication

public class ProductApplication {

public static void main(String[] args) {

SpringApplication.run(ProductApplication.class,args);

}

}

- 创建配置文件

server:

port: 8071

spring:

application:

name: service-product

datasource:

driver-class-name: com.mysql.cj.jdbc.Driver

url: jdbc:mysql:///shop? serverTimezone=UTC&useUnicode=true&characterEncoding=utf-8&useSSL=true

username: root

password: root

jpa:

properties:

hibernate:

hbm2ddl:

auto: update

dialect: org.hibernate.dialect.MySQL8Dialect

- 创建ProductDao接口

public interface ProductDao extends JpaRepository<Product,Integer> {

}

- 创建ProductService接口和实现类

@Service

public class ProductServiceImpl implements ProductService {

@Autowired

private ProductDao productDao;

@Override

public Product findByPid(Integer pid) {

return productDao.findById(pid).get();

}

}

- 创建ProductController

@RestController

public class ProductController {

@Autowired

private ProductService productService;

@RequestMapping("/product/{pid}")

public Product product(@PathVariable("pid") Integer pid){

log.info("查询{}号商品信息", pid);

Product product = productService.findByPid(pid);

log.info("商品信息查询成功,内容为{}", JSON.toJSONString(product));

return product;

}

}

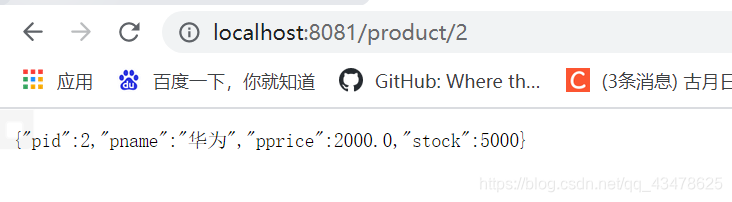

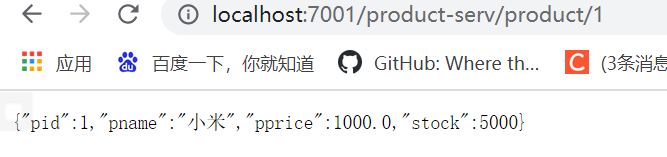

- 启动工程后,等到数据库表创建完毕后,加入测试数据

INSERT INTO shop_product VALUE(NULL,'小米','1000','5000');

INSERT INTO shop_product VALUE(NULL,'华为','2000','5000');

INSERT INTO shop_product VALUE(NULL,'苹果','3000','5000');

INSERT INTO shop_product VALUE(NULL,'OPPO','4000','5000');

- 通过浏览器访问服务

2.6 创建订单微服务

1 创建pom.xml

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<parent>

<artifactId>Springcloud-alibaba</artifactId>

<groupId>com.hmx</groupId>

<version>1.0-SNAPSHOT</version>

</parent>

<modelVersion>4.0.0</modelVersion>

<artifactId>shop-user</artifactId>

<properties>

<maven.compiler.source>8</maven.compiler.source>

<maven.compiler.target>8</maven.compiler.target>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>com.hmx</groupId>

<artifactId>shop-common</artifactId>

<version>1.0-SNAPSHOT</version>

</dependency>

</dependencies>

</project>

- 编写主类

package com.hmx;

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

/**

* @program: Springcloud-alibaba

* @description:

* @author: hmx

* @create: 2021-07-24 23:24

**/

@SpringBootApplication

public class ProductApplication {

public static void main(String[] args) {

SpringApplication.run(ProductApplication.class,args);

}

@Bean

public RestTemplate getRestTemplate(){

return new RestTemplate();

}

}

- 创建配置文件

server:

port: 8071

spring:

application:

name: service-order

datasource:

driver-class-name: com.mysql.cj.jdbc.Driver

url: jdbc:mysql:///shop? serverTimezone=UTC&useUnicode=true&characterEncoding=utf-8&useSSL=true

username: root

password: root

jpa:

properties:

hibernate:

hbm2ddl:

auto: update

dialect: org.hibernate.dialect.MySQL8Dialect

- 创建ProductDao接口

public interface OrderDao extends JpaRepository<Order,Integer> {

}

- 创建OrderService接口和实现类

@Service

@Service

public class OrderServiceImpl implements OrderService {

@Autowired

private OrderDao orderDao;

@Override

public Order save(Order order) {

Order order1 = orderDao.save(order);

return order1;

}

}

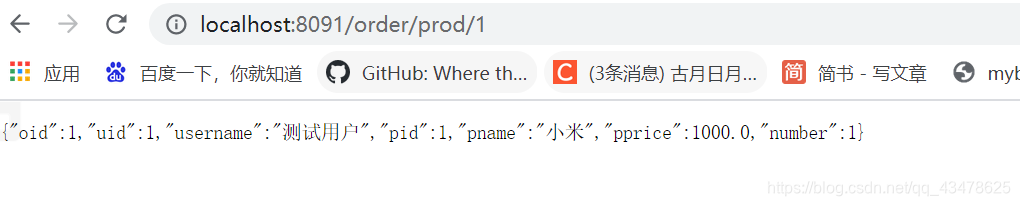

- 创建OrderController

@RestController

@Slf4j

public class OrderController {

@Autowired

private RestTemplate restTemplate;

@Autowired

private OrderService orderService;

//准备买一件商品

@GetMapping("/order/prod/{pid}")

public Order order(@PathVariable("pid") Integer pid){

log.info("客户下单,这时候要调用商品微服务查询商品信息");

//通过RestTemplate调用商品微服务

Product product = restTemplate.getForObject("http://localhost:8081/product/" + pid, Product.class);

log.info(">> 商品信息,查询结果:" + JSON.toJSONString(product));

Order order = new Order();

order.setUid(1);

order.setUsername("测试用户");

order.setPid(pid);

order.setPname(product.getPname());

order.setPprice(product.getPprice());

order.setNumber(1);

orderService.save(order);

return order;

}

}

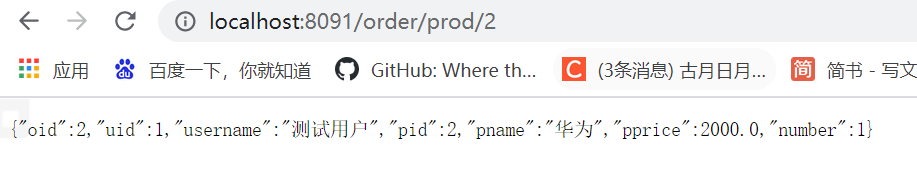

- 通过浏览器访问服务

三、 Nacos Discovery–服务治理

3.1 服务治理介绍

通过上一章的操作,我们已经可以实现微服务之间的调用。但是我们把服务提供者的网络地址(ip,端口)等硬编码到了代码中,这种做法存在许多问题:

- 一旦服务提供者地址变化,就需要手工修改代码

- 一旦是多个服务提供者,无法实现负载均衡功能

- 一旦服务变得越来越多,人工维护调用关系困难

那么应该怎么解决呢, 这时候就需要通过注册中心动态的实现服务治理。

什么是服务治理

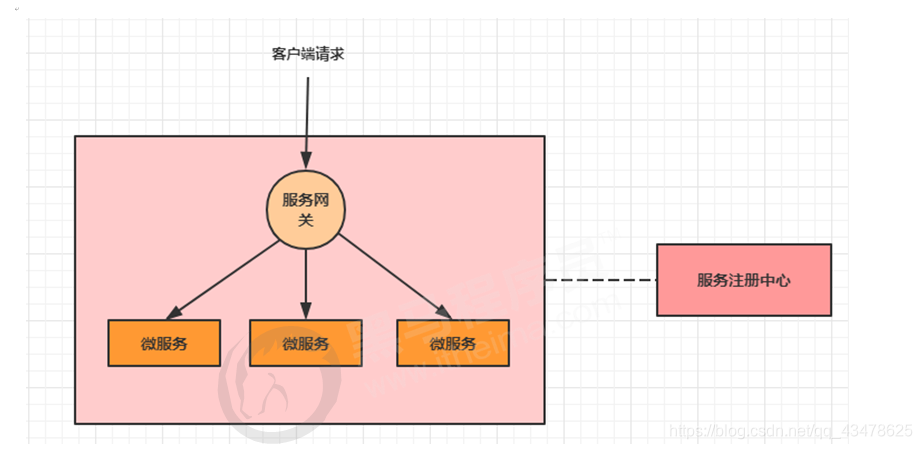

服务治理是微服务架构中最核心最基本的模块。用于实现各个微服务的自动化注册与发现。

服务注册:在服务治理框架中,都会构建一个注册中心,每个服务单元向注册中心登记自己提供服 务的详细信息。并在注册中心形成一张服务的清单,服务注册中心需要以心跳的方式去监测清单中 的服务是否可用,如果不可用,需要在服务清单中剔除不可用的服务。

- 服务发现:服务调用方向服务注册中心咨询服务,并获取所有服务的实例清单,实现对具体服务实 例的访问。

通过上面的调用图会发现,除了微服务,还有一个组件是服务注册中心,它是微服务架构非常重要 的一个组件,在微服务架构里主要起到了协调者的一个作用。注册中心一般包含如下几个功能:

- 服务发现:

- 服务注册:保存服务提供者和服务调用者的信息

- 服务订阅:服务调用者订阅服务提供者的信息,注册中心向订阅者推送提供者的信息

- 服务配置:

- 配置订阅:服务提供者和服务调用者订阅微服务相关的配置

- 配置下发:主动将配置推送给服务提供者和服务调用者

- 服务健康检测

- 检测服务提供者的健康情况,如果发现异常,执行服务剔除

常见的注册中心

- Zookeeper

zookeeper是一个分布式服务框架,是Apache Hadoop 的一个子项目,它主要是用来解决分布式应用中经常遇到的一些数据管理问题,如:统一命名服务、状态同步服务、集群管理、分布式应用 配置项的管理等。 - Eureka

Eureka是Springcloud Netflix中的重要组件,主要作用就是做服务注册和发现。但是现在已经闭源 - Consul

Consul是基于GO语言开发的开源工具,主要面向分布式,服务化的系统提供服务注册、服务发现 和配置管理的功能。Consul的功能都很实用,其中包括:服务注册/发现、健康检查、Key/Value 存储、多数据中心和分布式一致性保证等特性。Consul本身只是一个二进制的可执行文件,所以 安装和部署都非常简单,只需要从官网下载后,在执行对应的启动脚本即可。 - Nacos

Nacos是一个更易于构建云原生应用的动态服务发现、配置管理和服务管理平台。它是 Spring Cloud Alibaba 组件之一,负责服务注册发现和服务配置,可以这样认为nacos=eureka+config。

3.2 nacos简介

Nacos 致力于帮助您发现、配置和管理微服务。Nacos 提供了一组简单易用的特性集,帮助您快速实现动态服务发现、服务配置、服务元数据及流量管理。

从上面的介绍就可以看出,nacos的作用就是一个注册中心,用来管理注册上来的各个微服务。

3.3 nacos实战入门

接下来,我们就在现有的环境中加入nacos,并将我们的两个微服务注册上去。

3.3.1 搭建nacos环境

第1步: 安装nacos

下载地址: https://github.com/alibaba/nacos/releases

下载zip格式的安装包,然后进行解压缩操作

第2步:启动nacos

#切换目录

cd nacos/bin

#命令启动

startup.cmd -m standalone

正常解压之后,点击bin—startup.cmd就可以启动了,但是这里报错了。

其中的原因是解压之后startup.cmd里面MODE默认是cluster,编辑startup.cmd,将cluster改为standalone即可正常启动。

第3步:访问nacos

打开浏览器输入http://localhost:8848/nacos,即可访问服务, 默认密码是nacos/nacos

3.3.2 将商品微服务注册到nacos

接下来开始修改shop-product 模块的代码, 将其注册到nacos服务上

1 在pom.xml中添加nacos的依赖

<!--nacos客户端-->

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-nacos- discovery</artifactId>

</dependency>

2 在主类上添加@EnableDiscoveryClient注解

@SpringBootApplication @EnableDiscoveryClient

public class ProductApplication

3 在application.yml中添加nacos服务的地址

spring:

cloud:

nacos:

discovery:

server-addr: 127.0.0.1:8848

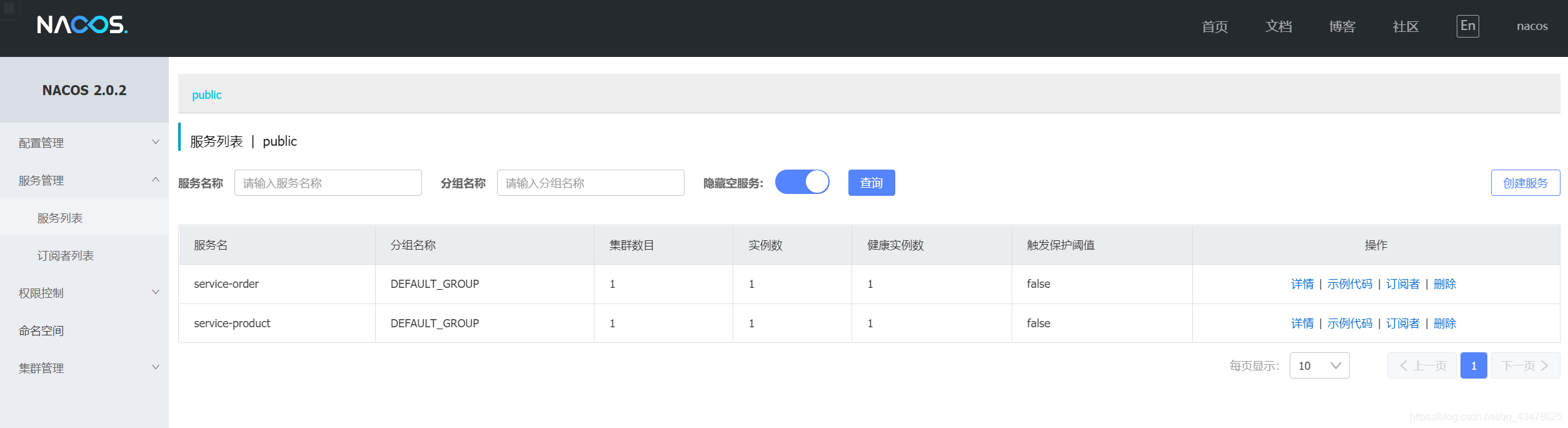

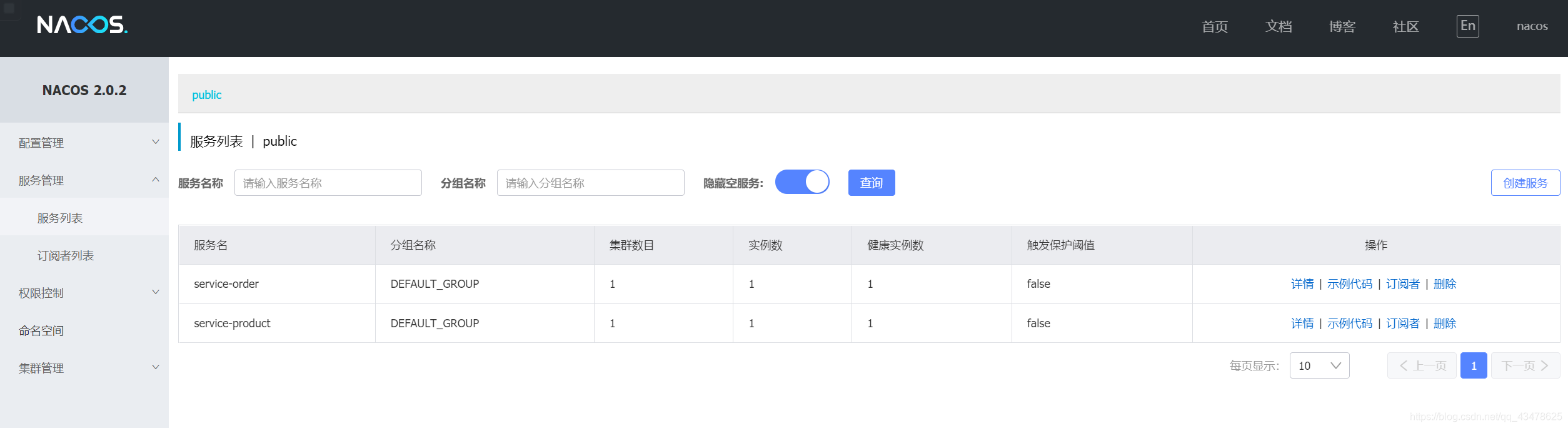

4 启动服务, 观察nacos的控制面板中是否有注册上来的商品微服务

3.3.3 将订单微服务注册到nacos

1,2,3步同上

- 修改OrderController, 实现微服务调用

@RestController

@Slf4j

public class OrderController {

@Autowired

private RestTemplate restTemplate;

@Autowired

private OrderService orderService;

@Autowired

private DiscoveryClient discoveryClient;

//准备买一件商品

@GetMapping("/order/prod/{pid}")

public Order order(@PathVariable("pid") Integer pid){

log.info(">>客户下单,这时候要调用商品微服务查询商品信息");

//从nacos中获取服务地址

ServiceInstance serviceInstance = discoveryClient.getInstances("service-product").get(0);

String url = serviceInstance.getHost() + ":" + serviceInstance.getPort();

log.info(">>从nacos中获取到的微服务地址为: " + url);

//通过RestTemplate调用商品微服务

Product product = restTemplate.getForObject("http://" + url + "/product/" + pid, Product.class);

log.info(">> 商品信息,查询结果:" + JSON.toJSONString(product));

Order order = new Order();

order.setUid(1);

order.setUsername("测试用户");

order.setPid(pid);

order.setPname(product.getPname());

order.setPprice(product.getPprice());

order.setNumber(1);

orderService.save(order);

return order;

}

}

5 启动服务, 观察nacos的控制面板中是否有注册上来的订单微服务,然后通过访问消费者服务验证调用是否成功

3.4 实现服务调用的负载均衡

3.4.1 什么是负载均衡

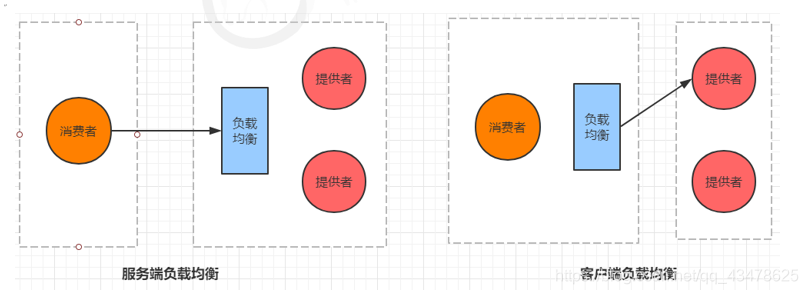

通俗的讲, 负载均衡就是将负载(工作任务,访问请求)进行分摊到多个操作单元(服务器,组件)上进行执行。

根据负载均衡发生位置的不同,一般分为服务端负载均衡和客户端负载均衡。服务端负载均衡指的是发生在服务提供者一方,比如常见的nginx负载均衡

而客户端负载均衡指的是发生在服务请求的一方,也就是在发送请求之前已经选好了由哪个实例处理请求。

我们在微服务调用关系中一般会选择客户端负载均衡,也就是在服务调用的一方来决定服务由哪个提供者执行。

3.4.2 自定义实现负载均衡

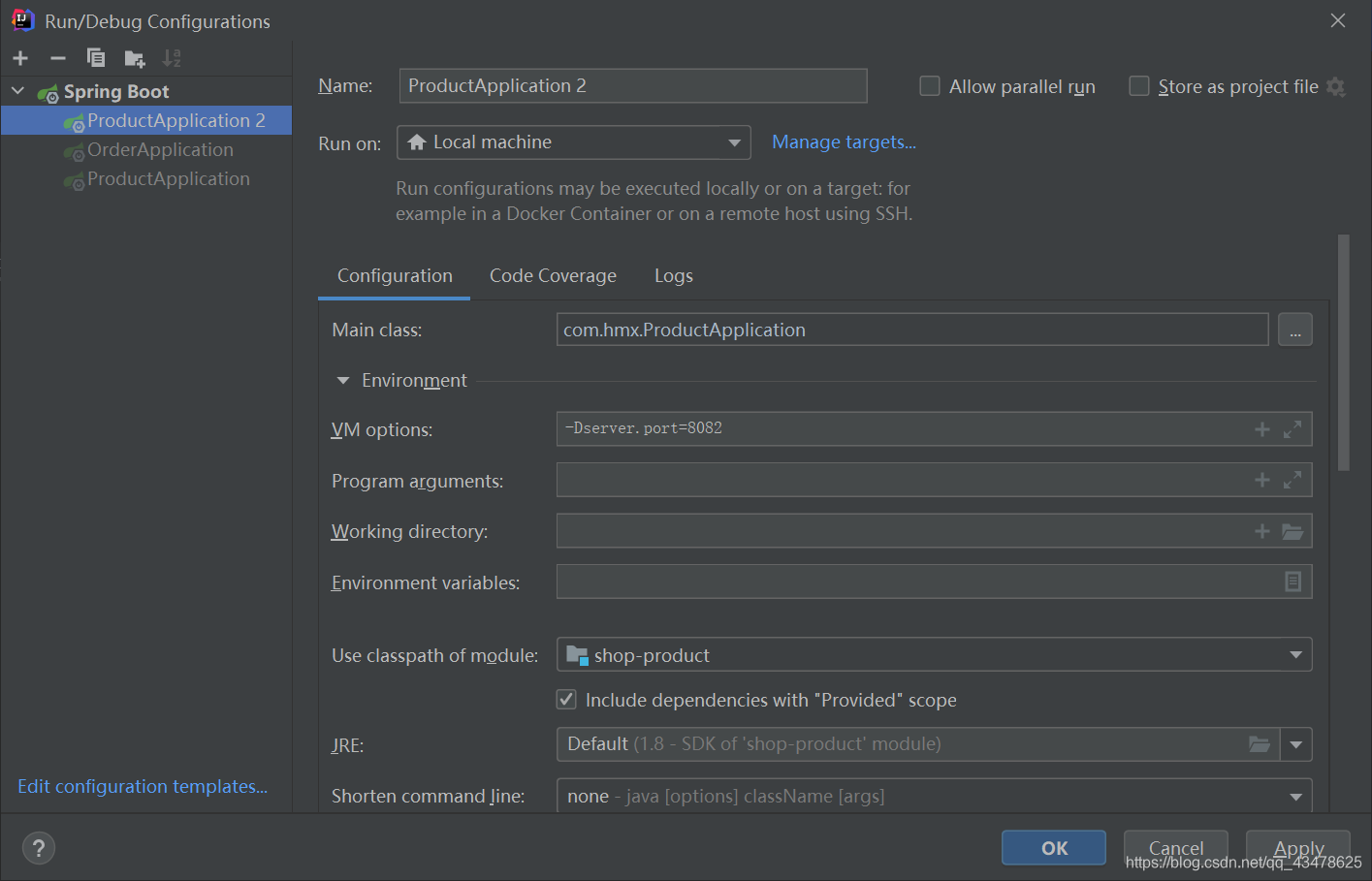

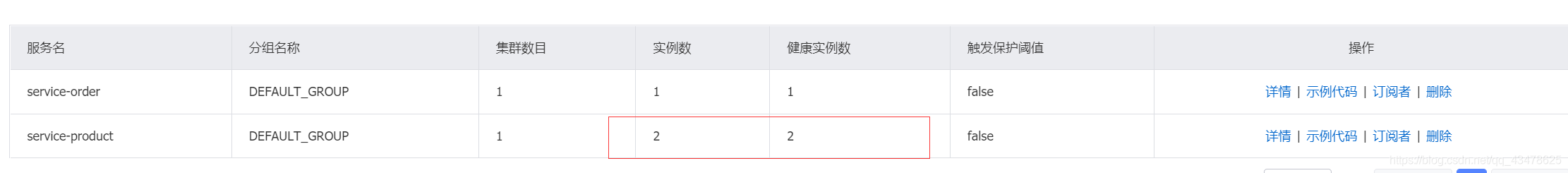

1 通过idea再启动一个shop-product 微服务,设置其端口为8082

2 通过nacos查看微服务的启动情况

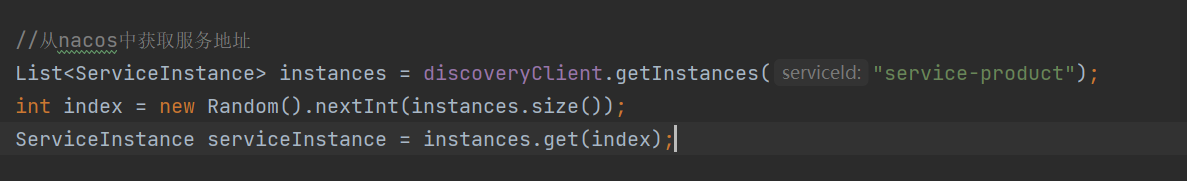

3 修改shop-order 的代码,实现负载均衡

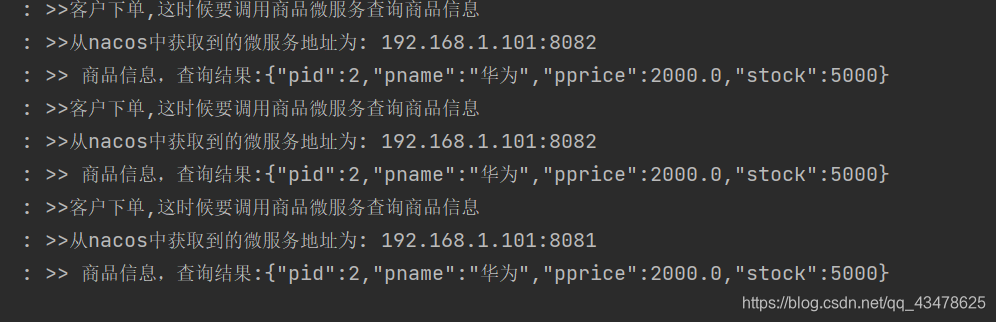

启动两个服务提供者和一个服务消费者,多访问几次消费者测试效果

3.4.3 基于Ribbon实现负载均衡

Ribbon是Spring Cloud的一个组件, 它可以让我们使用一个注解就能轻松的搞定负载均衡

第1步:在RestTemplate 的生成方法上添加@LoadBalanced注解

@Bean

@LoadBalanced

public RestTemplate restTemplate() { return new RestTemplate();

}

第2步:修改服务调用的方法

//直接使用微服务名字, 从nacos中获取服务地址

String url = "service-product";

//通过restTemplate调用商品微服务

Product product = restTemplate.getForObject(

"http://" + url + "/product/" + pid, Product.class);

Ribbon支持的负载均衡策略

Ribbon内置了多种负载均衡策略,内部负载均衡的顶级接口为

com.netflix.loadbalancer.IRule , 具体的负载策略如下图所示:

| 策略名 | 策略描述 | 实现说明 |

|---|---|---|

| BestAvailableRule | 选择一个最小的并发请求的server | 逐个考察Server,如果Server被tripped了,则忽略,在选择其中ActiveRequestsCount最小的server |

| AvailabilityFilteringRule | 过滤掉那些因为一直连接失败的被标记为circuit tripped的后端server,并过滤掉那些高并发的的后端server(active connections 超过配置的阈值) | 使用一个AvailabilityPredicate来包含过滤server的逻辑,其实就就是检查status里记录的各个server的运行状态 |

| WeightedResponseTimeRule | 根据相应时间分配一个weight,相应时间越长,weight越小,被选中的可能性越低。 | 一个后台线程定期的从status里面读取评价响应时间,为每个server计算一个weight。Weight的计算也比较简单responsetime 减去每个server自己平均的responsetime是server的权重。当刚开始运行,没有形成statas 时,使用roubine策略选择server。 |

| RetryRule | 对选定的负载均衡策略机上重试机制。 | 在一个配置时间段内当选择server不成功,则一直尝试使用subRule的方式选择一个可用的server |

| RoundRobinRule | 轮询方式轮询选择server | |

| RandomRule | 随机选择一个server | 在index上随机,选择index对应位置的server |

| ZoneAvoidanceRule | 复合判断server所在区域的性能和server 的可用性选择server | 使用ZoneAvoidancePredicate和AvailabilityPredicate来判断是否选择某个server,前一个判断判定一个zone的运行性能是否可用,剔除不可用 的 zone( 的 所 有 server), AvailabilityPredicate用于过滤掉连接数过多的Server。 |

我们可以通过修改配置来调整Ribbon的负载均衡策略,具体代码如下

service-product: # 调用的提供者的名称

ribbon:

NFLoadBalancerRuleClassName: com.netflix.loadbalancer.RandomRule

3.5 基于Feign实现服务调用

3.5.1 什么是Feign

Feign是Spring Cloud提供的一个声明式的伪Http客户端, 它使得调用远程服务就像调用本地服务一样简单, 只需要创建一个接口并添加一个注解即可。

Nacos很好的兼容了Feign, Feign默认集成了 Ribbon, 所以在Nacos下使用Fegin默认就实现了负载均衡的效果。

3.5.2 Feign的使用

- 加入Feign的依赖

<!--fegin组件-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-openfeign</artifactId>

</dependency>

- 在主类上添加Feign的注解

@SpringBootApplication

@EnableDiscoveryClient

@EnableFeignClients//开启Fegin

public class OrderApplication {}

- 创建一个service,并使用Feign实现微服务调用

@FeignClient("service-product")

public interface ProductService {

@GetMapping(value = "/product/{pid}")

Product findByPid(@PathVariable("pid") Integer pid);

}

- 修改controller代码,并启动验证

@RestController

@Slf4j

public class OrderController {

@Autowired

private RestTemplate restTemplate;

@Autowired

private OrderService orderService;

@Autowired

private DiscoveryClient discoveryClient;

@Autowired

private ProductService productService;

//准备买一件商品

@GetMapping("/order/prod/{pid}")

public Order order(@PathVariable("pid") Integer pid){

log.info(">>客户下单,这时候要调用商品微服务查询商品信息");

//直接使用微服务名字,从nacos中获取服务地址

String url = "service-product";

/*List<ServiceInstance> instances = discoveryClient.getInstances("service-product");

int index = new Random().nextInt(instances.size());

ServiceInstance serviceInstance = instances.get(index);

String url = serviceInstance.getHost() + ":" + serviceInstance.getPort();

*/

Product product = productService.findByPid(pid);

log.info(">> 商品信息,查询结果:" + JSON.toJSONString(product));

Order order = new Order();

order.setUid(1);

order.setUsername("测试用户");

order.setPid(pid);

order.setPname(product.getPname());

order.setPprice(product.getPprice());

order.setNumber(1);

orderService.save(order);

return order;

}

}

- 重启order微服务,查看效果

第四章 Sentinel–服务容错

4.1 高并发带来的问题

在微服务架构中,我们将业务拆分成一个个的服务,服务与服务之间可以相互调用,但是由于网络 原因或者自身的原因,服务并不能保证服务的100%可用,如果单个服务出现问题,调用这个服务就会 出现网络延迟,此时若有大量的网络涌入,会形成任务堆积,最终导致服务瘫痪。

接下来,我们来模拟一个高并发的场景

- 编写java代码

@RestController

@Slf4j

public class OrderController {

@Autowired

private RestTemplate restTemplate;

@Autowired

private OrderService orderService;

@Autowired

private DiscoveryClient discoveryClient;

@Autowired

private ProductService productService;

//准备买一件商品

@GetMapping("/order/prod/{pid}")

public Order order(@PathVariable("pid") Integer pid){

log.info(">>客户下单,这时候要调用商品微服务查询商品信息");

//直接使用微服务名字,从nacos中获取服务地址

String url = "service-product";

Product product = productService.findByPid(pid);

log.info(">> 商品信息,查询结果:" + JSON.toJSONString(product));

//模拟一次网络延时

try {

Thread.sleep(100);

} catch (InterruptedException e) {

e.printStackTrace();

}

Order order = new Order();

order.setUid(1);

order.setUsername("测试用户");

order.setPid(pid);

order.setPname(product.getPname());

order.setPprice(product.getPprice());

order.setNumber(1);

//为了不产生太多垃圾数据,暂时不做订单保存

//orderService.save(order);

return order;

}

@RequestMapping("/order/message")

public String message(){

return "高并发下的问题测试";

}

}

- 修改配置文件中tomcat的并发数

server:

port: 8091

tomcat:

max-threads: 10 # tomcat的最大并发值修改为10,默认是200

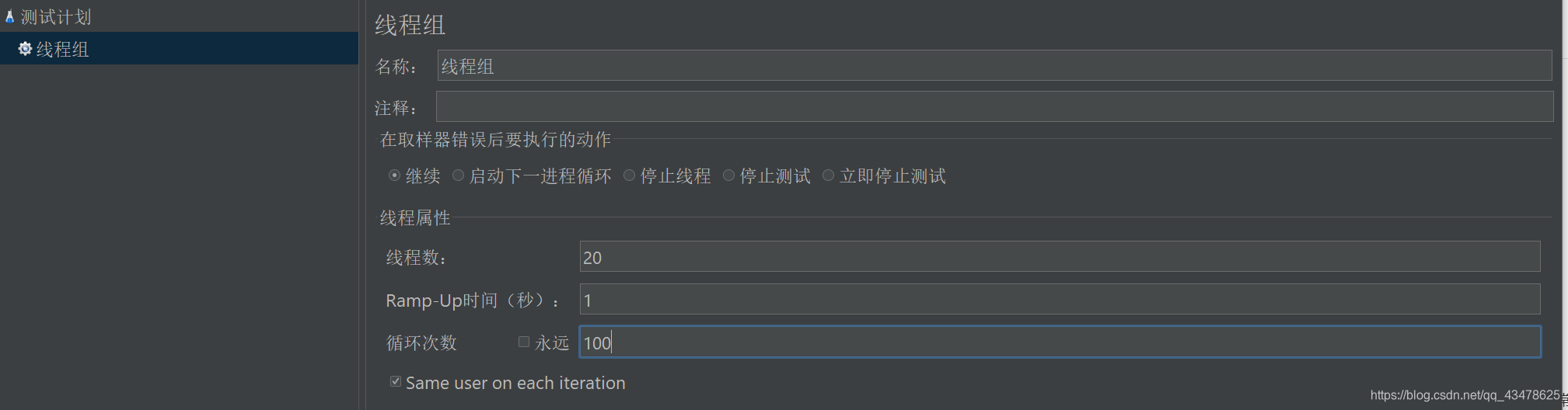

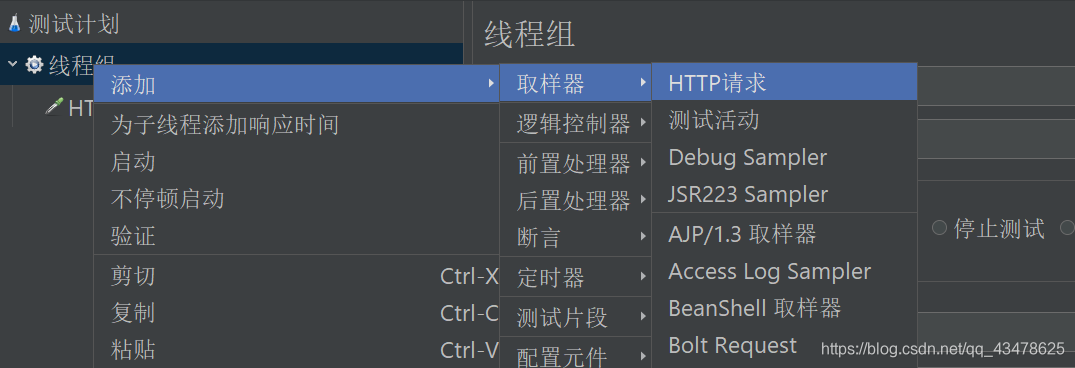

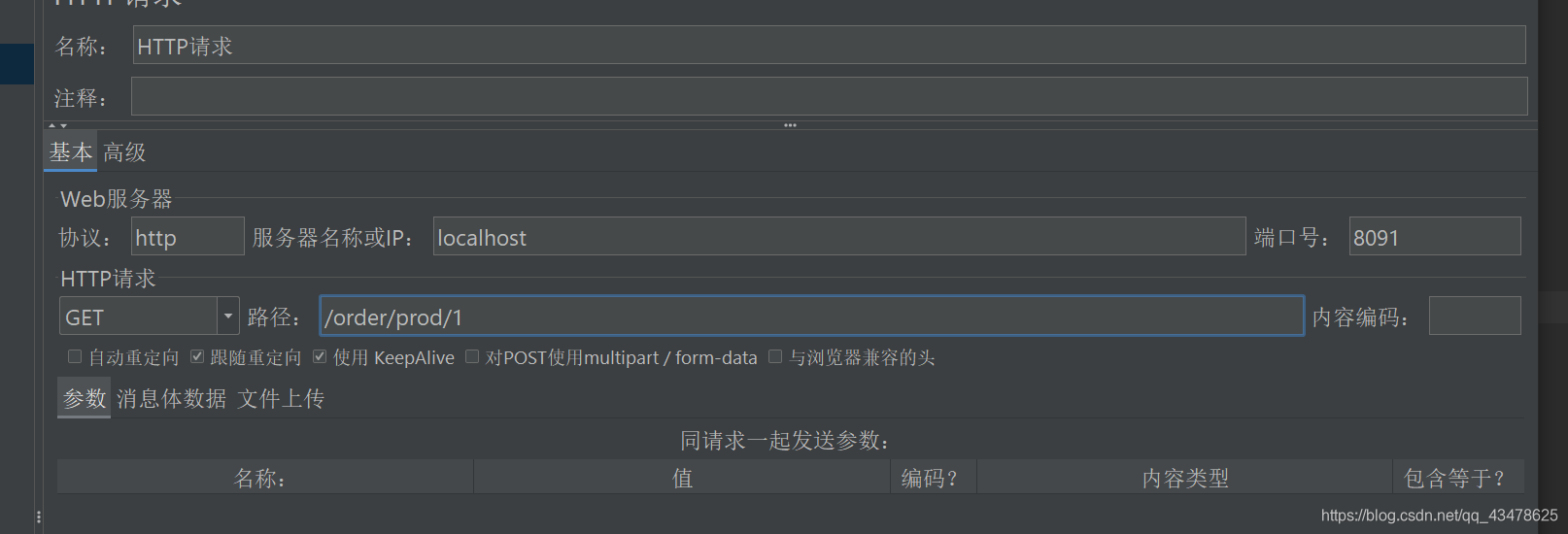

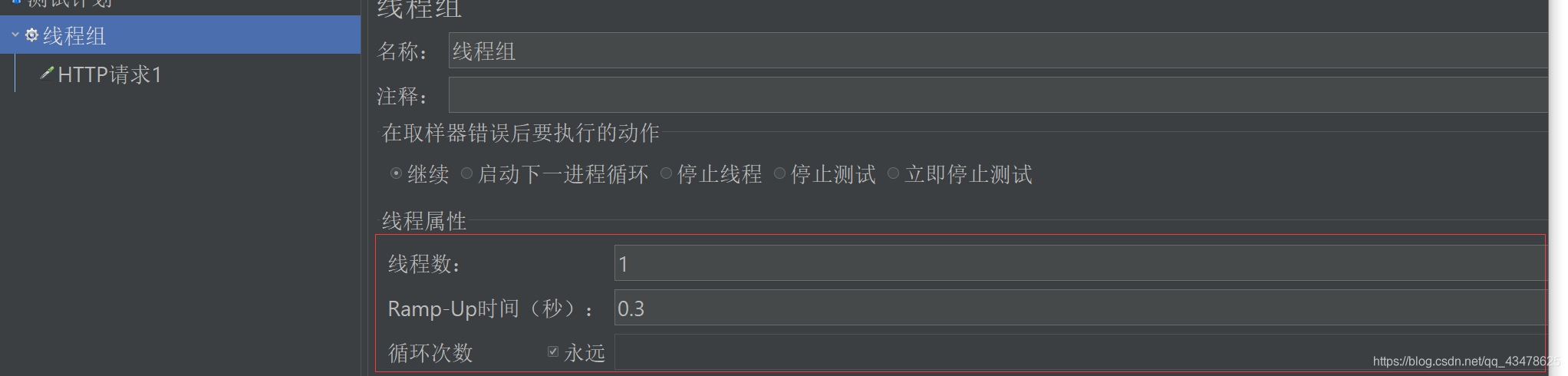

- 接下来使用压测工具,对请求进行压力测试

下载地址https://jmeter.apache.org/

第一步:修改配置,并启动软件

进入bin目录,修改jmeter.properties文件中的语言支持为language=zh_CN,然后点击jmeter.bat 启动软件。

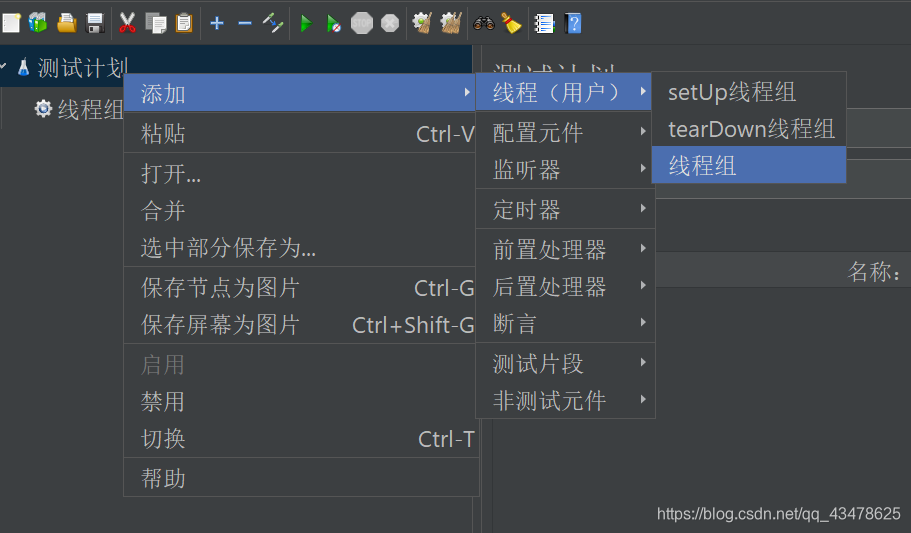

第二步:添加线程组

第三步:配置线程并发数

第四步:添加Http取样

第五步:配置取样,并启动测试

- 访问message方法观察效果

结论:

此时会发现, 由于order方法囤积了大量请求, 导致message方法的访问出现了问题,这就是服务雪崩的雏形。

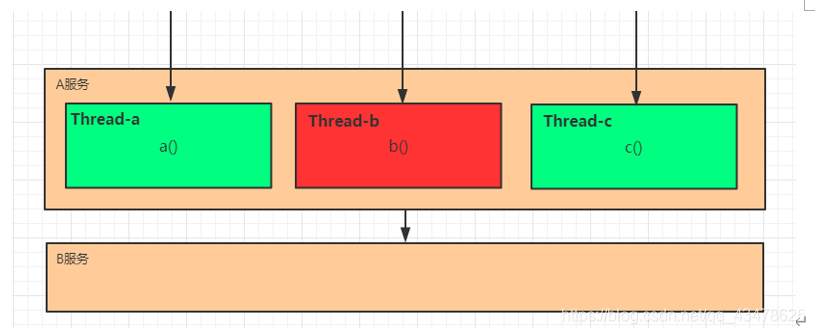

4.2 服务雪崩效应

在分布式系统中,由于网络原因或自身的原因,服务一般无法保证 100% 可用。如果一个服务出现了问题,调用这个服务就会出现线程阻塞的情况,此时若有大量的请求涌入,就会出现多条线程阻塞等 待,进而导致服务瘫痪。

由于服务与服务之间的依赖性,故障会传播,会对整个微服务系统造成灾难性的严重后果,这就是 服务故障的 “雪崩效应” 。

雪崩发生的原因多种多样,有不合理的容量设计,或者是高并发下某一个方法响应变慢,亦或是某 台机器的资源耗尽。我们无法完全杜绝雪崩源头的发生,只有做好足够的容错,保证在一个服务发生问 题,不会影响到其它服务的正常运行。也就是"雪落而不雪崩"。

4.3 常见容错方案

要防止雪崩的扩散,我们就要做好服务的容错,容错说白了就是保护自己不被猪队友拖垮的一些措 施, 下面介绍常见的服务容错思路和组件。

常见的容错思路

常见的容错思路有隔离、超时、限流、熔断、降级这几种,下面分别介绍一下。

- 隔离

它是指将系统按照一定的原则划分为若干个服务模块,各个模块之间相对独立,无强依赖。当有故 障发生时,能将问题和影响隔离在某个模块内部,而不扩散风险,不波及其它模块,不影响整体的 系统服务。常见的隔离方式有:线程池隔离和信号量隔离.

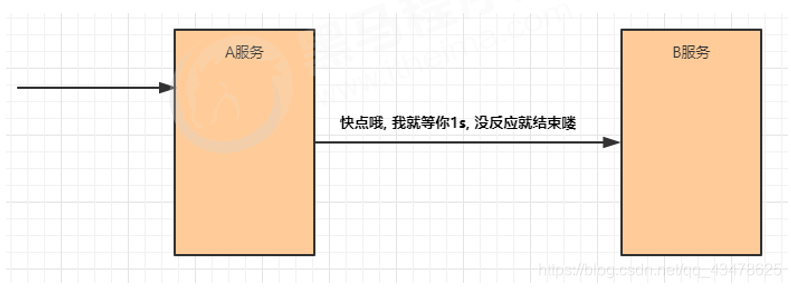

- 超时

在上游服务调用下游服务的时候,设置一个最大响应时间,如果超过这个时间,下游未作出反应, 就断开请求,释放掉线程。

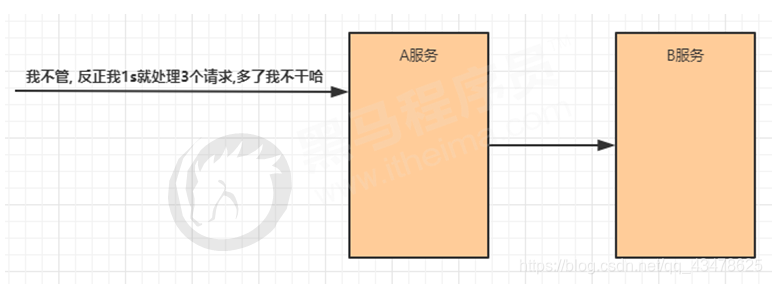

- 限流

限流就是限制系统的输入和输出流量已达到保护系统的目的。为了保证系统的稳固运行,一旦达到 的需要限制的阈值,就需要限制流量并采取少量措施以完成限制流量的目的。

-

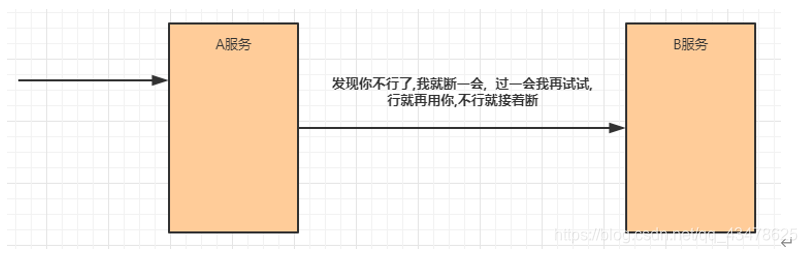

熔断

在互联网系统中,当下游服务因访问压力过大而响应变慢或失败,上游服务为了保护系统整体的可用性,可以暂时切断对下游服务的调用。这种牺牲局部,保全整体的措施就叫做熔断。

服务熔断一般有三种状态: -

熔断关闭状态(Closed)

服务没有故障时,熔断器所处的状态,对调用方的调用不做任何限制 -

熔断开启状态(Open)

后续对该服务接口的调用不再经过网络,直接执行本地的fallback方法 -

半熔断状态(Half-Open)

尝试恢复服务调用,允许有限的流量调用该服务,并监控调用成功率。如果成功率达到预期,则说明服务已恢复,进入熔断关闭状态;如果成功率仍旧很低,则重新进入熔断关闭状态。 -

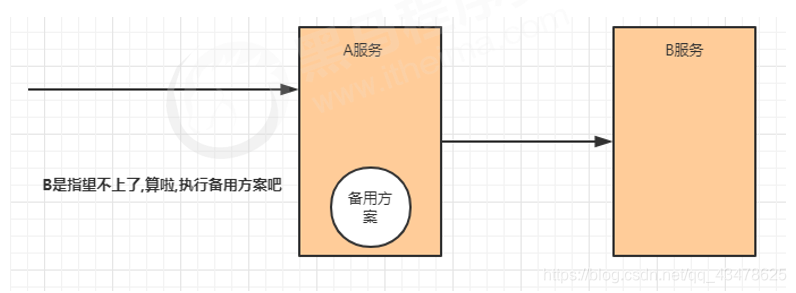

降级

降级其实就是为服务提供一个托底方案,一旦服务无法正常调用,就使用托底方案。

常见的容错组件 -

Hystrix

Hystrix是由Netflix开源的一个延迟和容错库,用于隔离访问远程系统、服务或者第三方库,防止 级联失败,从而提升系统的可用性与容错性。 -

Resilience4J

Resilicence4J一款非常轻量、简单,并且文档非常清晰、丰富的熔断工具,这也是Hystrix官方推 荐的替代产品。不仅如此,Resilicence4j还原生支持Spring Boot 1.x/2.x,而且监控也支持和prometheus等多款主流产品进行整合。 -

Sentinel

Sentinel 是阿里巴巴开源的一款断路器实现,本身在阿里内部已经被大规模采用,非常稳定。下面是三个组件在各方面的对比:

| Sentinel | Hystrix | resilience4j | |

|---|---|---|---|

| 隔离策略 | 信号量隔离(并发线程数限流) | 线程池隔离/信号量隔离 | 信号量隔离 |

| 熔断降级策略 | 基于响应时间、异常比率、异常数 | 基于异常比率 | 基于异常比率、响应时间 |

| 实时统计实现 | 滑动窗口(LeapArray) | 滑动窗口(基于 RxJava) | Ring Bit Buffer |

| 动态规则配置 | 支持多种数据源 | 支持多种数据源 | 有限支持 |

| 扩展性 | 多个扩展点 | 插件的形式 | 接口的形式 |

| 基于注解的支持 | 支持 | 支持 | 支持 |

| 限流 | 基于 QPS,支持基于调用关系的限流 | 有限的支持 | Rate Limiter |

| 流量整形 | 支持预热模式、匀速器模式、预热排队模式 | 不支持 | 简单的 Rate Limiter模式 |

| 系统自适应保护 | 支持 | 不支持 | 不支持 |

| 控制台 | 提供开箱即用的控制台,可配置规则、查看秒级监控、机器发现等 | 简单的监控查看 | 不提供控制台,可对接其它监控系统 |

4.4 Sentinel入门

4.4.1 什么是Sentinel

Sentinel (分布式系统的流量防卫兵) 是阿里开源的一套用于服务容错的综合性解决方案。它以流量为切入点, 从流量控制、熔断降级、系统负载保护等多个维度来保护服务的稳定性。

Sentinel具有一下特征:

- 丰富的应用场景 :Sentinel 承接了阿里巴巴近 10 年的双十一大促流量的核心场景, 例如秒杀(即突发流量控制在系统容量可以承受的范围)、消息削峰填谷、集群流量控制、实时熔断下游不可用 应用等。

- 完备的实时监控:Sentinel 提供了实时的监控功能。通过控制台可以看到接入应用的单台机器秒级数据, 甚至 500 台以下规模的集群的汇总运行情况。

- 广泛的开源生态:Sentinel 提供开箱即用的与其它开源框架/库的整合模块, 例如与 Spring Cloud、Dubbo、gRPC 的整合。只需要引入相应的依赖并进行简单的配置即可快速地接入Sentinel。

- 完善的 SPI 扩展点:Sentinel 提供简单易用、完善的 SPI 扩展接口。您可以通过实现扩展接口来快速地定制逻辑。例如定制规则管理、适配动态数据源等。

Sentinel分为两个部分

- 核心库(Java 客户端)不依赖任何框架/库,能够运行于所有 Java 运行时环境,同时对 Dubbo / Spring Cloud 等框架也有较好的支持。

- 控制台(Dashboard)基于 Spring Boot 开发,打包后可以直接运行,不需要额外的 Tomcat 等应用容器。

4.4.2 微服务集成Sentinel

为微服务集成Sentinel非常简单, 只需要加入Sentinel的依赖即可

1 在pom.xml中加入下面依赖

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-sentinel</artifactId>

</dependency>

2.编写一个Controller测试使用

@RestController

@Slf4j

public class OrderController2 {

@RequestMapping("/order/message1")

public String message1(){

return "message1";

}

@RequestMapping("/order/message2")

public String message2(){

return "message2";

}

}

4.4.3 安装Sentinel控制台

Sentinel 提供一个轻量级的控制台, 它提供机器发现、单机资源实时监控以及规则管理等功能。

- 下载jar包,解压到文件夹

https://github.com/alibaba/Sentinel/releases - 启动控制台

# 直接使用jar命令启动项目(控制台本身是一个SpringBoot项目)

java -Dserver.port=8080 -Dcsp.sentinel.dashboard.server=localhost:8080 -Dproject.name=sentinel-dashboard -jar sentinel-dashboard-1.8.2.jar

- 修改

shop-order,在里面载入有关控制台的配置

spring:

cloud:

sentinel:

transport:

port: 9999 #跟控制台交流的端口,随意指定一个未使用的端口即可

dashboard: localhost:8080 # 指定控制台服务的地址

第4步: 通过浏览器访问localhost:8080 进入控制台 ( 默认用户名密码是 sentinel/sentinel

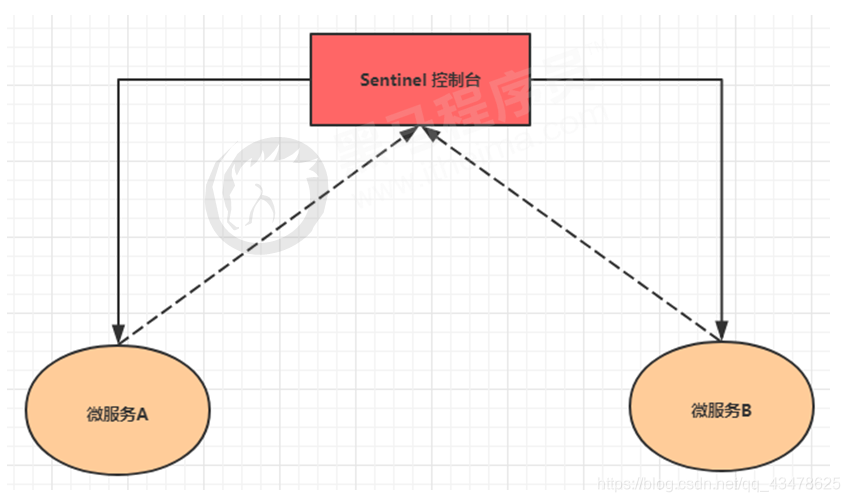

补充:了解控制台的使用原理

Sentinel的控制台其实就是一个SpringBoot编写的程序。我们需要将我们的微服务程序注册到控制台上, 即在微服务中指定控制台的地址, 并且还要开启一个跟控制台传递数据的端口, 控制台也可以通过此端口调用微服务中的监控程序获取微服务的各种信息。

4.4.4 实现一个接口的限流

- 通过控制台为message1添加一个流控规则

2 通过控制台快速频繁访问, 观察效果

4.5 Sentinel的概念和功能

4.5.1 基本概念

- 资源

资源就是Sentinel要保护的东西

资源是 Sentinel 的关键概念。它可以是 Java 应用程序中的任何内容,可以是一个服务,也可以是一个方法,甚至可以是一段代码。

入门案例中的message1方法就可以认为是一个资源

- 规则

规则就是用来定义如何进行资源保护的

作用在资源之上, 定义以什么样的方式保护资源,主要包括流量控制规则、熔断降级规则以及系统保护规则。

入门案例中就是为message1资源设置了一种流控规则,限制了进入message1的流量

4.5.2 重要功能

Sentinel的主要功能就是容错,主要体现为下面这三个:

- 流量控制

流量控制在网络传输中是一个常用的概念,它用于调整网络包的数据。任意时间到来的请求往往是 随机不可控的,而系统的处理能力是有限的。我们需要根据系统的处理能力对流量进行控制。Sentinel 作为一个调配器,可以根据需要把随机的请求调整成合适的形状。 - 熔断降级

当检测到调用链路中某个资源出现不稳定的表现,例如请求响应时间长或异常比例升高的时候,则 对这个资源的调用进行限制,让请求快速失败,避免影响到其它的资源而导致级联故障。

Sentinel 对这个问题采取了两种手段:- 通过并发线程数进行限制

Sentinel 通过限制资源并发线程的数量,来减少不稳定资源对其它资源的影 响。当某个资源出现不稳定的情况下,例如响应时间变长,对资源的直接影响就是会造成线程数的逐步堆 积。当线程数在特定资源上堆积到一定的数量之后,对该资源的新请求就会被拒绝。堆积的 线程完成任务后才开始继续接收请求。 - 通过响应时间对资源进行降级

除了对并发线程数进行控制以外,Sentinel 还可以通过响应时间来快速降级不稳定的资源。当依赖的资源出现响应时间过长后,所有对该资源的访问都会被直接拒绝,直到过了指定的 时间窗口之后才重新恢复。

- 通过并发线程数进行限制

Sentinel 和 Hystrix的区别

两者的原则是一致的, 都是当一个资源出现问题时, 让其快速失败, 不要波及到其它服务但是在限制的手段上, 确采取了完全不一样的方法:

Hystrix 采用的是线程池隔离的方式, 优点是做到了资源之间的隔离, 缺点是增加了线程切换的成本。

Sentinel 采用的是通过并发线程的数量和响应时间来对资源做限制。

- 系统负载保护

Sentinel 同时提供系统维度的自适应保护能力。当系统负载较高的时候,如果还持续让请求进入可能会导致系统崩溃,无法响应。在集群环境下,会把本应这台机器承载的流量转发到其 它的机器上去。如果这个时候其它的机器也处在一个边缘状态的时候,Sentinel 提供了对应的保护机制,让系统的入口流量和系统的负载达到一个平衡,保证系统在能力范围之内处理最多的请 求。

4.6 Sentinel规则

4.6.1 流控规则

流量控制,其原理是监控应用流量的QPS(每秒查询率) 或并发线程数等指标,当达到指定的阈值时对流量进行控制,以避免被瞬时的流量高峰冲垮,从而保障应用的高可用性。

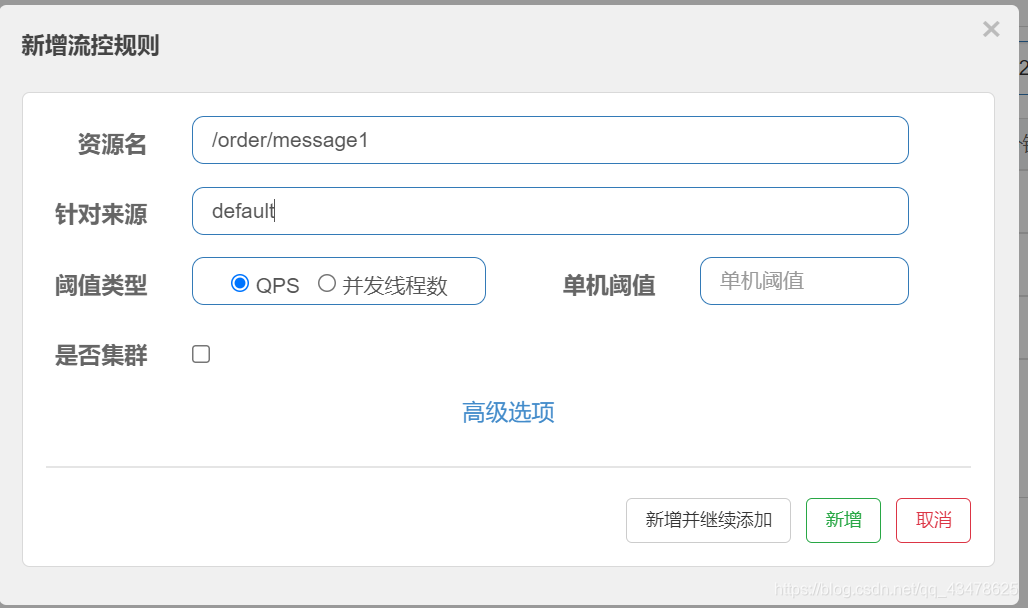

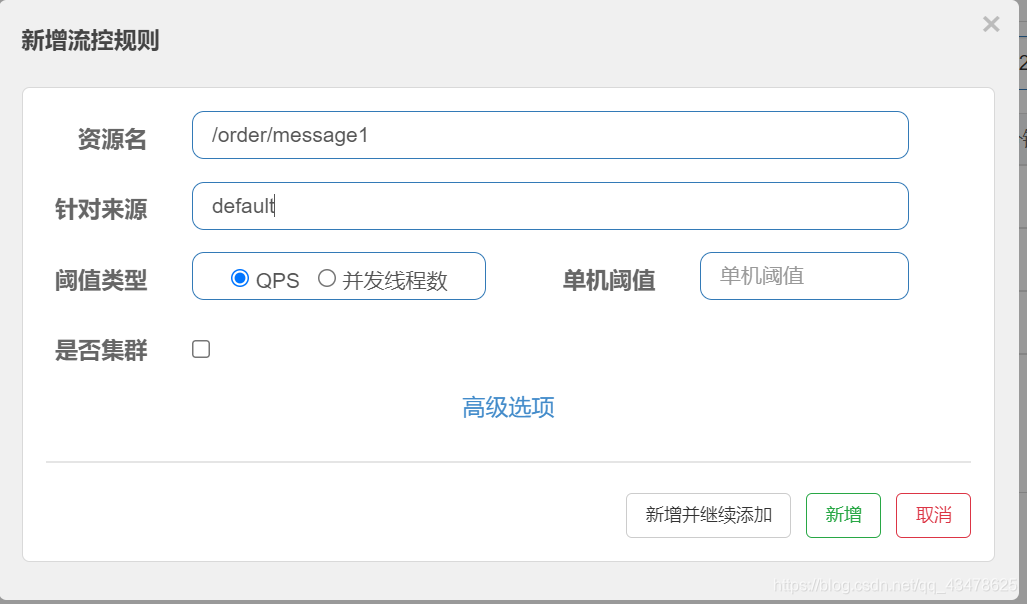

第1步: 点击簇点链路,我们就可以看到访问过的接口地址,然后点击对应的流控按钮,进入流控规则配置页面。新增流控规则界面如下:

资源名:唯一名称,默认是请求路径,可自定义

针对来源:指定对哪个微服务进行限流,默认指default,意思是不区分来源,全部限制

阈值类型/单机阈值:

- QPS(每秒请求数量): 当调用该接口的QPS达到阈值的时候,进行限流

- 线程数:当调用该接口的线程数达到阈值的时候,进行限流

是否集群:暂不需要集群

接下来我们以QPS为例来研究限流规则的配置。

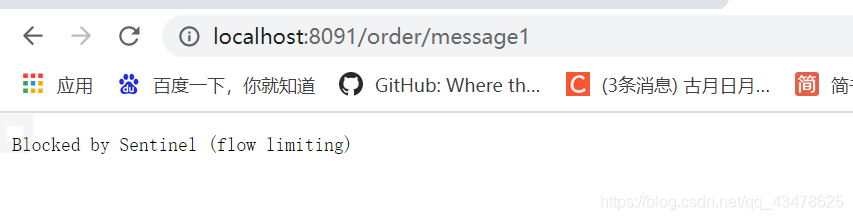

4.6.1.1 简单配置

我们先做一个简单配置,设置阈值类型为QPS,单机阈值为3。即每秒请求量大于3的时候开始限流。

接下来,在流控规则页面就可以看到这个配置。

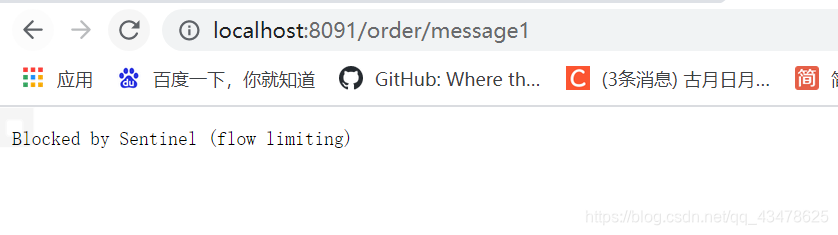

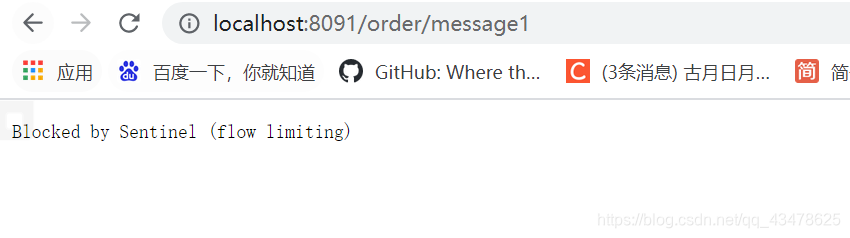

然后快速访问/order/message1 接口,观察效果。此时发现,当QPS > 3的时候,服务就不能正常响应,而是返回Blocked by Sentinel (flow limiting)结果。

4.6.1.2 配置流控模式

点击上面设置流控规则的编辑按钮,然后在编辑页面点击高级选项,会看到有流控模式一栏。

sentinel共有三种流控模式,分别是:

直接(默认):接口达到限流条件时,开启限流

关联:当关联的资源达到限流条件时,开启限流 [适合做应用让步]

链路:当从某个接口过来的资源达到限流条件时,开启限流

下面呢分别演示三种模式:

直接流控模式

直接流控模式是最简单的模式,当指定的接口达到限流条件时开启限流。上面案例使用的就是直接流控 模式。

关联流控模式

关联流控模式指的是,当指定接口关联的接口达到限流条件时,开启对指定接口开启限流。

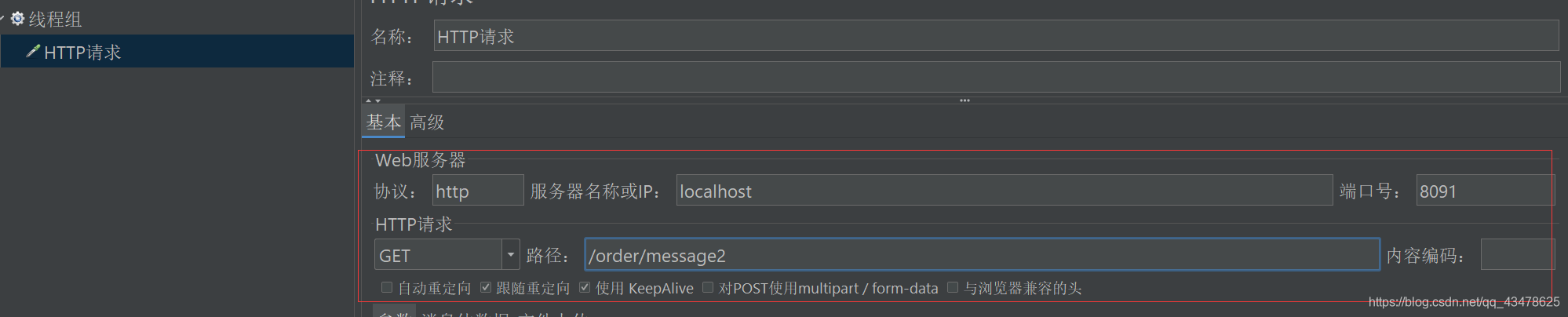

第1步:配置限流规则, 将流控模式设置为关联,关联资源设置为的 /order/message2。

第3步:通过jmeter软件向/order/message2连续发送请求,注意QPS一定要大于3

第4步:访问/order/message1,会发现已经被限流

链路流控模式

链路流控模式指的是,当从某个接口过来的资源达到限流条件时,开启限流。它的功能有点类似于针对 来源配置项,区别在于:针对来源是针对上级微服务,而链路流控是针对上级接口,也就是说它的粒度 更细。

第1步: 编写一个service,在里面添加一个方法message

@Service

public class OrderServiceImpl3 {

@SentinelResource("message")

public void message(){

System.out.println("message");

}

}

第2步: 在Controller中声明两个方法,分别调用service中的方法message

@RestController

@Slf4j

public class OrderController2 {

@Autowired

private OrderServiceImpl3 orderServiceImpl3;

@RequestMapping("/order/message1")

public String message1(){

orderServiceImpl3.message();

return "message1";

}

@RequestMapping("/order/message2")

public String message2(){

orderServiceImpl3.message();

return "message2";

}

}

第3步: 禁止收敛URL的入口 context

从1.6.3 版本开始,Sentinel Web filter默认收敛所有URL的入口context,因此链路限流不生效。

1.7.0 版本开始(对应SCA的2.1.1.RELEASE),官方在CommonFilter 引入了

WEB-CONTENT_UNIFY参数,用于控制是否收敛context。将其配置为false

即可根据不同的URL 进行链路限流.

SCA 2.1.1.RELEASE之后的版本,可以通过配置spring.cloud.sentinel.web-context-unify=false即可关闭收敛

我们当前使用的版本是SpringCloud Alibaba 2.1.0.RELEASE,无法实现链路限流。

目前官方还未发布SCA 2.1.2.RELEASE,所以我们只能使用2.1.1.RELEASE,需要写代码的形式实现

(1) 暂时将SpringCloud Alibaba的版本调整为2.1.1.RELEASE

<spring-cloud-alibaba.version>2.1.1.RELEASE</spring-cloud-alibaba.version>

(2) 配置文件中关闭sentinel的CommonFilter实例化

spring:

cloud:

sentinel:

filter:

enabled: false

(3) 添加一个配置类,自己构建CommonFilter实例

@Configuration

public class FilterContextConfig {

@Bean

public FilterRegistrationBean sentinelFilterRegistration() {

FilterRegistrationBean registration = new FilterRegistrationBean();

registration.setFilter(new CommonFilter()); registration.addUrlPatterns("/*");

// 入口资源关闭聚合

registration.addInitParameter(CommonFilter.WEB_CONTEXT_UNIFY, "false");

registration.setName("sentinelFilter");

registration.setOrder(1);

return registration;

}

}

第4步: 控制台配置限流规则

第5步: 分别通过/order/message1和/order/message2 访问, 发现1没问题, 2的被限流了

4.6.1.3 配置流控效果

- 快速失败(默认) :直接失败,抛出异常,不做任何额外的处理,是最简单的效果

- Warm Up:它从开始阈值到最大QPS阈值会有一个缓冲阶段,一开始的阈值是最大QPS阈值的

1/3,然后慢慢增长,直到最大阈值,适用于将突然增大的流量转换为缓步增长的场景。 - 排队等待:让请求以均匀的速度通过,单机阈值为每秒通过数量,其余的排队等待; 它还会让设置一个超时时间,当请求超过超时间时间还未处理,则会被丢弃。

4.6.2 降级规则

降级规则就是设置当满足什么条件的时候,对服务进行降级。Sentinel提供了三个衡量条件:

- 平均响应时间 :当资源的平均响应时间超过阈值(以 ms 为单位)之后,资源进入准降级状态。如果接下来 1s 内持续进入 5 个请求,它们的 RT都持续超过这个阈值,那么在接下的时间窗口

(以 s 为单位)之内,就会对这个方法进行服务降级。

注意 Sentinel 默认统计的 RT 上限是 4900 ms,超出此阈值的都会算作 4900 ms,若需要变更此上限可以通过启动配置项 -Dcsp.sentinel.statistic.max.rt=xxx 来配置。

- 异常比例:当资源的每秒异常总数占通过量的比值超过阈值之后,资源进入降级状态,即在接下的 时间窗口(以 s 为单位)之内,对这个方法的调用都会自动地返回。异常比率的阈值范围是 [0.0, 1.0]。

第1步: 首先模拟一个异常

int i = 0;

@RequestMapping("/order/message2")

public String message2() {

i++;

//异常比例为0.333

if (i % 3 == 0){

throw new RuntimeException();

}

return "message2";

}

第2步: 设置异常比例为0.25

- 异常数 :当资源近 1 分钟的异常数目超过阈值之后会进行服务降级。注意由于统计时间窗口是分钟级别的,若时间窗口小于 60s,则结束熔断状态后仍可能再进入熔断状态。

问题:

流控规则和降级规则返回的异常页面是一样的,我们怎么来区分到底是什么原因导致的呢?

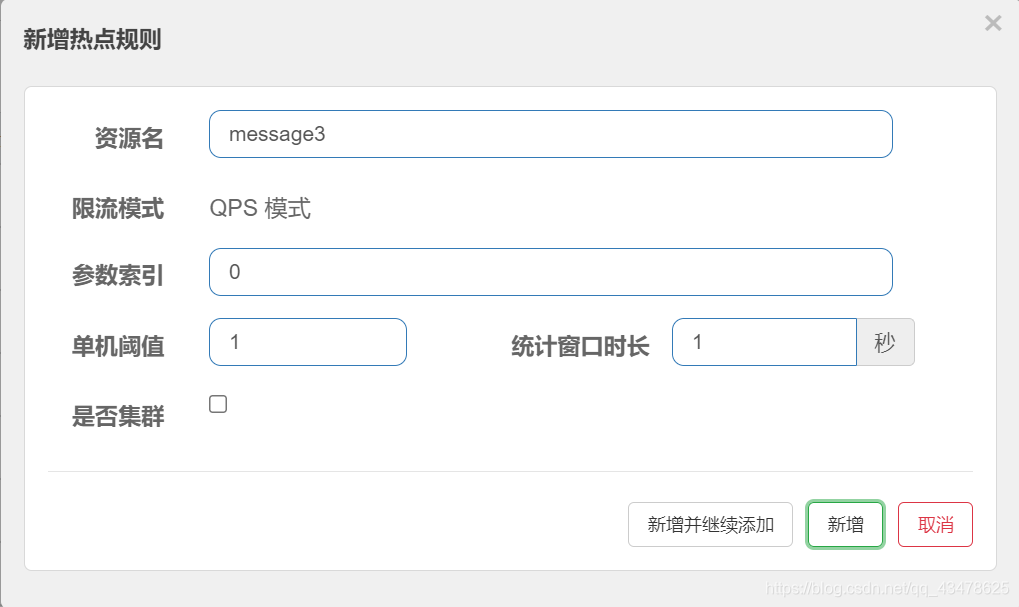

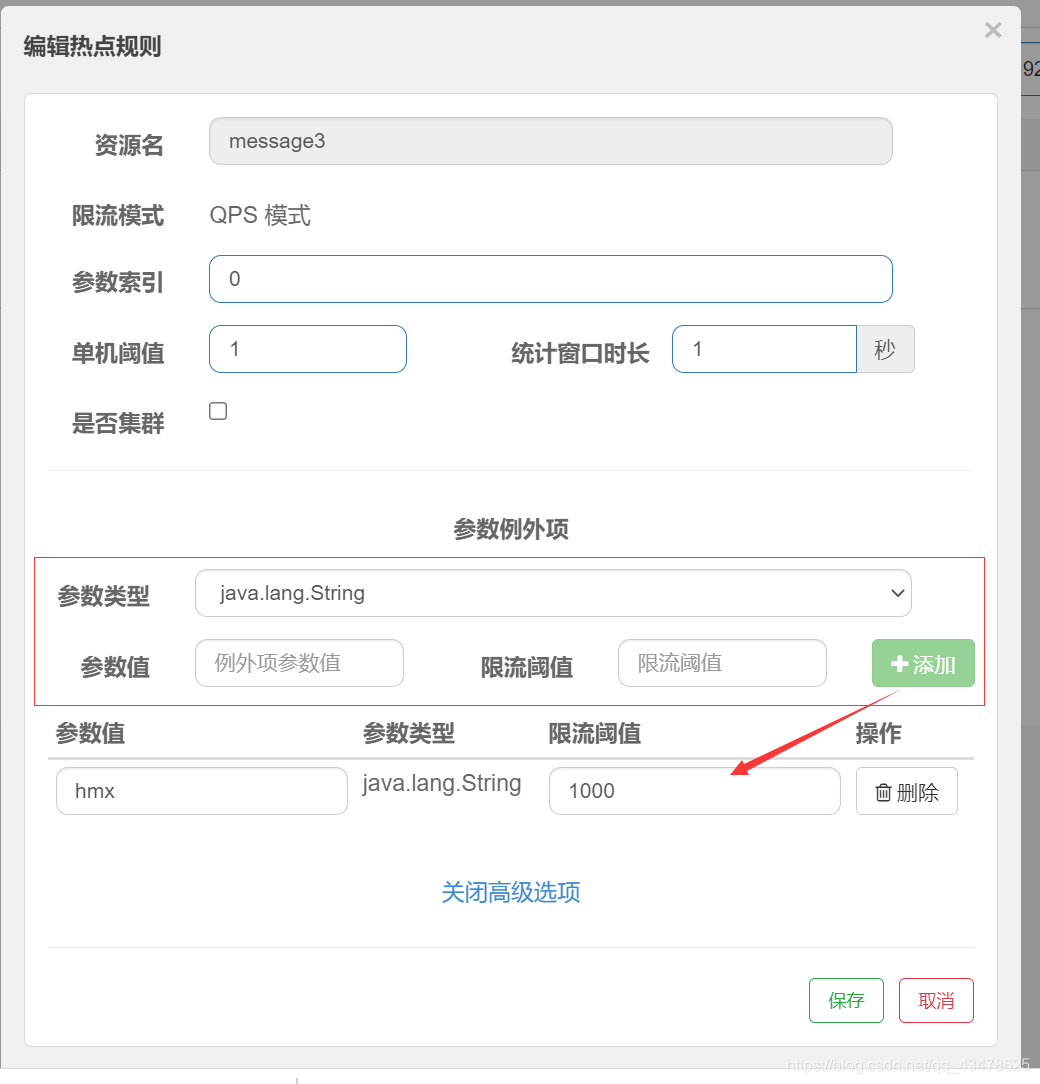

4.6.3 热点规则

热点参数流控规则是一种更细粒度的流控规则, 它允许将规则具体到参数上。

热点规则简单使用

第1步: 编写代码

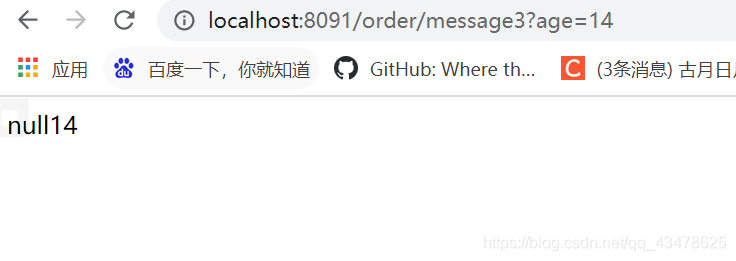

@RequestMapping("/order/message3")

@SentinelResource("message3") //注意这里必须使用这个注解标识,否则热点规则不生效

public String message3(String name, Integer age){

return name + age;

}

第2步: 配置热点规则

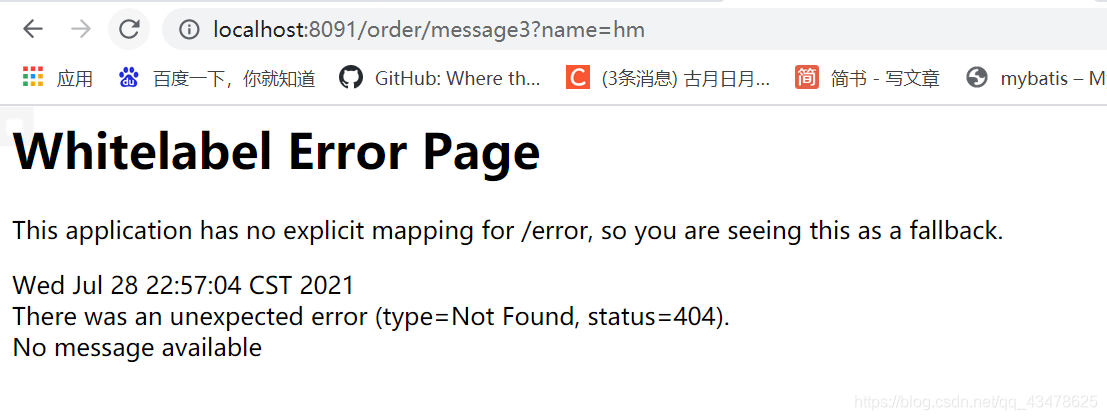

第3步: 分别用两个参数访问,会发现只对第一个参数限流了

热点规则增强使用

参数例外项允许对一个参数的具体值进行流控编辑刚才定义的规则,增加参数例外项

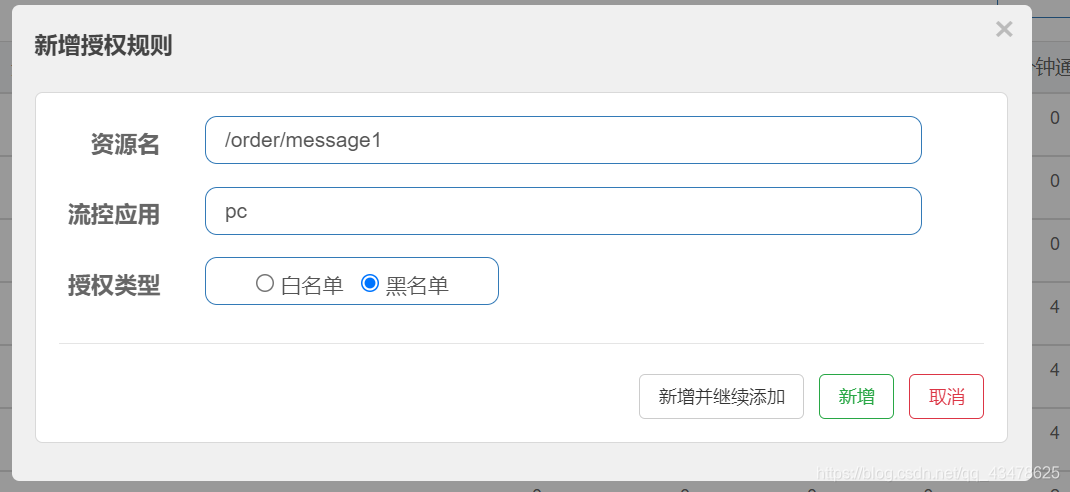

4.6.4 授权规则

很多时候,我们需要根据调用来源来判断该次请求是否允许放行,这时候可以使用 Sentinel 的来源访问控制的功能。来源访问控制根据资源的请求来源(origin)限制资源是否通过:

- 若配置白名单,则只有请求来源位于白名单内时才可通过;

- 若配置黑名单,则请求来源位于黑名单时不通过,其余的请求通过。

上面的资源名和授权类型不难理解,但是流控应用怎么填写呢?

其实这个位置要填写的是来源标识,Sentinel提供了RequestOriginParser 接口来处理来源。

只要Sentinel保护的接口资源被访问,Sentinel就会调用RequestOriginParser 的实现类去解析访问来源。

第1步: 自定义来源处理规则

@Component

public class RequestOriginParserDefinition implements RequestOriginParser {

/**

* 定义区分来源: 本质作用是通过request域获取到来源标识

* app pc

* 然后交给流控应用 位置进行匹配

* @param request

* @return

*/

@Override

public String parseOrigin(HttpServletRequest request) {

String serviceName = request.getParameter("serviceName");

if (StringUtils.isEmpty(serviceName)) {

throw new RuntimeException("serviceName is not Empty");

}

return serviceName;

}

}

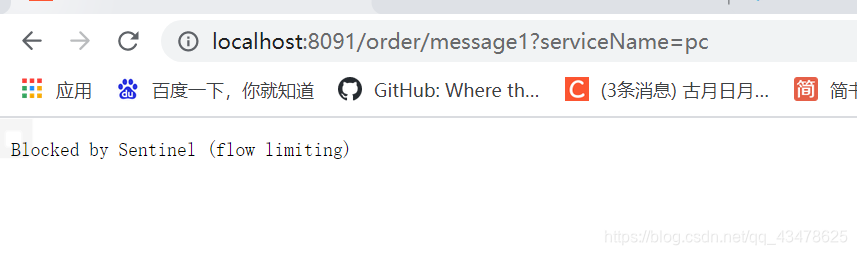

第2步: 授权规则配置

这个配置的意思是只有serviceName=pc不能访问(黑名单)

第3步: 访问 [http://localhost:8091/order/message1?serviceName=pc](http://localhost:8091/order/message1 ?serviceName=pc)观察结果

4.6.5 系统规则

系统保护规则是从应用级别的入口流量进行控制,从单台机器的总体 Load、RT、入口 QPS 、CPU 使用率和线程数五个维度监控应用数据,让系统尽可能跑在最大吞吐量的同时保证系统整体的稳定性。

系统保护规则是应用整体维度的,而不是资源维度的,并且仅对入口流量 (进入应用的流量) 生效。

- Load(仅对 Linux/Unix-like 机器生效):当系统 load1 超过阈值,且系统当前的并发线程数超过系统容量时才会触发系统保护。系统容量由系统的 maxQps * minRt 计算得出。设定参考值一般是 CPU cores * 2.5。

- RT:当单台机器上所有入口流量的平均 RT 达到阈值即触发系统保护,单位是毫秒。线程数:当单台机器上所有入口流量的并发线程数达到阈值即触发系统保护。

- 入口 QPS:当单台机器上所有入口流量的 QPS 达到阈值即触发系统保护。

- CPU使用率:当单台机器上所有入口流量的 CPU使用率达到阈值即触发系统保护。

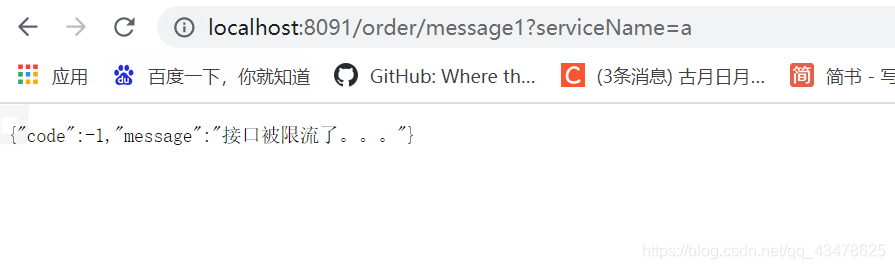

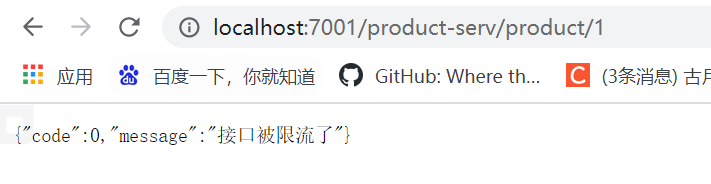

扩展: 自定义异常返回

@Component

public class ExceptionHandlerPage implements UrlBlockHandler {

/**

* 异常处理页面

* BlockException 异常接口,包含Sentinel的五个异常

* FlowException 限流异常

* DegradeException 降级异常

* ParamFlowException 参数限流异常

* AuthorityException 授权异常

* SystemBlockException 系统负载异常

* @param httpServletRequest

* @param httpServletResponse

* @param e

* @throws IOException

*/

@Override

public void blocked(HttpServletRequest httpServletRequest, HttpServletResponse httpServletResponse, BlockException e) throws IOException {

httpServletResponse.setContentType("application/json;charset=utf-8");

ResponseData data = null;

if(e instanceof FlowException){

data = new ResponseData(-1, "接口被限流了。。。");

} else if(e instanceof DegradeException){

data = new ResponseData(-2, "接口被降级了");

}

httpServletResponse.getWriter().write(JSON.toJSONString(data));

}

}

@Data

@AllArgsConstructor

@NoArgsConstructor

class ResponseData{

private int code;

private String message;

}

4.7 @SentinelResource的使用

在定义了资源点之后,我们可以通过Dashboard来设置限流和降级策略来对资源点进行保护。同时还能 通过@SentinelResource来指定出现异常时的处理策略。

用于定义资源,并提供可选的异常处理和 fallback 配置项。其主要参数如下:

| 属性 | 作用 |

|---|---|

| value | 资源名称 |

| entryType | entry类型,标记流量的方向,取值IN/OUT,默认是OUT |

| blockHandler | 处理BlockException的函数名称,函数要求:1. 必须是 public2. 返回类型 参数与原方法一致3. 默认需和原方法在同一个类中。若希望使用其他类的函数,可配置blockHandlerClass ,并指定blockHandlerClass里面的方法。 |

| blockHandlerClass | 存放blockHandler的类,对应的处理函数必须static修饰。 |

| fallback | 用于在抛出异常的时候提供fallback处理逻辑。fallback函数可以针对所 有类型的异常(除了 exceptionsToIgnore 里面排除掉的异常类型)进行处理。函数要求:1. 返回类型与原方法一致2. 参数类型需要和原方法相匹配3. 默认需和原方法在同一个类中。若希望使用其他类的函数,可配置fallbackClass ,并指定fallbackClass里面的方法。 |

| fallbackClass | 存放fallback的类。对应的处理函数必须static修饰。 |

| defaultFallback | 用于通用的 fallback 逻辑。默认fallback函数可以针对所有类型的异常进行处理。若同时配置了 fallback 和 defaultFallback,以fallback为准。函数要求:1. 返回类型与原方法一致2. 方法参数列表为空,或者有一个 Throwable 类型的参数。3. 默认需要和原方法在同一个类中。若希望使用其他类的函数,可配置fallbackClass ,并指定 fallbackClass 里面的方法。 |

| exceptionsToIgnore | 指定排除掉哪些异常。排除的异常不会计入异常统计,也不会进入fallback逻辑,而是原样抛出。 |

| exceptionsToTrace | 需要trace的异常 |

定义限流后和降级后的处理方法

方式一: 直接将限流和降级方法定义在方法中

@Service

@Slf4j

public class OrderServiceImpl3 {

int i = 0;

/**

* 定义一个资源

* 定义当资源内部发生异常的时候的处理逻辑

* blockHandler 定义当资源内部发生了BlockException应该进入的方法[不活的是Sentinel定义的异常]

* fallback 定义当资源内部发生了Throwable应该进入的方法

*/

@SentinelResource(value = "message",blockHandler = "blockHandler",fallback = "fallback")

public String message(String name){

i++;

if(i % 3 == 0){

throw new RuntimeException();

}

return "message";

}

/**

* blockHandler

* 要求:

* 1. 当前方法的返回值和参数要跟原方法一致

* 2. 但是允许在参数列表的最后一项加入一个参数BlockException,用来接收原方法中的异常

* @param name

* @param e

* @return

*/

public String blockHandler(String name, BlockException e){

//自定义异常处理逻辑

log.error("触发了BlockException,内容为{}",e);

return "BlockException";

}

/**

* fallback

* 要求:

* 1. 当前方法的返回值和参数要跟原方法一致

* 2. 但是允许在参数列表的最后一项加入一个参数BlockException,用来接收原方法中的异常

* @param name

* @param e

* @return

*/

public String fallback(String name, Throwable e){

//自定义异常处理逻辑

log.error("触发了Throwable,内容为{}",e);

return "Throwable";

}

}

方式二: 将限流和降级方法外置到单独的类中

@Service

@Slf4j

public class OrderServiceImpl3 {

int i = 0;

/**

* 定义一个资源

* 定义当资源内部发生异常的时候的处理逻辑

* blockHandler 定义当资源内部发生了BlockException应该进入的方法[不活的是Sentinel定义的异常]

* fallback 定义当资源内部发生了Throwable应该进入的方法

*/

@SentinelResource(value = "message",blockHandler = "blockHandler",fallback = "fallback")

public String message(String name){

i++;

if(i % 3 == 0){

throw new RuntimeException();

}

return "message";

}

/**

* blockHandler

* 要求:

* 1. 当前方法的返回值和参数要跟原方法一致

* 2. 但是允许在参数列表的最后一项加入一个参数BlockException,用来接收原方法中的异常

* @param name

* @param e

* @return

*/

public String blockHandler(String name, BlockException e){

//自定义异常处理逻辑

log.error("触发了BlockException,内容为{}",e);

return "BlockException";

}

/**

* fallback

* 要求:

* 1. 当前方法的返回值和参数要跟原方法一致

* 2. 但是允许在参数列表的最后一项加入一个参数BlockException,用来接收原方法中的异常

* @param name

* @param e

* @return

*/

public String fallback(String name, Throwable e){

//自定义异常处理逻辑

log.error("触发了Throwable,内容为{}",e);

return "Throwable";

}

}

log.error("{}", ex);

return "接口被限流或者降级了...";

}

}

@Slf4j

public class OrderServiceImpl3FallbackClass {

//注意这里必须使用static修饰方法

public static String fallback(Throwable throwable) { log.error("{}", throwable);

return "接口发生异常了...";

}

}

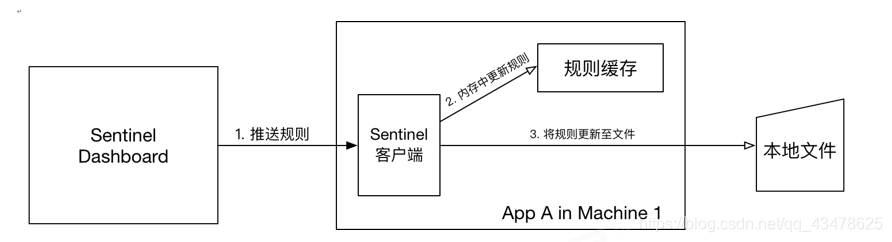

4.8 Sentinel规则持久化

通过前面的讲解,我们已经知道,可以通过Dashboard来为每个Sentinel客户端设置各种各样的规 则,但是这里有一个问题,就是这些规则默认是存放在内存中,极不稳定,所以需要将其持久化。

本地文件数据源会定时轮询文件的变更,读取规则。这样我们既可以在应用本地直接修改文件来更 新规则,也可以通过 Sentinel 控制台推送规则。以本地文件数据源为例,推送过程如下图所示:

首先 Sentinel 控制台通过 API 将规则推送至客户端并更新到内存中,接着注册的写数据源会将新的规则保存到本地的文件中。

- 编写处理类

public class FilePersistence implements InitFunc {

@Value("spring.application.name")

private String applicationName;

@Override

public void init() throws Exception {

String ruleDir = System.getProperty("user.home") + "/sentinel-rules/" + applicationName;

String flowRulePath = ruleDir + "/flow-rule.json";

String degradeRulePath = ruleDir + "/degrade-rule.json";

String systemRulePath = ruleDir + "/system-rule.json";

String authorityRulePath = ruleDir + "/authority-rule.json";

String paramFlowRulePath = ruleDir + "/param-flow-rule.json";

this.mkdirIfNotExists(ruleDir);

this.createFileIfNotExists(flowRulePath);

this.createFileIfNotExists(degradeRulePath);

this.createFileIfNotExists(systemRulePath);

this.createFileIfNotExists(authorityRulePath);

this.createFileIfNotExists(paramFlowRulePath);

// 流控规则

ReadableDataSource<String, List<FlowRule>> flowRuleRDS = new FileRefreshableDataSource<>(

flowRulePath, flowRuleListParser

);

FlowRuleManager.register2Property(flowRuleRDS.getProperty()); WritableDataSource<List<FlowRule>> flowRuleWDS = new

FileWritableDataSource<>(

flowRulePath, this::encodeJson

);

WritableDataSourceRegistry.registerFlowDataSource(flowRuleWDS);

// 降级规则

ReadableDataSource<String, List<DegradeRule>> degradeRuleRDS = new FileRefreshableDataSource<>(

degradeRulePath, degradeRuleListParser

);

DegradeRuleManager.register2Property(degradeRuleRDS.getProperty()); WritableDataSource<List<DegradeRule>> degradeRuleWDS = new

FileWritableDataSource<>(

degradeRulePath, this::encodeJson

);

WritableDataSourceRegistry.registerDegradeDataSource(degradeRuleWDS);

// 系统规则

ReadableDataSource<String, List<SystemRule>> systemRuleRDS = new FileRefreshableDataSource<>(

systemRulePath, systemRuleListParser

);

SystemRuleManager.register2Property(systemRuleRDS.getProperty()); WritableDataSource<List<SystemRule>> systemRuleWDS = new

FileWritableDataSource<>(

systemRulePath, this::encodeJson

);

WritableDataSourceRegistry.registerSystemDataSource(systemRuleWDS);

// 授权规则

ReadableDataSource<String, List<AuthorityRule>> authorityRuleRDS = new FileRefreshableDataSource<>(

authorityRulePath, authorityRuleListParser

);

AuthorityRuleManager.register2Property(authorityRuleRDS.getProperty()); WritableDataSource<List<AuthorityRule>> authorityRuleWDS = new

FileWritableDataSource<>(

authorityRulePath, this::encodeJson

);

WritableDataSourceRegistry.registerAuthorityDataSource(authorityRuleWDS);

// 热点参数规则

ReadableDataSource<String, List<ParamFlowRule>> paramFlowRuleRDS = new FileRefreshableDataSource<>(

paramFlowRulePath, paramFlowRuleListParser

);

ParamFlowRuleManager.register2Property(paramFlowRuleRDS.getProperty()); WritableDataSource<List<ParamFlowRule>> paramFlowRuleWDS = new

FileWritableDataSource<>(

paramFlowRulePath, this::encodeJson

);

ModifyParamFlowRulesCommandHandler.setWritableDataSource(paramFlowRuleWDS);

}

private Converter<String, List<FlowRule>> flowRuleListParser = source -> JSON.parseObject(

source,

new TypeReference<List<FlowRule>>() {

}

);

private Converter<String, List<DegradeRule>> degradeRuleListParser = source

-> JSON.parseObject(

source,

new TypeReference<List<DegradeRule>>() {

}

);

private Converter<String, List<SystemRule>> systemRuleListParser = source -> JSON.parseObject(

source,

new TypeReference<List<SystemRule>>() {

}

);

private Converter<String, List<AuthorityRule>> authorityRuleListParser = source -> JSON.parseObject(

source,

new TypeReference<List<AuthorityRule>>() {

}

);

private Converter<String, List<ParamFlowRule>> paramFlowRuleListParser = source -> JSON.parseObject(

source,

new TypeReference<List<ParamFlowRule>>() {

}

);

private void createFileIfNotExists(String filePath) throws IOException { File file = new File(filePath);

if (!file.exists()) { file.createNewFile();

}

}

private void mkdirIfNotExists(String filePath) throws IOException { File file = new File(filePath);

if (!file.exists()) {

file.mkdirs();

}

}

private <T> String encodeJson(T t) { return JSON.toJSONString(t);

}

}

2 添加配置

在resources下创建配置目录META-INF/services ,然后添加文件

com.alibaba.csp.sentinel.init.InitFunc

在文件中添加配置类的路径

com.hmx.config.FilePersistence

4.9 Feign整合Sentinel

第1步: 引入sentinel的依赖

<!--sentinel客户端-->

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-sentinel</artifactId>

</dependency>

第2步: 在配置文件中开启Feign对Sentinel的支持

feign:

sentinel:

enabled: true

第3步: 创建容错类

@Component

@Slf4j

public class ProductServiceFallBack implements ProductService {

@Override

public Product findByPid(Integer pid) {

Product product = new Product();

product.setPid(-1);

return product;

}

}

第4步: 为被容器的接口指定容错类

@FeignClient(value = "service-product",fallback = ProductServiceFallback.class)

public interface ProductService {

@GetMapping(value = "/product/{pid}")

Product findByPid(@PathVariable("pid") Integer pid);

}

第5步: 修改controller

@RestController

@Slf4j

public class OrderController {

@Autowired

private RestTemplate restTemplate;

@Autowired

private OrderService orderService;

@Autowired

private OrderServiceImpl3 orderServiceImpl3;

@Autowired

private DiscoveryClient discoveryClient;

@Autowired

private ProductService productService;

//下单--feign

@GetMapping("/order/prod/{pid}")

public Order order(@PathVariable("pid") Integer pid){

log.info(">>客户下单,这时候要调用商品微服务查询商品信息");

//直接使用微服务名字,从nacos中获取服务地址

String url = "service-product";

Product product = productService.findByPid(pid);

if(product.getPid() == -1){

Order order = new Order();

order.setPname("下单失败");

return order;

}

log.info(">> 商品信息,查询结果:" + JSON.toJSONString(product));

//模拟一次网络延时

try {

Thread.sleep(100);

} catch (InterruptedException e) {

e.printStackTrace();

}

Order order = new Order();

order.setUid(1);

order.setUsername("测试用户");

order.setPid(pid);

order.setPname(product.getPname());

order.setPprice(product.getPprice());

order.setNumber(1);

//为了不产生太多垃圾数据,暂时不做订单保存

//orderService.save(order);

return order;

}

//测试高并发

@RequestMapping("/order/message")

public String message(){

return orderServiceImpl3.message("xxx");

}

}

第6步: 停止所有shop-product服务,重启shop-order服务,访问请求,观察容错效果

扩展: 如果想在容错类中拿到具体的错误,可以使用下面的方式

@FeignClient(

value = "service-product",

//fallback = ProductServiceFallBack.class, fallbackFactory = ProductServiceFallBackFactory.class)

public interface ProductService {

//@FeignClient的value + @RequestMapping的value值 其实就是完成的请求地址

//"http://service-product/product/" + pid

@RequestMapping("/product/{pid}")//指定请求的URI部分

Product findByPid(@PathVariable Integer pid);

}

@Component

public class ProductServiceFallBackFactory implements FallbackFactory<ProductService> {

@Override

public ProductService create(Throwable throwable)

{ return new ProductService() {

@Override

public Product findByPid(Integer pid) {

throwable.printStackTrace();

Product product = new Product(); product.setPid(-1);

return product;

}

};

}

}

注意: fallback和fallbackFactory只能使用其中一种方式

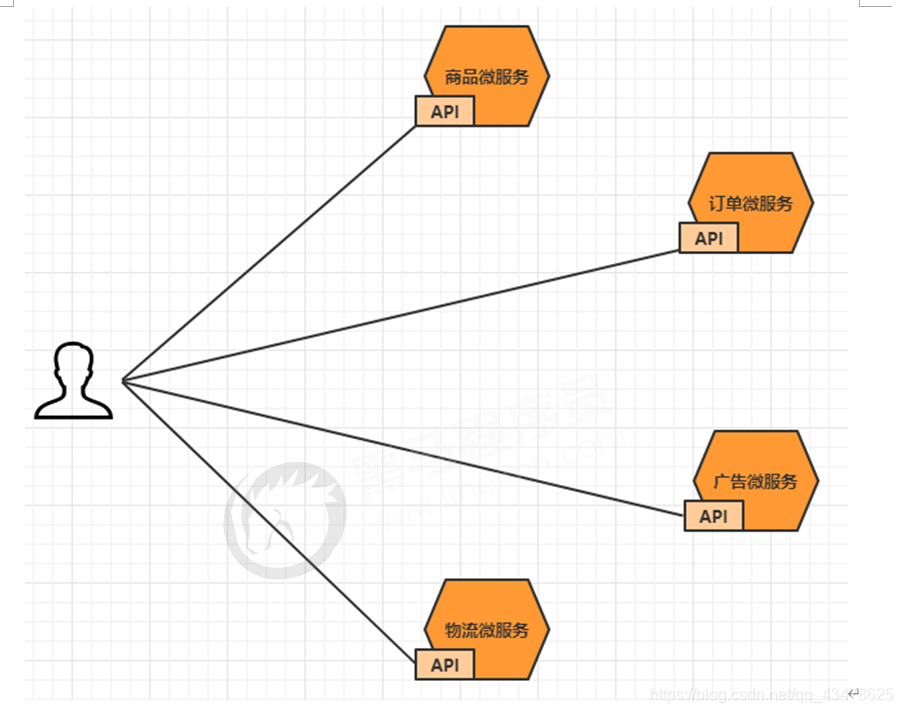

第五章 Gateway–服务网关

5.1 网关简介

大家都都知道在微服务架构中,一个系统会被拆分为很多个微服务。那么作为客户端要如何去调用 这么多的微服务呢?如果没有网关的存在,我们只能在客户端记录每个微服务的地址,然后分别去调 用。

这样的架构,会存在着诸多的问题:

- 客户端多次请求不同的微服务,增加客户端代码或配置编写的复杂性

- 认证复杂,每个服务都需要独立认证。

- 存在跨域请求,在一定场景下处理相对复杂。

上面的这些问题可以借助API网关来解决。

所谓的API网关,就是指系统的统一入口,它封装了应用程序的内部结构,为客户端提供统一服

务,一些与业务本身功能无关的公共逻辑可以在这里实现,诸如认证、鉴权、监控、路由转发等等。 添加上API网关之后,系统的架构图变成了如下所示:

我们也可以观察下,我们现在的整体架构图:

在业界比较流行的网关,有下面这些:

-

Ngnix+lua

使用nginx的反向代理和负载均衡可实现对api服务器的负载均衡及高可用

lua是一种脚本语言,可以来编写一些简单的逻辑, nginx支持lua脚本 -

Kong

基于Nginx+Lua开发,性能高,稳定,有多个可用的插件(限流、鉴权等等)可以开箱即用。 问题: 只支持Http协议;二次开发,自由扩展困难;提供管理API,缺乏更易用的管控、配置方式。 -

Zuul Netflix开源的网关,功能丰富,使用JAVA开发,易于二次开发 问题:缺乏管控,无法动态配置;依赖组件较多;处理Http请求依赖的是Web容器,性能不如Nginx

-

Spring Cloud Gateway

Spring公司为了替换Zuul而开发的网关服务,将在下面具体介绍。

注意:SpringCloud alibaba技术栈中并没有提供自己的网关,我们可以采用Spring Cloud Gateway来做网关

5.2 Gateway简介

Spring Cloud Gateway是Spring公司基于Spring 5.0,Spring Boot 2.0 和 Project Reactor 等技术开发的网关,它旨在为微服务架构提供一种简单有效的统一的 API 路由管理方式。它的目标是替代Netflix Zuul,其不仅提供统一的路由方式,并且基于 Filter 链的方式提供了网关基本的功能,例如:安全,监控和限流。

优点:

- 性能强劲:是第一代网关Zuul的1.6倍

- 功能强大:内置了很多实用的功能,例如转发、监控、限流等

- 设计优雅,容易扩展

缺点: - 其实现依赖Netty与WebFlux,不是传统的Servlet编程模型,学习成本高

- 不能将其部署在Tomcat、Jetty等Servlet容器里,只能打成jar包执行

- 需要Spring Boot 2.0及以上的版本,才支持

5.3 Gateway快速入门

要求: 通过浏览器访问api网关,然后通过网关将请求转发到商品微服务

5.3.1 基础版

第1步:创建一个api-gateway 的模块,导入相关依赖

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<parent>

<artifactId>Springcloud-alibaba</artifactId>

<groupId>com.hmx</groupId>

<version>1.0-SNAPSHOT</version>

</parent>

<modelVersion>4.0.0</modelVersion>

<artifactId>api-gateway</artifactId>

<properties>

<maven.compiler.source>8</maven.compiler.source>

<maven.compiler.target>8</maven.compiler.target>

</properties>

<dependencies>

<!-- gateway网关-->

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-gateway</artifactId>

</dependency>

</dependencies>

</project>

第2步:创建主类

@SpringBootApplication

public class GatewayApplication {

public static void main(String[] args) {

SpringApplication.run(GatewayApplication.class,args);

}

}

第3步: 添加配置文件

server:

port: 7001

spring:

application:

name: api-gateway

cloud:

gateway:

routes: # 路由数组[路由 就是指定当请求满足什么条件的时候转到哪个微服务]

- id: product_route # 当前路由的标识,要求唯一

uri: http://localhost:8081 # 请求要转发到的地址

order: 1 # 路由的优先级,数字越小级别越高

predicates: # 断言(就是路由转发要满足的条件)

- Path=/product-serv/** # 当请求路径满足Path指定的规则时,才进行路由转发

filters: # 过滤器,请求在传递过程中可以通过过滤器对其进行一定的修改

- StripPrefix=1 # 转发前去掉1层路径

第4步: 启动项目, 并通过网关去访问微服务

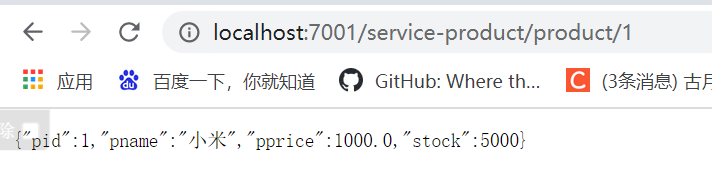

5.3.2 增强版

现在在配置文件中写死了转发路径的地址, 前面我们已经分析过地址写死带来的问题, 接下来我们从注册中心获取此地址。

第1步: 加入nacos依赖

<!-- nacos客户端-->

<dependency>

<groupId>com.alibaba.cloud</groupId>

<artifactId>spring-cloud-starter-alibaba-nacos-discovery</artifactId>

</dependency>

第2步:在主类上添加注解

@EnableDiscoveryClient

第3步:修改配置文件

server:

port: 7001

spring:

application:

name: api-gateway

cloud:

nacos:

discovery:

server-addr: 127.0.0.1:8848

gateway:

discovery:

locator:

enabled: true # 让gateway可以发现nacos中的微服务

routes: # 路由数组[路由 就是指定当请求满足什么条件的时候转到哪个微服务]

- id: product_route # 当前路由的标识,要求唯一

uri: lb://service-product # lb 指的是从nacos中按照名称获取微服务,并遵循负载均衡策略

predicates: # 断言(就是路由转发要满足的条件)

- Path=/product-serv/** # 当请求路径满足Path指定的规则时,才进行路由转发

filters: # 过滤器,请求在传递过程中可以通过过滤器对其进行一定的修改

- StripPrefix=1 # 转发前去掉1层路径

第4步:测试

5.3.3 简写版

第1步: 去掉关于路由的配置

server:

port: 7001

spring:

application:

name: gateway

cloud:

nacos:

discovery:

server-addr: 127.0.0.1:8848

gateway:

discovery:

locator:

enabled: true # 让gateway可以发现nacos中的微服务

第2步: 启动项目,并通过网关去访问微服务

这时候,就发现只要按照网关地址/微服务/接口的格式去访问,就可以得到成功响应

5.4 Gateway核心架构

5.4.1 基本概念

路由(Route) 是 gateway 中最基本的组件之一,表示一个具体的路由信息载体。主要定义了下面的几个信息:

-

id,路由标识符,区别于其他 Route。

-

uri,路由指向的目的地 uri,即客户端请求最终被转发到的微服务。

-

order,用于多个 Route 之间的排序,数值越小排序越靠前,匹配优先级越高。

-

predicate,断言的作用是进行条件判断,只有断言都返回真,才会真正的执行路由。

-

filter,过滤器用于修改请求和响应信息。

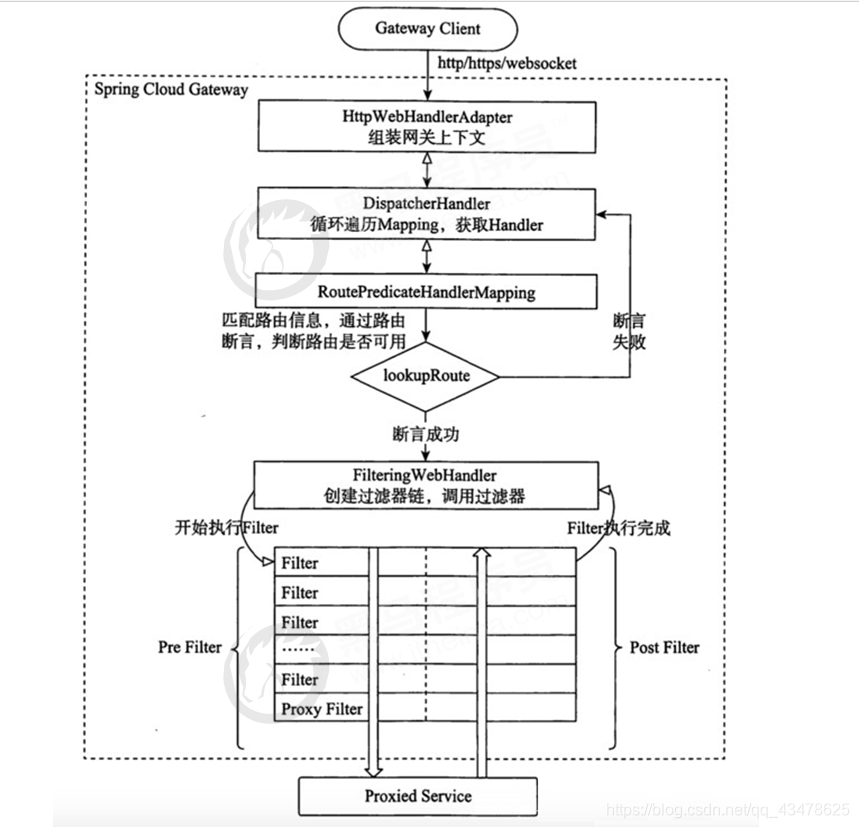

5.4.2 执行流程

执行流程大体如下:

-

Gateway Client向Gateway Server发送请求

-

请求首先会被HttpWebHandlerAdapter进行提取组装成网关上下文

-

然后网关的上下文会传递到DispatcherHandler,它负责将请求分发给

RoutePredicateHandlerMapping -

RoutePredicateHandlerMapping负责路由查找,并根据路由断言判断路由是否可用

-

如果过断言成功,由FilteringWebHandler创建过滤器链并调用

-

请求会一次经过PreFilter–微服务–PostFilter的方法,最终返回响应

5.5 断言

Predicate(断言, 谓词) 用于进行条件判断,只有断言都返回真,才会真正的执行路由。断言就是说: 在 什么条件下 才能进行路由转发

5.5.1 内置路由断言工厂

SpringCloud Gateway包括许多内置的断言工厂,所有这些断言都与HTTP请求的不同属性匹配。具体如下:

- 基于Datetime类型的断言工厂

此类型的断言根据时间做判断,主要有三个:

AfterRoutePredicateFactory: 接收一个日期参数,判断请求日期是否晚于指定日期BeforeRoutePredicateFactory: 接收一个日期参数,判断请求日期是否早于指定日期BetweenRoutePredicateFactory: 接收两个日期参数,判断请求日期是否在指定时间段内

-After=2019-12-31T23:59:59.789+08:00[Asia/Shanghai]

- 基于远程地址的断言工厂 RemoteAddrRoutePredicateFactory:接收一个IP地址段,判断请求主机地址是否在地址段中

-RemoteAddr=192.168.1.1/24

- 基于Cookie的断言工厂

CookieRoutePredicateFactory:接收两个参数,cookie 名字和一个正则表达式。 判断请求

cookie是否具有给定名称且值与正则表达式匹配。

-Cookie=chocolate, ch.

- 基于Header的断言工厂

HeaderRoutePredicateFactory:接收两个参数,标题名称和正则表达式。 判断请求Header是否具有给定名称且值与正则表达式匹配。

-Header=X-Request-Id, \d+

- 基于Host的断言工厂

HostRoutePredicateFactory:接收一个参数,主机名模式。判断请求的Host是否满足匹配规则。

-Host=**.testhost.org

- 基于Method请求方法的断言工厂

MethodRoutePredicateFactory:接收一个参数,判断请求类型是否跟指定的类型匹配。

-Method=GET

- 基于Path请求路径的断言工厂

PathRoutePredicateFactory:接收一个参数,判断请求的URI部分是否满足路径规则。

-Path=/foo/{segment}

- 基于Query请求参数的断言工厂

QueryRoutePredicateFactory :接收两个参数,请求param和正则表达式, 判断请求参数是否具有给定名称且值与正则表达式匹配。

-Query=baz, ba.

- 基于路由权重的断言工厂

WeightRoutePredicateFactory:接收一个[组名,权重], 然后对于同一个组内的路由按照权重转发

routes:

-id: weight_route1 uri: host1 predicates:

-Path=/product/**

-Weight=group3, 1

-id: weight_route2 uri: host2 predicates:

-Path=/product/**

-Weight= group3, 9

内置路由断言工厂的使用

接下来我们验证几个内置断言的使用:

server:

port: 7001

spring:

application:

name: gateway

cloud:

nacos:

discovery:

server-addr: 127.0.0.1:8848

gateway:

discovery:

locator:

enabled: true # 让gateway可以发现nacos中的微服务

routes:

- id: product_route

uri: lb://service-product

predicates:

- Path=/product-serv/**

- Before=2021-08-04T00:00:00.000+08:00 # 限制请求时间在2021-8-4之前

- Method=GET # 限制请求方式为GET

filters:

- StripPrefix=1

5.5.2 自定义路由断言工厂

我们来设定一个场景: 假设我们的应用仅仅让age在(min,max)之间的人来访问。

第1步:在配置文件中,添加一个Age的断言配置

server:

port: 7001

spring:

application:

name: gateway

cloud:

nacos:

discovery:

server-addr: 127.0.0.1:8848

gateway:

discovery:

locator:

enabled: true # 让gateway可以发现nacos中的微服务

routes:

- id: product_route

uri: lb://service-product

predicates:

- Path=/product-serv/**

- Age=20,60 # 限制年龄只有18到60岁之间的人才能访问

filters:

- StripPrefix=1

第2步:自定义一个断言工厂, 实现断言方法

@Component

// 泛型 用于接收一个配置类,配置类用于接收配置文件中的配置

public class AgeRoutePredicateFactory extends AbstractRoutePredicateFactory<AgeRoutePredicateFactory.Config> {

public AgeRoutePredicateFactory() {

super(AgeRoutePredicateFactory.Config.class);

}

/**

* 断言

* @param config

* @return

*/

@Override

public Predicate<ServerWebExchange> apply(AgeRoutePredicateFactory.Config config) {

return serverWebExchange -> {

String ageStr = serverWebExchange.getRequest().getQueryParams().getFirst("age");

if (StringUtils.isNotEmpty(ageStr)) {

int age = Integer.parseInt(ageStr);

return age > config.getMinAge() && age < config.getMaxAge();

}

return true;

};

}

/**

* 用于从配置文件中获取参数赋值到配置类中的属性上

* @return

*/

@Override

public List<String> shortcutFieldOrder() {

//这里的顺序要跟配置文件中的参数顺序一致

return Arrays.asList("minAge","maxAge");

}

//配置类,用于接收配置文件中的参数

@Data

@NoArgsConstructor

public static class Config {

private int minAge;

private int maxAge;

}

}

第3步: 启动测试

#测试发现当age在(20,60)可以访问,其它范围不能访问http://localhost:7000/product-serv/product/1?age=30 http://localhost:7000/product-serv/product/1?age=10

5.6 过滤器

三个知识点:

1 作用: 过滤器就是在请求的传递过程中,对请求和响应做一些手脚

2 生命周期: Pre Post

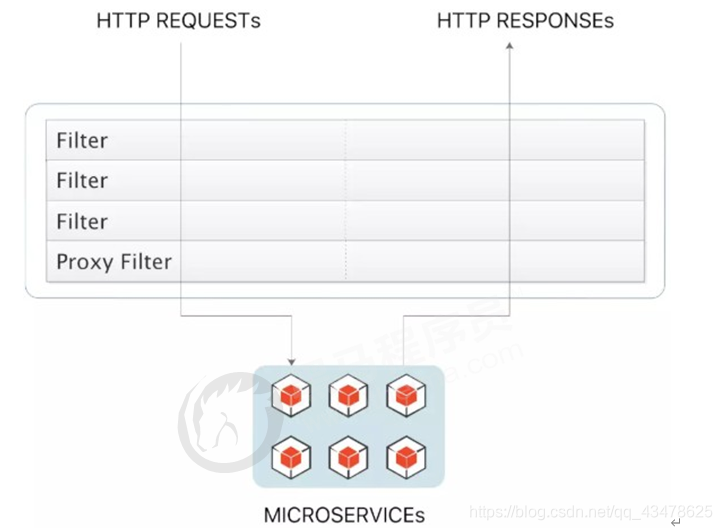

3 分类: 局部过滤器(作用在某一个路由上) 全局过滤器(作用全部路由上) 在Gateway中, Filter的生命周期只有两个:“pre” 和 “post”。

- PRE: 这种过滤器在请求被路由之前调用。我们可利用这种过滤器实现身份验证、在集群中选择请求的微服务、记录调试信息等。 - POST:这种过滤器在路由到微服务以后执行。这种过滤器可用来为响应添加标准的HTTP Header、收集统计信息和指标、将响应从微服务发送给客户端等。

Gateway 的Filter从作用范围可分为两种: GatewayFilter与GlobalFilter。 - GatewayFilter:应用到单个路由或者一个分组的路由上。

- GlobalFilter:应用到所有的路由上。

5.6.1 局部过滤器

局部过滤器是针对单个路由的过滤器。

5.6.1.1 内置局部过滤器

在SpringCloud Gateway中内置了很多不同类型的网关路由过滤器。具体如下:

| 过滤器工厂 | 作用 | 参数 |

|---|---|---|

| AddRequestHeader | 为原始请求添加Header | Header的名称及值 |

| AddRequestParameter | 为原始请求添加请求参数 | 参数名称及值 |

| AddResponseHeader | 为原始响应添加Header | Header的名称及值 |

| DedupeResponseHeader | 剔除响应头中重复的值 | 需要去重的Header名称及去重策略 |

| Hystrix | 为路由引入Hystrix的断路器保护 | HystrixCommand 的名称 |

| FallbackHeaders | 为fallbackUri的请求头中添加具体的异常信息 | Header的名称 |

| PrefixPath | 为原始请求路径添加前缀 | 前缀路径 |

| PreserveHostHeader | 为请求添加一个preserveHostHeader=true的属性,路由过滤器会检查该属性以决定是否要发送原始的Host | 无 |

| RequestRateLimiter | 用于对请求限流,限流算法为令牌桶 | keyResolver、rateLimiter、statusCode、denyEmptyKey、emptyKeyStatus |

| RedirectTo | 将原始请求重定向到指定的URL | http状态码及重定向的url |

| RemoveHopByHopHeadersFilter | 为原始请求删除IETF组织规定的一系列Header | 默认就会启用,可以通过配置指定仅删除哪些Header |

| RemoveRequestHeader | 为原始请求删除某个Header | Header名称 |

| RemoveResponseHeader | 为原始响应删除某个Header | Header名称 |

| RewritePath | 重写原始的请求路径 | 原始路径正则表达式以及重写后路径的正则表达式 |

| RewriteResponseHeader | 重写原始响应中的某个Header | Header名称,值的正则表达式,重写后的值 |

| SaveSession | 在转发请求之前,强制执行WebSession::save 操作 | 无 |

| secureHeaders | 为原始响应添加一系列起安全作用的响应头 | 无,支持修改这些安全响应头的值 |

| SetPath | 修改原始的请求路径 | 修改后的路径 |

| SetResponseHeader | 修改原始响应中某个Header的值 | Header名称,修改后的值 |

| SetStatus | 修改原始响应的状态码 | HTTP 状态码,可以是数字,也可以是字符串 |

| StripPrefix | 用于截断原始请求的路径 | 使用数字表示要截断的路径的数量 |

| Retry | 针对不同的响应进行重试 | retries、statuses、methods、series |

| RequestSize | 设置允许接收最大请求包的大 小。如果请求包大小超过设置的值,则返回 413 Payload TooLarge | 请求包大小,单位为字节,默认值为5M |

| ModifyRequestBody | 在转发请求之前修改原始请求体内容 | 修改后的请求体内容 |

| ModifyResponseBody | 修改原始响应体的内容 | 修改后的响应体内容 |

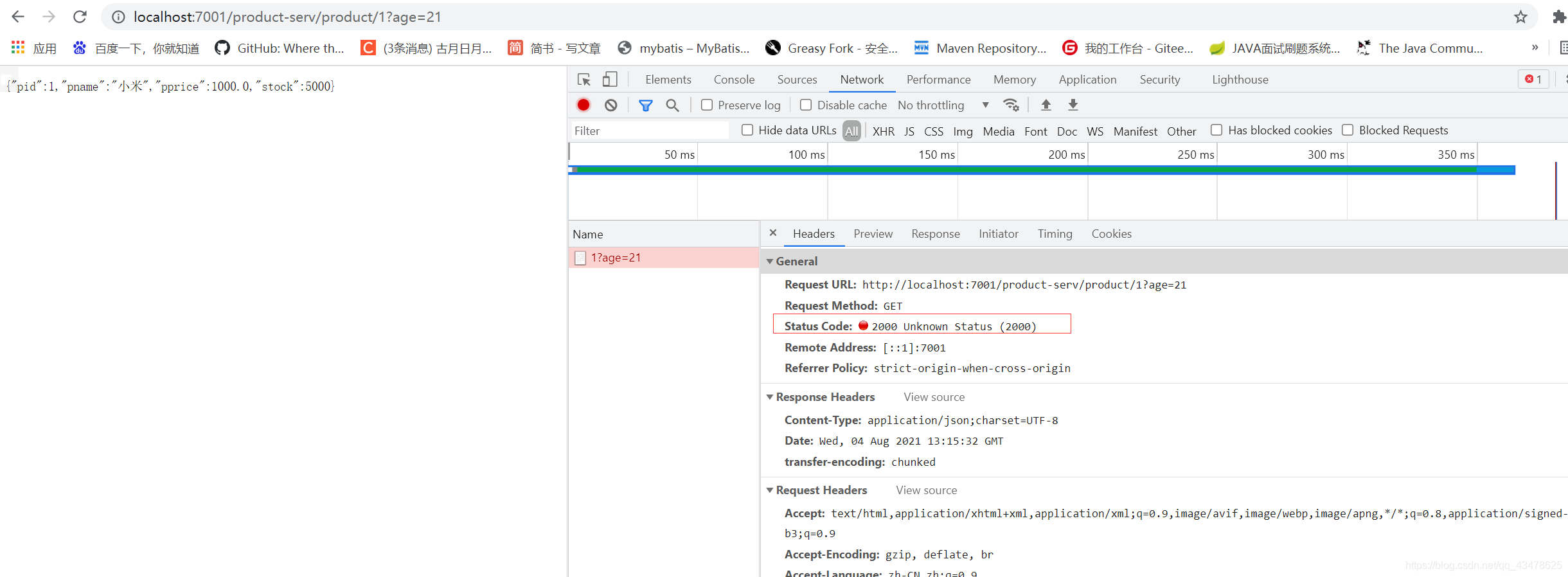

内置局部过滤器的使用

server:

port: 7001

spring:

application:

name: gateway

cloud:

nacos:

discovery:

server-addr: 127.0.0.1:8848

gateway:

discovery:

locator:

enabled: true # 让gateway可以发现nacos中的微服务

routes:

- id: product_route

uri: lb://service-product

order: 1

predicates:

- Path=/product-serv/**

filters:

- StripPrefix=1

- SetStatus=2000 # 修改返回状态

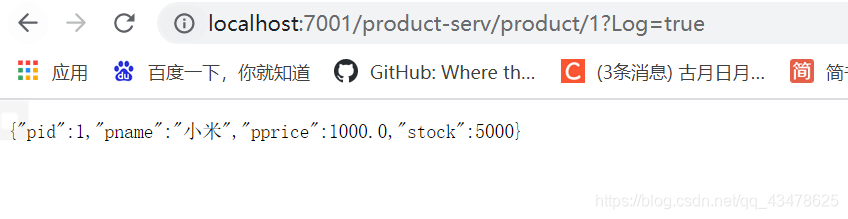

5.6.1.2 自定义局部过滤器

第1步:在配置文件中,添加一个Log的过滤器配置

server:

port: 7001

spring:

application:

name: gateway

cloud:

nacos:

discovery:

server-addr: 127.0.0.1:8848

gateway:

discovery:

locator:

enabled: true # 让gateway可以发现nacos中的微服务

routes:

- id: product_route

uri: lb://service-product

order: 1

predicates:

- Path=/product-serv/**

filters:

- StripPrefix=1

- Log=true,false # 控制日志是否开启

第2步:自定义一个过滤器工厂,实现方法

//自定义局部过滤器

@Component

public class LogGatewayFilterFactory extends AbstractGatewayFilterFactory<LogGatewayFilterFactory.Config> {

//构造函数

public LogGatewayFilterFactory(){

super(LogGatewayFilterFactory.Config.class);

}

//过滤器逻辑

@Override

public GatewayFilter apply(Config config) {

return new GatewayFilter() {

@Override

public Mono<Void> filter(ServerWebExchange exchange, GatewayFilterChain chain) {

if(config.isCacheLog()){

System.out.println("cacheLog已经开启了......");

}

if(config.isConsoleLog()){

System.out.println("consoleLog已经开启了......");

}

return chain.filter(exchange);

}

};

}

//读取配置文件中的参数赋值到配置类中

@Override

public List<String> shortcutFieldOrder() {

return Arrays.asList("consoleLog","cacheLog");

}

//配置类 接收配置参数

@Data

@NoArgsConstructor

public static class Config{

private boolean consoleLog;

private boolean cacheLog;

}

}

第3步:启动测试

5.6.2 全局过滤器

全局过滤器作用于所有路由, 无需配置。通过全局过滤器可以实现对权限的统一校验,安全性验证等功能。

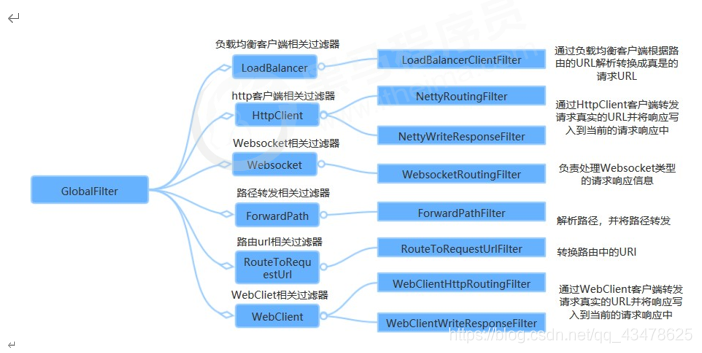

5.6.2.1 内置全局过滤器

SpringCloud Gateway 内部也是通过一系列的内置全局过滤器对整个路由进行转发处理如下:

5.6.2.2 自定义全局过滤器

内置的过滤器已经可以完成大部分的功能,但是对于企业开发的一些业务功能处理,还是需要我们 自己编写过滤器来实现的,那么我们一起通过代码的形式自定义一个过滤器,去完成统一的权限校验。

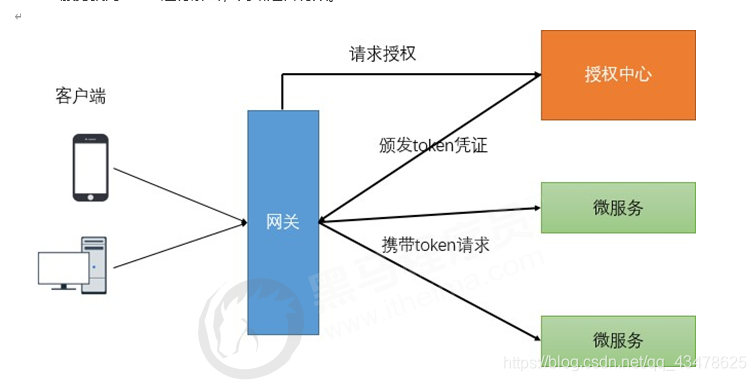

开发中的鉴权逻辑:

- 当客户端第一次请求服务时,服务端对用户进行信息认证(登录)

- 认证通过,将用户信息进行加密形成token,返回给客户端,作为登录凭证

- 以后每次请求,客户端都携带认证的token

- 服务端对token进行解密,判断是否有效。

如上图,对于验证用户是否已经登录鉴权的过程可以在网关统一检验。检验的标准就是请求中是否携带token凭证以及token的正确性。

下面的我们自定义一个GlobalFilter,去校验所有请求的请求参数中是否包含“token”,如何不包含请求

参数“token”则不转发路由,否则执行正常的逻辑。

public class AuthGlobalFilter implements GlobalFilter, Ordered {

//完成逻辑判断

@Override

public Mono<Void> filter(ServerWebExchange exchange, GatewayFilterChain chain) {

String token = exchange.getRequest().getQueryParams().getFirst("token");

if(StringUtils.isBlank(token)){

System.out.println("鉴权失败");

exchange.getResponse().setStatusCode(HttpStatus.UNAUTHORIZED);

return exchange.getResponse().setComplete();

}

//调用chain.filter继续向下游执行

return chain.filter(exchange);

}

//顺序,数值越小,优先级越高

@Override

public int getOrder() {

return 0;

}

}

5.7 网关限流

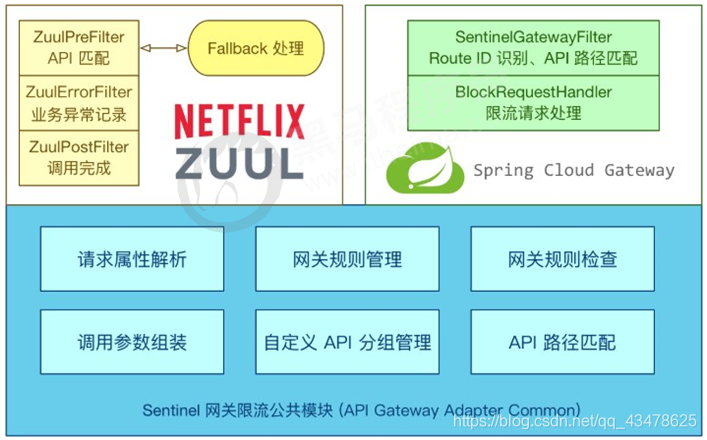

网关是所有请求的公共入口,所以可以在网关进行限流,而且限流的方式也很多,我们本次采用前 面学过的Sentinel组件来实现网关的限流。Sentinel支持对SpringCloud Gateway、Zuul等主流网关进行限流。

从1.6.0版本开始,Sentinel提供了SpringCloud Gateway的适配模块,可以提供两种资源维度的限流:

- route维度:即在Spring配置文件中配置的路由条目,资源名为对应的routeId

- 自定义API维度:用户可以利用Sentinel提供的API来自定义一些API分组

1 导入依赖

<dependency>

<groupId>com.alibaba.csp</groupId>

<artifactId>sentinel-spring-cloud-gateway-adapter</artifactId>

</dependency>

2 编写配置类

基于Sentinel 的Gateway限流是通过其提供的Filter来完成的,使用时只需注入对应的

SentinelGatewayFilter实例以及 SentinelGatewayBlockExceptionHandler 实例即可。

@Configuration

public class GatewayConfiguration {

private final List<ViewResolver> viewResolvers;

private final ServerCodecConfigurer serverCodecConfigurer;

public GatewayConfiguration(List<ViewResolver> viewResolvers, ServerCodecConfigurer serverCodecConfigurer) {

this.viewResolvers = viewResolvers;

this.serverCodecConfigurer = serverCodecConfigurer;

}

/**

* 初始化一个限流的容器

*

* @return

*/

@Bean

@Order(Ordered.HIGHEST_PRECEDENCE)

public GlobalFilter sentinelGatewayFilter() {

return new SentinelGatewayFilter();

}

/**

* 配置初始化的限流参数

*/

@PostConstruct

public void initGatewayRules() {

Set<GatewayFlowRule> rules = new HashSet<>();

rules.add(new GatewayFlowRule("product_route")//资源名称,对应路由id

.setCount(1) //限流阈值

.setIntervalSec(1) // 统计时间窗口,单位是秒,默认是1秒

);

GatewayRuleManager.loadRules(rules);

}

// 配置限流的异常处理器

@Bean

@Order(Ordered.HIGHEST_PRECEDENCE)

public SentinelGatewayBlockExceptionHandler sentinelGatewayBlockExceptionHandler() {

return new SentinelGatewayBlockExceptionHandler(viewResolvers, serverCodecConfigurer);

}

// 自定义限流异常页面

@PostConstruct

public void initBlockHandlers() {

BlockRequestHandler blockRequestHandler = new BlockRequestHandler() {

@Override

public Mono<ServerResponse> handleRequest(ServerWebExchange serverWebExchange, Throwable throwable) {

Map map = new HashMap<>();

map.put("code", 0);

map.put("message", "接口被限流了");

return ServerResponse.status(HttpStatus.OK).

contentType(MediaType.APPLICATION_JSON_UTF8)

.body(BodyInserters.fromObject(map));

}

};

GatewayCallbackManager.setBlockHandler(blockRequestHandler);

}

}

3 测试

在一秒钟内多次访问http://localhost:7001/product-serv/product/1就可以看到限流启作用了。

4 自定义API分组

自定义API分组是一种更细粒度的限流规则定义

@Configuration

public class GatewayConfiguration {

private final List<ViewResolver> viewResolvers;

private final ServerCodecConfigurer serverCodecConfigurer;

public GatewayConfiguration(List<ViewResolver> viewResolvers, ServerCodecConfigurer serverCodecConfigurer) {

this.viewResolvers = viewResolvers;

this.serverCodecConfigurer = serverCodecConfigurer;

}

/**

* 初始化一个限流的容器

*

* @return

*/

@Bean

@Order(Ordered.HIGHEST_PRECEDENCE)

public GlobalFilter sentinelGatewayFilter() {

return new SentinelGatewayFilter();

}

/**

* 配置初始化的限流参数

*/

@PostConstruct

public void initGatewayRules() {

Set<GatewayFlowRule> rules = new HashSet<>();

rules.add(new GatewayFlowRule("product_api1").setCount(1).setIntervalSec(1));

rules.add(new GatewayFlowRule("product_api2").setCount(1).setIntervalSec(1));

GatewayRuleManager.loadRules(rules);

}

/**

* 自定义API分组

*/

// @PostConstruct

private void initCustomizedApis() {

Set<ApiDefinition> definitions = new HashSet<>();

ApiDefinition api1 = new ApiDefinition("product_api1")

.setPredicateItems(new HashSet<ApiPredicateItem>() {{

// 以/product-serv/product/api1 开头的请求

add(new ApiPathPredicateItem().setPattern("/product-serv/product/api1/**").

setMatchStrategy(SentinelGatewayConstants.URL_MATCH_STRATEGY_PREFIX));

}});

ApiDefinition api2 = new ApiDefinition("product_api2")

.setPredicateItems(new HashSet<ApiPredicateItem>() {{

// 以/product-serv/product/api2/demo1 完成的url路径匹配

add(new ApiPathPredicateItem().setPattern("/product-serv/product/api2/demo1"));

}});

definitions.add(api1); definitions.add(api2);

GatewayApiDefinitionManager.loadApiDefinitions(definitions);

}

// 配置限流的异常处理器

@Bean

@Order(Ordered.HIGHEST_PRECEDENCE)

public SentinelGatewayBlockExceptionHandler sentinelGatewayBlockExceptionHandler() {

return new SentinelGatewayBlockExceptionHandler(viewResolvers, serverCodecConfigurer);

}

// 自定义限流异常页面

@PostConstruct

public void initBlockHandlers() {

BlockRequestHandler blockRequestHandler = new BlockRequestHandler() {

@Override

public Mono<ServerResponse> handleRequest(ServerWebExchange serverWebExchange, Throwable throwable) {

Map map = new HashMap<>();

map.put("code", 0);

map.put("message", "接口被限流了");

return ServerResponse.status(HttpStatus.OK).

contentType(MediaType.APPLICATION_JSON_UTF8)

.body(BodyInserters.fromObject(map));

}

};

GatewayCallbackManager.setBlockHandler(blockRequestHandler);

}

}

第六章 Sleuth–链路追踪

6.1 链路追踪介绍

在大型系统的微服务化构建中,一个系统被拆分成了许多模块。这些模块负责不同的功能,组合成 系统,最终可以提供丰富的功能。在这种架构中,一次请求往往需要涉及到多个服务。互联网应用构建 在不同的软件模块集上,这些软件模块,有可能是由不同的团队开发、可能使用不同的编程语言来实 现、有可能布在了几千台服务器,横跨多个不同的数据中心,也就意味着这种架构形式也会存在一些问 题:

- 如何快速发现问题?

- 如何判断故障影响范围?

- 如何梳理服务依赖以及依赖的合理性?

- 如何分析链路性能问题以及实时容量规划?

分布式链路追踪(Distributed Tracing),就是将一次分布式请求还原成调用链路,进行日志记录,性能监控并将一次分布式请求的调用情况集中展示。比如各个服务节点上的耗时、请求具体到达哪 台机器上、每个服务节点的请求状态等等。

常见的链路追踪技术有下面这些:

- cat 由大众点评开源,基于Java开发的实时应用监控平台,包括实时应用监控,业务监控 。 集成方案是通过代码埋点的方式来实现监控,比如: 拦截器,过滤器等。 对代码的侵入性很大,集成成本较高。风险较大。

- zipkin 由Twitter公司开源,开放源代码分布式的跟踪系统,用于收集服务的定时数据,以解决微服务架构中的延迟问题,包括:数据的收集、存储、查找和展现。该产品结合spring-cloud-sleuth 使用较为简单, 集成很方便, 但是功能较简单。

- pinpoint Pinpoint是韩国人开源的基于字节码注入的调用链分析,以及应用监控分析工具。特点是支持多种插件,UI功能强大,接入端无代码侵入。

- skywalking

SkyWalking是本土开源的基于字节码注入的调用链分析,以及应用监控分析工具。特点是支持多 种插件,UI功能较强,接入端无代码侵入。目前已加入Apache孵化器。 - Sleuth

SpringCloud 提供的分布式系统中链路追踪解决方案。

注意:SpringCloud alibaba技术栈中并没有提供自己的链路追踪技术的,我们可以采用Sleuth + Zinkin来做链路追踪解决方案

6.2 Sleuth入门

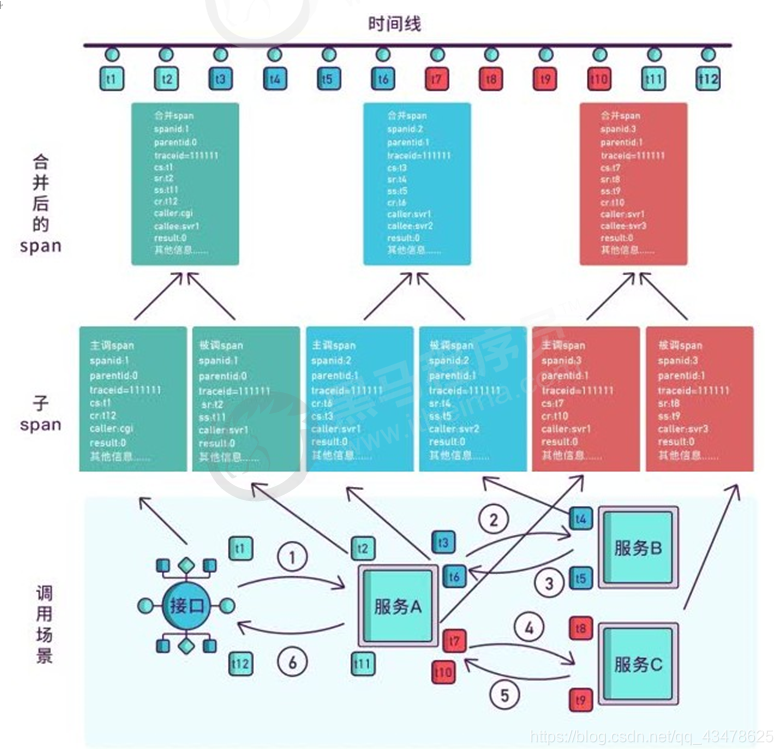

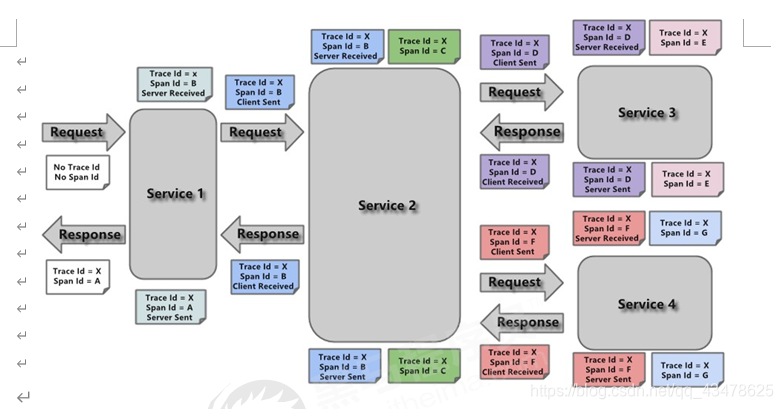

6.2.1 Sleuth介绍SpringCloud Sleuth主要功能就是在分布式系统中提供追踪解决方案。它大量借用了Google Dapper的设计, 先来了解一下Sleuth中的术语和相关概念。

- Trace

由一组Trace Id相同的Span串联形成一个树状结构。为了实现请求跟踪,当请求到达分布式系统的入口端点时,只需要服务跟踪框架为该请求创建一个唯一的标识(即TraceId),同时在分布式系 统内部流转的时候,框架始终保持传递该唯一值,直到整个请求的返回。那么我们就可以使用该唯 一标识将所有的请求串联起来,形成一条完整的请求链路。 - Span 代表了一组基本的工作单元。为了统计各处理单元的延迟,当请求到达各个服务组件的时候,也通过一个唯一标识(SpanId)来标记它的开始、具体过程和结束。通过SpanId的开始和结 束时间戳,就能统计该span的调用时间,除此之外,我们还可以获取如事件的名称。请求信息等 元数据。

- Annotation

用它记录一段时间内的事件,内部使用的重要注释:

cs(Client Send)客户端发出请求,开始一个请求的生命

sr(Server Received)服务端接受到请求开始进行处理, sr-cs = 网络延迟(服务调用的时间) ss(Server Send)服务端处理完毕准备发送到客户端,ss - sr = 服务器上的请求处理时间cr(Client Reveived)客户端接受到服务端的响应,请求结束。 cr - sr = 请求的总时间

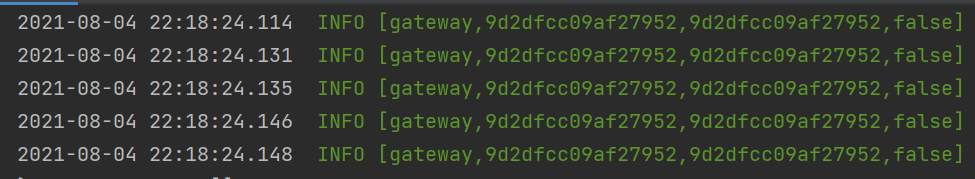

6.2.2 Sleuth入门

微服务名称, traceId, spanid,是否将链路的追踪结果输出到第三方平台

[api-gateway,3977125f73391553,3977125f73391553,false]

[service-order,3977125f73391553,57547b5bf71f8242,false]

[service-product,3977125f73391553,449f5b3f3ef8d5c5,false]

接下来通过之前的项目案例整合Sleuth,完成入门案例的编写。修改父工程引入Sleuth依赖

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-sleuth</artifactId>

</dependency>

启动微服务,调用之后,我们可以在控制台观察到sleuth的日志输出

其中 5399d5cb061971bd 是TraceId, 5399d5cb061971bd 是SpanId,依次调用有一个全局的

TraceId,将调用链路串起来。仔细分析每个微服务的日志,不难看出请求的具体过程。

查看日志文件并不是一个很好的方法,当微服务越来越多日志文件也会越来越多,通过Zipkin可以 将日志聚合,并进行可视化展示和全文检索。

6.3 Zipkin的集成

6.3.1 ZipKin介绍

Zipkin 是 Twitter 的一个开源项目,它基于Google Dapper实现,它致力于收集服务的定时数据, 以解决微服务架构中的延迟问题,包括数据的收集、存储、查找和展现。

我们可以使用它来收集各个服务器上请求链路的跟踪数据,并通过它提供的REST API接口来辅助我们查询跟踪数据以实现对分布式系统的监控程序,从而及时地发现系统中出现的延迟升高问题并找出系 统性能瓶颈的根源。

除了面向开发的 API 接口之外,它也提供了方便的UI组件来帮助我们直观的搜索跟踪信息和分析请求链路明细,比如:可以查询某段时间内各用户请求的处理时间等。

Zipkin 提供了可插拔数据存储方式:In-Memory、MySql、Cassandra 以及 Elasticsearch。

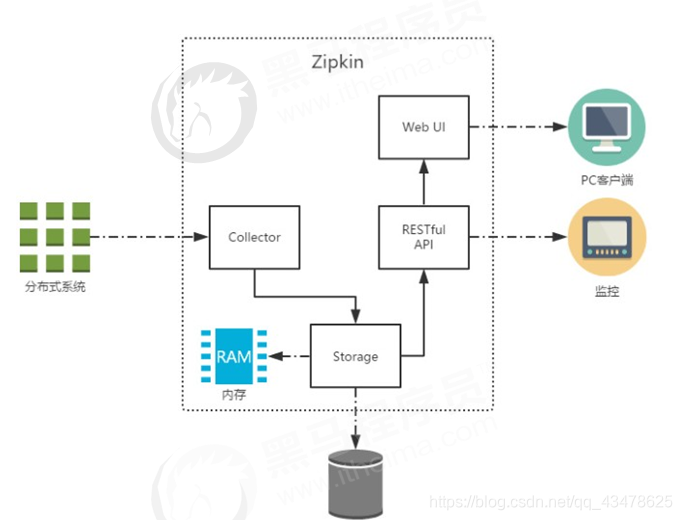

上图展示了 Zipkin 的基础架构,它主要由 4 个核心组件构成:

- Collector:收集器组件,它主要用于处理从外部系统发送过来的跟踪信息,将这些信息转换为Zipkin内部处理的 Span 格式,以支持后续的存储、分析、展示等功能。

- Storage:存储组件,它主要对处理收集器接收到的跟踪信息,默认会将这些信息存储在内存中, 我们也可以修改此存储策略,通过使用其他存储组件将跟踪信息存储到数据库中。

- RESTful API:API 组件,它主要用来提供外部访问接口。比如给客户端展示跟踪信息,或是外接系统访问以实现监控等。

- Web UI:UI 组件, 基于API组件实现的上层应用。通过UI组件用户可以方便而有直观地查询和分析跟踪信息。

Zipkin分为两端,一个是 Zipkin服务端,一个是 Zipkin客户端,客户端也就是微服务的应用。 客户端会配置服务端的 URL 地址,一旦发生服务间的调用的时候,会被配置在微服务里面的 Sleuth 的监听器监听,并生成相应的 Trace 和 Span 信息发送给服务端。

6.3.2 ZipKin服务端安装

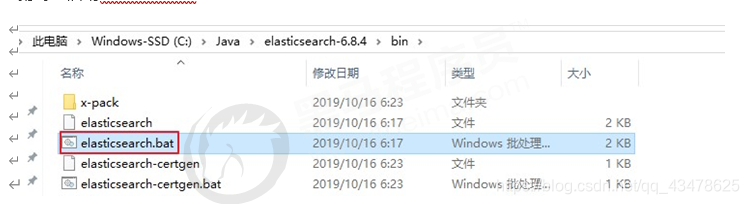

第1步: 下载ZipKin的jar包

https://search.maven.org/

访问上面的网址

第2步: 通过命令行,输入下面的命令启动ZipKin Server

java -jar zipkin-server-2.12.9-exec.jar

第3步:通过浏览器访问 http://localhost:9411访问

6.3.3 Zipkin客户端集成

ZipKin客户端和Sleuth的集成非常简单,只需要在微服务中添加其依赖和配置即可。

第1步:在每个微服务上添加依赖

<dependency>

<groupId>org.springframework.cloud</groupId>

<artifactId>spring-cloud-starter-zipkin</artifactId>

</dependency>

第2步:添加配置

spring:

zipkin:

base-url: http://127.0.0.1:9411/ #zipkin server的请求地址

discovery-client-enabled: false # 让nacos把它当成一个URL,而不要当做服务名

sleuth:

sampler:

probability: 1.0 # 采样的百分比service-product: # 调用的提供者的名称

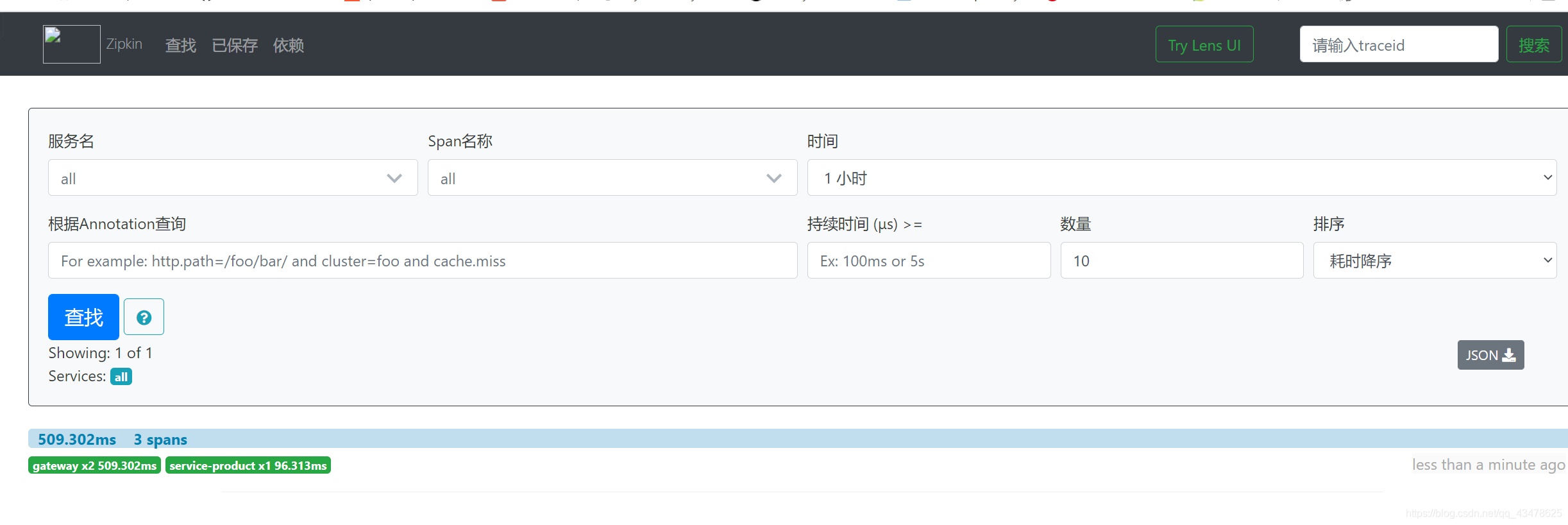

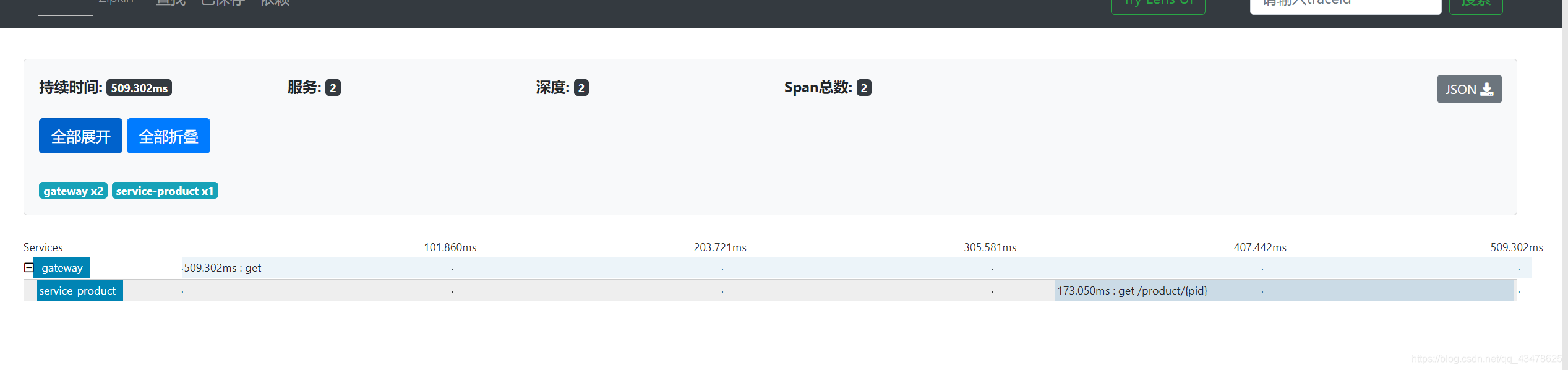

第3步: 访问微服务

http://localhost:7001/order-serv/order/prod/1

第4步: 访问zipkin的UI界面,观察效果

第5步:点击其中一条记录,可观察一次访问的详细线路。

6.4 ZipKin数据持久化

Zipkin Server默认会将追踪数据信息保存到内存,但这种方式不适合生产环境。Zipkin支持将追踪数据持久化到mysql数据库或elasticsearch中。

6.4.1 使用mysql实现数据持久化

第1步: 创建mysql数据环境

CREATE TABLE IF NOT EXISTS zipkin_spans (

`trace_id_high` BIGINT NOT NULL DEFAULT 0 COMMENT 'If non zero, this means the trace uses 128 bit traceIds instead of 64 bit',

`trace_id` BIGINT NOT NULL,

`id` BIGINT NOT NULL,

`name` VARCHAR(255) NOT NULL,

`parent_id` BIGINT,

`debug` BIT(1),

`start_ts` BIGINT COMMENT 'Span.timestamp(): epoch micros used for endTs query and to implement TTL',

`duration` BIGINT COMMENT 'Span.duration(): micros used for minDuration and maxDuration query'

) ENGINE=InnoDB ROW_FORMAT=COMPRESSED CHARACTER SET=utf8 COLLATE

utf8_general_ci;

ALTER TABLE zipkin_spans ADD UNIQUE KEY(`trace_id_high`, `trace_id`, `id`) COMMENT 'ignore insert on duplicate';

ALTER TABLE zipkin_spans ADD INDEX(`trace_id_high`, `trace_id`, `id`) COMMENT 'for joining with zipkin_annotations';

ALTER TABLE zipkin_spans ADD INDEX(`trace_id_high`, `trace_id`) COMMENT 'for getTracesByIds';

ALTER TABLE zipkin_spans ADD INDEX(`name`) COMMENT 'for getTraces and getSpanNames';

ALTER TABLE zipkin_spans ADD INDEX(`start_ts`) COMMENT 'for getTraces ordering and range';

CREATE TABLE IF NOT EXISTS zipkin_annotations (