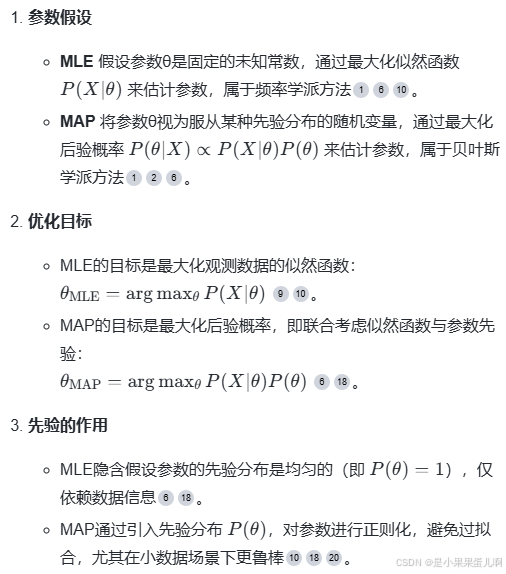

区别和联系:

- MLE:MLE是一种基于观测数据来评估模型参数的方法,它假设模型已定,参数未知。MLE的目标是找到使观测数据最可能发生的参数值,即最大化似然函数。MLE不考虑先验信息,仅依赖于观测数据本身,因此在数据量较少时容易受到噪声或偏差的影响。

- MAP:MAP在MLE的基础上引入了先验信息,结合了观测数据和先验概率来估计参数。MAP的目标是最大化后验概率,即同时考虑似然函数和先验概率。当先验信息准确时,MAP能够提供更稳定和合理的估计结果。

直观对比:

性能比较:

特性 MLE MAP 目标函数 最大化似然 $P(D \theta)$ 先验信息 无 依赖先验分布 P(\theta)P(θ) 过拟合风险 高(尤其数据少时) 低(先验起正则化作用) 典型应用 简单模型(如线性回归) 复杂模型(如带正则化的分类)

- 随着样本数量的增加,MLE和MAP的估计结果会逐渐接近真实值。研究表明,随着样本数量的增加,MLE的误差会逐渐减小,并在一定样本数量后趋于稳定。

- MAP在某些情况下可能会比MLE更优,尤其是在先验信息较为准确的情况下。例如,在半范数下的实验中,MAP与MSE之间的差距在不同样本数量下有所不同,但总体上MAP的表现优于MLE。

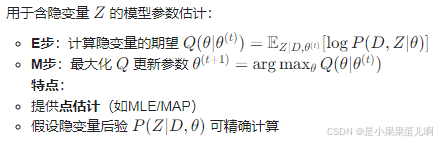

EM算法

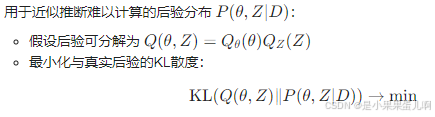

变分贝叶斯

特性 EM算法 变分贝叶斯(VB) 输出类型 参数点估计(\thetaθ) 后验分布近似(Q(\theta,Z)Q(θ,Z)) 隐变量处理 精确计算期望(E步) 近似变分分布(如均值场假设) 计算复杂度 低(仅需迭代优化) 高(需优化变分参数) 不确定性量化 无 是(通过分布方差) 典型应用 GMM参数估计、HMM训练 主题模型(LDA)、深度学习贝叶斯神经网络

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?