引言

数据预处理对结果很重要,例如处理数据时的标准化输入特征,将参数量级统一,配合优化器使用。

中间层变量变化可能范围大,需要对学习率补偿调整

更深层的网络复杂,容易过拟合

作用

作用于深层网络

可使用大Learning rate,加速收敛

不改变精度

方式

batch范围

单个batch无法使用,其减去均值为0。

batch范围50-100,中等小批量

计算方式

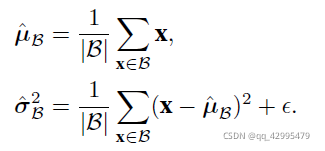

在每个batch中计算均值与方差

最后一项>0,防止除以0

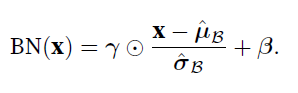

批量归一化

γ与β为可学习参数

作用位置

全连接、卷积输出上,激活函数前

全连接、卷积输入上

(全连接的特征维,卷积通道维)

小结

最初文章:减少内部协变量转移

后续研究:通过小批量加入噪音,控制模型复杂度,类似于正则化。因而不与dropout一同使用。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?